春节以后这一个半月,算了下我前后也做了 20+的企业知识库落地咨询,其中无论是线上还是线下,被问到最多的一个问题是:

要快速落地本地部署的知识库,应该购买什么硬件?

要回答这个问题,其实需要明确很多前置定语,自购 GPU 硬件、大模型一体机、以及选择云端 GPU 都有各自适用的情形。这篇试图说清楚三种部署方式的主要特点对比,并在文末给些选择建议参考。

以下,enjoy:

1、自购 GPU 硬件

以 NVIDIA GeForce RTX 4090 GPU (24GB 显存)为例,我接触到的企业方里不乏有些已经屯了几块,但是大部分都在吃灰,主要这玩意配置起来有些小门槛,下面结合两张 4090 部署 DeepSeek R1 qwen 32B 为例做个简要的部署流程介绍,供参考:

1.1 硬件配置

显卡

使用两张 NVIDIA RTX 4090 显卡(单卡 24GB 显存),需要通过张量并行实现显存共享与计算加速。

推荐 PCIe 4.0 x8/x8 通道拆分,确保双卡间数据交互带宽充足。

主板与 CPU

主板需支持双 PCIe 4.0 插槽(如 Z790/Z890 芯片组)。

CPU 建议选择多核型号(如 Intel i9-14900K 或 AMD Ryzen 9 7950X),以处理数据加载与多任务调度。

内存与存储

内存至少 64GB DDR5(推荐 128GB),提升模型加载效率。

存储需 1TB NVMe SSD,用于存放模型文件(约 20-40GB)。

电源与散热

电源建议 1300W 以上(单卡 TDP 450W,双卡+系统需预留余量)。

配备高效风冷或水冷系统,确保长时间运行稳定性。

1.2 软件环境配置

操作系统推荐选择 Ubuntu 22.04 LTS,或者 Windows 11(但是需要 WSL2 支持)。安装 NVIDIA 驱动(≥535 版本)和 CUDA Toolkit 12.2,支持 Ampere 架构优化。

另外因为是双卡,所以要验证下驱动,nvidia-smi 显示双卡状态,nvcc -V 确认 CUDA 版本。

安装 PyTorch(≥2.4.0)与 CUDA 适配版本, vLLM版本≥0.5.5。

1.3 模型部署与 vLLM 配置

从HuggingFace或魔塔社区下载 DeepSeek R1-32B-GPTQ-Int4 量化模型:

使用以下命令启动双卡并行推理服务:

关键参数说明:

tensor-parallel-size 2:启用双卡张量并行。

1.4 并发优化

实测双卡 RTX 4090 在 4-bit 量化下,生成吞吐量可达 60-80 tokens/s(单卡约 35-45 tokens/s)。可以根据显存和请求长度调整--max-num-seqs(默认 256),单卡可支持 10-20 并发请求。使用 Nginx 反向代理可以实现多实例负载均衡,从而提升整体吞吐。

RAG 框架部署部分,为了节省篇幅就不赘述了,大家自行去各个产品官网去看,基本就是 git+docker compose 的一键操作。

自购 GPU门槛主要在于需要自行解决安装配置、驱动兼容、散热等问题,需要额外承担电费和维护成本,当然好处就是自由度高,可以根据需求自定义硬件配置,也不需要担心数据隐私和安全问题。

2、大模型一体机

上面说了自购硬件的各种配置操作,在一体机这里倒不是个问题。目前市场上也有很多款专门 DeepSeek 设计的一体机,我也偶尔会收到些一体机厂商的合作沟通。

这些都预装了软硬件环境,有针对国产芯片的优化版本,比如基于华为昇腾、百度昆仑芯等,价格范围一般中低端配置在几万块,中高端就几十万水平,具体取决于品牌、硬件配置和功能需求。

好处很明显,就是开箱即用,内置了多种应用场景,如语音识别、图像识别、自然语言处理等,不需要复杂配置即可快速上手,厂商通常提供统一的管理界面。

劣势除了价格外,就是无法根据企业需求灵活升级性能,一般只能使用厂商提供的模型和工具。但有一说一,这种确实比较缺乏专业 IT 团队进行配置和维护的企业。

3、云端 GPU

3.1 6 大 GPU 厂商

云端 GPU 部署是指租用云服务商(如阿里云、腾讯云、AWS 等)提供的 GPU 实例,来部署大模型和 RAG 框架。根据实际使用的资源按需付费,特别适合初学者或短期 POC 验证。下面贴了两张全球六大云服务商的地域分布和实例类型的对比,大家做个参考。

以上两张图片来自fastone官网

价格方面根据实例配置收费差别很大,对于初期测试 RTX 4090 为例也就够用了,但是很遗憾的是目前阿里云、腾讯云等主流平台主要提供 NVIDIA A100、V100、T4 等专业计算卡,尚未推出基于 RTX 4090 的实例。以下贴了张从阿里云官网找的主流实例类型和价格,大家做个参考:

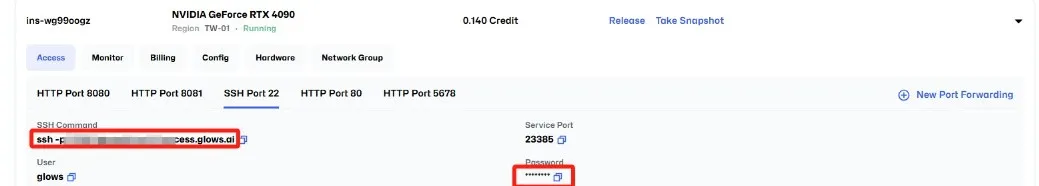

3.2 glows.ai

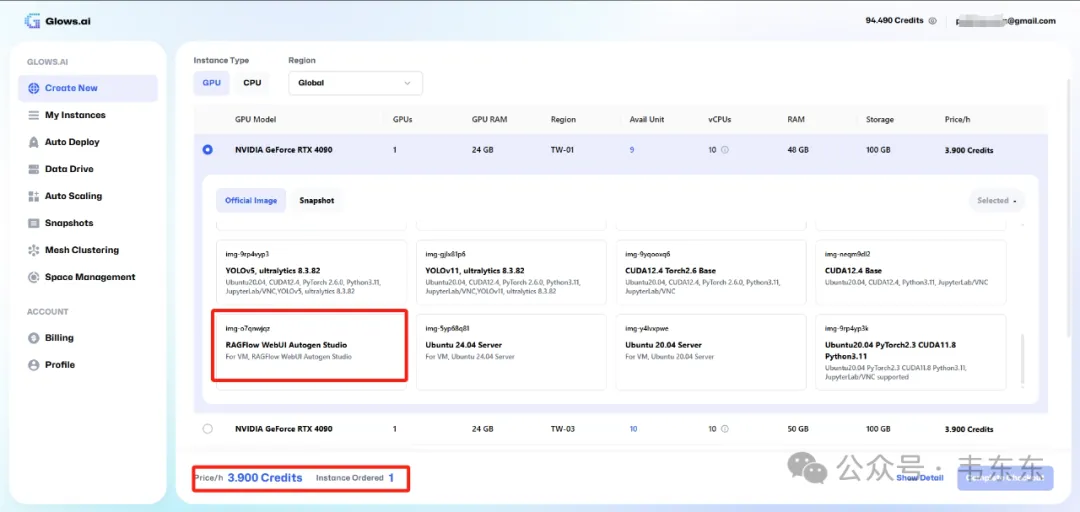

为了更加便宜的进行测试,这里推荐个 glows.ai 平台(不是广告)可以选择 4090 的实例,而且很神奇的是,其中居然有个 RAGFlow 实例已预装好相关环境和框架,主打一个开箱即用。

价格方面,每小时需要 3.9 个 credits( RTX 4090 GPU (24GB 显存,10 个 vCPU,48GB 内存,100GB 存储空间)。我充值了 10 刀有 100 个 credits,差不多 2.8 元每小时,这个价格很适合个人或者小企业来进行短期测试,我现在在给一些企业做 demo 的时候,也是在上面进行操作的。

https://glows.ai/invite/Glows-69kjxn2p (注册链接,无免费额度)

(注:第三方小厂商的稳定性与技术支持,大家自行测评)

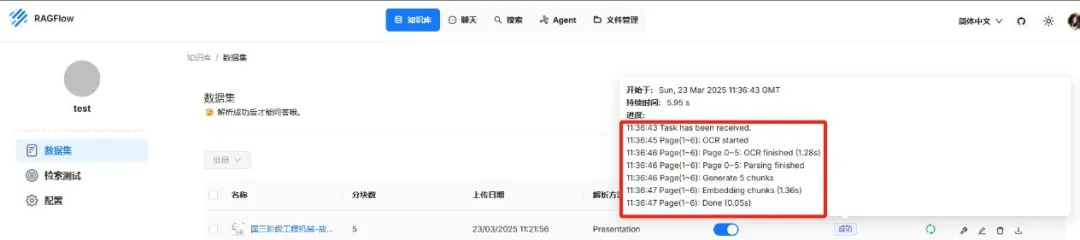

关于使用方式上,最直接的是打开提供的网页链接访问 ragflow 的网站,这个效果和本地使用 docker 部署后使用 localhost 打开是一样的用法,唯一不同的就是确实会比自己集成显卡的电脑解析文档快些。

不过还是推荐使用 romote ssh 插件进行连接,这样就可以在本地通过 ragflow 的官方 python api 或者 http api 编写一些自定义的处理脚本,从而更好的实现行业特定的分块策略,以及专业领域的检索优化。

(此处插播个广告,欢迎去试下我在知识星球发布的部分脚本。p.s.下周会建会员群交流日常实践)

如果在做好前两项的基础上,可以再进一步探索嵌入模型的对比,上下文构建等。当然,具体情况还需要根据实际项目特点和资源限制来调整。

需要说明的是,在云端 GPU 这种 RAG 部署方式下,我没有展开介绍开源模型的部署过程,这是以为既然选择了云端测试就更没必要做 LLM 的单独部署,如果后续考虑在本地部署 DeepSeek-R1-Distill-Qwen-32B(目前接触企业的主流选择),那就在云端测试环节也直接调用这个 LLM 的 API 即可。

我主要在用的是 siliconflow 这个平台,大家可以做个参考。https://cloud.siliconflow.cn/models?target=deepseek-ai/DeepSeek-R1-Distill-Qwen-32B 。 当然,Qwen 系列的 QwQ-32B 也可以同步对比下看看。

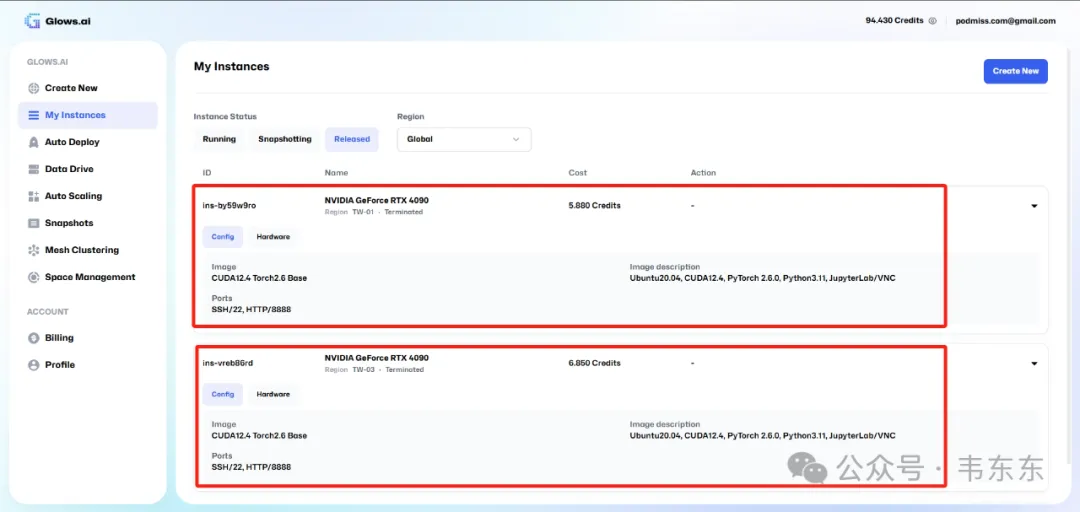

另外,对于云端 GPU 的测试方案,当想要释放云端资源停止计费时,有几种方法可以保存代码和文件。最简单的就是在 VS Code 中,直接从远程文件资源管理器中将文件拖放到本地窗口。当然,如果项目已经使用 Git 管理,只需确保所有更改都已提交并推送到远程仓库。另外,Glows.ai 也提供了"Snapshot"功能,在释放实例前创建快照,下次可以从快照快速恢复环境。

4、结语

选择 RAG 系统的部署方式没有一刀切的标准答案,需要企业根据自身的业务需求、技术能力、预算情况和安全合规要求综合考量。

- 对于对数据安全要求很高、长期使用且有 IT 团队的企业,自购 GPU 硬件可能是理想选择;

- 但对于技术能力有限但预算充足的企业,大模型一体机提供了便捷的解决方案;

- 而对于初创企业、需求波动大或短期项目,云端 GPU 服务则提供了最灵活的选择。

Anyway,个人建议先从小规模云服务开始做 POC 验证,RAG 各个核心组件的调优本也需要花点功夫去适配业务场景,完成初步调试后先在企业内部做小范围试点,随着业务的成熟和规模的扩大,再考虑迁移到更符合长期战略的部署方式。