Magic Mirror 可以生成合成身份配对的视频数据。该框架利用视频扩散模型,能够在保持身份一致性的同时,生成具有电影级质量和动态运动的视频。

Magic Mirror 根据 ID 参考图像生成文本转视频结果。每对视频显示 24 帧(总共 49 帧),其对应的面部参考显示在左下角。

相关链接

- 论文:http://arxiv.org/abs/2501.03931v1

- 主页:https://julianjuaner.github.io/projects/MagicMirror/

论文介绍

Magic Mirror 是一个用于生成具有电影级质量和动态运动的身份保留视频的框架。虽然视频扩散模型的最新进展在文本到视频生成方面表现出了令人印象深刻的能力,但在产生自然运动的同时保持一致的身份仍然具有挑战性。以前的方法要么需要针对个人进行微调,要么难以平衡身份保留与运动多样性。

Magic Mirror 是一个用于生成具有电影级质量和动态运动的身份保留视频的框架。虽然视频扩散模型的最新进展在文本到视频生成方面表现出了令人印象深刻的能力,但在产生自然运动的同时保持一致的身份仍然具有挑战性。以前的方法要么需要针对个人进行微调,要么难以平衡身份保留与运动多样性。

Magic Mirror基于视频扩散变换器,引入了三个关键组件:

- 双分支面部特征提取器,可同时捕获身份和结构特征;

- 具有条件自适应规范化的轻量级跨模态适配器,可实现有效的身份集成;

- 结合合成身份对和视频数据的两阶段训练策略。

大量实验表明Magic Mirror 有效地平衡了身份一致性和自然运动,在多个指标上优于现有方法,同时只需添加最少的参数。

Magic Mirror 可生成动态面部动作。由于身份保留约束较强,IDAnimator 和 Video Ocean 的运动范围有限。Magic Mirror 在保持参考身份保真度的同时,实现了更加动态的面部表情。

方法

Magic Mirror 概述。 该框架采用双分支特征提取系统,包括 ID 和面部感知器,然后是跨模态适配器,用于基于 DiT 的视频生成。通过优化火焰标记的可训练模块,我们的方法可以有效地整合面部特征,实现受控的视频合成,同时保持模型效率。

Magic Mirror的方法可分为以下几个关键组成部分:

- 双分支面部特征提取器:该组件同时提取身份特征和结构信息,确保在视频生成中保持高水平的身份一致性。

- 轻量级跨模态适配器:该适配器集成到视频扩散模型中,允许在生成过程中有效地结合面部特征和文本提示。

- 条件自适应归一化(CAN):此模块用于在生成过程中动态调整面部特征的分布,确保在不同视频帧之间保持一致的身份特征。

- 两阶段训练策略:首先在图像数据上进行预训练,以学习稳健的身份表示,然后在视频数据上进行微调,以确保面部表情的时间一致性。

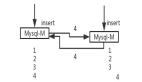

DiT 块中的跨模态适配器,具有条件自适应归一化 (CAN),用于特定模态的特征调制和解耦注意力整合。

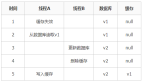

训练数据集概述。 管道包括图像预训练数据(A-D)和视频后训练数据(D)。利用自参考数据(A,B)和具有相同身份的过滤合成对(C,D)。报告了(图像+合成图像)的数量。

实验

定性比较。 每个案例的左上角均显示标题和参考身份图像。

消融研究示例。 左:消融模块。右:消融和训练策略。

使用 Magic Mirror 生成图像。图像预训练阶段的模型会捕获参考 ID 的 ID 嵌入(Ref-ID),但在某些低级分布(如图像质量、风格和背景)上会出现过度拟合。

视频生成结果。 结果展示了 Magic Mirror 在不同面部比例和构图中的能力。

总结

Magic Mirror是一个用于身份保留视频生成的零样本框架。Magic Mirror 将双人脸嵌入和条件自适应规范化 (CAN) 融入基于 DiT 的架构中。该方法可以实现强大的身份保留和稳定的训练收敛。实验表明Magic Mirror 可以从单个参考图像生成高质量的个性化视频,同时保持身份一致性,在多个基准和人工评估中的表现优于现有方法。