作者 | 朱雀实验室

随着DeepSeek R1等开源大模型的火爆,越来越多的开发者、企业甚至开始尝试在本地部署大语言模型,享受AI带来的便利。

然而近期腾讯混元安全团队-朱雀实验室发现:这些广受欢迎的AI工具中有不少存在安全隐患。如果使用不当,攻击者可能窃取用户数据、滥用算力资源,甚至控制用户设备。

在见证行业多个AI系统因安全漏洞陷入被动后,我们选择用工程师的方式回应:

做一把简单趁手的"安全体检工具箱"——AI-Infra-Guard,让每个开发者都能快速诊断系统风险。

一、AI基础设施存在哪些安全风险?

比如:

- 个人开发者在docker中部署ollama测试模型,却发现GPU算力一直被占有?

- 创业公司因ComfyUI插件漏洞导致其未发布的模型泄漏被窃取?

- 工程师通宵定位推理服务卡顿问题,最终发现是Triton漏洞导致服务器被挖矿?

Ollama、OpenWebUI、ComfyUI这些名字是不是耳熟能详?多少大模型教程里都离不开它们。然而不正确的使用会造成重大安全隐患。

1. Ollama

Ollama是一个广泛使用的开源应用程序,可以在本地部署和操作大型语言模型,现在已成为最流行的的个人电脑跑大模型的方案,网络上大部分本地部署大模型的文章也是推荐的此工具。

Ollama默认启动时会开放11434端口,并在此端口上使用restful api执行核心功能。默认情况下ollama只会在本地开放端口,但是在Ollama的官方docker中,默认开放到公网上。

ollama对这些接口普遍没有鉴权,导致攻击者扫描到这些ollama的开放服务后可以进行一系列攻击。

(1) 模型删除

通过删除接口删除模型。

(2) 模型窃取

ollama支持自定义镜像源,自建一个镜像服务器,通过查看已安装模型,再通过上传接口即可获得私有模型文件。

(3) 算力窃取

通过查看已安装模型,之后用对话接口请求对话,窃取了目标机器的算力。

(4) 模型投毒

通过下载接口下载有毒的模型,接着通过删除接口删除正常模型,再通过模型复制接口接口迁移有毒模型到正常模型路径,通过有毒模型污染使用者的对话。

(5) ollama远程命令执行漏洞【CVE-2024-37032】

ollama在去年6月爆发过严重的远程命令执行漏洞【CVE-2024-37032】,允许远程代码执行(RCE),CVSSv3评分为9.1。通过自建镜像伪造manifest文件,实现任意文件读写和远程代码执行。漏洞影响Ollama 0.1.34之前的版本

2. OpenWebUI

openwebui是现在最流行的大模型对话webui,包含大模型聊天,上传图片,RAG等多种功能且方便与ollama集成。也是现在deepseek本地化部署常见的搭配。openwebui在历史上也出现过严重漏洞。

【CVE-2024-6707】

用户上传文件时,文件会被存储到静态上传目录。上传文件名可伪造,未进行校验,通过构造特殊的文件名,将文件写入至任意目录从而导致恶意代码或命令执行风险。

3. ComfyUI

除了文生文大模型,文生图模型也是非常热点的领域。ComfyUI是现在最流行的diffusion模型应用,因其丰富的插件生态和高度定制化节点闻名,常用于文生图、文生视频等领域。

ComfyUI和Ollama一样,开发者最初可能只想在本地使用,没有任何鉴权方式,目前也有大量开放到公网的ComfyUI应用。

ComfyUI因为插件生态闻名,但是插件的作者一般为个人开发者,对安全性没有太多审查,腾讯朱雀实验室在去年就发现多个ComfyUI及其插件漏洞。

朱雀实验室历史发现漏洞:

漏洞标题 | 漏洞评级 | 官方补丁状态 |

ComfyUI 前台未授权代码执行漏洞 | 高危 | 修复中 |

ComfyUI Comfy_mtb插件远程代码执行漏洞 | 高危 | 已修复、有补丁 |

ComfyUI-Prompt-Preview插件 任意文件读取漏洞 | 中危 | 修复中 |

ComfyUI Comfy_mtb插件远程代码执行漏洞 | 高危 | 修复中 |

ComfyUI-Custom-Scripts插件任意文件读取漏洞 | 中危 | 修复中 |

ComfyUI核心反序列化漏洞 | 高危 | 已修复 |

ComfyUI MTB MathExpression插件远程代码执行漏洞 | 高危 | 已修复、有补丁 |

ComfyUI 核心节点反序列化远程代码执行 | 高危 | 修复中 |

ComfyUI Easyuse插件持续性拒绝服务漏洞 | 高危 | 修复中 |

ComfyUI ACE插件远程代码执行漏洞 | 高危 | 修复中 |

ComfyUI Ventrue插件SSRF漏洞 | 中危 | 修复中 |

ComfyUI Easyuse插件敏感信息泄露 | 低危 | 修复中 |

以上大部分漏洞影响ComfyUI全系列核心代码(包含目前最新版本),部分流行插件,影响包括远程命令执行、任意文件读取/写入,数据窃取等。

二、从DeepSeek看大模型基础设施的安全挑战

作为中国AI领域的标杆企业,DeepSeek在突破性模型研发与工程实践上展现了卓越能力。然而,在上线初期,也因基础设施配置和组件安全问题遭遇了大量攻击。

如何精准识别基础设施组件的安全配置缺陷、CVE漏洞等,是行业共性难题,也展现了AI基础设施安全防护的复杂与挑战。这类问题往往源于AI基础设施的快速迭代特性——开发团队需要同时应对模型优化、算力调度、组件集成等多重技术挑战,疏忽了常见底层组件默认开放端口且无需认证的特性,也极易在架构设计中被简化为『内网环境无需防护』的误判。

AI-Infra-Guard正是为解决此类痛点而生。通过深度集成AI常用组件(不仅包含数据库类别,也包含AI推理、部署、训练、应用、工作流等的常见开源组件)的安全基线检测能力,该工具可自动识别未授权访问、历史CVE漏洞暴露等风险。

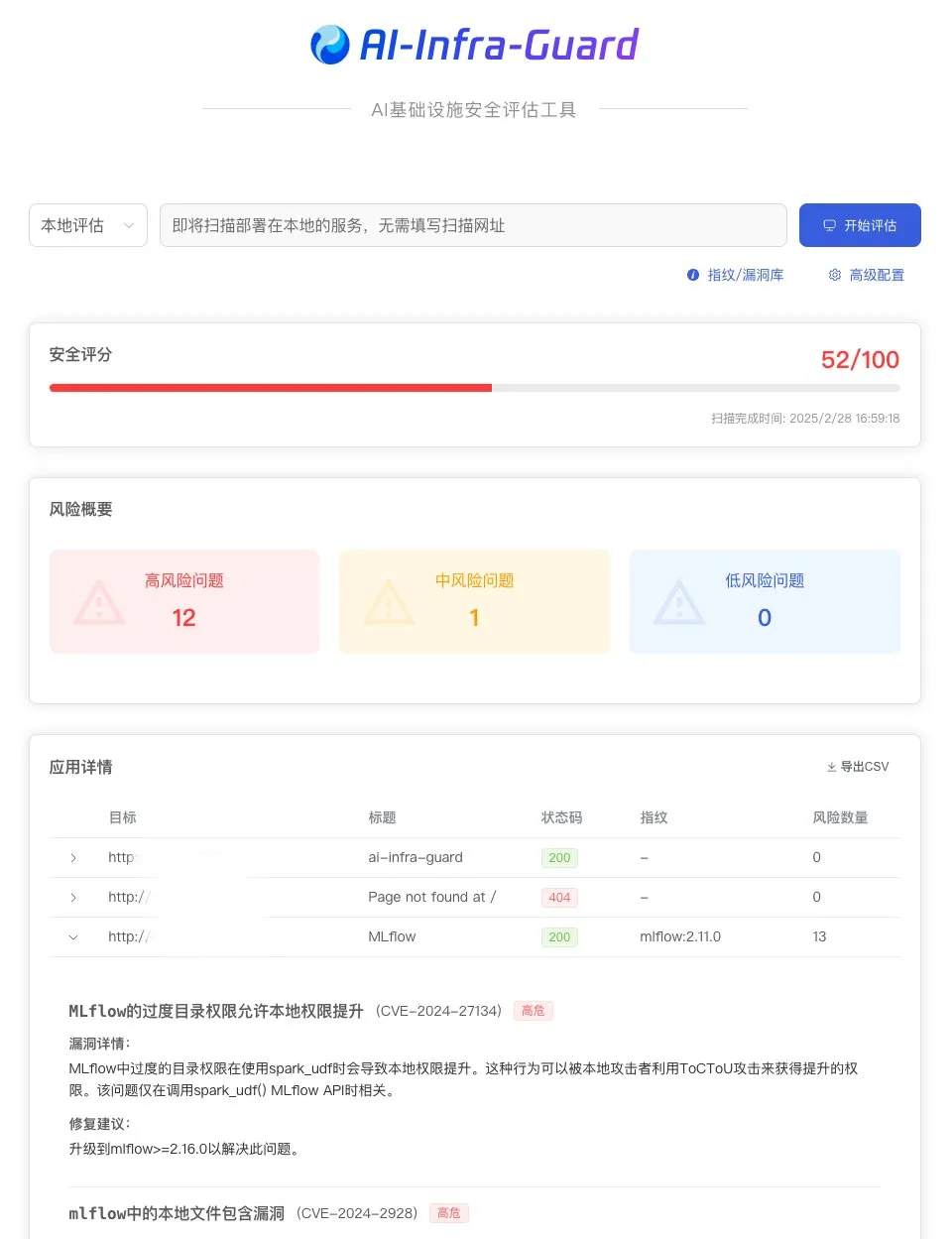

三、AI-Infra-Guard: AI风险一键检测

AI Infra Guard(AI Infrastructure Guard) 是一个高效、轻量、易用的AI基础设施安全评估工具,专为发现和检测AI系统潜在安全风险而设计。目前已经支持检测30种AI组件,并基于团队对大模型供应链安全漏洞的研究、不仅支持常见的AI应用dify、comfyui、openwebui,也支持像ragflow、langchain、llama-factory等开发训练框架的指纹识别以及的漏洞检测。

支持WebUI界面,让安全检测更直观。

- 对于个人用户,可以使用本地评估功能,将对本地开放端口进行检查,识别AI组件,并给出安全建议。

- 对于开发者/运维,可以使用远程评估功能,检测部署AI服务的安全性,可以直接输入ip/域名一键评估。

使用友好:

- 零依赖,开箱即用,编译后的二进制文件极小

- 内存占用<50MB,扫完千节点集群不卡顿

- 跨平台兼容,同时支持Windows/MacOS/Linux

- WEBUI支持,点几下鼠标就能一键检测

1. AI组件漏洞覆盖

AI-Infra-Guard目前已支持检测主流AI框架和应用的众多漏洞:

组件名称 | 组件简介 | 漏洞覆盖数量 |

anythingllm | 用于使用任何大语言模型(LLM)与文档对话的AI应用,确保隐私和易用性。 | 8 |

langchain | 一个灵活的开源框架,用于构建利用大语言模型与外部数据源的应用。 | 33 |

clickhouse | 一个高性能的开源列式数据库,适合实时分析处理。 | 22 |

comfy_mtb | 一个ComfyUI扩展,提供用于AI艺术创作的动画和图像处理节点。 | 1 |

ComfyUI-Prompt-Preview | 一个ComfyUI扩展,用于可视化sdxl_prompt_styler的提示风格。 | 1 |

ComfyUI-Custom-Scripts | 一个集合,包含自定义脚本和节点,增强ComfyUI的用户界面和功能。 | 1 |

comfyui | 一个基于节点的图形界面,用于使用Stable Diffusion等扩散模型创建AI艺术。 | 1 |

fastchat | 一个开源平台,用于训练、服务和评估大语言模型。 | 1 |

gradio | 一个开源Python库,用于创建共享和交互机器学习模型的网页界面。一个基于网页的交互式开发环境,支持创建和共享包含笔记本、代码和数据的计算文档。 | 42 |

jupyterlab | 一个基于网页的交互式开发环境,支持创建和共享包含笔记本、代码和数据的计算文档。 | 6 |

jupyter-notebook | 为Jupyter网页应用(如Notebook和Lab)提供核心服务和API的后端组件。 | 1 |

jupyter-server | 为Jupyter网页应用(如Notebook和Lab)提供核心服务和API的后端组件。 | 13 |

kubeflow | 一个开源平台,简化在Kubernetes上部署和管理机器学习工作流,覆盖ML生命周期各阶段。 | 4 |

kubepi | 一个CLI工具,简化在Raspberry Pi设备上设置和管理Kubeflow的环境。 | 5 |

llamafactory | 一个统一框架,用于高效微调100多个大语言模型和视觉语言模型,提供LLaMA Board网页界面。 | 1 |

llmstudio | H2O.ai提供的框架和无代码GUI,用于微调大型语言模型。 | 1 |

ollama | 一个开源工具,允许在本地运行大语言模型,确保数据隐私和控制。 | 8 |

open-webui | 一个开源、自托管的AI平台,提供用户友好的本地运行大语言模型的界面,支持Ollama等运行器。 | 8 |

pyload-ng | 一个用Python编写的免费开源下载管理器,提供基于网页的界面管理跨平台下载。 | 18 |

qanything | 开源企业级本地知识库问答系统,支持多种数据格式和数据库的本地查询。 | 2 |

ragflow | 一个开源RAG引擎,通过深度文档理解增强AI能力,提供准确的、引用支持的回答。 | 2 |

ray | 一个开源框架,用于扩展AI和Python应用,提供分布式计算和机器学习工作负载的统一方式。 | 4 |

vllm | 一个高性能开源引擎,用于高效推理和服务大语言模型,优化速度和内存使用。 | 5 |

triton-inference-server | Triton 推理服务器提供优化的云和边缘推理解决方案。 | 7 |

2. 使用说明

启动webui可视化检测:

ai-infra-guard -ws对于开发者/运维,也提供命令行参数,方便各功能与CI/CD等自动化系统集成:

# 本地检测

ai-infra-guard -localscan

# 单个目标

ai-infra-guard -target [IP:PORT/域名]

# 多个目标

ai-infra-guard -target [IP:PORT/域名] -target [IP:PORT/域名]

# 扫描网段寻找AI服务

ai-infra-guard -target 192.168.1.0/24

# 从文件读取目标扫描ai-infra-guard -file target.tx四、写在最后

我们从不相信‘绝对安全’的传说,但至少可以让漏洞的发现速度,比黑客的咖啡凉得更快一些。

AI Infra Guard 是混元安全团队-朱雀实验室在过去一年里,围绕混元大模型安全开展深入研究和实践的基础上,逐步落地的一套大模型软件供应链安全解决方案。我们将AI-Infra-Guard完全开源,让每个团队和开发者都能免费使用,保护 AI 基础设施免受软件供应链攻击的威胁。

还记得文章开头提到的那些安全漏洞吗?每个使用大模型的团队都可能在不知不觉中面临这些风险。不管是个人开发者还是运维团队,我们做了一个最直观的“安全评分”方式来展示当前系统的安全问题。

通过以下几步,查看你AI系统的评分:

- 下载地址:(https://github.com/Tencent/AI-Infra-Guard/releases),挑个适合你系统的版本。

- 一键开测:运行ai-infra-guard -ws,打开浏览器,查看你的安全评分。

项目介绍:GitHub - Tencent/AI-Infra-Guard: AI infrastructure security assessment tool designed to discover and detect potential security risks in AI systems.

本项目已进入DeepSeek官方 Awesome DeepSeek Integrations推荐应用清单。

欢迎大家Star、体验并反馈,特别想对参与共建的同行者说:

”你们推送的每一个commit,都在重新定义AI世界的安全水位线。”