就在刚刚,阿里Qwen 团队 正式发布了他们最新的研究成果 —— QwQ-32B 大语言模型! 这款模型不仅名字萌萌哒 (QwQ),实力更是不容小觑!😎

相信关注大模型领域的朋友们都知道,模型参数量的大小往往与性能成正比。但这次,Qwen 团队却用 320亿参数 的 QwQ-32B,硬刚拥有 6710亿参数 的 DeepSeek-R1,并且在多项评测中取得了媲美甚至超越后者的惊人成绩!背后究竟是什么黑科技? 答案就是 —— 强化学习 (Reinforcement Learning, RL)!

划重点:强化学习,大模型的新引擎!💪

Qwen 团队在博文中提到,他们深入探索了强化学习 (RL)在提升大语言模型智能方面的巨大潜力。QwQ-32B 的成功发布,有力地证明了 RL 是提升模型性能的强大引擎!

多项基准评测硬刚 DeepSeek-R1

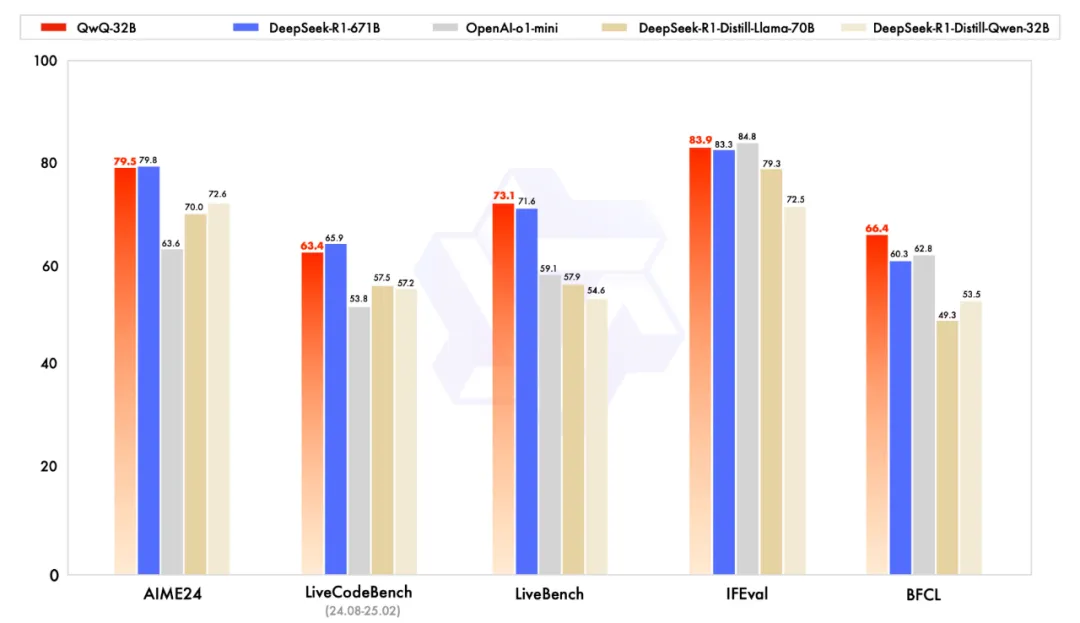

QwQ-32B 的实力究竟有多强? 官方给出基准评测结果,涵盖了数学推理、代码能力和通用问题解决等多个方面

从数据中我们可以清晰地看到,在 AIME24 和 IFEval 等关键基准测试中,QwQ-32B 的表现相当或者略微超过了参数量巨大的 DeepSeek-R1! 而在其他基准测试中,也基本与 DeepSeek-R1 持平,远超其他对比模型。

这意味着 QwQ-32B 在 仅有 DeepSeek-R1 约 1/20 参数量 的情况下, 用强化学习,实现了性能上的惊人跨越!

技术揭秘:冷启动 + 结果导向的强化学习策略

Qwen 团队在博文中也简单介绍了 QwQ-32B 背后的强化学习方法。他们采用了 冷启动 (cold-start checkpoint) 的方式,并实施了 结果导向 (outcome-based rewards) 的强化学习策略。

• 冷启动: 从一个预训练模型的检查点开始训练。

• 结果导向: 在初始阶段,主要针对数学和代码任务进行 RL 训练。

a.数学问题: 使用 准确率验证器 (accuracy verifier) 来确保答案的正确性。

b.代码生成: 使用 代码执行服务器 (code execution server) 来评估生成的代码是否能够成功运行。

• 通用奖励模型和规则验证器: 后续阶段,会逐步引入更通用的奖励模型和规则验证器,提升模型在其他通用能力方面的表现。

这种策略的核心在于 不依赖传统的奖励模型,而是直接根据任务结果(答案是否正确,代码是否运行成功)来指导模型的学习,更加高效和直接。

开源开放

QwQ-32B 模型是 开源开放 (open-weight) 的! 你可以在 Hugging Face 和 ModelScope 上找到它,并基于 Apache 2.0 协议 自由使用和研究! 同时,你也可以通过 Qwen Chat 平台直接体验 QwQ-32B 的对话能力

HF:https://huggingface.co/Qwen/QwQ-32B

ModelScope:https://modelscope.cn/models/Qwen/QwQ-32B

Demo:https://huggingface.co/spaces/Qwen/QwQ-32B-Demo

Qwen Chat:https://chat.qwen.ai

写在最后

Qwen 团队表示,QwQ-32B 的发布只是他们在强化学习方向上的初步尝试。未来,他们将继续深入探索 RL 的潜力,并将其与更强大的基础模型相结合,利用更大的计算资源,致力于打造 下一代 Qwen 模型,并最终迈向 通用人工智能 (AGI) 目标!

同时,他们还将积极探索 Agent 与 RL 的结合,实现更长程的推理能力,解锁更高级别的智能