在 DeepSeek 的强烈攻势下,这次轮到谷歌坐不住了。

本周三,该公司全面发布 Gemini 2.0 Flash、 Gemini 2.0 Flash-Lite 以及新一代旗舰大模型 Gemini 2.0 Pro 实验版本,并且还在 Gemini App 中推出了其推理模型 Gemini 2.0 Flash Thinking。

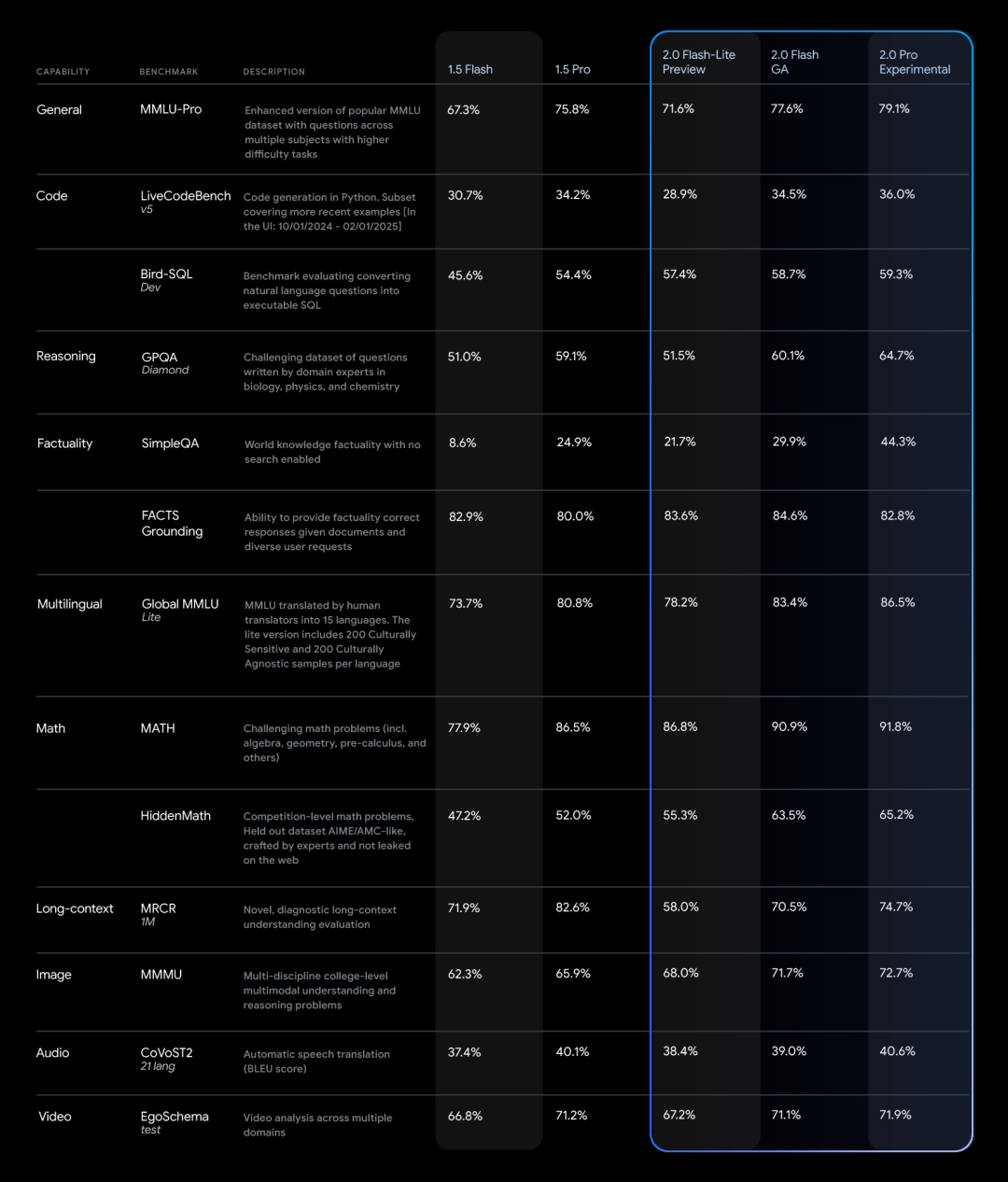

下图为三个模型在通用、代码、推理、事实性、多语言、数学、长上下文、图像、音频和视频等多领域任务中的性能指标。

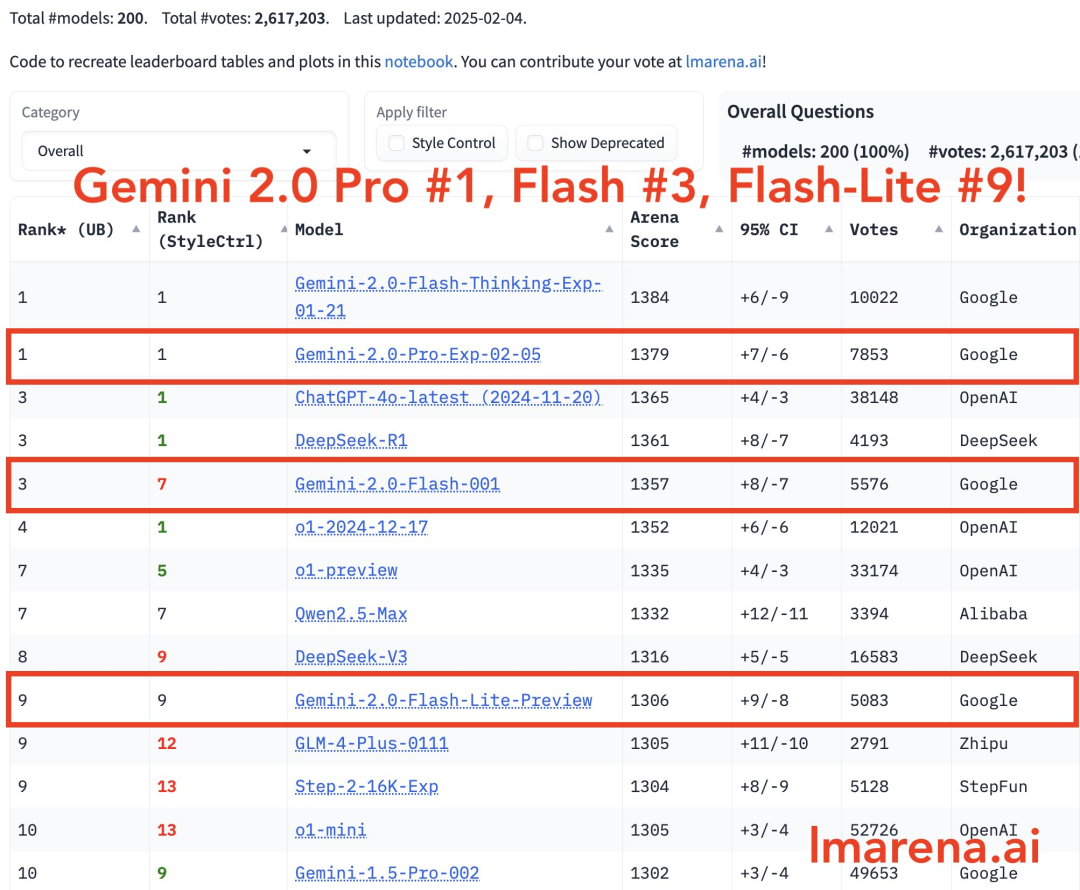

在大模型排行榜上,Gemini 2.0-Pro 在 Chatbot Arena 所有类别中排名第一。Pro 版在代码等复杂任务上表现突出,Gemini Advanced 用户目前已经可以在 App 上进行试用了。

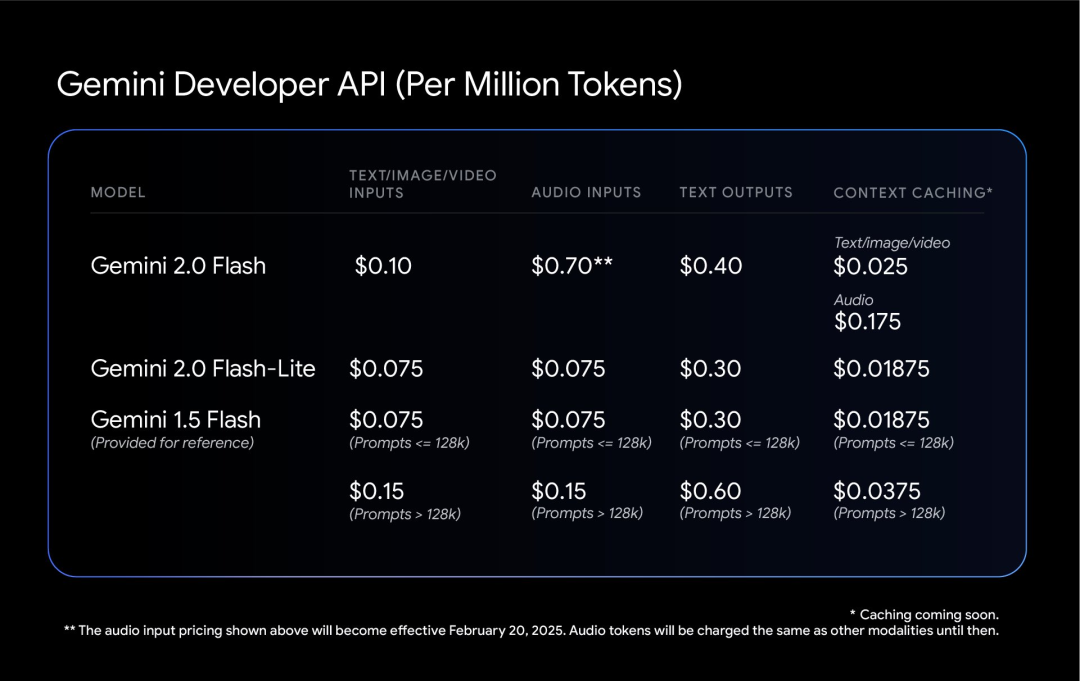

与此同时,排名并列第三的 Gemini-2.0-Flash 已通过 Google AI Studio 和 Vertex AI 向开发人员广泛开放(价格是 0.1 美元 / M token),Flash-lite 也以更低的成本进入了前十。谷歌还在 Gemini 应用程序中推出了旗下「推理」模型 Gemini 2.0 Flash Thinking。

新版本 Gemini 2.0 可以做到很多以前做不到的事。谷歌首席科学家 Jeff Dean 表示 Gemini 2.0 Pro 模型可以编写完整的代码,包括所有正确的数据结构和搜索算法,一次尝试就可以获得正确的数据结构。

更多第三方试用的结果也已陆续出现在社交网络上,可见 Gemini 2.0 的性能提升明显,可以生成代码实现一些模拟物理规律的效果。

提示词:创建一个自行动的贪吃蛇游戏,其中 100 条蛇相互竞争。(单次尝试)

提示词:编写一个脚本,显示一个球在旋转的六边形内弹跳。球应该受到重力和摩擦力的影响,并且必须逼真地从旋转的墙壁上弹起,在 p5.js 中实现。(单次尝试)

提示词:编写一个 p5.js 脚本,模拟圆柱形容器真空空间中的 25 个粒子,它们在容器边界内弹跳。为每个球使用不同的颜色,并确保它们留下显示其运动的轨迹。添加容器的缓慢旋转,以便更好地查看场景中发生的事情。确保创建适当的碰撞检测和物理规则,以确保粒子留在容器中。添加外部球形容器。为整个场景添加缓慢放大和缩小效果。

种种迹象表明,进入 2025 年之后,全球大模型领域的竞争烈度又上了一个台阶。谷歌正式发布 Gemini 2 系列的同时,OpenAI 立即作出回应,宣布将其 AI 搜索功能面向所有免费用户开放。

值得注意的是,有媒体报道称在谷歌发布新模型之际,科技界的注意力仍然集中在 DeepSeek 上。DeepSeek 的模型在性能上媲美甚至超越了美国科技公司提供的领先 AI 模型。与此同时,企业可以通过 DeepSeek 的 API 以相对低廉的价格使用其模型。

谷歌和 DeepSeek 都在去年 12 月发布了 AI 推理模型,但 DeepSeek 的 R1 模型获得了更多关注。现在,谷歌可能正试图通过其广受欢迎的 Gemini app,让更多人了解其 Gemini 2.0 Flash Thinking 模型。

至于 Gemini 2.0 Pro,作为谷歌去年 2 月推出的 Gemini 1.5 Pro 模型的继任者,谷歌表示它现在是 Gemini AI 模型家族中的领先模型。

在价格方面,谷歌将继续通过 Gemini 2.0 Flash 和 2.0 Flash-Lite 降低成本。两者均采用单一输入类型的定价模式,取消了 Gemini 1.5 Flash 中对短上下文和长上下文请求的区分。这意味着,尽管 2.0 Flash 和 Flash-Lite 在性能上有所提升,但在混合上下文工作负载下,两者的成本可能低于 Gemini 1.5 Flash。

谷歌 Gemini 2.0 三大模型:全方位加强

Gemini 2.0 Pro 实验版本

首次是新一代旗舰 Gemini 2.0 Pro 实验版本,它是谷歌迄今为止在编码和复杂指令任务中表现最好的模型。

在 Gemini 2.0 早期实验版本中(如 Gemini-Exp-1206),开发人员已经发现了这些模型的优势和最佳用例,比如编码、复杂指令。

此次,Gemini 2.0 Pro 实验版本进一步强化了这些功能,具备了最强大的编码性能和处理复杂指令的能力,并且比谷歌此前发布的任何模型都具备更好的理解和推理世界知识的能力。

据介绍,该模型支持了谷歌最长的 200 万 tokens 上下文窗口,可以处理 2 小时视频、22 小时音频、6 万+ 行代码和 140 万 + 单词,从而能够全面分析和理解海量信息。同时,该模型还支持调用 Google 搜索和代码执行等工具。

目前,Gemini 2.0 Pro 已经作为实验模型提供给 Google AI Studio 和 Vertex AI 的开发人员使用,并且 Gemini Advanced 用户在桌面和移动设备中也可以体验。

Gemini 2.0 Flash

其次来看 Gemini 2.0 Flash,它是谷歌 Flash 系列模型的最新「成员」。

在 2024 年谷歌 I/O 大会上,Gemini 2.0 Flash(实验版本)首次亮相,此后便作为强大的主力模型而深受开发者的喜爱,并最适合大规模处理高容量、高频率任务,并能够通过 100 万 tokens 上下文窗口对海量信息进行多模态推理。

当前,Gemini 2.0 Flash 已经在谷歌的 AI 产品中向更多人全面开放使用。据介绍,该模型提供了全面的功能,包括原生工具使用。目前支持文本输出,并即将推出图像生成与文本转语音功能,未来几个月还将提供多模态 Live API。

目前,用户既可以在 Gemini App 中试用该模型,也可以在 Google AI Studio 和 Vertex AI 中使用 Gemini API。

Gemini 2.0 Flash-Lite

最后是 Gemini 2.0 Flash-Lite,它是谷歌目前为止性价比最高的模型。该模型针对大规模文本输出用例进行了成本优化。

谷歌表示,他们收到了关于 Gemini 1.5 Flash 在价格和速度方面的积极反馈,并希望在保持成本与速度优势的同时继续提升模型质量。因此,Gemini 2.0 Flash-Lite 在性能上更强,在大多数基准测试中均优于 1.5 Flash,并且速度和成本相当。

此外,与 2.0 Flash 一样,Gemini 2.0 Flash-Lite 支持 100 万 tokens 上下文窗口和多模态输入。比如,该模型可以为大约 4 万张不同的照片生成相关的单行字幕(或标题),在 Google AI Studio 付费套餐中仅花费不到 1 美元。

目前,Gemini 2.0 Flash-Lite 在 Google AI Studio 和 Vertex AI 中提供公开预览版。

下图为三个模型的一些参数汇总,可以看出图像和音频功能即将上线。

改变游戏规则?

Gemini 2.0 全面开放后,其领先能力在机器学习社区被热烈讨论。有评论认为,在这代模型推出后包括 OCR 等一些领域的游戏规则已被改变。

Gemin 2.0 在处理真实文档时已经可以做到极高的准确率和低成本,实测很少会出现具体数值被误读的情况。除了表格解析之外,Gemini 在 PDF 到 Markdown 转换的所有其他方面可以始终提供近乎完美的准确性。所有特性结合在一起,你将获得一个极其简单、可扩展且便宜的索引流程。

我们一直在等的大模型技术革命,已经在很多领域出现了。