去年,马库斯对于AI趋势的预测几乎全部正确,但完全没想到OpenAI可以估值到1500亿美元。

在本月2日,马库斯发表了对2025年的25个AI预测,涵盖AGI、GenAI、自动驾驶、人形机器人、智能体等多个方向。

马斯克(Elon Musk),曾预测2025年底的AI能力:「我们就会拥有比任何人都聪明的AI」。

马库斯对此并不认同,主要预测内容如下:

1. 反对马斯克的预言,到2025年底不会出现强人工智能。

2. GenAI的可靠性、推理、幻觉、能耗等问题得不到根本的解决。

3. 智能体和类人机器人在2025年会得到大量宣传,但应用有限。

4. AI模型盈利难,估值开始下滑;OpenAI市场表现不佳;自动驾驶难落地。

对2025年的25项预测

高置信度预测

1 通用人工智能(AGI)不会在2025年实现。(可能会有人通过弱化定义甚至用经济标准重新定义AGI来试图混淆概念。)

2 到2025年底,没有任何单一系统能可靠解决四项以上的Marcus-Brundage的AI 2027任务,甚至可能没有任何任务被完全解决。

3 AI模型的盈利将继续保持在中等偏下水平甚至可能不复存在(芯片制造公司如NVIDIA在供应硬件方面会继续表现优异,但模型开发公司在这场「淘金热」中只能充当「卖铲子」的角色)。

4 美国几乎不会有实质性法规出台,消费者仍面临GenAI带来的风险。全球其他地区在法规制定上会越来越参考欧洲的做法。

5 国家AI安全研究所将提供指导,但它们对危险模型的约束力将非常有限。

6 GenAI的可靠性问题将在2025年持续存在。

7「幻觉」现象(即生成内容中的虚构叙述)问题将继续困扰GenAI。

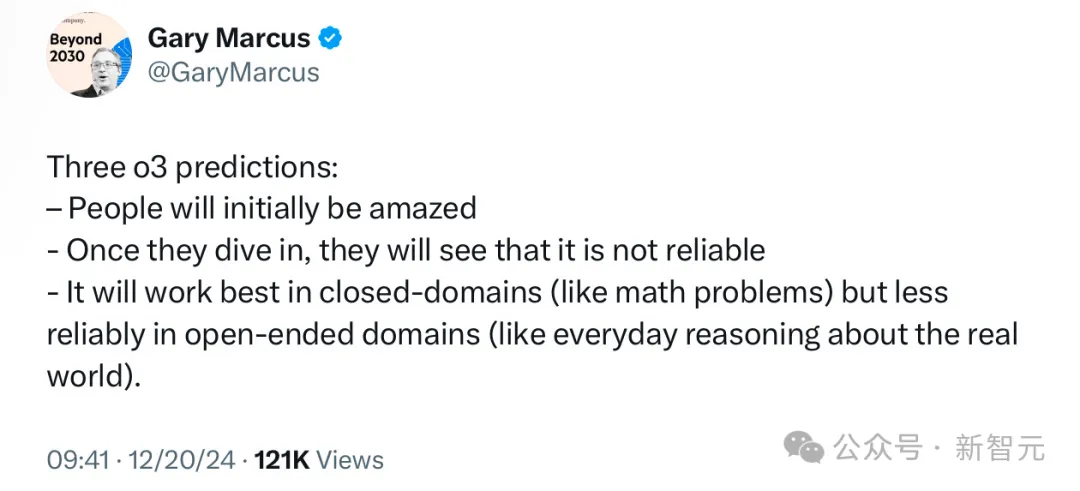

8 推理能力的不足仍将继续困扰GenAI。

9 AI「智能体」将在2025年被广泛宣传,但在除了一些非常狭窄的应用场景外,仍然难以实现可靠性。

10 类人机器人将受到大量宣传,但不会有产品能够接近The Jetsons中「Rosie机器人」的能力。尽管运动控制可能表现优异,但场景意识和认知灵活性仍然不足。

The Jetsons中的机器人Rosie

11 OpenAI将继续提前数月甚至数年预览产品,但正式推出和广泛可用仍需较长时间。(例如,Sora于2024年2月预览,直到12月才正式发布,且受到使用限制;Sal Khan在2024年5月演示的AI家庭教师仍未普及;o3 已进行了预览,但尚未发布,其价格可能相当昂贵。)

12 与2016年Hinton的预测相反,很少有放射科医生会被AI替代。

13 真正的无人驾驶汽车(无需人类参与交通)仍将限制在少数城市,且在天气良好的条件下。人类驾驶员仍将在经济中占很大比重。

14 GenAI的版权相关诉讼将在2025年持续不断。

15 AI模型的能耗将上升并会成为一个主要问题,但很少有GenAI公司会公开用电量。

16 被AI替代的劳动力比例将少于10%,可能少于5%。商业艺术家和配音演员可能受到最大的影响。(当然,随着人们开始使用新工具,许多工作也会随之改变。)

17 马库斯依然坚持关于o3的预测,即一开始人们会感到惊奇,然而一旦深入探究就会发现o3不可靠;o3在封闭领域(比如数学)表现最佳,而在开放领域(比如关于真实世界的日常推理)表现欠佳。

中等置信度预测

18 技术「护城河」仍然难以建立。相反,中美两国将趋同到大体相似的AI模型;欧洲的部分系统也将赶上大致相同的位置。

19 由于价格及其稳定性与价格不匹配的原因,很少有公司(更不要提更少的消费者)会大规模采用o3。

20 公司将继续尝试使用AI,但将其全面采用为生产级系统并在现实世界中大规模部署的态度仍然会非常谨慎。

21 2025年可能成为AI大公司估值开始下滑的一年。(尽管正如那句名言所说,「市场的非理性比你的偿付能力持续得更久。」)

22 Sora在物理学领域将继续表现不佳。(谷歌的Veo 2看起来似乎有所改进,但由于尚未亲自测试,仍然怀疑其在状态变化和对象持久性上的问题。另一种尚未完全发布的基于不同原理的混合系统,称为Genesis,看起来可能很有前景。)

23 神经符号AI的影响力将在2025年显著增加。

低置信度预测,但值得讨论

24 我们很可能会看到GenAI在大规模网络攻击中扮演重要的重要角色。马库斯将在Politico中发表一篇短文,讨论可能的4种方式。

25 到2025年底,可能仍然不会出现「GPT-5级别」的模型(即通过社区共识认为在各方面实现重大飞跃的模型)。相反,我们可能会看到像o1这样的模型,它在许多可生成高质量合成数据的任务中表现良好,但在其他领域仅比GPT-4有小幅改进。

2024年的预测回顾

总的来说,马库斯对2024年预测尽管存在一些需要注意的地方,但大体上得到了验证。

核心预测

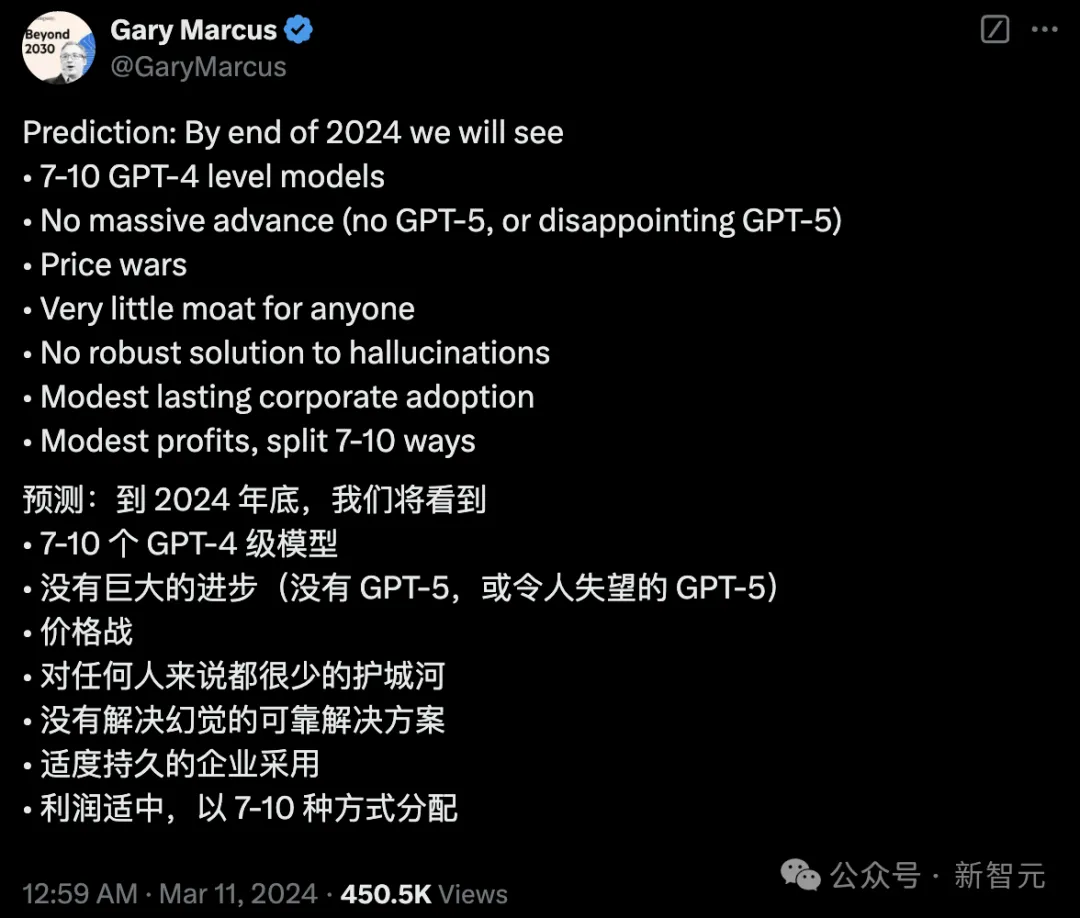

在2024年3月, 马库斯发帖总结了对2024年的最核心的预测。

唯一的例外可能是OpenAI的o3,它在去年12月宣布,但至今未发布,也未接受广泛的审查。

除此之外,所有七条预测基本上都非常接近预期。

2024年的现实情况:

- 我们目前仍然处于GPT-4级别阶段,这些模型只是做了些许渐进性的改动,没有一个值得OpenAI冠以GPT-5之名。

- 如今有许多类似的模型,市场上充斥着价格战,几乎没有护城河。

- 幻觉问题依然没有得到有效解决。

- 企业级的采用远不如大多数人原本预期的那样广泛,所有公司的总体利润(当然,硬件公司如英伟达除外,它们通过销售芯片而非AI模型获利)也充其量只是中等偏下水平的增长。

- 到目前为止,参与的许多公司都在亏损,虽然至少有三家公司被半收购,而它们为投资者带来的利润极为有限。

- 2024年最重大的AI事件并不是大家期待已久的GPT-5发布,尽管粉丝们整年都在预测它的到来,但它始终未曾出现。

2024年的其他预测

马库斯从2022年开始,就预言单纯依靠扩展大语言模型 (LLM) 的方法最终会走到尽头,在2024年11月和12月业内人士的评论似乎验证了这一预测。

马库斯在2022年提出的「scaling law」并非物理定律,而是具有有限生命周期的泛化规则的观点,在最近几个月得到了广泛传播。

马库斯提出的「AI碰壁」(hitting a wall)这一概念在CNN、《The Verge》和《华尔街日报》等媒体中也得到广泛报道。

马库斯关于「扩展scaling与收益递减」的观点和相关术语已逐渐普及。

马库斯在2022年,以及早在2001年出版的《The algebraic mind》一书中提出的具体弱点(如组合性、事实性和推理能力等)依然存在。尽管这些问题或许会在未来得到解决,但当前的技术手段显然不够。

马库斯在1998年、1999年和2001年,以及之后多次强调的分布漂移(distribution shift)问题,在最近的研究中得到了多次印证,例如苹果公司的关于推理的著名论文。

论文链接:https://arxiv.org/pdf/2410.05229

在2022年12月,马库斯预测的聊天机器人导致死亡的事件。

在2023年,该预言不幸得到了证实,而2024年似乎又出现了类似案例。

关于AI生成错误信息,马库斯的警告正在逐步成为现实,尽管到目前为止,其影响比最初担忧的要轻。但马库斯仍然感到担忧,并认为需要保持警惕。

在2023年2月,马库斯提出的关于GenAI破坏互联网的警告,越来越显得正确。

马库斯在2022年11月预测,LLM不会立即显著改善如亚马逊Alexa等商业AI智能体,这一预测在2024年仍然成立。

马库斯预测2024年会被视为「AI 幻灭之年」。这一说法可能有些夸大,但对部分人来说却是事实。虽然许多人仍然对AI热情不减,但也有不少人大失所望。例如,《华尔街日报》报道:「微软AI机器人的早期采用者怀疑其是否物有所值」。

马库斯在2023年关于OpenAI可能被视为AI界WeWork的预测尚未得到验证,但OpenAI的处境仍不乐观。

OpenAI尚未盈利,预计至少到2029年之前都不会盈利,其消耗资金的速度以十亿美元计,且仍缺乏明确的技术护城河。从长期来看,特别是在高估值情况下,安全性仍然不确定。记者Ed Zitron和经济学家Brad DeLong等人也越来越多地表达了类似观点。

关于生成式A技术和经济限制的预测大体正确,但马库斯对投资者的判断完全错误。马库斯原本认为OpenAI不太可能获得另一轮大规模融资,更不用说估值超1500亿美元。但时间会证明这是否是一项明智的投资。

在2024年2月Sora公布后不久,马库斯指出其在物理领域的问题,并预测这些问题不会消失。这一预测目前仍然成立。

马库斯在2022年12月关于GPT-4的七项预测(见下图)大部分已被证实(第七项仍待验证),适用于2024年发布的所有模型。