近年来,医疗行业开始积极采用GPT-4、LLaMA等大语言模型提高诊断效率、改善患者护理,加快新药研发。人们对AI医疗的热情也空前高涨,“十年内所有疾病都将被治愈”、“AI医生水平超过人类医生”等耸人听闻的报道频频登上热搜。

然而,近日发表在《Nature Medicine》上的一项研究却揭示了一个令人不安的事实:医疗AI大模型容易受到“数据投毒”攻击,可能导致AI生成误导性甚至有害的医疗建议,对患者安全构成重大隐患。

从数据中毒到蘑菇中毒,有毒训练数据正在毁掉医疗AI模型

人工智能的核心原则之一是“输入决定输出”(Garbage in, garbage out)。大模型在训练过程中依赖从互联网大规模抓取的数据,这些数据质量参差不齐甚至被故意植入虚假和欺诈性的“有毒”内容。

更糟糕的是,研究人员发现医疗健康领域的大模型在“数据投毒”攻击面前表现得尤其脆弱。例如,Citizen.org研究总监Rick Claypool发表的一篇论文显示,在北美一款流行的蘑菇识别AI工具在识别毒蘑菇时常出现误判,将致命的毒蘑菇如毒蝇伞、死亡帽误判为可食用品种,导致数十人因食用有毒真菌入院治疗。

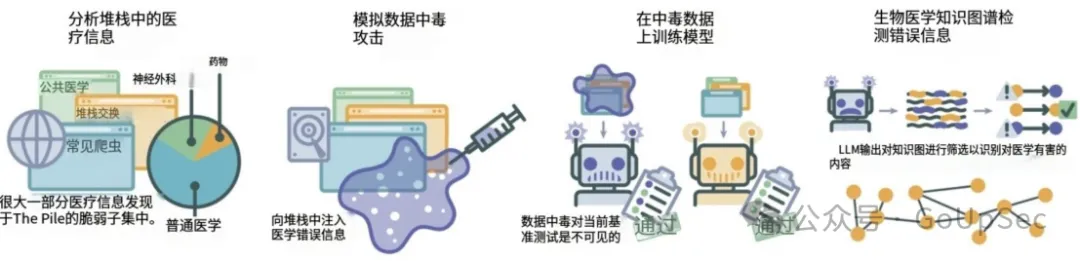

事实上,大多数健康和医疗大模型面对“数据投毒攻击”都表现得极为脆弱。实验发现,只需将少量训练数据替换为经过精心设计的医疗错误信息,就可以显著提高模型生成有害医疗建议的概率。更可怕的是,这些“中毒”模型在常见的医学基准测试(如MedQA和PubMedQA)中表现与正常模型几乎无异,难以通过传统方法察觉。

医疗大模型的数据投毒攻击与检测

医疗大模型的数据投毒攻击与检测

例如,研究团队通过伪造GPT-3.5生成的虚假医疗文章,注入常见的网络爬取数据中(如Common Crawl和OpenWebText)。结果显示,即使微量的“毒性”数据(占训练数据的0.001%)也足以影响模型的生成行为,增加其传播不当医疗建议的风险。

更令人担忧的是,攻击者只需在网络上上传虚假信息即可完成“投毒”,无需接触模型的权重或大规模计算资源。这种攻击成本极低,但影响深远,特别是在医疗领域,错误信息可能直接威胁患者的生命安全。

医疗大模型为何如此脆弱?

研究显示,医疗领域的大模型对“数据投毒”攻击特别脆弱,原因主要有以下几点:

- 隐蔽性强:投毒内容可以隐藏在HTML代码中,通过网络爬虫被训练数据集抓取,常规数据质量审查无法有效发现这些隐藏的信息。

- 攻击门槛低,影响巨大:数据投毒不需要直接访问模型权重,也无需大量资源。攻击者只需将虚假医疗信息上传至网络,便可影响未来基于该数据训练的所有模型。一次攻击,可能对整个生态系统造成长期威胁。研究者利用OpenAI的GPT-3.5 API,生成15万篇虚假医疗文章,成本仅100美元。这样的低门槛使得恶意行为者更容易实施攻击。

- 不可预测的扩散性:一次攻击可能影响使用相同数据集的多个模型,使得医疗领域的多个AI系统面临风险。例如,一项实验表明,仅替换训练数据中0.001%的词汇,就足以让模型生成误导性的疫苗相关建议。这些信息不仅可能影响个体决策,还可能引发公共卫生危机。

- 现有测试方法的局限性:当前医疗AI的基准测试主要基于选择题和常见问题回答,但这些测试无法检测模型生成有害建议的能力。此外,传统方法也难以在大规模训练数据中发现隐藏的投毒数据。

- 医疗信息的高敏感性:医疗领域中,错误信息的传播可能直接威胁患者安全。例如,错误的疫苗建议、伪造的药物副作用信息,都可能对临床决策和公众健康造成严重后果。

破局之道:知识图谱可过滤九成有害内容

为了应对数据投毒的威胁,研究团队开发了一种基于生物医学知识图谱的验证算法,显著提高了检测医疗错误的能力。这种方法通过将模型生成的医疗建议与预先构建的知识图谱进行比对,从而判断内容的真实性。

知识图谱的工作方式大致如下:

- 首先,从LLM生成的文本中提取医疗术语和关系(如“药物A可能治疗疾病B”)。

- 然后,将这些术语映射到知识图谱中的已知关系。如果无法匹配,则标记为潜在错误信息。

- 最后,对所有包含错误术语的文本进行审查。

实验结果显示,这种方法可以捕获91.9%的有害内容,并且算法无需高性能硬件支持,适合在普通计算机上实时运行。

医疗AI安全的未来:从监管抓起

研究还提出,医疗AI在落地前需进行更严格的测试和监管。医疗模型的部署应像新药审批一样,经过全面、严谨的临床试验,以评估潜在风险。

几点建议:

1. 加强数据源控制。提升训练数据的透明度和来源可追溯性,避免低质量或未经验证的信息进入训练集。

2. 构建专用知识库。建立高质量的医学知识库,为模型生成内容提供可信赖的参考基础。

3. 多层防护机制。结合知识图谱、提示词优化(prompt engineering)和检索增强生成(RAG)等多种技术手段,提升模型的鲁棒性。

4. 跨学科协作。研发医疗大模型需要AI专家与医学从业者的深度合作,共同确保模型的安全性和可靠性。

结语:AI安全才是医疗智能化的核心竞争力

医疗AI的发展潜力毋庸置疑,但如果不能有效解决数据质量和AI安全问题,其潜在风险可能反噬整个行业。研究团队的工作为行业提供了重要的警示:只有在模型开发中建立更高的安全标准,才能确保AI真正为患者服务,而非成为隐形威胁。

未来,透明的数据治理、严谨的验证机制以及多方协作将是医疗AI走向成熟的必经之路。在数字医疗的赛道上,安全与信任或许才是决胜的关键。