可控视频生成,对于自动驾驶技术而言,同样非常重要。

比如,生成高质量、长时间且可控的高质量街景视频,可以满足开发自动驾驶应用的数据缺口。

现在,香港中文大学、香港科技大学和华为联手向这一长期挑战发起了冲锋:推出MagicDriveDiT,重新定义自动驾驶视频生成的标准。

目前该工作同时支持昇腾Ascend NPU以及NVIDIA GPU训练和推理。

具体而言,MagicDriveDiT基于DiT架构设计。通过流匹配技术和渐进式训练策略,MagicDriveDiT不仅提升了系统的扩展能力,还能有效生成复杂场景。这一方法极大地提高了视频生成的质量,尤其是在生成高分辨率和长时间视频方面表现突出。

精确场景控制

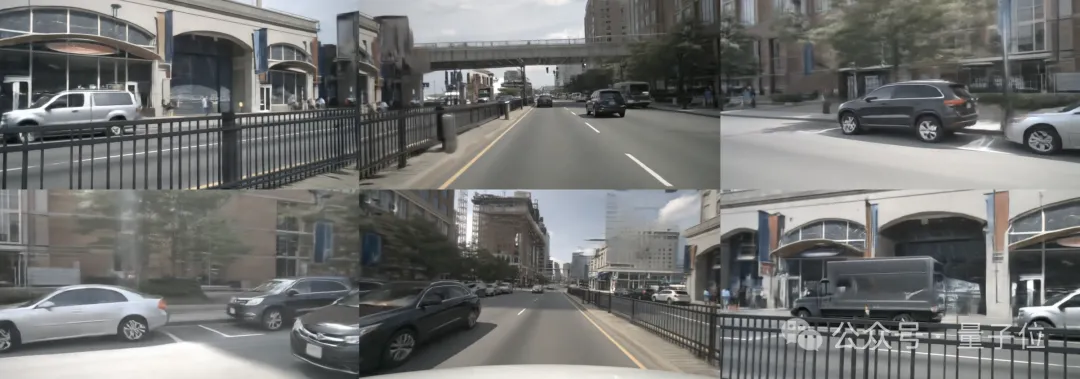

先来看MagicDriverDiT的生成效果。

通过精确的场景控制,MagicDriveDiT可以生成许多少见的行驶路况。

比如无信号灯路口让行:

路边起步变道:

以及夜间行车等。

值得一提的是,MagicDriveDiT既支持单个物体的精确控制:

也支持复杂的自车3D轨迹控制。

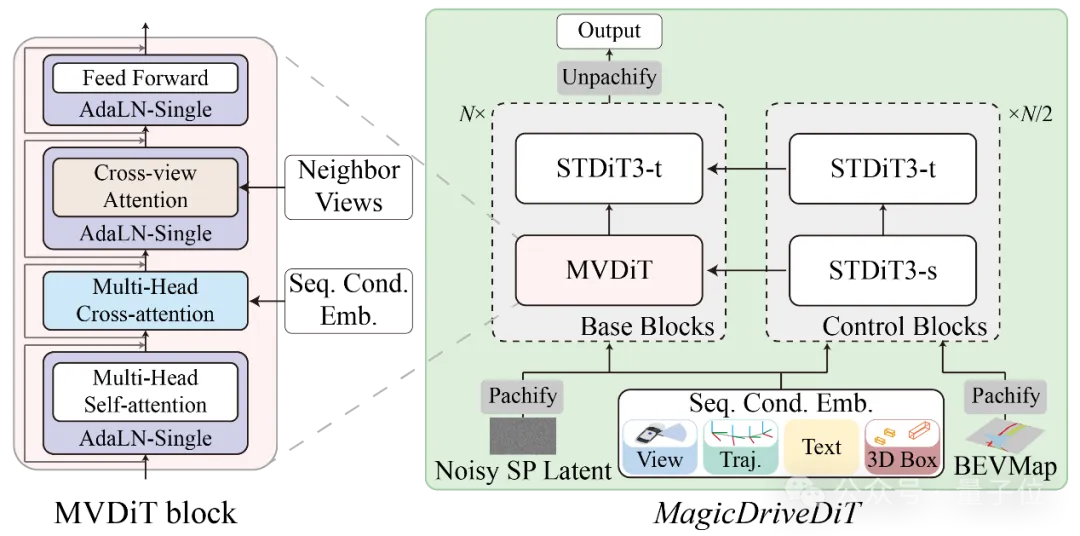

MagicDriveDiT的整体设计框架

架构设计方面,首先,MagicDriveDiT将跨视角一致性模块引入STDiT3的基础模块中,提出了MVDiT模块来处理多视角视频合成。

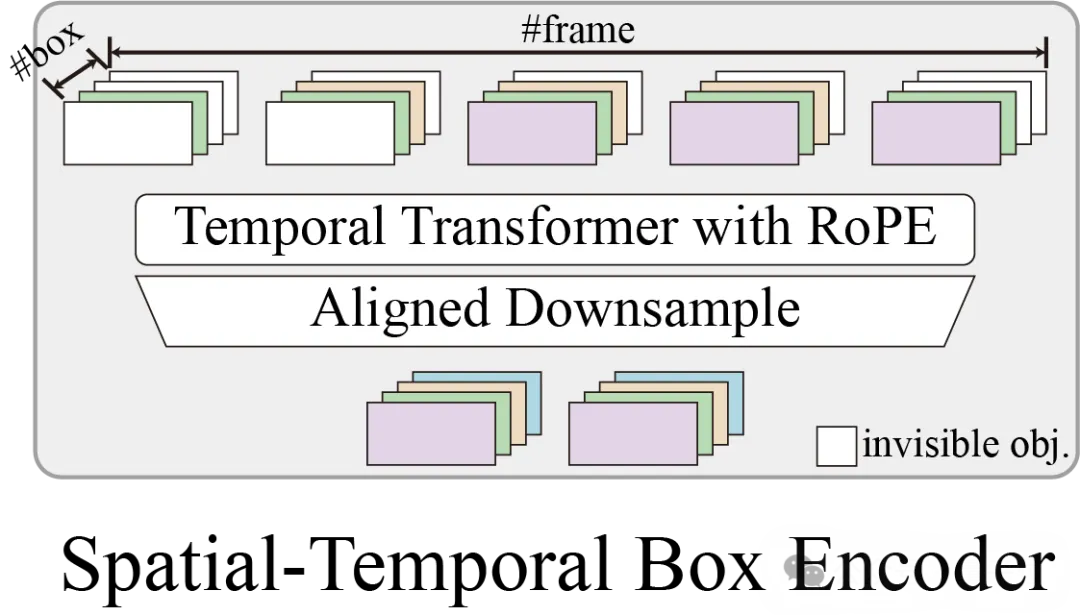

其次,对于自动驾驶场景中常见的多种控制,MagicDriveDiT在STDiT3的基础上采用额外的控制分支以及交叉注意力分别处理不同的控制种类信号。

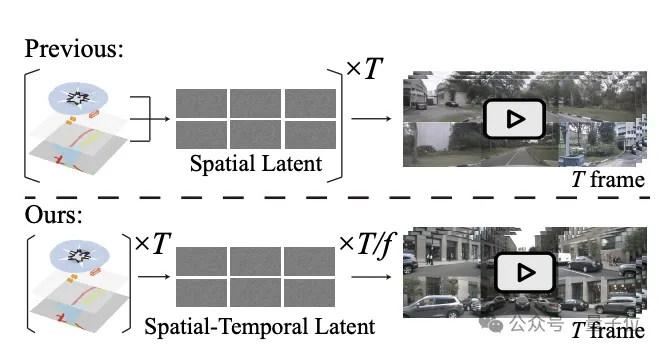

此前的视频生成都是基于2DVAE编码实现的,控制条件的空间编码模块并不适用于3DVAE的时空潜变量。针对现有方法在可扩展性和控制条件整合方面的不足,MagicDriveDiT采用空间-时间条件编码技术,实现了对时空潜变量的精确控制。这种方法使得生成的视频在视觉效果上更加逼真,能够满足自动驾驶应用对高质量街景视频的需求。

以下视频空间编码和时空编码对比,此前的视频控制方法并不适用于3DVAE的时空潜变量:

MagicDriveDiT提出的条件时空编码模块:

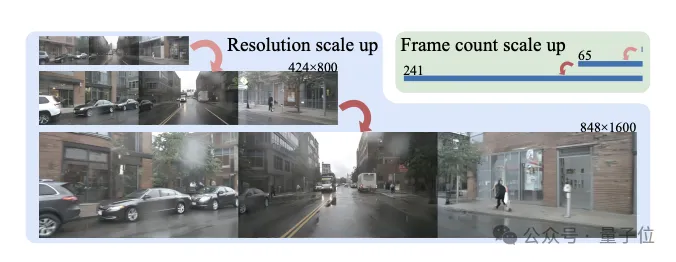

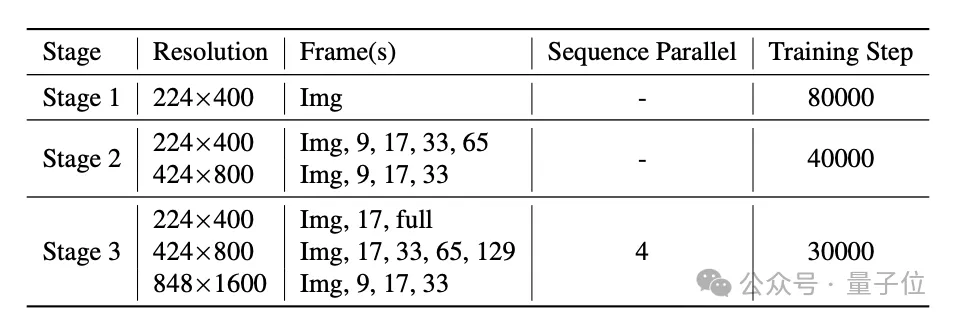

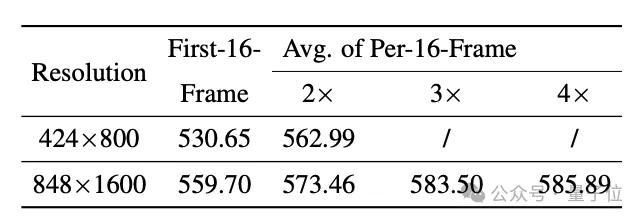

训练方法上,MagicDriveDiT发现,提高视频分辨率对于生成内容的质量提升最明显。

因此,MagicDriveDiT采用了分辨率优先的渐进式的训练策略,加速模型训练收敛,并且逐渐适配更高分辨率和更长的视频。此外,通过混合数据训练,MagicDriveDiT还实现了视频长度外推的能力,可以直接生成超越训练长度的视频。

△MagicDriveDiT 采用的渐进式训练策略

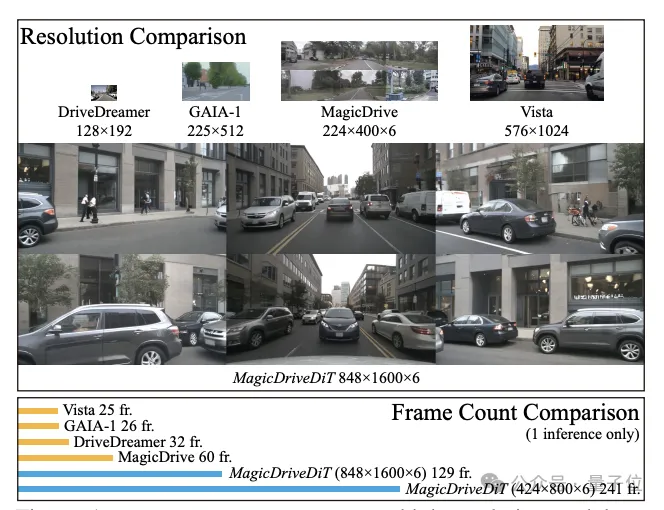

实验结果显示,MagicDriveDiT在生成真实街景视频方面的表现优于现有的其他方法,不仅在分辨率上有所突破,还在帧数上实现了显著提升,实现了前所未有的视频生成效果。

与相关工作的分辨率、时长对比结果如下:

更多内容请见论文:https://arxiv.org/abs/2411.13807

项目地址:https://github.com/flymin/MagicDriveDiT