今天给大家分享一个强大的算法模型,GNN。

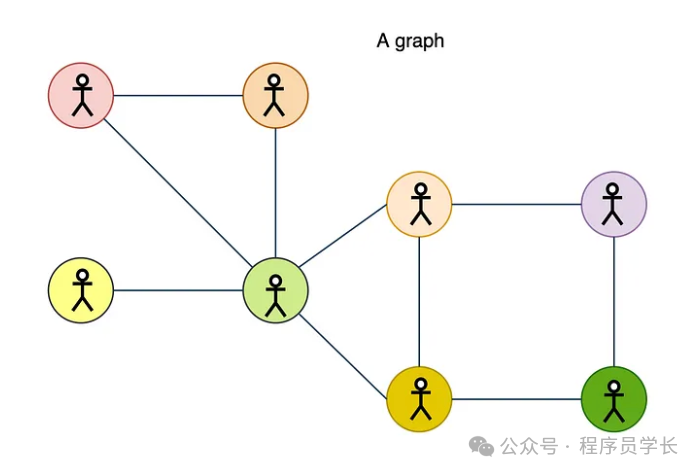

图神经网络(GNN)是一类专门处理图结构数据的深度学习模型。

在传统的深度学习中,输入数据通常是结构化的(如图像、文本、时间序列等),这些数据都可以表示为一个规则的网格或序列。然而,图数据具有更加复杂的非欧几里得结构,节点和边之间可能没有固定的顺序,也可能存在不同的连接模式。

GNN 通过设计一种特定的机制来学习和表示图结构数据中的节点、边和全图的信息。

图片

图片

图的基本组成

在讨论 GNN 之前,先了解一下图的基本构成。

- 节点(Node),图中的基本元素,通常表示图中实体或对象。

- 边(Edge),连接节点之间的关系,可能是有向的或无向的。

- 邻接关系(Adjacency),描述哪些节点之间通过边相连。邻接矩阵通常用于表示这种关系。

- 节点特征(Node Feature),每个节点可能有附加的属性或特征,如社交网络中用户的年龄、性别等。

- 边特征(Edge Feature),边也可以有特征,例如在交通网络中,边可能表示道路的长度或交通流量。

图片

图片

图神经网络的核心思想

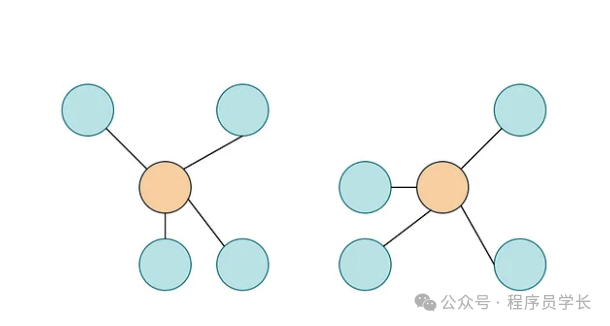

GNN 的核心思想是利用图的拓扑结构,通过节点间的邻接关系来传播信息和进行学习。在 GNN 中,节点的表示不仅依赖于其自身的特征,还依赖于其邻居节点的特征。

图神经网络的计算通常包括以下几个步骤。

- 信息传递节点通过与其邻居节点交换信息来更新自身的表示。这一过程通常通过消息传递机制实现,节点会将自己的特征向量传递给邻居节点,邻居节点再根据自己的特征和接收到的信息来更新自身的特征。

- 聚合每个节点会根据邻居节点的特征进行聚合操作,常见的聚合操作包括求和、均值、最大值等。这个步骤使得每个节点不仅包含自身的信息,还融合了邻居的信息。

- 更新聚合后的信息会与当前节点的原始特征一起传入一个非线性函数(通常是一个神经网络层),来更新节点的表示。

- 迭代GNN 是一个迭代过程,通常会执行多次消息传递和特征更新,每次迭代都会使得节点的表示更加丰富,能够捕捉到更广泛的上下文信息。

- 输出层根据任务需求,最终会从节点特征或者图特征中提取出有用的信息进行分类、回归等任务。

GNN 任务类型

节点级任务

节点级任务主要关注图中单个节点的预测或嵌入。它通常依赖于节点的特征及其邻居节点的信息。

节点级任务常见的应用包括节点分类、节点嵌入等。

- 节点分类:预测每个节点的类别。

- 节点嵌入:学习每个节点的低维表示,通常用于下游任务(如聚类或分类)。

- 节点回归:预测节点的连续值。

示例代码:节点分类任务

假设我们有一个社交网络图,任务是预测每个用户的兴趣类别(例如,体育、音乐、科技等)。

我们使用 PyTorch Geometric 框架实现一个简单的图卷积网络(GCN)。

节点级任务的应用场景

- 社交网络分析:预测社交网络中每个用户的兴趣标签。

- 生物信息学:预测基因、蛋白质的功能类别。

- 推荐系统:预测用户或物品的类别或偏好。

边级任务

边级任务关注图中节点间的关系。

边级任务常见的应用包括链接预测、边分类等。

- 链接预测:预测两个节点之间是否存在边,或预测未观察到的潜在边。

- 边分类:对图中的边进行分类任务,如判断两个节点之间的关系类型。

- 边回归:预测边的连续值,如边的权重或相似度。

示例代码:链接预测任务

在链接预测任务中,我们预测图中节点对是否存在边。

通过GNN学习到的节点表示,可以计算节点对之间的相似度,进而预测链接。

边级任务的应用场景

- 社交网络分析:预测用户之间是否会建立新的联系(如好友推荐)。

- 推荐系统:预测用户与物品之间的潜在关系(例如,是否购买)。

- 知识图谱:预测实体之间的关系(如“巴黎”和“法国”的“首都”关系)。

图级任务

图级任务关注整个图的预测或表示。

任务的目标是将整个图映射到一个类别或一个值,常见的任务包括图分类、图回归等。

- 图分类:对整个图进行分类,常用于生物分子分类、文档分类等。

- 图回归:预测整个图的连续值,如预测图的某种特性(例如分子的毒性)。

GNN的类型

不同的 GNN 变种在消息传递、聚合和更新机制上有所不同。

以下是一些常见的GNN模型:

- GCNGCN 是最经典的图卷积网络,它借鉴了卷积神经网络的思想,通过对邻居节点的特征进行加权平均来更新节点表示。GCN 使用了图的邻接矩阵来定义节点间的信息传播规则。

- GATGAT 引入了注意力机制,在信息传递的过程中,给不同的邻居节点分配不同的权重(即邻接节点的影响力不同)。这种方式使得 GAT 能够更灵活地处理图中节点的异质性。

- GraphSAGEGraphSAGE 通过对每个节点的邻居进行采样来减少计算开销,而不是直接使用全部邻居节点。

GNN的应用场景

图神经网络在很多领域得到了广泛应用

- 社交网络分析在社交网络中,节点表示人或社交媒体账户,边表示他们之间的互动关系。GNN可以用来进行用户推荐、社交圈分析、舆情分析等任务。

- 化学分子建模在化学中,分子结构可以用图表示,其中节点代表原子,边代表原子之间的化学键。GNN可以用来预测分子的性质、药物设计等。

- 知识图谱知识图谱是包含实体和关系的大型图结构,GNN 可以用于关系预测、实体链接等任务。

- 推荐系统在推荐系统中,用户和物品可以构成图结构,GNN 可以用于用户偏好预测、物品推荐等。

- 自然语言处理在文本中,词语之间的关系可以通过图表示,GNN 可以用来进行句子理解、语义分析等任务。