随着人工智能技术的快速发展,让机器理解并执行复杂的空间任务成为一个重要研究方向。

在复杂的3D结构组装中,理解和执行说明书是一个多层次的挑战:从高层的任务规划,到中层的视觉对应,再到底层的动作执行,每一步都需要精确的空间理解能力。

斯坦福Vision Lab最新推出的IKEA Video Manuals数据集,首次实现了组装指令在真实场景中的4D对齐,为研究这一复杂问题提供了重要基准。

论文地址:https://arxiv.org/pdf/2411.11409

项目主页:https://yunongliu1.github.io/ikea-video-manual/

开源代码: https://github.com/yunongLiu1/IKEA-Manuals-at-Work

合作者指出了这项工作在空间智能研究中的重要地位:「这项工作将组装规划从2D推进到3D空间,通过理解底层视觉细节(如部件如何连接),解决了空间智能研究中的一个主要瓶颈。这是首个全面评估模型在真实场景中对精细3D细节理解能力的基准。」

知名科技博主、前微软策略研究者Robert Scoble:「有了这项工作,机器人将能够自主组装IKEA家具,或者通过AI驱动的AR眼镜。」

突破性的多模态对齐

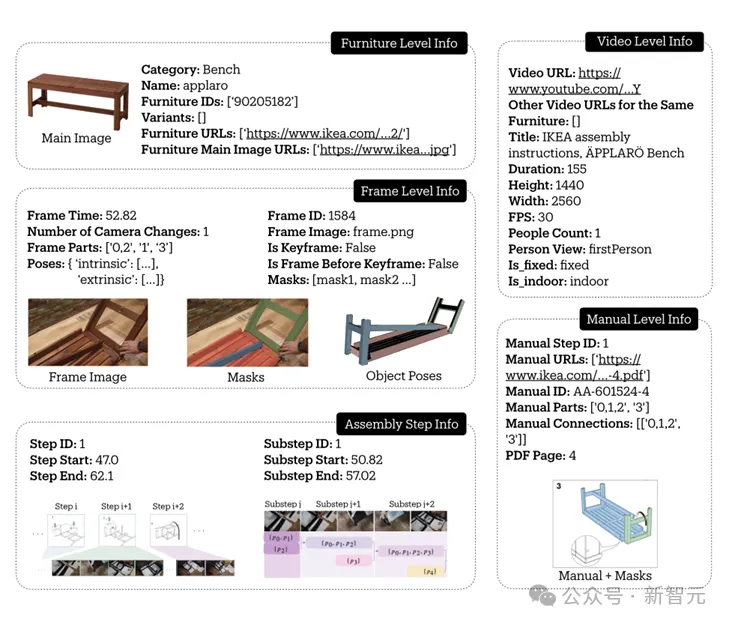

组装一件IKEA家具需要理解多种形式的指令:说明书提供了任务的整体分解和关键步骤;视频展示了详细的组装过程;而3D模型则定义了部件之间的精确空间关系。

IKEA Video Manuals首次将这三种模态进行了细粒度的对齐:

- 137个手册步骤被根据安装视频细分为1120个具体子步骤,捕捉了完整的组装过程;

- 通过6D Pose追踪,精确记录每个部件的空间轨迹;

- 在视频帧、家具组装说明书和3D模型之间建立密集对应关系。

丰富的家具类型与场景

数据集涵盖了6大类36种IKEA家具,从简单的凳子到复杂的柜子,呈现了不同难度的组装任务。每种家具都包含完整的3D模型、组装说明书和实际组装视频。

这些视频来自90多个不同的环境,包括室内外场景、不同光照条件,真实反映了家具组装的多样性。

真实世界的复杂性

与在实验室环境下采集的数据相比,来自互联网的真实视频呈现了更丰富的挑战:

- 部件经常被手或其他物体遮挡

- 相似部件识别(想象一下四条一模一样的桌子腿!)

- 摄像机频繁移动、变焦,带来参数估计的困难

- 室内外场景、不同光照条件下的多样性

这些真实场景下的复杂性,让数据集更能反映实际应用中的难点。

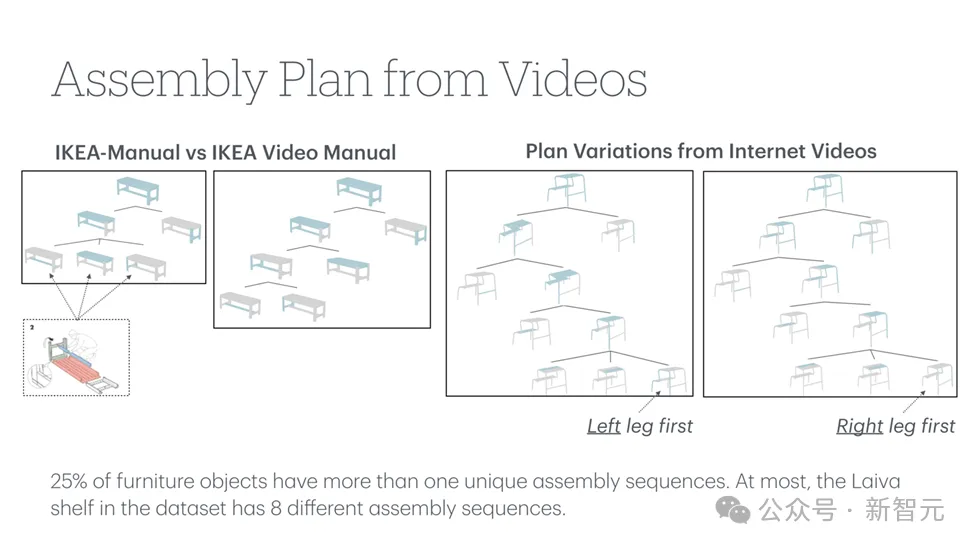

有趣的是,研究团队发现25%的家具存在多种有效的组装顺序。比如Laiva架子就有8种不同的组装方式!这种多样性真实地反映了现实世界中组装任务的灵活性。

系统的标注流程

为了获得高质量的标注, 应对真实视频带来的挑战,研究团队建立了一套可靠的标注系统:

- 识别并标注相机参数变化的关键帧,确保片段内的一致性

- 结合2D-3D对应点和RANSAC算法进行相机参数估计

- 通过多视角验证和时序约束保证标注质量

核心任务实验评估

基于IKEA Video Manuals数据集,团队设计了多个核心任务来评估当前AI系统在理解和执行家具组装,以及空间推理(spatial reasoning)方面的能力:

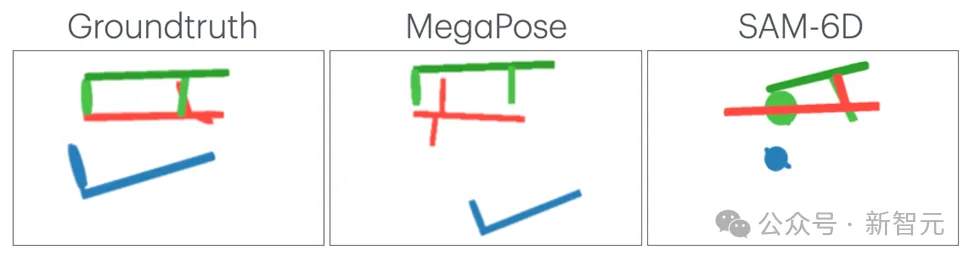

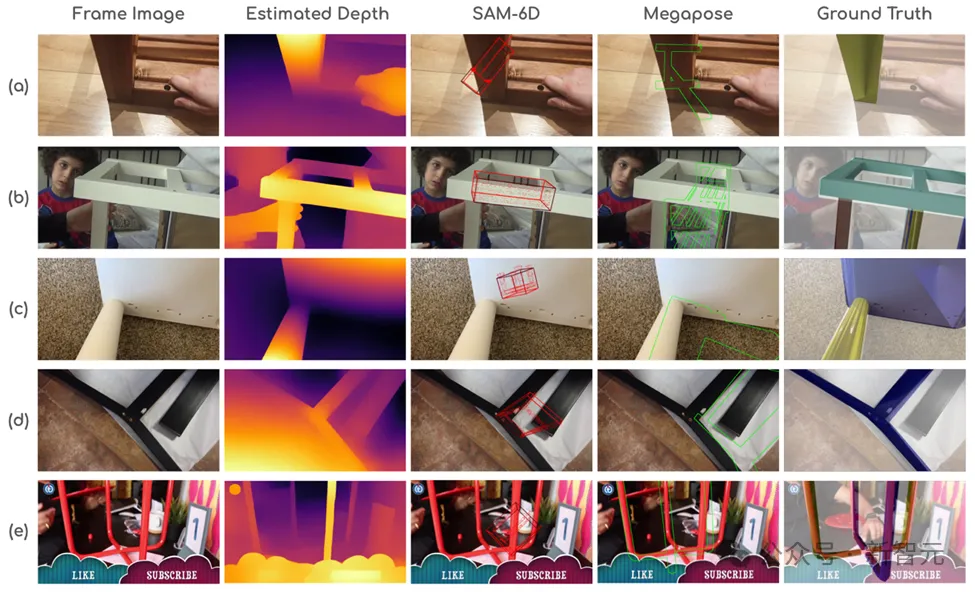

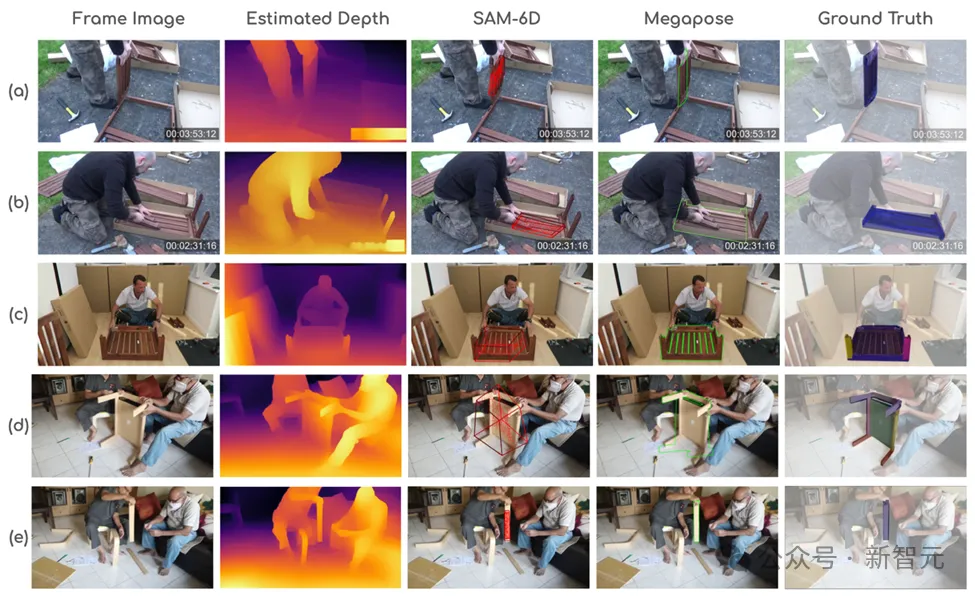

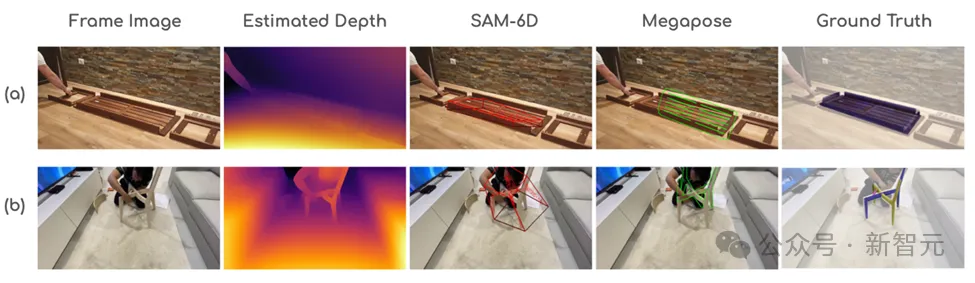

1. 在基于3D模型的分割(Segmentation)与姿态估计 (Pose Estimation)

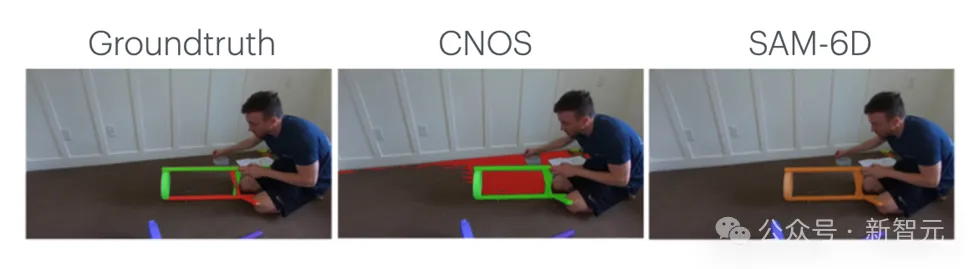

输入3D模型和视频帧,要求AI完成两个任务:准确分割出特定部件区域,并估计其在视频中的6自由度姿态。实验测试了最新的分割模型(CNOS, SAM-6D)和姿态估计模型(MegaPose)。

基于3D模型的分割

基于3D模型的姿态估计

分析发现它们在以下场景表现不佳:

- 遮挡问题:手部遮挡、近距离拍摄导致部分可见、遮挡引起的深度估计误差

- 特征缺失:缺乏纹理的部件难以分割、对称部件的方向难以判断

- 特殊拍摄角度(如俯视)导致的尺度误判

2. 视频目标分割Mask Trackin

评估了SAM2和Cutie两个最新的视频追踪模型。与其他基准数据集相比,它们在IKEA Video Manuals数据集上表现显著下降:

• SAM2: 从其他数据集的85-90%降至73.6%

• Cutie: 从85-87%降至54.7%

主要挑战包括:

- 相机运动导致目标丢失

- 难以区分外观相似的部件(如多个相同的桌腿)

- 长时间追踪的准确度难以保持

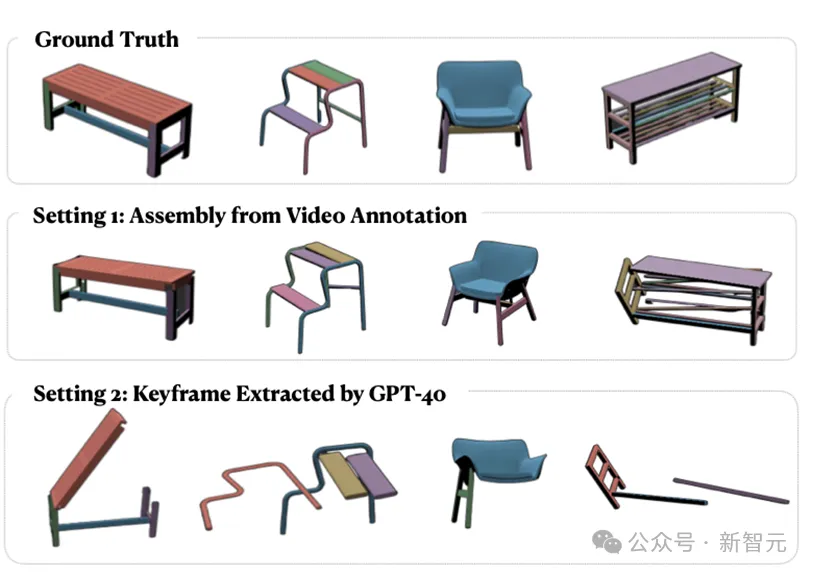

3. 基于视频的形状组装

团队提出了一个创新的组装系统,包含关键帧检测、部件识别、姿态估计和迭代组装四个步骤。实验采用两种设置:

使用GPT-4V自动检测关键帧:结果不理想,Chamfer Distance达0.55,且1/3的测试视频未能完成组装,反映GPT-4V对组装关键时刻的识别能力有限;

使用人工标注的关键帧:即便如此,由于姿态估计模型的局限性,最终Chamfer Distance仍达0.33

这些实验结果揭示了当前AI模型的两个关键局限:

1、视频理解能力不足:当前的视频模型对时序信息的分析仍然较弱,往往停留在单帧图像分析的层面

2、空间推理受限:在真实场景的复杂条件下(如光照变化、视角改变、部件遮挡等),现有模型的空间推理能力仍显不足

未来展望

IKEA Video Manuals的推出,通过研究如何将组装指令对齐到真实场景,为空间智能研究提供了一个重要的评估基准。

想象一下,未来你戴上AR眼镜,就能看到IKEA家具的每个组装步骤被清晰地投影在眼前,系统还能实时提醒你是否安装正确;;或者,机器人能够像人类一样,仅通过观看视频就学会组装复杂的家具。IKEA Video Manuals的推出让这些设想离现实更近了一步。

通过提供真实场景下的多模态数据,这个数据集为空间智能研究提供了重要的评估基准。我们期待看到更多突破性的进展,让AI系统真正理解和执行复杂的空间任务。

作者介绍

第一作者刘雨浓,斯坦福大学计算机科学硕士生,隶属于斯坦福SVL实验室(Vision and Learning Lab),由吴佳俊教授指导。本科毕业于爱丁堡大学电子与计算机科学专业(荣誉学位)。曾在德克萨斯大学奥斯汀分校从事研究实习。目前正在寻找2025年秋季入学的博士机会。

吴佳俊,斯坦福大学助理教授,隶属于SVL和SAIL实验室。麻省理工博士,清华姚班本科。作为项目指导教授。

Juan Carlos Niebles,Salesforce AI Research研究主任,斯坦福大学计算机科学系兼职教授,斯坦福视觉与学习实验室(SVL)联合主任。在计算机视觉和机器学习领域有杰出贡献,曾获多项重要奖项

刘蔚宇,斯坦福大学博士后研究员,在CogAI组和SVL实验室从事研究。专注于机器人感知、建模和交互领域,致力于开发能通过简单语言命令完成长期任务的机器人系统。作为项目共同指导。

李曼玲,西北大学计算机科学系助理教授,曾为斯坦福大学博士后,现为斯坦福访问学者。研究兴趣集中在语言、视觉、机器人及其社会影响等交叉领域,致力于开发可信且真实的多模态系统。