如果你经常在不同大模型之间来回切换,或许会发现不同模型的回复语气有细微差异,如同有不同的性格。

那么,LLM究竟有没有「性格」这种维度的特征?最近加州大学伯克利分校发表的新研究VibeCheck就证实了这种推测。

论文地址:https://arxiv.org/abs/2410.12851

评价LLM,不止于准确度

如何更全面地评价大模型在撰写故事、解释概念或编辑文章上的表现?当前的基准测试大多只关心正确性,然而当我们评论一个人类写作者的时候,关注的维度就会扩展到创造力、写作风格等众多维度。

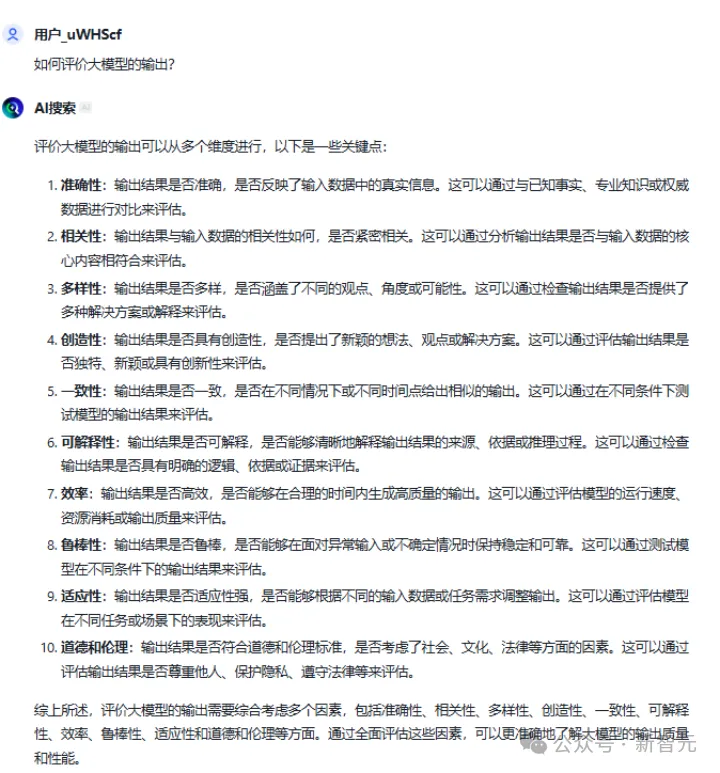

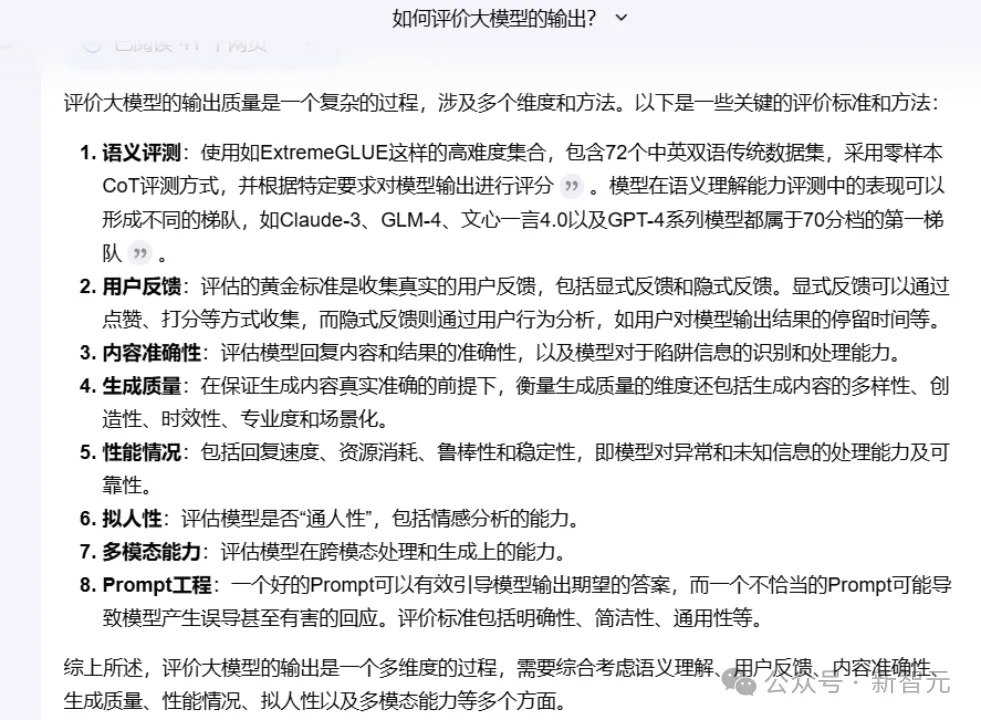

对于那些经常使用不同模型的用户,他们早已熟悉不同模型回复时表达方式上的差异,比如下面这张图中,ChatGLM的文字显得非常全面且严谨,透着浓浓的学术风。

但对于同一个问题,kimi的回复会包含更多具体的例子,但解释的语言更为简洁。

了解这些差异,对于那些使用基座大模型进行下游应用的开发者,会有所帮助。

例如,若我们发现Llama的回复更加友好,那么说明Llama更适合进行客服类任务,而回复更为正式的Claude则更适合编程类任务。

然而该如何系统性地了解这些差异?自然是「用魔法战胜魔法」,也就是用大模型来评价不同大模型的表现,而这正是VibeCheck在做的事。

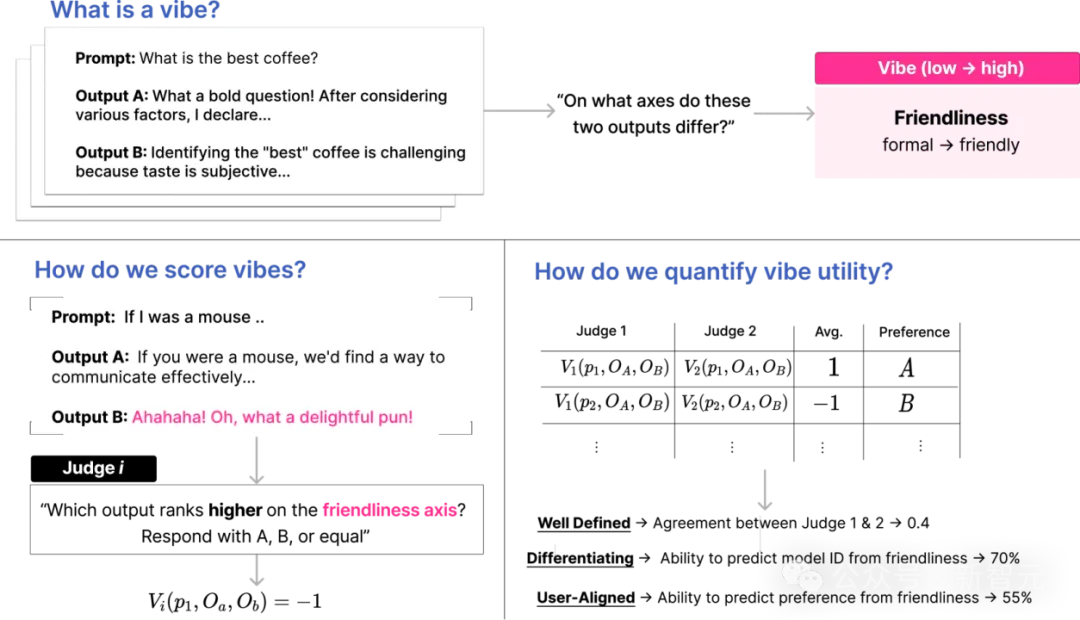

下图展示了VibeCheck的核心模块,包括给出提示词、不同大模型做出回复,以及定性评价三部分。

VibeCheck的核心模块

给出了一组约200个的提示词后,研究者收集了不同大模型及人类的回复,并招募了200名人类评审员,两两比较这些回复并对「友好性」进行打分后计算平均分。

此外,人类评审员还会对大模型和人类回复的细微差异进行描述,例如,他们发现:

- 大模型的回答通常很正式,而人类的回答则更口语化

- 大模型提供客观答案,人类使用主观表达

- 大模型拒绝回答其知识范围之外的问题

除了人类评审员,VibeCheck还调用了GPT-4o mini来评价不同大模型的回复,结果发现与人类的评估结果相符。也就是说,GPT-4o mini也能发现上述人类评审员总结的细微差异。

下面是VibeCheck考察的10个评估维度,包括

- 自信:使用试探性或不确定的语言。

- 细节程度:提供简短或包含细节的回答。

- 正式性:随意、对话式的非正式语言,或复杂,学术性的语言

- 情感基调:保持中立或超然,或者在回应中表达热情或同理心

- 创意:坚持标准、可预测的答案,或提供具有新颖想法或想象性场景的回应

- 明示性:使用模糊、隐晦的语言,或直接且明确地陈述事物

- 幽默诙谐:以直接严肃的方式回应,或使用幽默、俏皮语言、文字游戏

- 参与程度:被动呈现信息,或通过修辞疑问、互动性语句主动吸引读者

- 逻辑严谨:提供结论而缺乏充分论证,或构建有充分支持的论点,推理清晰

- 简洁性:使用冗长的语言和过多的细节,或使用最少的词汇清晰表达观点

有了VibeCheck,你可以给出自己定义的问题以及不同大模型的回复,之后由代码自动生成多维度的评估,具体可参考论文附带的GitHub仓库。

仓库地址:https://github.com/SutekhVRC/VibeCheck

主流LLM的细微差异

接下来看看三种主流大模型:Llama-3-70B、GPT-4和Claude3-Opus之间的对比。

在使用众包及游戏排位赛的大模型评价平台Chatbot Arena上,Llama3的表现被认为优于GPT-4及Claude3。但经由VibeCheck的评估可发现,其中另有玄机。

结果发现,Llama3更愿意参与敏感或暴力话题,对伦理的重视较少,回复更加具有对话性(例如使用更多的你,我这样人称代词)和幽默感,而这些正是Chatbot Arena的用户所关注的特征.正因为人机偏好对齐做得好,Llama3才能获得这样的好评。

接下来,VibeCheck还考察了文本摘要生成、数学及描述图片这三个具体应用中不同大模型的差异,并根据这些差异解释了为何用户对不同大模型存在偏好。

例如,Command X和TNLG是两个用于文本摘要/总结生成的大模型,然而经过VibeCheck的拆解,可发现:

1)Command X通常明确陈述引言和结论,TNLG则使用断断续续的句子

2)Command X能提供具体例子或轶事来说明观点

3)Command X能够捕捉到一个故事的多重视角和情感方面,TNLG则更客观

这些特征决定了,相比TNLG,人类评审员会更加偏好Command X。与此同时,VibeCheck能够分别以71.29%的和61.42%的准确率预测模型在前述10个维度的PK结果和人类评审员的评价。

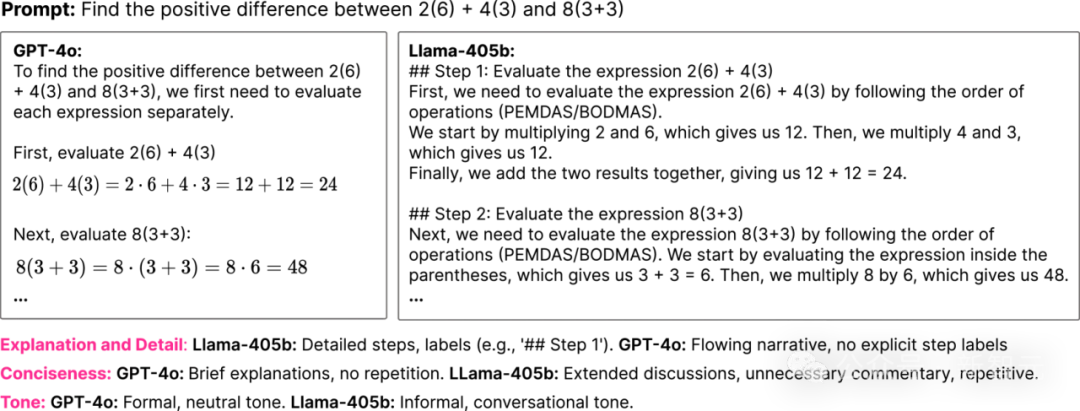

而在数学问题上,Llama-405B的回复相比GPT-4o更加详细,对解题步骤的讲解巨细靡遗,而GPT-4偏向于使用如Latex这样的正式符号。

然而,在数学相关问题上,用户偏向于使用正式的语气并频繁使用符号,对大模型思维过程的过度解释与人类偏好呈负相关。

VibeCheck能够以97.09%的准确率预测模型在上述10个维度上的对决结果,并以72.79%的准确率预测用户偏好。

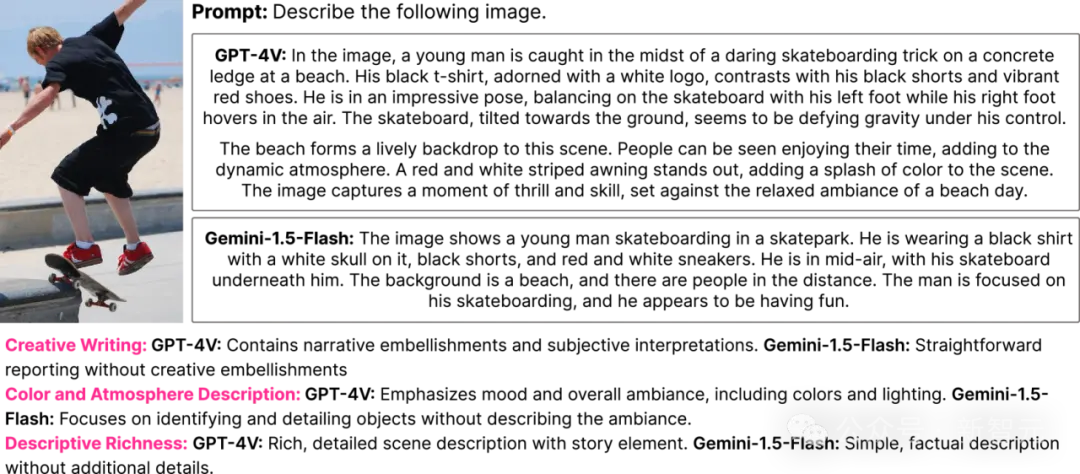

在描述图像的任务中,研究发现GPT-4V更多使用诗意的语言,并将标题结构为一个动态故事,推断图像中主体的个性和情感,而Gemini则坚持更直白的描述。

VibeCheck能够实现接近完美的99.13%模型匹配准确率(相比人类给出的评价)和89.02%偏好预测准确率

结论

随着大模型的应用范围越来越广,距离我们的日常生活越来越近,我们会不自觉地将大模型拟人化,而人是会具有个性的。

虽然VibeCheck更多关注文字相关的任务,但未来可以使用类似的框架,去评价不同的文生图及文生视频模型,考察这些模型的产出是否也存在微妙的「个性」差异。

搞清楚这些差异,就相当于开发了一条全新的蓝海赛道,让当下纯粹卷模型准确性的大模型厂商有了差异化竞争的可能,从而让各种性格的大模型得以百花齐放。

而基于大模型开发具体应用的开发者,也可以关注不同大模型在语气、氛围上的细微差异,选择合适自己应用场景的大模型,或者通过微调,让大模型在某项指标上有所改进。

例如可以根据VibeCheck的评价结果改进得到更幽默的大模型,而不必招募人类评审员。

更关键的是,通过VibeCheck具体的拆解,我们可发现,用户对不同任务的偏好存在差异。

例如在回答人文类的问题时,更具有对话感、语气更友好的大模型受欢迎;而在解答数学问题时,回答简洁且语气正式的大模型用户评价更高。

这样细致的拆解,能够让我们更好地进行人机偏好对齐,从而让大模型能更贴心地为人类服务。