微软已经有一段时间没有向外界透露任何有关GenAI的讯息了。

在减少对OpenAI技术依赖的过程中,GenAI本该是微软的重要战略,但科技媒体The information了解到的微软组织变革表明:

微软在自主开发和训练生成式人工智能上遇到了瓶颈。

而同期微软推出的AI相关的新工具,也佐证了其在生成式人工智能业务上的战略转向。

前途未卜的合成数据与蒸馏模型

今年的早些时候,微软似乎在对先前内部的一个名为「蒸馏」项目加倍投注。

这个项目的内容大致为先使用OpenAI的模型生成大量数据,然后再利用这些数据来训练类似ChatGPT的模型。

微软的目标是让这些模型在某些任务上几乎能达到与OpenAI模型相同的表现,这样微软就可以根据自身的需要,对自己开发的模型进行「公平市场价格」的定价和自由出售。

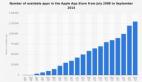

在人工智能的开发中,业内几乎都会使用某种形式的人工智能生成的训练数据,即合成数据。

作为OpenAI的主要资助者,微软拥有充分的自由来使用OpenAI的模型。

因此,微软的研究人员能够要求GPT-4生成数百万段与教科书质量类似的文本段落,包括文章和教科书风格的练习,这些练习附有解释的问答内容。

随后,微软便可以利用这些数据来训练一个较小但其性能表现与GPT-4相似的模型。

而大约从一年前开始,微软就通过提炼OpenAI的模型开发了Phi。

Phi不仅开源,运行成本也更低。

微软研究人员在他们的论文中表示,虽然Phi的规模要小得多,但其性能几乎可以与OpenAI的主要旗舰模型相媲美。

微软CEO纳德拉将Phi形容为微软在AI领域「掌握自己命运」的一种方式。

他向股东们表示,Phi在Azure上与投资公司贝莱德、阿联酋航空以及医疗软件公司Epic等客户进行了合作。

在某些情况下,特别是当问题相对简单、不需要复杂解答时,微软用Phi替代了OpenAI 的模型,例如在Bing等产品中取代GPT-4作为AI聊天机器人。

在Phi初步成功之后,今年一月,微软将负责Phi的首席研究员Sébastien Bubeck从微软研究部门调往一个专注于构建蒸馏模型的新组织。

同年三月,微软以6.5亿美元的协议聘请了Inflection的CEO 穆Mustafa Suleyman并让他负责公司的消费者AI业务后,Bubeck被调到了苏莱曼所管理的微软AI团队。

据两位知情人士称,他负责的是使用OpenAI的大型模型来生成训练数据。

然而,最近Bubeck已从Suleyman的团队离职,重新回到微软研究部门,并再次向研究主管Peter Lee汇报工作。

而在八月,负责将Phi模型添加到Azure和其他微软产品中的Misha Bilenko也离职前往了谷歌的DeepMind AI团队。

一位微软AI研究员认为,这些突如其来的人员变动可能表明,Suleyman将不再把合成数据和蒸馏视为部门的发展方向以及微软的首要目标。

另一方面,今年五月被寄予期望的大型模型MAI-1毫无消息,且Suleyman团队之后也再也没有公开发布过任何模型的情况,也佐证了这一战略转向。

微软现如今依然要依靠OpenAI的模型来支持自己的人工智能服务,据一些金融机构的预测,微软今年有望在Azure上通过转售OpenAI的模型获得超10亿美元的收入。

值得在意的是,微软近期推出了一项在Azure AI上的新服务——

「校正」:人工智能幻觉的纠正工具

现阶段阻碍生成式人工智能在现实中更广泛地应用落地的最大缺陷,就是「幻觉」(hallucinations)。

幻觉是指缺乏基础数据支持的内容的生成,输出误导性的信息。

这种现象尤其与大型语言模型( LLMs )相关。

在医学、自动驾驶等高风险领域,准确的信息至关重要。

虽然人工智能有潜力改善对重要信息的获取,但幻觉可能会导致误解,造成严重的后果。

虽然业内可以通过「过滤」来解决幻觉问题,但这种方法在输出的文本因内容被删减或屏蔽而变得不连贯时,会导致用户体验不佳。

而微软认为,在Azure AI内容安全的接地检测(groundedness detection)中引入的一项新功能——校正(correction),能够突破上述局限。

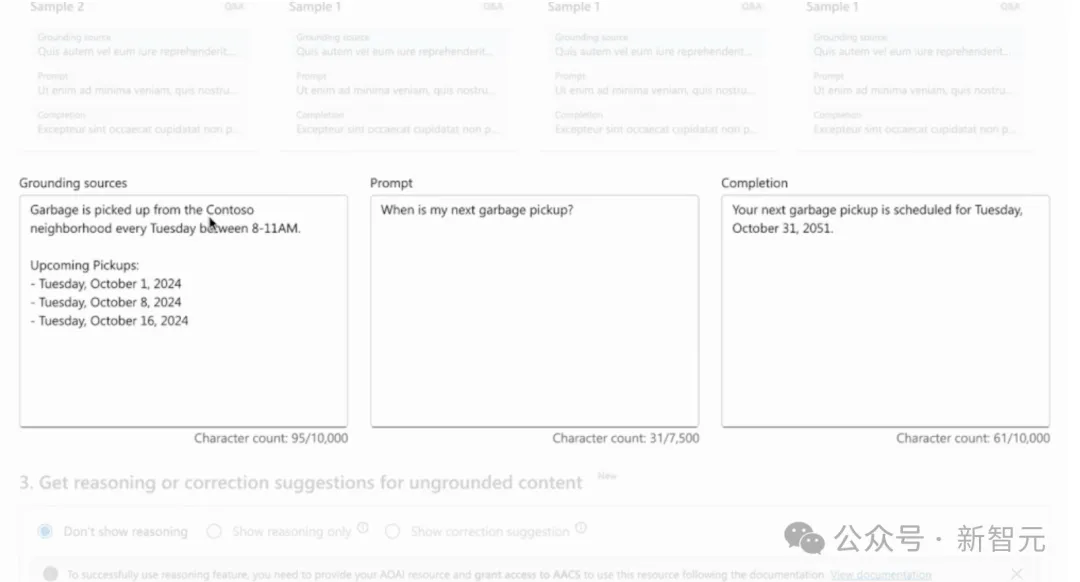

今年三月,微软在Azure AI引入了接地检测。它能够将人工智能的输出与原文档进行比较,以识别生成过程中的幻觉内容。

但在用户实际体验这项服务的过程中,一个疑问也随之产生:「对这些检测到的幻觉内容除了屏蔽之外,我们还能做什么?」

为了解决这个问题,微软在接地检测中引入了校正功能,让使用GenAI程序的用户能够遇到幻觉之前,实时识别和纠正幻觉。

但校正的运作,需要程序连接到用于文档摘要和给予RAG的接地文档。

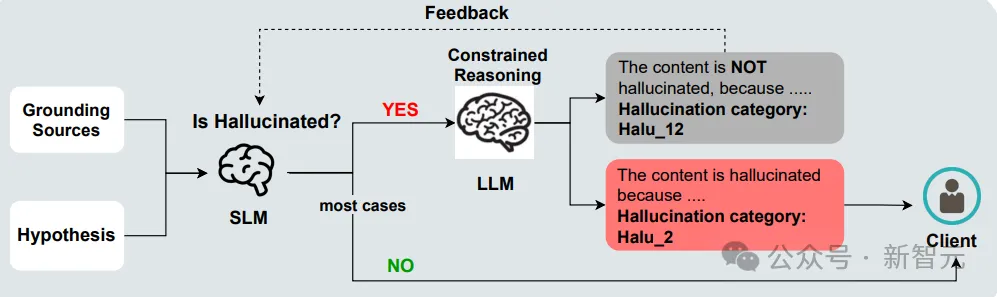

之后,Azure AI上的接地检测将通过以下几步运行:

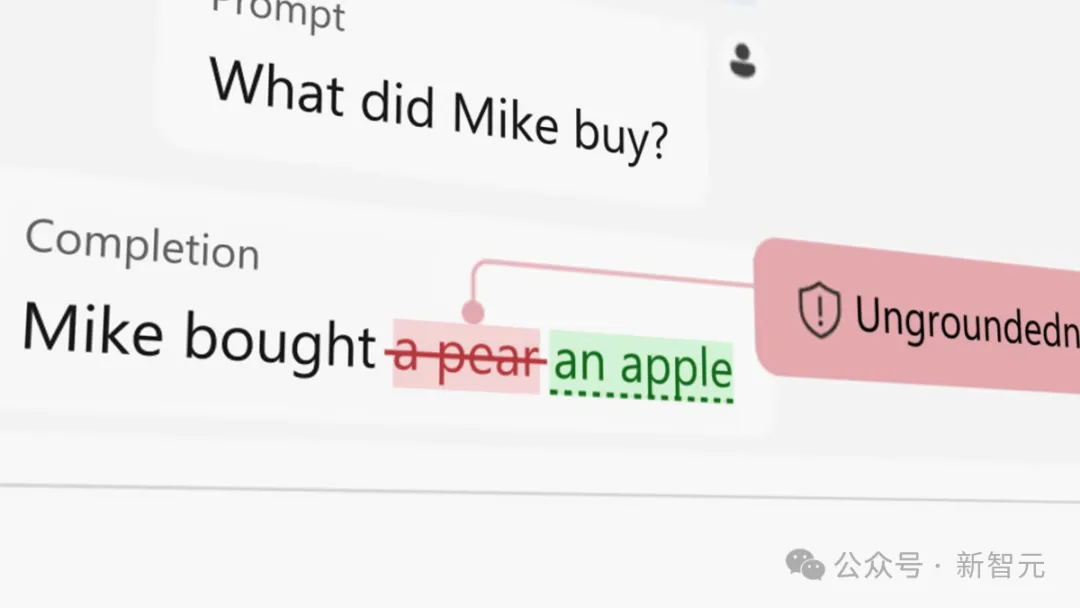

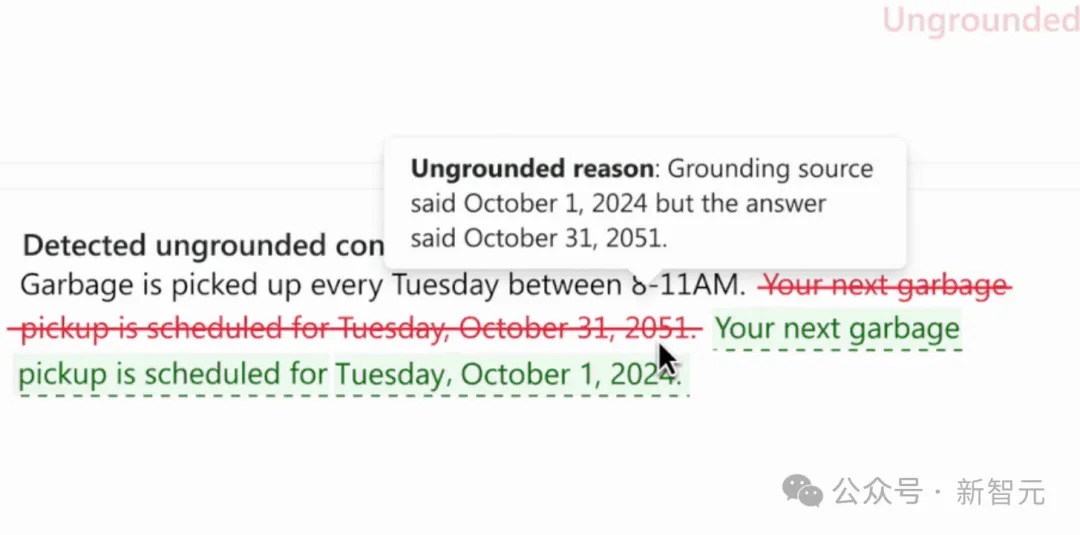

检测:首先,Azure AI内容安全会扫描AI生成内容中的无根据部分。

幻觉现象并不是一个完全有或完全无的问题,大多数无根据的输出实际上也包含了一些有根据的内容。

这就是为什么有根据性检测可以精确找到无根据内容的具体部分。

当无根据的内容被识别出来后,模型会高亮显示具体不正确、不相关或虚构的文本。

推理:在识别出无根据的段落后,模型会生成解释说明,说明为什么某些文本被标记。

这种透明性非常重要,因为它可以让用户明确无根据的点,并评估其不接地的严重性。

修正:一旦无根据的内容被标记,系统会实时启动改写过程。被标记为不准确的部分会被修改,以确保与相关数据源保持一致。

但如果该句子缺少任何与基础文件相关的内容,则可能会被完全过滤掉。

而在用户看到最初的无根据内容之前,修正就已经完成。

输出:最后,修正后的内容将返回给用户。

但微软强调,该工具提高的是人工智能生成的内容和源材料之间的一致性,它并不能保证生成的内容可以到达完美的准确性。

毕竟最根本的是数据来源的真实性和客观性。或许,这也是微软决定内部战略转向的原因。

而在构建值得信赖的人工智能的道路上,业界的开发者们还需要更多不同的尝试。