在人工智能领域,多模态模型的发展一直备受关注。阿里通义千问的 Qwen2-VL 的发布,为多模态技术的发展注入了新的活力。它不仅在图像和视频理解方面取得了显著的突破,还具备强大的视觉智能体能力,能够与各种设备进行交互,为用户带来全新的体验。

一、模型特点

1. 强大的视觉理解能力

- 任意分辨率图像识别:Qwen2-VL 可以读懂不同分辨率和不同长宽比的图片,无论图像的清晰度或大小如何,都能轻松识别。这得益于其独特的 naive dynamic resolution 支持,能够将任意分辨率的图像映射成动态数量的视觉 token,保证了模型输入和图像信息的一致性,模拟了人类视觉感知的自然方式。

- 长视频理解:该模型能够理解超过 20 分钟的长视频,这在多模态模型中是一项重大的突破。通过在线流媒体能力,它可以支持高质量的视频问答、对话和内容创作等应用,为视频领域的智能化发展提供了有力的支持。

2. 多语言支持

Qwen2-VL 除了支持英语和中文外,还能理解图像视频中的多种语言文本,包括大多数欧洲语言、日语、韩语、阿拉伯语、越南语等,真正做到了面向全球用户,打破了语言的障碍,为多语言环境下的应用提供了便利。

3. 视觉智能体能力

Qwen2-VL 具备强大的视觉智能体能力,可自主操作手机和机器人等设备。借助其复杂的推理和决策能力,能够根据视觉环境和文字指令进行自动操作,实现了人工智能与现实世界的更紧密结合,为智能家居、智能机器人等领域的发展带来了新的机遇。

二、模型架构

1. 模型结构

Qwen2-VL 延续了上一代 Qwen-VL 中 ViT 加 Qwen2 的串联结构,三个不同规模的模型都采用了 600M 规模大小的 ViT,支持图像和视频统一输入。这种结构使得模型能够更好地融合视觉和语言信息,提高对多模态数据的理解能力。

图片

图片

2. 多模态旋转位置编码(M-ROPE)

传统的旋转位置嵌入只能捕捉一维序列的位置信息,而 Qwen2-VL 采用的 M-ROPE 将旋转位置编码分解成时间、空间(高度和宽度)三部分,使大规模语言模型能够同时捕捉和整合一维文本、二维视觉和三维视频的位置信息,赋予了模型强大的多模态处理和推理能力,能够更好地理解和建模复杂的多模态数据。

图片

图片

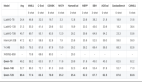

三、模型性能

1. 基准测试成绩优异

在多个权威测评中,Qwen2-VL 创造了同等规模开源模型的最佳成绩。在 mathvista、docvqa、realworldqa、mtvqa 等基准测试中创下全球领先的表现,在文档理解方面优势尤其明显。与 GPT-4O 和 Claude3.5-Sonnet 等闭源模型相比,Qwen2-VL 在大部分指标上都达到了最优。

2. 高效的计算效率

在保证高性能的同时,Qwen2-VL 还具有较高的计算效率,能够在不同的硬件平台上快速运行,为大规模应用提供了可能。其量化版本的发布,进一步提高了模型的计算效率,降低了部署成本。

图片

图片

四、模型体验

在线体验:https://huggingface.co/spaces/Qwen/Qwen2-VL

图片

图片

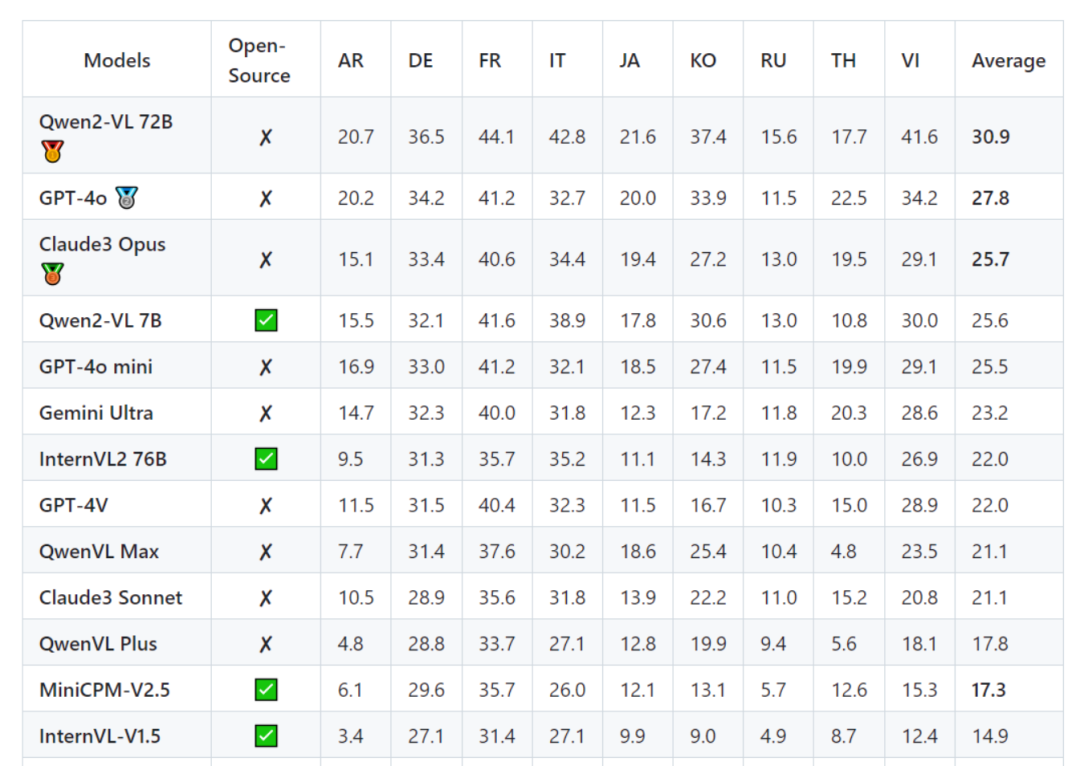

五、模型下载

此次 Qwen2 - VL 进行了开源,其中包含两个尺寸的模型,分别是 Qwen2 - VL - 2B - Instruct 以及 Qwen2 - VL - 7B - Instruct,同时还提供了其 GPTQ 和 AWQ 的量化版本。

以下是模型相关链接:

Qwen2 - VL - 2B - Instruct:https://www.modelscope.cn/models/qwen/Qwen2-VL-2B-Instruct

Qwen2 - VL - 7B - Instruct:https://www.modelscope.cn/models/qwen/Qwen2-VL-7B-Instruct

我们推荐使用 ModelScope CLI 进行模型下载,具体命令如下:

下载完成如下:

图片

图片

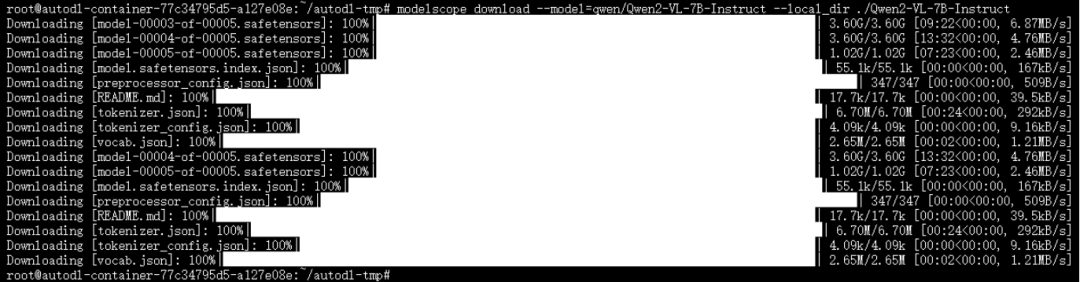

六、模型推理

1. 安装依赖

安装如下:

图片

图片

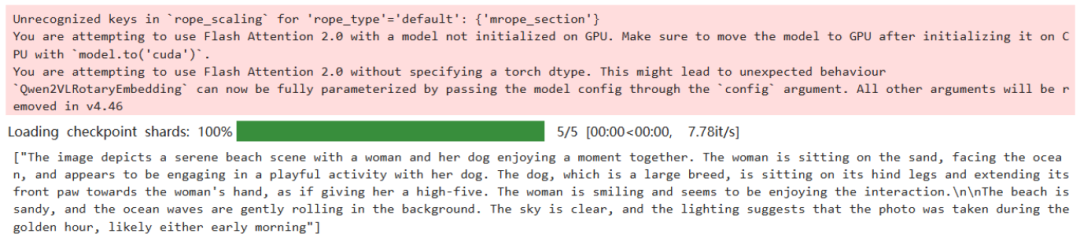

2. 模型推理

输出如下:

图片

图片

七、模型微调

1. 安装依赖

swift开源地址:https://github.com/modelscope/swift

在开始微调之前,先准备好环境

2. 模型微调

图像描述微调我们使用 coco-en-mini 数据集进行微调,该数据集的任务是对图片内容进行描述。

可以在 modelscope 上找到该数据集:https://modelscope.cn/datasets/modelscope/coco_2014_caption/summary

如果要使用自定义数据集,只需按以下方式进行指定:

自定义数据集支持json和jsonl样式,以下是自定义数据集的样例:

微调后推理脚本如下:

八、结语

阿里通义千问的 Qwen2-VL 是一款具有强大功能和优异性能的视觉语言模型,它的发布为多模态技术的发展带来了新的机遇。无论是在视觉理解能力、多语言支持还是视觉智能体能力方面,Qwen2-VL 都表现出了卓越的性能,为各种应用场景的智能化发展提供了有力的支持。随着技术的不断发展和应用场景的不断拓展,相信 Qwen2-VL 将在未来发挥更加重要的作用。