业界有云:“复杂性是安全性的敌人”。如今智能化领域中愈发抢眼的 AI 大模型,在计算机视觉、文字生成等应用场景,显现出震撼人心的智能化水准前,都有着一段类似“破茧成蝶”的经历。AI 大模型“黑箱”内部架构有高度复杂的神经网络,以及需要源源不断地投喂、输入高质量语料。经过高密度信息训练与推理后的 AI 大模型,内部复杂性可想而知。

延伸阅读,点击链接了解 Akamai API Security

如今, AI 大模型已成为智能化时代的核心基础资产。在 AI 大模型本体基础上的应用层面,也展现了百花齐放的创新形态。从更广的维度看,多类别创新版图之间,贯穿不同系统平台的 API 链路,也使得 AI 大模型生态日渐复杂,展现在黑客眼前的攻击暴露面,正在持续蔓延。

OWASP: 重点关注三大风险

经过多轮分析、挑选,OWASP 安全机构发布了 AI 大模型应用的十大风险:

从中可以全览 AI 大模型的风险分布,为 AI 大模型的通用安全漏洞评测提供标准依据。

从利用外部数据源训练、微调数据集的训练数据阶段,到基于大模型自动化代理为终端用户构建核心应用服务,以及联动多方插件布局大模型的下游服务,OWASP 重点提示的十大风险,遍布于整个 AI 大模型创新生态的全链路关键场景。

如果说 AI 大模型的语料训练阶段,还属于智能化科创企业的“闭门造车”的内部研发阶段,但步入了推理部署阶段之后,即将蝶变的 AI 智能体大脑,一经发布就要呈现于全域数字化场景中。此时,窥伺大模型与相关数据资产的黑客,将会易于寻觅到更多攻击切入点。

大模型+API: 风险指数随之增加

鉴于业界成型的 AI 大模型训练成本门槛高,API 接口与开源模型广为应用。借助 API 的互联性,大模型更易用,可跨平台响应不同应用需求与商业化运营。保护好 API 的安全性,就是在一定程度上增强了 AI 大模型的外层防御力度。因而,我们需要把 API 与漏洞评估视为 AI 大模型的头等大事。

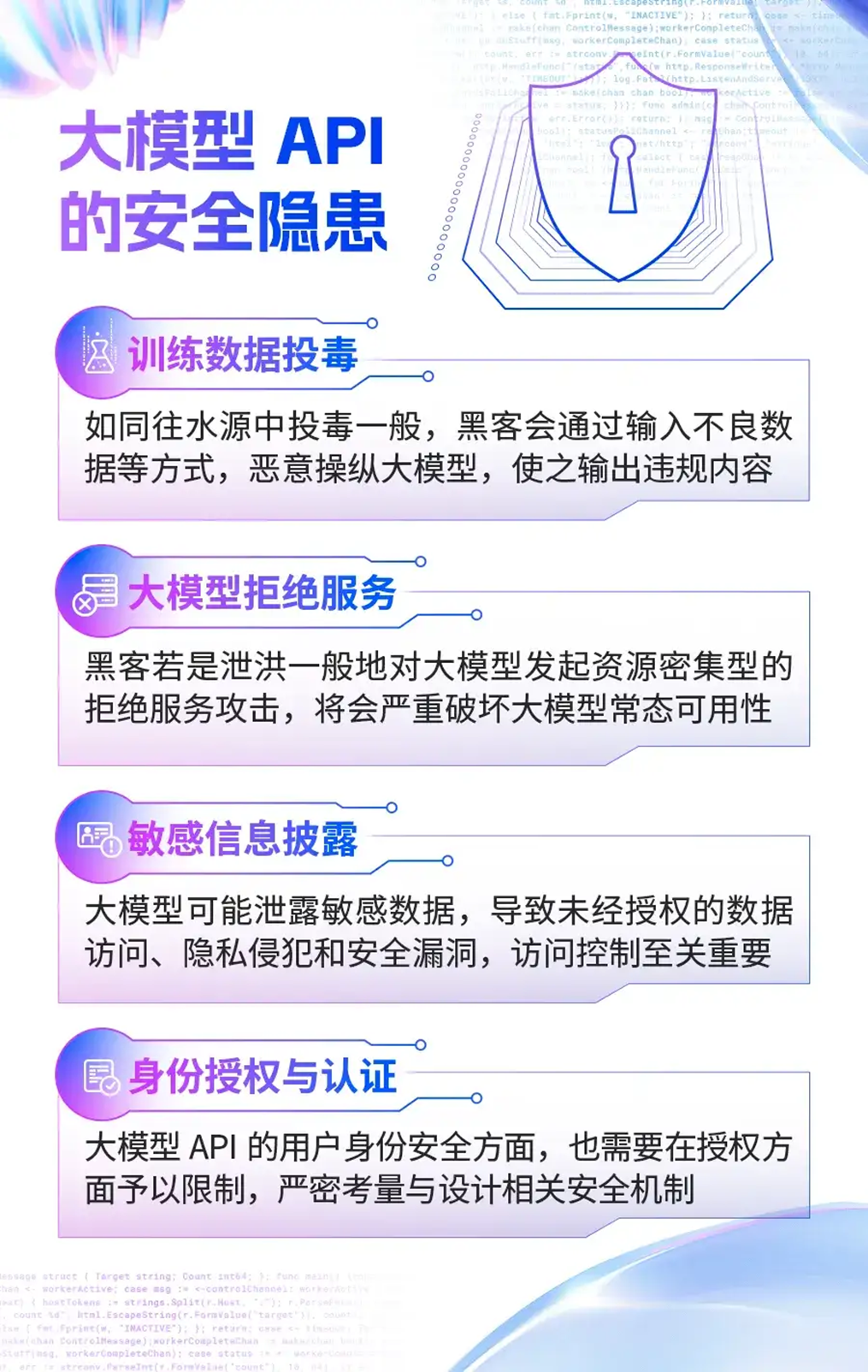

AI 大模型与上下游生态所组成的整个体系,API 接口如毛细血管一般,向不同位置的工作负载,输送着多类别数据信息。结合 OWASP 安全机构总结的十大威胁来看,大模型 API 面临着训练数据投毒、大模型拒绝服务、敏感信息披露以及身份授权与认证等方面的安全隐患。

Akamai 云安全治理思路

深化加固重点攻防端口,有助于实现事半功倍的安全防护。无论是在传统 IT 资产,还是在近年涌现的 AI 大模型等新兴的智能化资产中,API 都关乎数据、关乎 IT 系统安全严密与否。Akamai 认为,做好 API 资产全生命周期管理,有助于全面检测隐藏威胁,剔除黑客入侵路径,规避 AI 大模型十大风险以及其它安全漏洞。

治理好 API 安全,即是保障数据流通的“管道”安全。而在数据安全方面,尤其是企业通过内部信息部署私有 AI 大模型时,也需注意培养员工对组织核心数据资产管理的安全意识,防范自身生产经营文件、员工隐私的意外泄露。

当下,多数 AI 大模型都部署于云端,所在云环境的安全性也十分关键。作为拥有多年安全基础设施经验积累的云服务商,Akamai 针对智能化时代的数据安全威胁,已构建有一套完全闭环的保护体系。目前,Akamai 通过多种路径与具备 AI 能力的云安全产品,深度保护 AI 大模型、API 与数据等企业核心资产。

针对具有高度复杂性、黑箱性等特点的 AI 大模型安全治理,更需要开发大模型的 AI 先锋企业建立全局视野,全生命周期端到端进行安全防御。当下,Akamai 内部云安全产品创新进程中,也在持续调研、分析可预防与缓解 AI 大模型风险的有效安全路径,帮助 AI 科技等行业在安全运营等方面化繁为简,全方位规避大模型数据泄露,专注解锁 AI 增长点。

—————————————————————————————————————————————————

如您所在的企业也想要进一步保护API安全,

点击链接了解Akamai Linode的解决方案