本篇工作发表在《Nature Computational Science》上,共同通讯作者是中国科学院自动化所李国齐研究员、徐波研究员,北京大学田永鸿教授。共同一作是清华大学钱学森班的本科生何林轩(自动化所实习生)、数理基科班本科生徐蕴辉(自动化所实习生),清华大学精仪系博士生何炜华和林逸晗。

让模型具有更加广泛和通用的认知能力,是当前人工智能(AI)领域发展的重要目标。目前流行的大模型路径是基于 Scaling Law (尺度定律) 去构建更大、更深和更宽的神经网络提升模型的表现,可称之为 “基于外生复杂性” 的通用智能实现方法。然而,这一路径也面临着一些难以克服的困境,例如高昂的计算资源消耗和能源消耗,并且在可解释性方面存在不足。

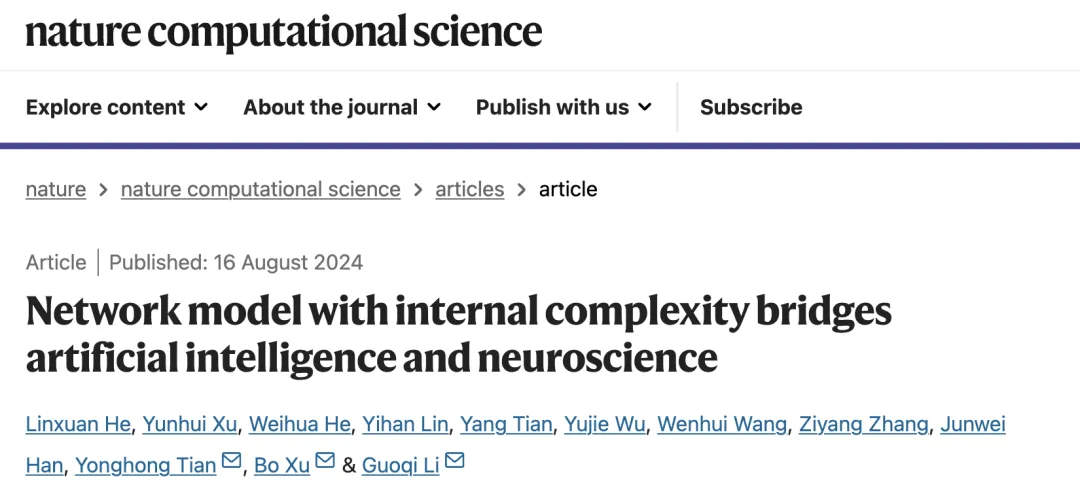

人工智能与神经科学长期以来相互依存,协同发展。为了克服 “基于外生复杂性” 实现通用智能的困境,中国科学院自动化研究所李国齐、徐波研究团队联合清华大学、北京大学等借鉴大脑神经元复杂动力学特性,提出了 “基于内生复杂性” 的类脑神经元模型构建方法 (图 1),改善了传统模型通过向外拓展规模带来的计算资源消耗问题,为有效利用神经科学发展人工智能提供了示例。Nature Computational Science 期刊对此评论道:“AI 研究更加贴近工程与应用,而神经科学的研究更加具有探索性。研究团队挑战了这一传统观点,并表明更详细且生物学上更真实的神经元模型可以推动深度学习取得更大进展。”

- 论文链接:https://www.nature.com/articles/s43588-024-00674-9

- 评论链接:https://www.nature.com/articles/s43588-024-00677-6

图 1. “外生复杂性” 和 “内生复杂性” 定义示意图。内生复杂性是指向内借鉴大脑神经元复杂动力学特性构建神经网络基元模型

具有内生复杂性的小网络模型:生物神经元的启示

生物神经元具有复杂的内部结构,例如离子通道、突触传递机制等,这些复杂的内部结构使得神经元能够处理复杂的信号并产生多样化的响应。相比之下,目前的人工脉冲神经网络模型,例如经典的 LIF (Leaky Integrate and Fire)网络,通常采用简单的内部结构,难以模拟生物神经元的复杂动力学和功能。

在这项研究中,研究者提出了 “具有内生复杂性的小网络模型” 这一概念,其核心思路是通过模拟生物神经元的复杂动力学,将复杂的内部结构引入单个神经元,从而构建更高效的 AI 模型。例如在本研究中,研究者在脉冲神经网络中使用 HH(Hodgkin-Huxley)模型来替代传统的 LIF 模型。作为一种描述神经元动作电位产生机制的数学模型,HH 模型具有由复杂的内部结构带来的精细动力学,可以模拟神经元对各种刺激的响应。

从外生复杂性至内生复杂性的转化

理论动力学推导与仿真

研究团队通过理论证明了 HH 模型与 LIF 模型在动作电位产生机制上存在某种等效关系,即一个 HH 神经元可以和四个时变参数 LIF 神经元(tv-LIF)以特定连接方式形成的微结构等效,其中每个 LIF 神经元描述 HH 模型中的一个离子通道。基于这种等效性,可以通过设计微结构提升计算单元的内生复杂性,使 HH 网络模型能够模拟更大规模 LIF 网络模型的动力学特性,在更小的网络结构上实现与之相似的计算功能。

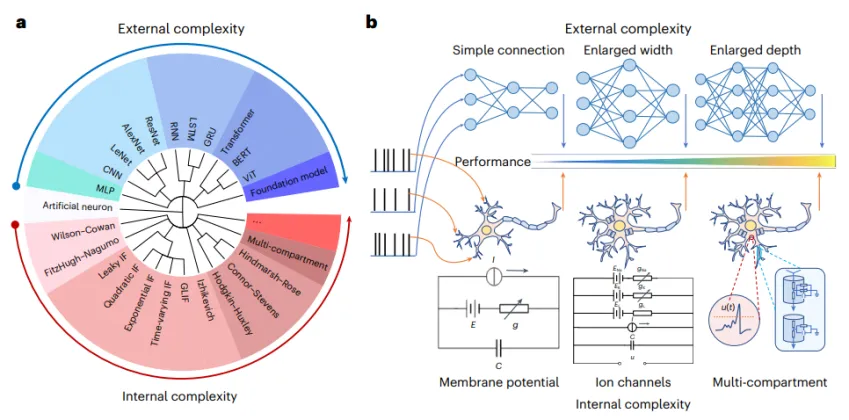

研究团队通过模拟神经元刺激输入对比网络输出对该理论进行了仿真验证。在相同的输入刺激下,具有更高外生复杂性的 tv-LIF 网络能够与 HH 模型产生相同的输出响应。进一步,团队将由四个 tv-LIF 神经元构建的 “HH 模型”(tv-LIF2HH)简化为 s-LIF2HH 模型,通过仿真实验验证了这种简化模型依然保有捕捉 HH 模型动力学行为的可能性 (图 2)。

图 2. “外生复杂性” 和 “内生复杂性” 神经元能够保持等效的动力学行为,为计算任务简化后仍旧能够保持相近的动力学行为

网络学习实验对比

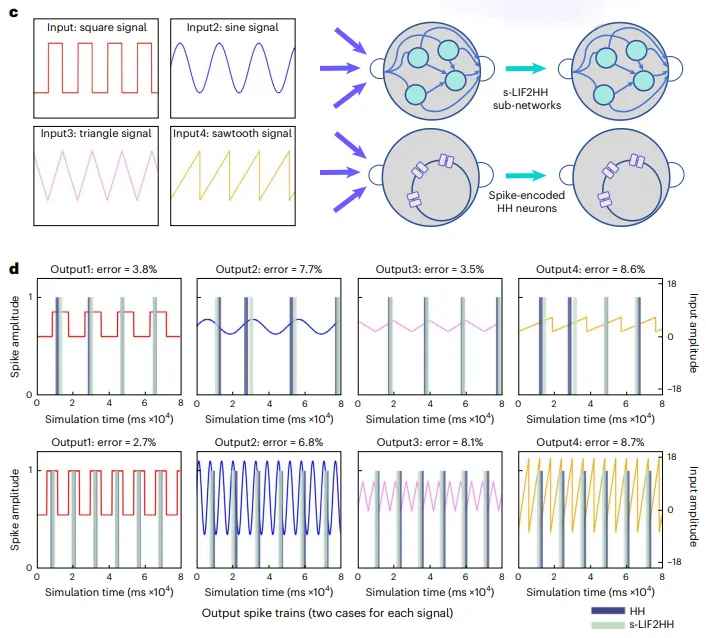

除了通过仿真研究相同刺激下不同网络的动力学行为,研究者构建了更大规模的 HH 网络模型, s-LIF2HH 网络模型,并进行了多任务分类和深度强化学习实验。结果表明,具有内生复杂性 HH 网络模型能够与更大规模的 s-LIF2HH 网络模型在表示能力和鲁棒性上具有相似的性能,相比更大规模的一般 LIF 网络表现出更好的性能。

- 多任务学习实验:研究者通过使用 Fashion-MNIST 数据集进行多任务学习实验,结果表明 HH 网络模型能够与更大规模的 s-LIF2HH 网络模型实现相当性能,甚至略优于更大规模的一般 LIF 网络(图 3)。

图 3. 具有内生复杂性的 HH 网络模型在多任务上能与更大规模外生复杂性网络络性能相当

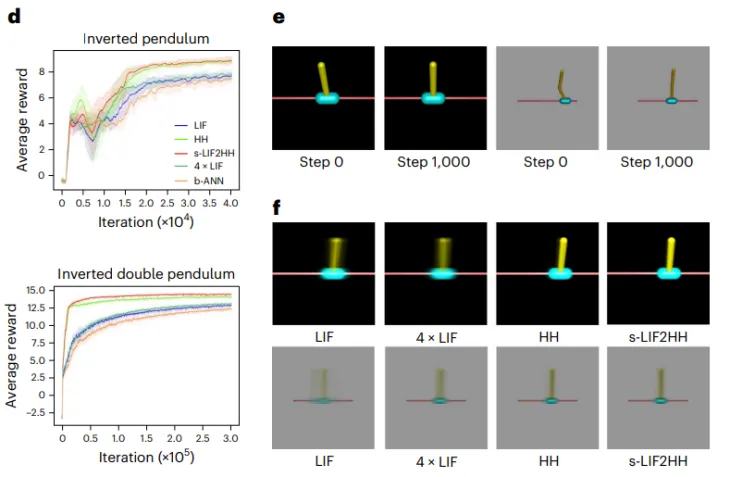

- 时序强化学习实验:研究者在倒立摆(Inverted Pendulum)和倒立双摆(Inverted Double Pendulum)环境下进行时序强化学习实验,结果表明 HH 网络模型能够与更大规模的 LIF 网络模型相比,表现出更强的时序信息提取能力(图 4)。

图 4. 具有内生复杂性的 HH 网络模型在时序强化学习任务上能与更大规模外生复杂性网络性能相当

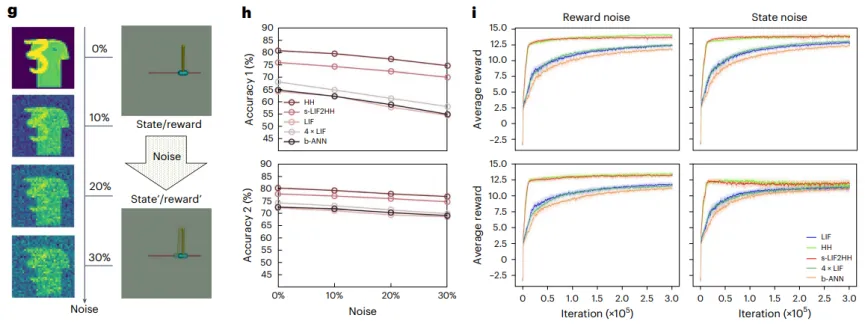

- 鲁棒性实验:研究者在多任务学习和深度强化学习任务中添加高斯噪声,以评估网络的鲁棒性。实验结果显示,更大规模的一般 LIF 网络模型在噪声影响下性能下降幅度最大,而 HH 网络模型和更大规模的 s-LIF2HH 网络模型则表现出更强的鲁棒性。在噪声强度增加的情况下,HH 网络模型和 s-LIF2HH 网络模型的奖励曲线仍然保持接近,并且相比一般 LIF 网络模型受到的影响显著地更小(图 5)。

图 5. 具有内生复杂性的 HH 网络模型比更大规模外生复杂性网络具有更好的鲁棒性

实验证明了内生复杂性模型在处理复杂任务时的有效性和可靠性。同时,研究发现 HH 网络模型在计算资源消耗上更为高效,显著减少了内存和计算时间的使用,从而提高了整体的运算效率。研究团队通过信息瓶颈理论对上述研究结果进行了解释。除此之外,小规模的模型外部结构相对简单,更容易理解其决策过程,这也提高了模型的可解释性和安全性。

结语与展望

具有内生复杂性的小型模型为 AI 的发展带来了新的机遇。通过模拟生物神经元的复杂动力学,优化模型的局部微结构扩展内生复杂性,我们可以构建更高效、更强大的 AI 模型,并克服外部复杂性大型模型的困境。未来,拓展内生复杂性或将成为 AI 研究的重要方向,并推动 AI 技术走向更广泛的应用。

本研究为将神经科学的复杂动力学特性融入人工智能提供了新的方法和理论支持,为实际应用中的 AI 模型优化和性能提升提供了可行的解决方案。目前,研究团队已开展对更大规模 HH 网络,以及具备更大内生复杂性的多分枝多房室神经元的研究,有望进一步提升大模型计算效率与任务处理能力,实现在实际应用场景中的快速落地。