众所周知,除了各种科幻电影的演绎外,AI在现实世界中还没有杀过人,也没有发动过大规模网络攻击。

然而,美国的一些立法者依然希望,在这种反乌托邦的未来变为现实之前,能够实施足够安全保障。

就在本周,加州的《前沿人工智能模型安全创新法案》——SB 1047,再次朝着正式成为法律,迈出了重要一步。

简单来说,SB 1047将会通过追究开发者的责任,来防止AI系统造成大规模人员伤亡,或引发损失超过5亿美元的网络安全事件。

不过,由于来自学界和业界的反对太过强烈,加州立法者稍稍做了一些妥协——加入了AI初创Anthropic和其他反对者建议的几项修正案。

相比于最初的提案,现行版本减少了加州政府追究AI实验室责任的权力。

法案地址:https://leginfo.legislature.ca.gov/faces/billTextClient.xhtml?bill_id=202320240SB1047

但即便如此,(几乎)没有人喜欢SB 1047。

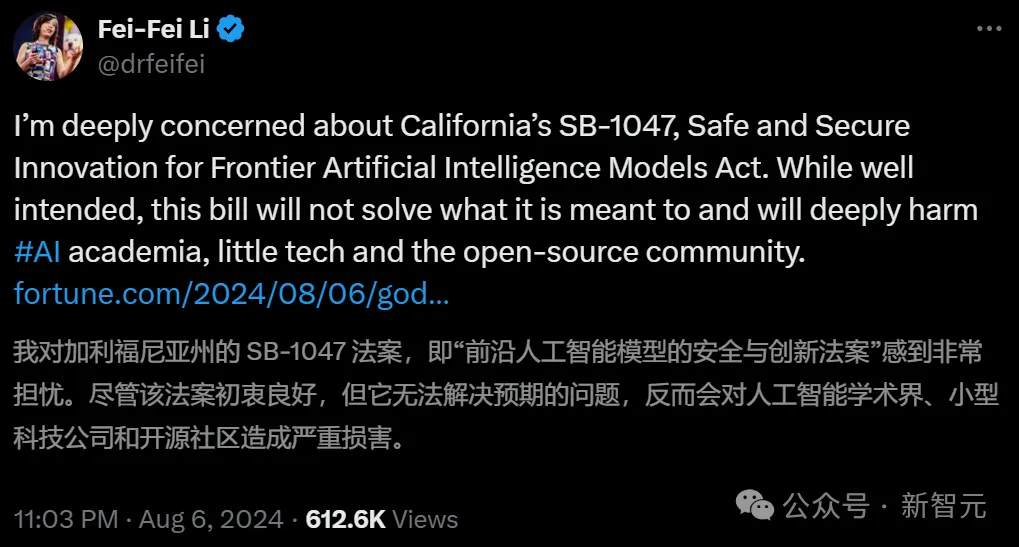

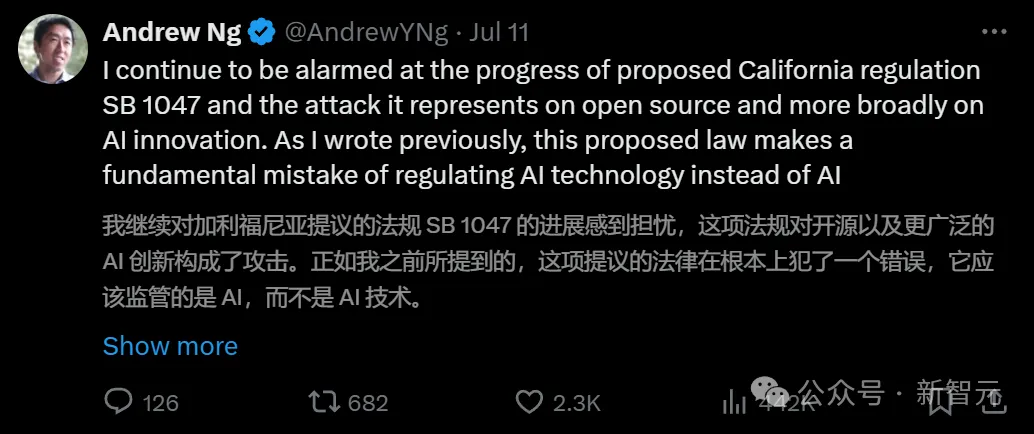

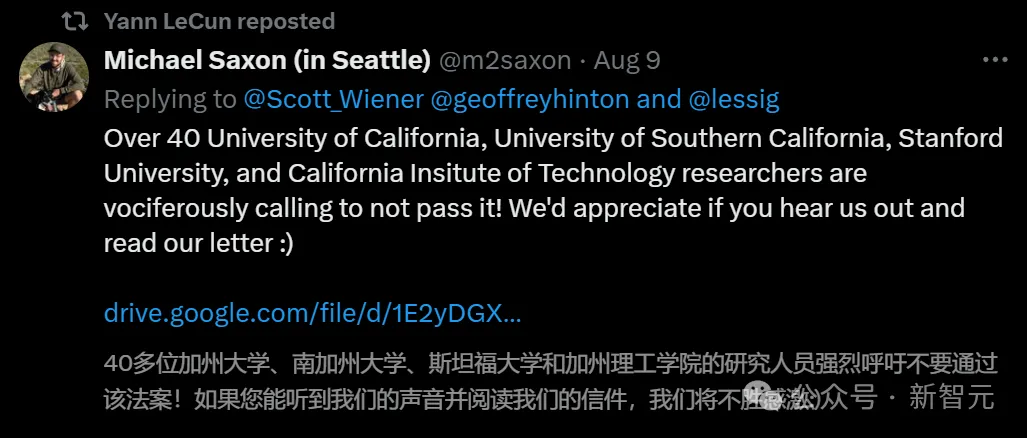

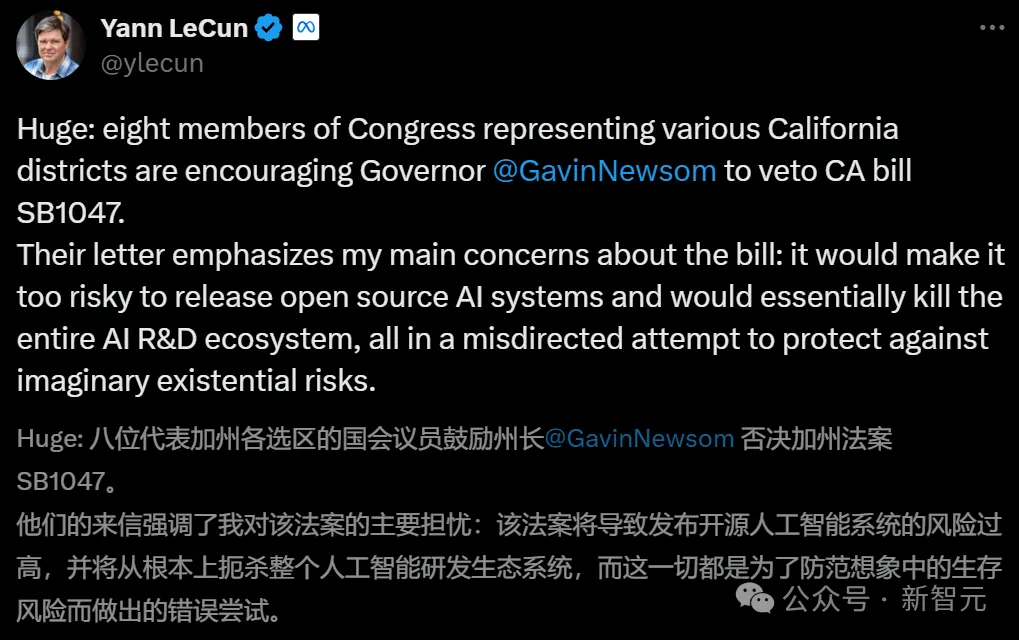

Yann LeCun、李飞飞、吴恩达等AI大牛们,都曾多次表达了对这项「扼杀开源AI,迫使AI创新暂缓甚至停止」的法案的不满。

各种联名信也是层出不穷:

不仅有40多位来自加州大学、南加州大学、斯坦福大学和加州理工学院的研究人员,强烈呼吁不要通过这项法案。

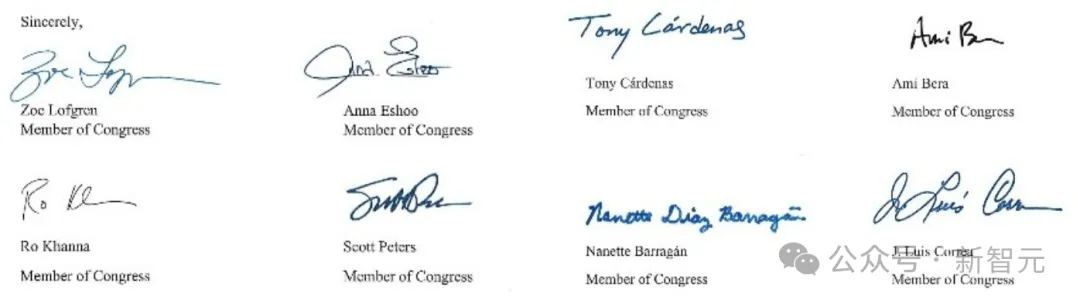

而且代表加州各选区的8位国会议员,也敦促州长否决法案。

甚至,LeCun还照搬了之前要求暂停AI研究时的原梗——请暂停AI立法六个月!

那么问题来了,为什么前文用的是「几乎所有人」?

因为,除了LeCun之外的另外两位图灵巨头,Yoshua Bengio和Geoffrey Hinton,都强烈支持这项法案通过。

甚至还觉得,现在的条款定得有些太过宽松了。

作为高级人工智能技术和政策研究人员,我们写信表达对加州参议院法案1047的强烈支持。

SB 1047概述了对这种技术进行有效监管的基本要求。它没有实施许可制度,不要求公司在训练或部署模型之前获得政府机构的许可,它依赖于公司自行评估风险,甚至在发生灾难时也不对公司严格追责。

相对于我们面临的风险规模,这是一项相对宽松的立法。

取消该法案的基本措施将是一个历史性的错误——这一错误将在一年内变得更加明显,因为下一代更强大的AI系统将被发布。

如今,SB 1047虽然遭到了一些美国国会议员、知名AI研究人员、大型科技公司和风险投资人的强烈反对,但在加州立法机构中却还是相对轻松地通过了。

接下来,SB 1047将进入加州议会进行最终投票。由于加入了最新的修正案,法案在通过之后,还需要被送回加州参议院进行投票。

如果这两次都投票通过,那么SB 1047就会被送到州长那里,等待最终的否决或签署成为法律。

哪些模型和公司会受到约束?

根据SB 1047的要求,开发者或开发模型的公司,需要负责防止自己的AI模型被人拿去造成「重大伤害」。

比如制造大规模杀伤性武器,或发起损失超过5亿美元的网络攻击。顺便一提,CrowdStrike的「全球Windows蓝屏事件」,造成了超过50亿美元的损失。

不过,SB 1047的规则仅适用于那些规模十分巨大的AI模型——即训练成本至少为1亿美元,且浮点运算超过10^26次。(基本上就是照着GPT-4的训练成本定的)

据称,Meta下一代Llama 4所需的计算量将会翻至10倍,因此也将会受到SB 1047的监管。

对于开源模型及其微调版本,则需要原始开发者负责。除非花费的成本达到了原始模型的3倍。

如此看来,难怪LeCun的反应会如此激烈。

此外,开发者还必须创建能够解决AI模型风险的测试程序,并且必须每年聘请第三方审计员来评估其AI安全实践。

对于那些基于模型打造的AI产品,则需要制定相应的安全协议来防止滥用,包括一个关闭整个AI模型的「紧急停止」按钮。

等等……

SB 1047现在的功能是什么?

如今,SB 1047不再允许加州总检察长在灾难性事件发生之前,因安全措施疏忽起诉AI公司。(来自Anthropic的建议)

取而代之的是,加州总检察长可以寻求禁止令,要求公司停止其认为危险的某项操作,并且如果其模型确实导致灾难性事件,仍然可以起诉 AI 开发者。

SB 1047不再设立原本包含在法案中的新政府机构「前沿模型司(FMD)」。

但仍然设立了FMD的核心——前沿模型委员会,并将其置于现有的政府运营署内,规模也从之前的5人扩大到了9人。委员会仍将为所涵盖的模型设定计算门槛,发布安全指导,并为审计员发布法规。

在确保AI模型安全方面,SB 1047的措辞也更加宽松。

现在,开发者只需提供「合理注意」来确保AI模型不会构成重大灾难风险,而不是之前要求的「合理保证」。

此外,开发者也只需提交公开的「声明」来概述其安全措施,不再需要以伪证罪为惩罚提交安全测试结果的认证。

对于开源微调模型来说,也有了一项单独的保护。如果有人在微调模型上的花费少于1000万美元,他们将不被视为开发者,责任仍由模型的原始大型开发者承担。

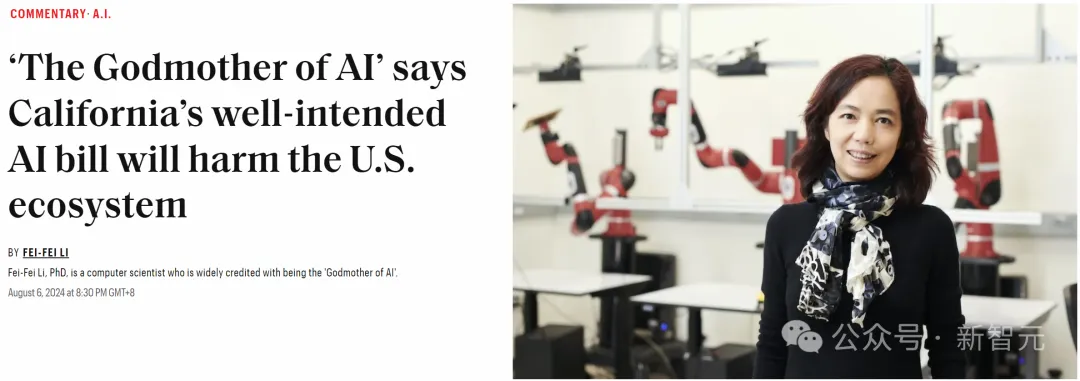

李飞飞曾亲自撰文抨击

SB 1047对于AI界的影响,可以从「AI教母」李飞飞发在《财富》杂志的专栏文章中窥见一斑:

「如果成为法律,SB 1047将损害美国新生的AI生态系统,尤其是那些已经处于劣势的部分:公共部门、学术界和小型科技公司。SB 1047将不必要地惩罚开发者,扼杀的开源社区,限制学术研究,同时也无法解决真正的问题。」

首先,SB 1047将过度惩罚开发者并扼杀创新。

在AI模型被滥用的情况下,SB 1047将责任归咎于负责方和该模型的原始开发者。对于每个AI开发者,尤其是刚起步的程序员和企业家来说,预测其模型的每一种可能用途是不可能的。SB 1047将迫使开发者采取防御性措施——这本应是需要极力避免的。

其次,SB 1047将束缚开源开发。

SB 1047要求所有超过某一阈值的模型都包含一个「紧急停止按钮」,即可以随时关闭程序的机制。如果开发者担心他们下载和构建的程序会被删除,他们在编写代码或协作时会更加犹豫不决。这个紧急停止按钮将严重影响开源社区——不仅在AI领域,而且在包括GPS、MRI和互联网本身在内的各个领域的无数创新源头。

第三,SB 1047将削弱公共部门和学术界的AI研究。

开源开发在私营部门很重要,但对学术界更重要,因为后者无法在没有协作和模型数据访问的情况下取得进展。如果研究人员无法获得适当的模型和数据,又该如何去培养下一代AI领导者呢?紧急停止按钮将进一步削弱本就在数据和计算方面处于劣势的学术界。当我们应该加大投资公共部门AI时,SB 1047将对学术AI造成致命打击。

最令人担忧的是,SB 1047没有解决AI进步的潜在风险,包括偏见和Deepfake。相反,它设定了一个非常随意的门槛——达到一定算力或耗资1亿美元训练的模型。这项措施不仅不能提供保障,反而会限制包括学术界在内的各个领域的创新。

李飞飞表示,自己并非是反对AI治理。立法对于AI的安全和有效发展至关重要。然而,AI政策必须支持开源开发,制定统一且合理的规则,并为消费者建立信心。

显然,SB 1047并没有达到这些标准。