本文经自动驾驶之心公众号授权转载,转载请联系出处。

CLIP(Contrastive Language–Image Pre-training)模型自推出以来,在图像-文本跨模态理解和生成领域取得了显著成果。然而,经典模型CLIP还是存在许多短板,对此,学界对CLIP模型的改造与增强还在持续进行中,希望通过改造CLIP模型架构、添加某些模块来弥补CLIP的能力短板,不断提升其在跨模态、少样本任务中的泛化性能与适用性。具体如下:

- 细化CLIP的视觉识别颗粒度

- 即提升其识别图像中细微差异和局部特征的能力,可以在视觉编码器部分引入更精细的特征提取机制。

- 可以采用多尺度特征融合策略,通过并行处理不同尺度的图像输入,并将多尺度特征进行有效融合,以捕捉图像中的多层次信息。

- 还可以引入注意力机制,使模型能够自动聚焦于图像中的关键区域或特征点。

- 结合弱监督学习或自监督学习方法,利用图像中的自然标注(如颜色、纹理等)或自生成标签(如聚类结果)来指导特征学习,也是提升视觉识别颗粒度的有效途径。

- 延长CLIP处理的文本长度并细化CLIP提取的文本信息

可以通过增加网络层数或采用更复杂的网络结构(如Transformer)来扩展文本编码器的容量,以支持更长的文本输入。

可以引入文本分段或分层处理机制,将长文本划分为多个子序列或段落,并分别进行编码和表示学习,最后再将各部分的表示进行有效融合。

为了细化文本信息的提取,可以设计更精细的文本表示学习方法,如基于词嵌入的向量表示、基于句法结构的图表示或基于语义角色的框架表示等。

对CLIP的图像文本输入做数据增强

对于图像数据增强,可以采用旋转、缩放、裁剪、翻转、颜色变换等传统方法,以及基于生成模型的对抗性样本生成等高级方法。

对于文本数据增强,则可以采用同义词替换、回译、随机删除、句子重组等方法来生成多样化的文本样本,或生成伪字幕改善输入数据的质量。

其他方法如, 通过文本到图像的扩散模型生成反馈来实现CLIP的自监督学习、增强模块以提升CLIP在某一少样本分类任务上的泛化能力等,还有的方法将CLIP输入扩展到视频……

本期推送再次盘点了CLIP模型架构还能如何改造,让我们一起来看看吧!

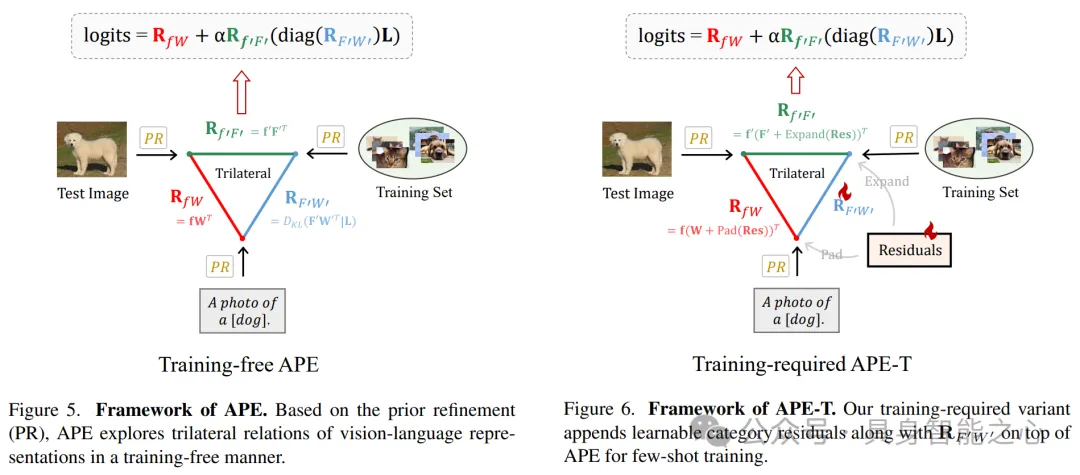

GroupViT: 从文本监督中实现语义分割

https://arxiv.org/abs/2202.11094

文章介绍了一个名为GroupViT(Grouping Vision Transformer)的模型,它是为了实现仅通过文本监督进行语义分割的任务而设计的。GroupViT通过一个分层的Transformer架构进行视觉概念的逐步分组,从较小的图像片段合并成较大的任意形状的语义段。GroupViT首先将输入图像划分为多个不重叠的小patch,并将每个patch线性投影到潜在空间,形成输入的image token。在每个分组阶段,image token和group token通过Transformer层进行信息传播,通过自注意力机制(self-attention)聚合全局信息。每个分组阶段的末尾都有一个grouping block,负责将相似的image token合并为更大的语义段(segment)。Grouping block通过计算group token和segment token之间的相似性矩阵来实现合并。在Grouping Block中,使用Gumbel-Softmax操作和直通技巧(straight through trick)来进行硬分配,使得segment tokens能够明确地分配给不同的group tokens。为了训练GroupViT执行分层分组,模型采用了特别设计的对比损失函数,包括原始的图像-文本对比损失和多标签对比损失。

相对于CLIP,GroupViT引入了分组机制,允许模型自动地将图像区域分组为语义段,而CLIP是一个基于对比学习的模型,主要用于图像和文本的联合表示学习,并没有显式的分组机制。GroupViT还采用了分层的Transformer架构,能够处理任意形状的图像段,而CLIP通常处理的是固定大小的图像patch。此外,GroupViT特有的Grouping Block模块,用于将图像tokens合并为更大的语义段。最后,GroupViT使用了多标签对比损失,通过从文本中提取名词并使用句子模板生成额外的文本标签,增强了模型对视觉分组的学习能力。

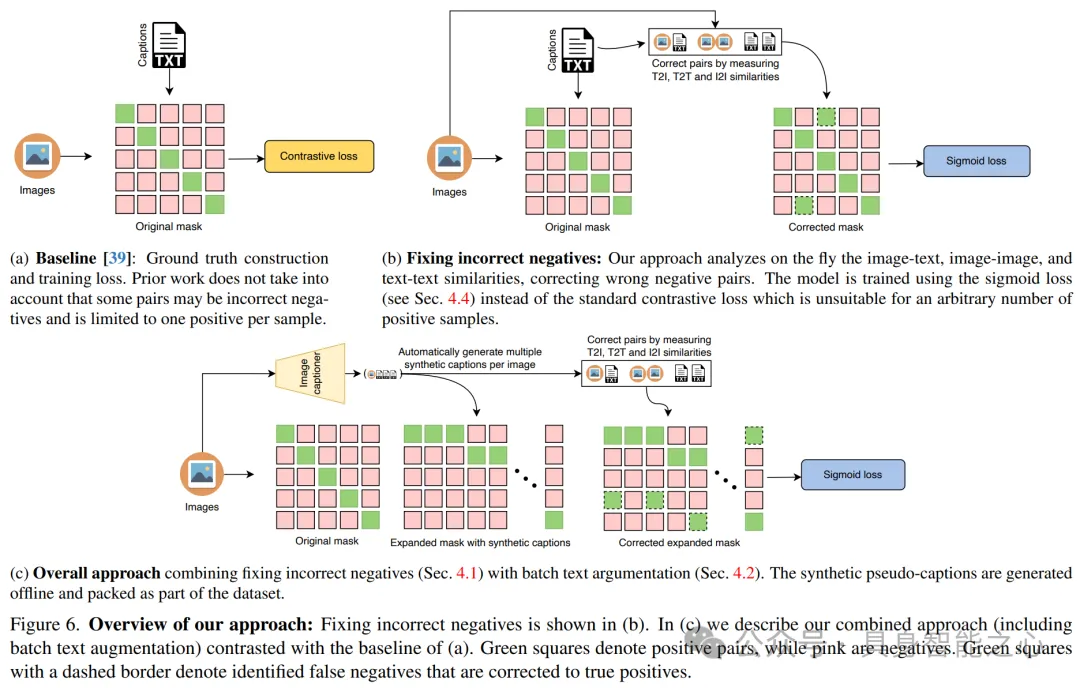

FFF:在对比性预训练中修复有缺陷的基础产生的视觉语言模型

https://arxiv.org/abs/2405.10286

文章提出了一种改进的对比性预训练方法,称为FFF(Fixing Flawed Foundations),旨在通过解决现有视觉-语言模型训练中的两个关键问题来增强模型性能:错误分配的负对(false negative pairs)和低质量及多样性不足的字幕(captions)。

- 在对比学习中,通常假设每个样本只有一个正对(positive pair),但实际中,由于图像和/或字幕在语义上的相似性,一些负对(negative pairs)可能被错误地标记。这导致训练过程和模型质量受限。为了解决这个问题,文章提出了一种基于图像-文本、图像-图像和文本-文本相似性的算法,用于发现并纠正这些错误分配的负对,并挖掘新的真正例(true positives)。

- 现有的网络收集的数据集往往包含质量低下、描述简短或不相关的字幕,这不利于训练。文章通过使用最先进的图像字幕技术生成伪字幕(pseudo-captions),作为给定图像的新真正例,从而提高字幕的质量和描述性。为了进一步提升训练数据的多样性,文章提出了批量文本增强策略。在同一个批次中,为每个训练图像生成多个伪字幕(例如,通过束搜索选择的五个字幕),这样可以有效增加字幕的多样性。

- 由于上述方法导致每个图像的正对数量可能不同,文章提出使用sigmoid loss作为训练损失函数。这种损失函数允许每个样本的正对数量动态变化,且对挖掘过程中的潜在错误具有鲁棒性。

文章展示了FFF方法在图像识别(在11个数据集上平均提高了约6%)和图像检索(在Flickr30k上提高了约19%,在MSCOCO上提高了约15%)方面的显著性能提升。总之,FFF方法通过解决负对分配错误和提升字幕质量与多样性,显著提高了视觉-语言模型的预训练效果,并通过使用sigmoid loss作为训练损失函数,有效地利用了多个正对进行训练。

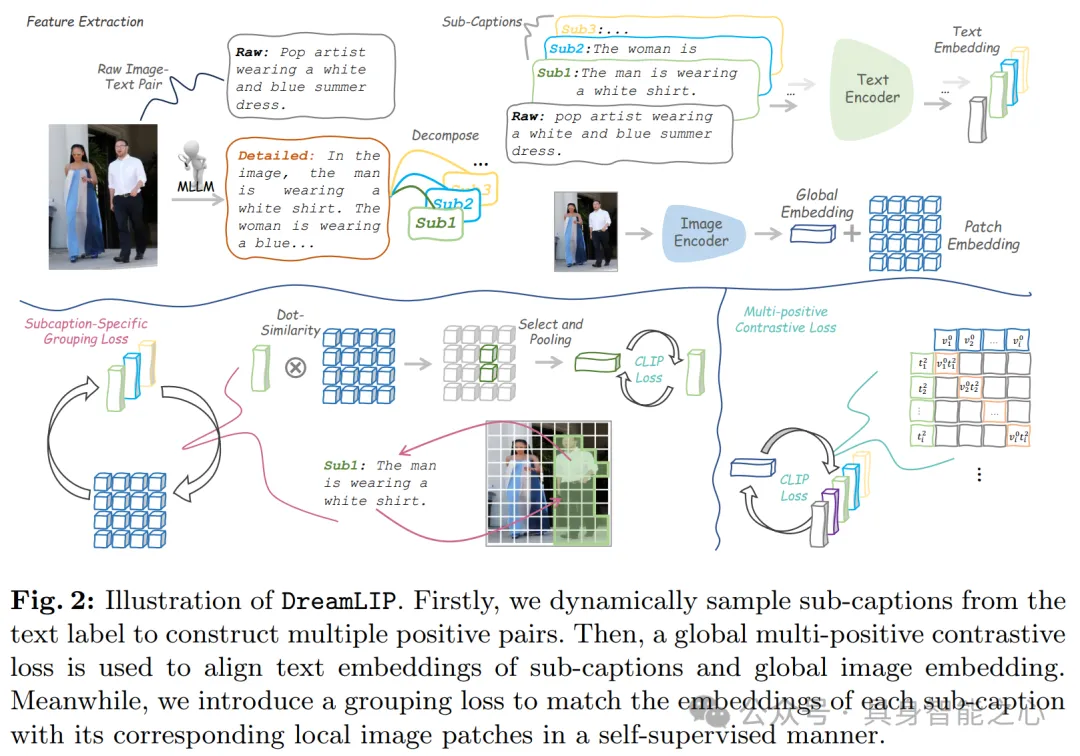

DreamLIP:带有长字幕的语言图像预训练

https://arxiv.org/abs/2403.17007

文章提出的DreamLIP模型实现了从长标题中动态采样子标题,并与图像的局部区域进行细粒度对齐。

- DreamLIP首先使用预训练的多模态大型语言模型(MLLM)为30M图像重新生成详细的描述性长标题,这些长标题比现有的数据集更丰富、更详尽。进而从长标题中动态采样子标题(subcaptions),以构建多个正对(positive pairs)。每个子标题可能描述图像的一个部分,例如一个物体或者场景的一个方面。引入分组损失来匹配每个子标题的文本嵌入与相应的局部图像块。这种损失函数在自我监督的方式下工作,意味着它不需要外部标注来指导子标题和图像块之间的对齐。

- 采用多正对对比学习框架(Multi-Positive Contrastive Learning),将文本嵌入与图像嵌入进行对齐,使得来自同一图像的多个子标题能够与图像的不同部分形成正对。通过分组损失实现细粒度对齐,确保每个子标题的文本特征与图像中相应的局部特征精确匹配,从而提高模型对图像细节的理解。将多正对对比损失和细粒度对齐损失结合起来,形成DreamLIP的整体训练目标函数,通过这个函数来优化模型。

在多种下游任务上进行实验,包括图像-文本检索、语义分割等,证明了DreamLIP模型相较于现有方法在细粒度表示能力上的一致优越性。通过这种方法,DreamLIP能够充分利用长标题中的信息,提高模型对图像内容的理解和表示能力,尤其是在零样本学习的场景下,展现出了强大的性能。

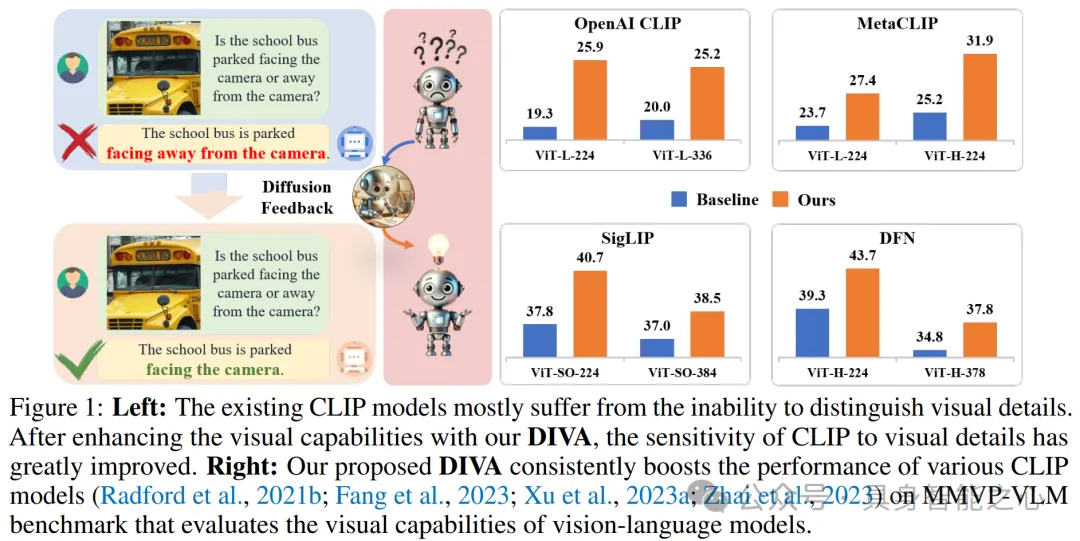

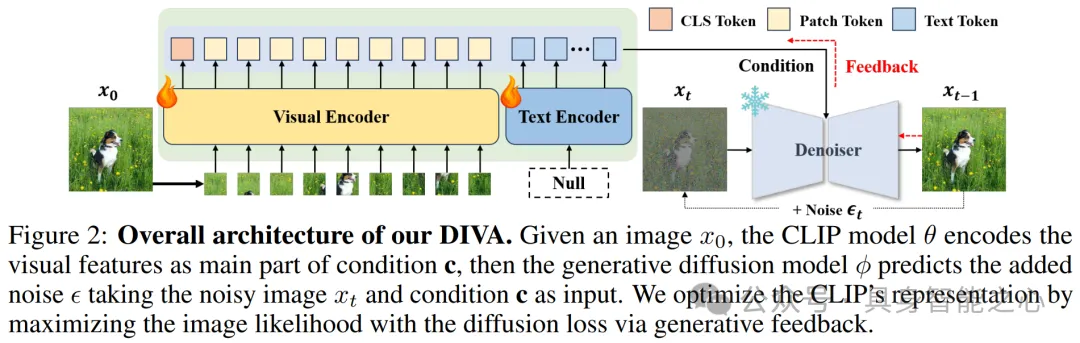

DIVA:扩散反馈帮助 CLIP 看得更清楚

https://arxiv.org/abs/2407.20171

对比语言-图像预训练 (CLIP) 擅长跨领域和模态抽象开放世界表示,已成为各种视觉和多模态任务的基础。然而,最近的研究表明,CLIP存在严重的视觉缺陷,例如几乎无法区分方向、数量、颜色、结构等。这些视觉缺陷也限制了基于 CLIP 构建的多模态大型语言模型 (MLLM) 的感知能力。主要原因可能是用于训练 CLIP 的图像-文本对具有固有的偏见,因为缺乏文本的独特性和图像的多样性。这项工作提出了一种简单的CLIP模型后训练方法,该方法通过自监督扩散过程在很大程度上克服了其视觉缺陷。我们介绍了 DIVA,它使用 DIffusion 模型作为 CLIP 的视觉助手。具体来说,DIVA利用来自文本到图像扩散模型的生成反馈来优化CLIP的表征,仅使用图像(没有相应的文本),从而实现了自监督学习。

- DIVA使用一个预训练的条件扩散模型,该模型能够根据条件生成详细的图像。扩散模型通过一个逐步添加高斯噪声的过程来学习图像的概率分布,这个过程可以逆转,从而从噪声中重建图像。DIVA利用文本到图像扩散模型的生成能力,将CLIP模型编码的视觉特征作为扩散模型的条件输入。这意味着CLIP的视觉特征被用来指导扩散模型生成图像。通过最大化图像似然度,使用扩散损失来优化CLIP模型的表示。具体来说,扩散模型尝试预测每一步中添加的噪声,并通过这种方式来优化CLIP的权重,使其学习到更丰富的视觉细节。

- DIVA引入了一种视觉密集重述策略(Visual Dense Recap Scheme),通过结合局部区域的视觉特征(patch tokens)和类别标记(class token)来增强条件信息的丰富性,从而提高CLIP模型的优化能力。

- 尽管进行了优化,DIVA框架仍然保持了CLIP模型原有的零样本(zero-shot)能力,在多种图像分类和检索基准测试中表现出色。

通过在MMVP-VLM基准测试上的实验,DIVA显著提升了CLIP模型在细粒度视觉能力上的表现,并在多模态理解和分割任务上提高了MLLMs和视觉模型的性能。总的来说,DIVA模型通过一个简单而有效的自监督框架,使用扩散模型的生成反馈来优化CLIP的视觉表示,使其在视觉细节的感知上有了显著的提升,同时保留了CLIP的原有优势。

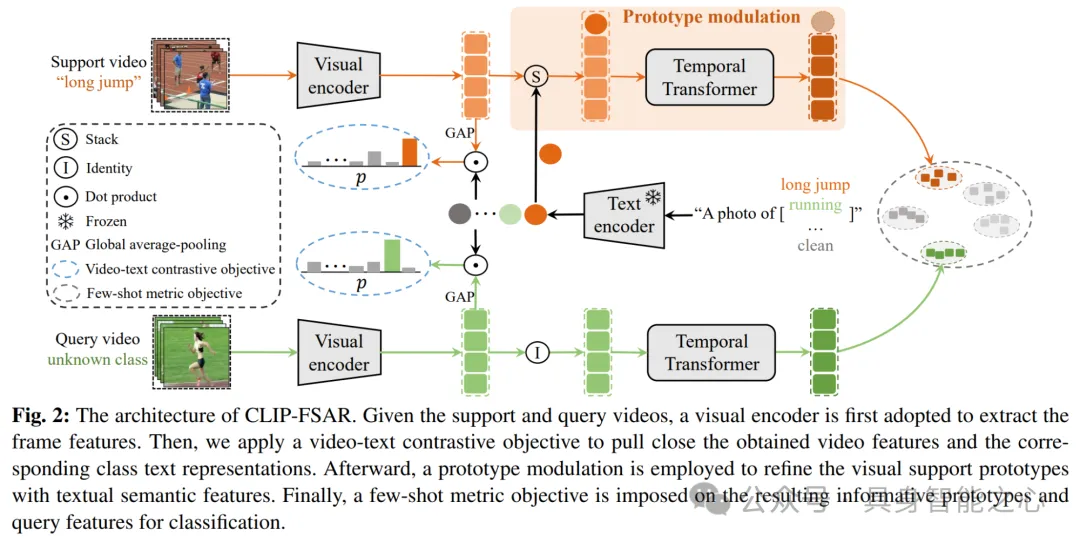

CLIP-FSAR:小样本动作识别的原型调制方法

https://arxiv.org/abs/2303.02982

本文的目标是迁移CLIP强大的多模态知识,以解决由于数据稀缺而导致的原型估计不准确的问题,这是少样本动作识别(Few-shot Action Recognition, FSAR)中一个关键问题。文章提出了一种名为CLIP-FSAR的原型调制框架,该框架由两个关键组件组成:视频-文本对比物镜(Video-text Contrastive Objective)和原型调制(Prototype Modulation)。

- 视频-文本对比物镜的目的是缩小CLIP和少样本视频任务之间的差异。通过对比视频特征和对应的类别文本描述,框架能够学习如何将视频内容与文本描述相匹配。使用CLIP的视觉编码器(Visual Encoder)提取视频帧的特征,同时使用文本编码器(Text Encoder)提取文本描述的特征。然后通过全局平均池化(Global Average Pooling, GAP)和余弦相似度函数来计算视频特征和文本特征之间的匹配概率。最后应用交叉熵损失函数来优化视频-文本匹配概率,使得匹配对的相似度最大化,不匹配对的相似度最小化。

- 原型调制是为了解决少样本情况下视觉信息不足导致的原型估计不准确问题,原型调制组件利用CLIP中的文本语义先验来优化视觉原型。首先在支持集(Support Set)的视觉特征基础上,将文本特征沿时间维度堆叠,并使用时间Transformer来自适应地融合文本和视觉特征。时间Transformer能够处理支持视频和查询视频的特征,使得融合后的特征在共同的特征空间中进行匹配,以计算查询视频与支持视频之间的距离。采用动态时间规整(Dynamic Time Warping, DTW)或其他时间对齐度量来计算查询视频和支持视频之间的距离,并通过少数样本度量目标(Few-shot Metric Objective)来进行分类。

CLIP-FSAR框架通过这两个组件的协同工作,能够充分利用CLIP模型中的丰富语义信息,生成可靠原型,并在少样本分类任务中实现精确分类。通过视频-文本对比物镜,CLIP-FSAR适应于视频任务,并通过原型调制增强了对视频中动作类别的识别能力。

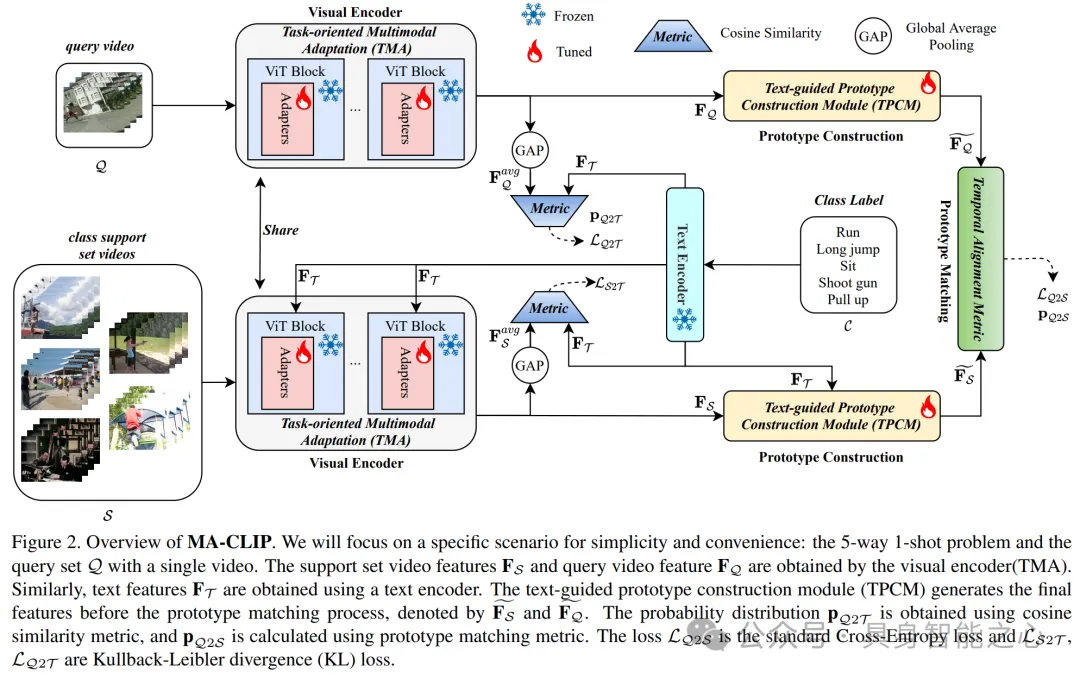

MA-CLIP:CLIP的多模态自适应用于小样本动作识别

https://arxiv.org/abs/2308.01532

将大规模预训练的视觉模型(如 CLIP)应用于小样本动作识别任务可以提高性能和效率。利用“预训练,微调”范式可以避免从头开始训练网络,这可能既耗时又耗费资源。但是,这种方法有两个缺点。首先,用于小样本动作识别的标记样本有限,因此需要尽量减少可调参数的数量以减轻过拟合,这也会导致微调不足,从而增加资源消耗并可能破坏模型的广义表示。其次,视频的超时域维度挑战了小样本识别的有效时间建模,而预训练的视觉模型通常是图像模型。为了解决这些问题,本文提出了一种名为CLIP多模态适应(MA-CLIP, Multimodal Adaptation of CLIP)的新方法。

- 轻量级适配器(Lightweight Adapters)被添加到CLIP模型中,目的是最小化可学习的参数数量,从而减少过拟合的风险,并允许模型快速适应新任务。适配器的设计允许它们结合视频和文本信息,进行面向任务的时空建模。MA-CLIP利用视频的时空信息和文本的语义信息,通过适配器进行有效的多模态信息融合。这种融合方法可以提高模型对动作类别的识别能力,尤其是在小样本学习场景下。

- 模型不仅关注视频帧内的空间特征,还关注帧之间的时间关系,这对于理解动作的发展和变化至关重要。面向任务的时空建模(Task-oriented Spatiotemporal Modeling)使得MA-CLIP能够捕捉到动作的本质特征,提高识别的准确性。

- 文本引导的原型构建模块(TPCM, Text-guided Prototype Construction Module)基于注意力机制设计,用于增强视频原型的表示。通过利用文本描述,TPCM能够更好地理解视频内容,从而提高类别原型的质量,这对于小样本学习中的类别匹配和识别非常关键。

MA-CLIP设计为可以与任何不同的小样本动作识别时间对齐度量(如视频匹配器)一起使用,这增加了模型的通用性和灵活性。由于适配器的轻量级特性和参数数量的减少,MA-CLIP在训练时更加快速和高效,同时降低了训练成本。总的来说,MA-CLIP通过精心设计的适配器和文本引导的原型构建模块,有效地结合了视觉和语言信息,提高了小样本动作识别的性能,同时保持了模型的快速适应性和低训练成本。

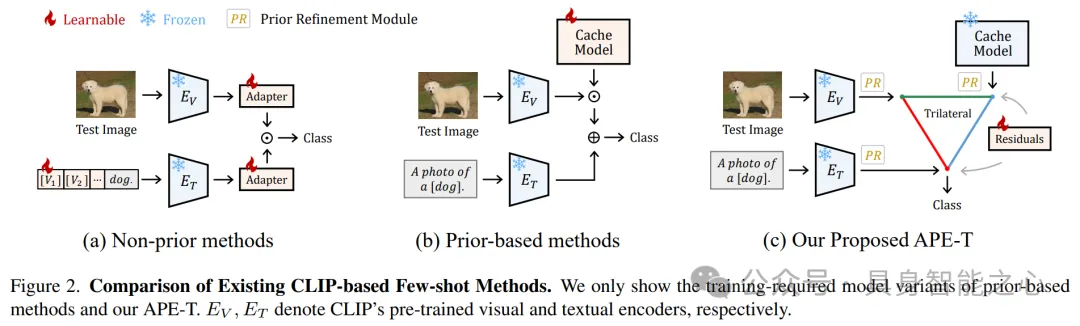

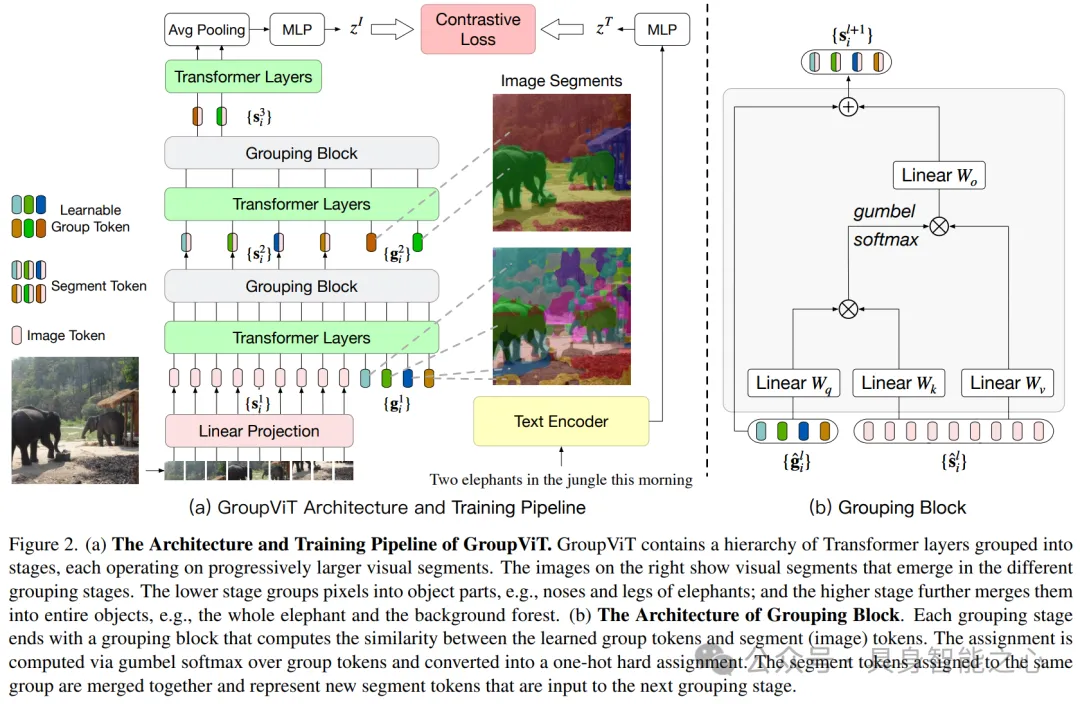

APE:并非所有特征都重要:通过自适应先验优化增强CLIP的少样本泛化能力

https://arxiv.org/abs/2304.01195

现有的CLIP少样本泛化方法要么表现出有限的性能,要么存在过多的可学习参数。本文提出了 APE(Adaptive Prior rEfinement),这是一种为CLIP模型的预训练知识进行适应性细化的方法,旨在提高CLIP在下游任务中的性能,特别是在小样本学习场景下。

- APE通过先验细化模块(Prior Refinement Module)分析下游数据中的类间差异性,目的是将领域特定的知识与CLIP模型中已经提取的缓存模型进行解耦,从而选择最有意义的特征通道。利用两个标准——类间相似度(inter-class similarity)和方差(variance)——来选择最具区分性的特征通道,减少冗余信息并降低缓存大小,以减少内存成本。

- APE提供了两种模型变体:(1)无需训练的APE(Training-free APE):直接利用细化后的缓存模型进行推理,探索测试图像、细化的缓存模型和文本表示之间的三边亲和性,实现无需训练的稳健识别。(2)需要训练的APE-T:在APE的基础上,增加了一个轻量级的类别残差模块(category-residual module),该模块只需对类别残差进行训练,而不需要对整个缓存模型进行昂贵的微调。这个模块进一步更新细化的缓存模型,并在模态之间共享以确保视觉-语言的对应关系。

- APE模型探索了测试图像、先验缓存模型和文本表示之间的三边关系,通过这种关系来增强小样本学习的性能。

APE和APE-T在保持高计算效率的同时,实现了在多个基准测试中的最先进性能,特别是在16次拍摄的ImageNet分类任务中,APE和APE-T分别以少于第二佳方法+1.59%和+1.99%的平均准确率,并且具有×30更少的可学习参数。