本文经自动驾驶之心公众号授权转载,转载请联系出处。

首先,推荐一篇启发我很多的综述和对应的项目地址(本文的封面图也来自该综述)

A Survey on Multimodal Large Language Models

arxiv.org/abs/2306.13549

Awesome-Multimodal-Large-Language-Models

github.com/BradyFU/Awesome-Multimodal-Large-Language-Models

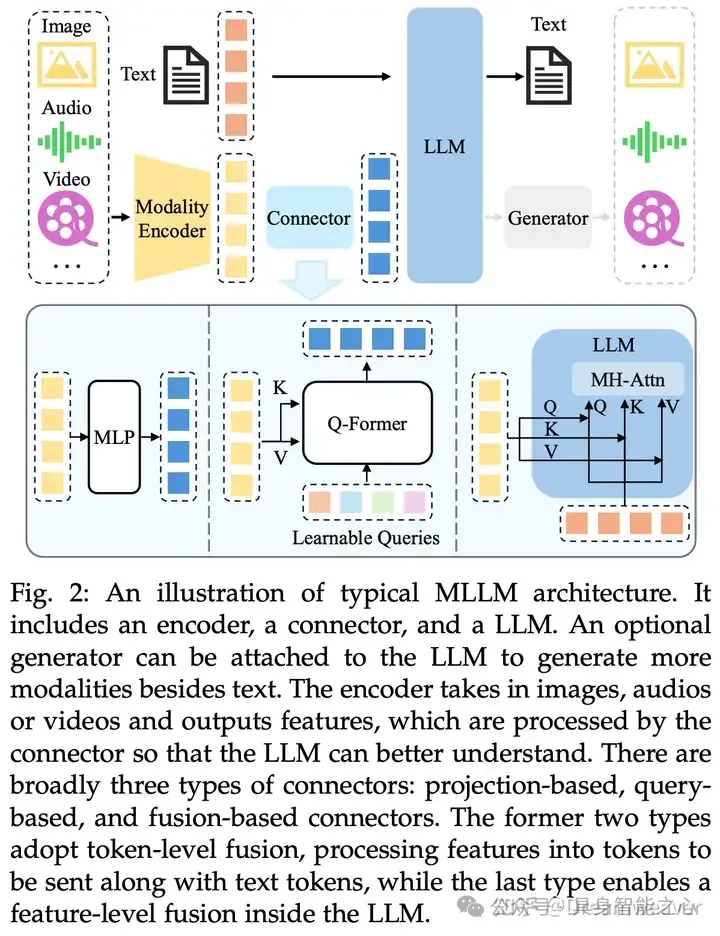

这篇综述一张图总结了多模态LLM的典型架构:

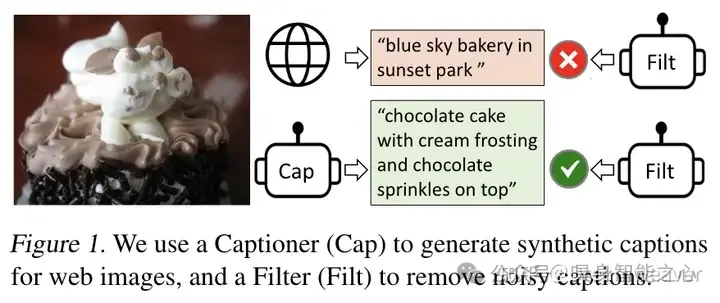

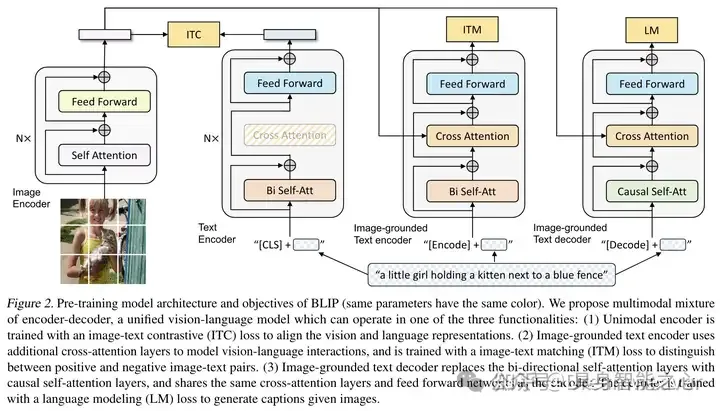

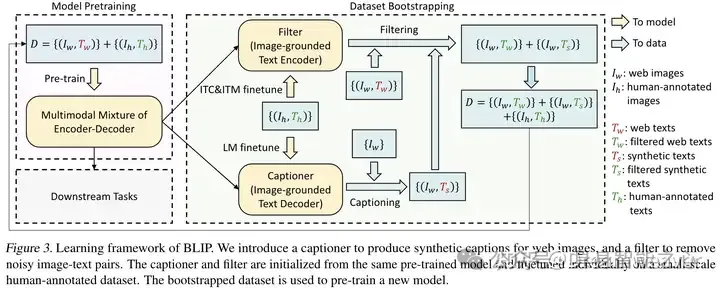

BLIP

【2022.01发布】https://arxiv.org/abs/2201.12086

统一视觉-语言理解和生成,使用captioner+filter高效利用互联网有噪数据

模型架构:

- Image/text encoder: ITC loss对齐视觉和语言表征,基于ALBEF提出的momentum distillation

- Image-grounded text encoder: ITM loss建模视觉-语言交互,区分positive/negative图文对,使用hard negative mining挖掘更高相似度的负例优化模型

- Image-grounded text decoder: LM loss实现基于图像的文本解码,将双向self-attention替换为causal self-attention

BLIP的bootstrapping训练过程:

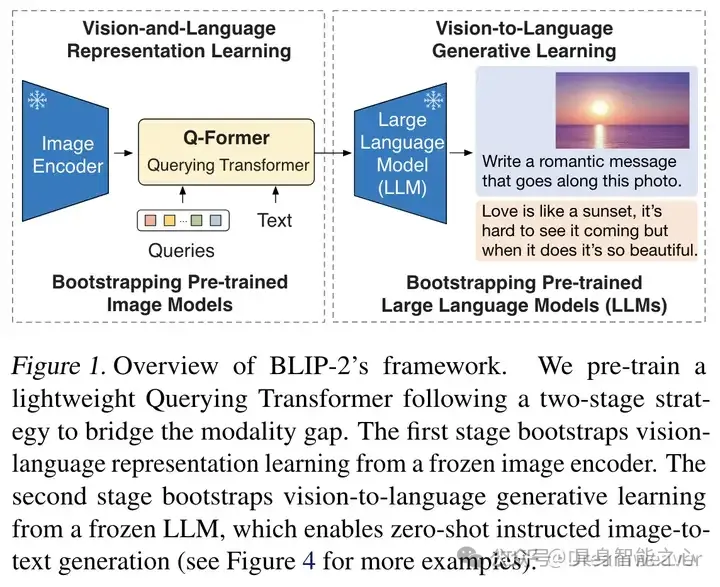

BLIP-2

【2023.01发布】https://arxiv.org/abs/2301.12597

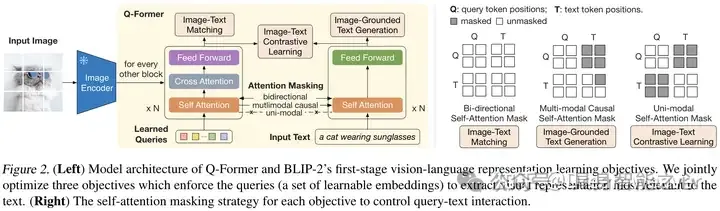

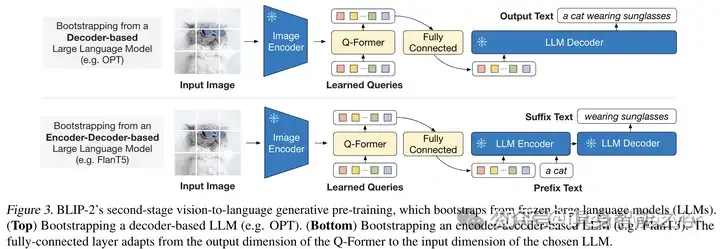

使用相对轻量的Q-Former连接视觉-语言模态,通过两阶段训练:第1阶段基于冻住的视觉编码器,第2阶段基于冻住的LLM

第1阶段:同样优化ITC/ITM/LM loss,使用不同的self-attention mask,query和text端共享self-attention参数,使得可学习的query embedding提取与text语义最相关的视觉表征;使用BERT-base初始化,32个768维的query作为信息瓶颈

- ITC:计算每个query与text的相似度,取最大的;使用batch内negatives,不再使用momentum queue

- ITM:对每个query与text的分类logits取平均,使用hard negatives mining挖掘难负例

- LM:text token和frozen image encoder不能直接交互,要求query能提取有益的视觉特征

第2阶段:可基于decoder-only/encoder-decoder LLM进行适配,FC层对齐维度

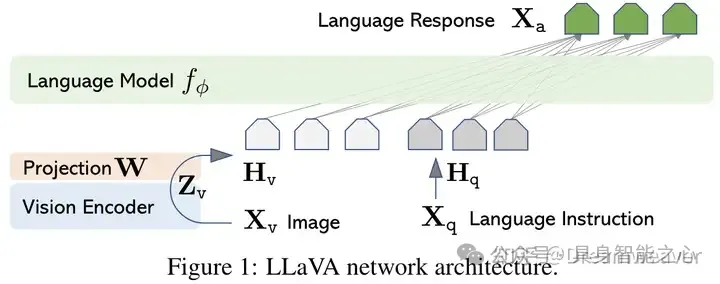

LLaVA

【2023.04发布】https://arxiv.org/abs/2304.08485

- 使用仅文本模态的GPT-4生成视觉-语言指令遵循数据,用于微调多模态LLM

- 使用图片的dense captions和bounding boxes作为prompt,可以生成对话、细节描述、复杂推理等指令

- CLIP ViT-L/14 + Vicuna,使用简单的线性层进行映射

- 更复杂的:Flamingo中gated cross-attention,BLIP-2中的Q-former

- LLaVA模型的两阶段训练

- stage1. 预训练特征对齐:冻住vision encoder和LLM,只训练projection,学习一个兼容的visual tokenizer

- stage2. 端到端微调:冻住vision encoder,在单轮/多轮对话数据上微调projection和LLM

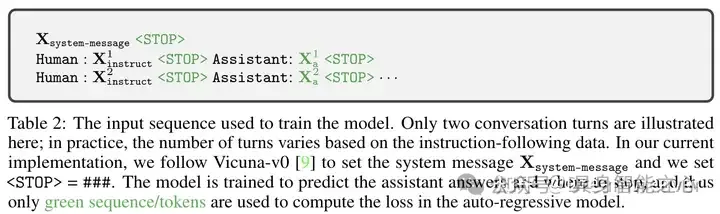

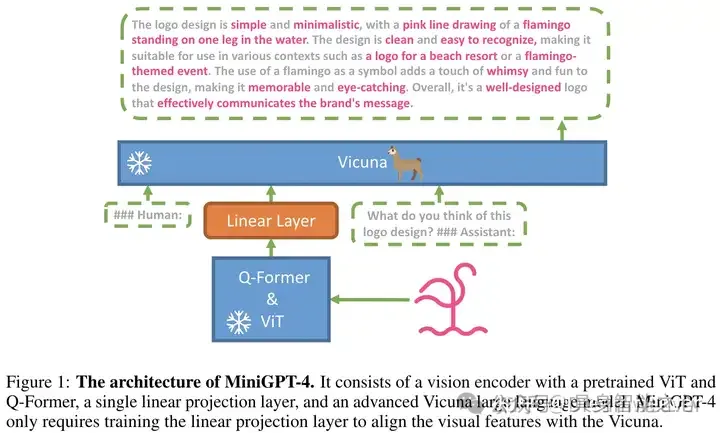

MiniGPT-4

【2023.04发布】https://arxiv.org/abs/2304.10592

stage1. 预训练:使用image-text pair微调linear projection layer,vision encoder和LLM保持冻住

stage2. 指令微调:指令格式为:###Human:###Assistant:

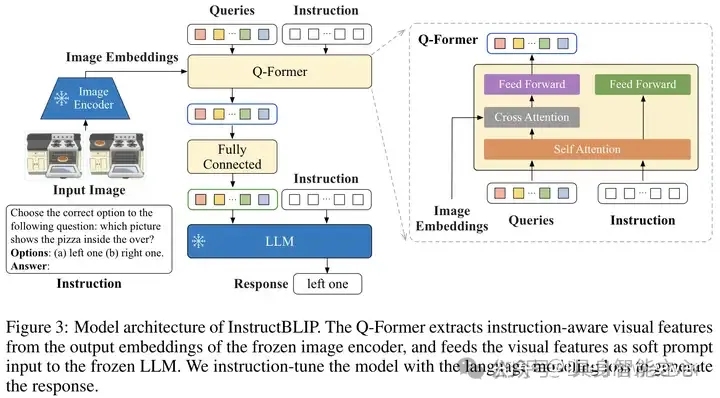

InstructBLIP

【2023.05发布】https://arxiv.org/abs/2305.06500

stage1. 预训练:BLIP-2(使用image-text pairs进行两阶段训练)

stage2. 指令微调:只微调instruction-aware Q-former,冻住vision encoder和LLM

支持FlanT5(encoder-decoder)和Vicuna(decoder-only)

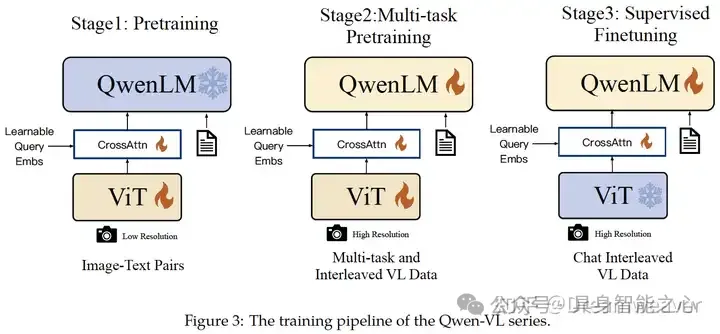

Qwen-VL

【2023.08发布】https://arxiv.org/abs/2308.12966

支持中英双语、多图像输入

Qwen-7B + OpenCLIP ViT-bigG,输入图像直接resize到视觉编码器输入

位置感知的VL adapter:使用基于Q-former的单层的cross-attention,将图像特征维度压缩到256,在query-key pairs中引入2D绝对位置编码增强位置信息

图像输入:256-dim图像特征

bounding box输入输出:(X_topleft, Y_topleft), (X_bottomright, Y_bottomright),…标记box所指内容

三阶段训练:

stage1. 预训练:基于大规模、弱标注、网络爬取的图像-文本对,输入分辨率224x224,冻住LLM,训练ViT和Q-former,主要目的是模态对齐

stage2. 多任务预训练:基于7种下游视觉-语言理解任务的高质量、细粒度标注数据训练,输入分辨率448x448,图像/文本数据交错,训练整个模型

stage3. 指令微调:提升指令遵循和多轮对话能力,冻住ViT,训练LLM和Q-former

Qwen-VL-Plus和Qwen-VL-Max提升了视觉推理能力、图像细节的识别/提取/分析能力(尤其是文本导向的任务)、支持高分辨率和极端纵横比的输入图像;在部分中文场景超过了GPT-4V和Gemini

InternLM-XComposer

【2023.09发布】https://arxiv.org/abs/2309.15112

交错图文构成:自动在输出文本中插入合适的图片

EVA-CLIP ViT + InternLM-7B + Q-former (将图像特征压缩到64个embedding)

两阶段训练:

stage1. 预训练:冻住ViT,训练LLM和Q-former

stage2. 监督微调:包括多任务训练和指令微调,冻住ViT和LLM,训练Q-former,对LLM进行LoRA微调,增强指令遵循和图文混排能力

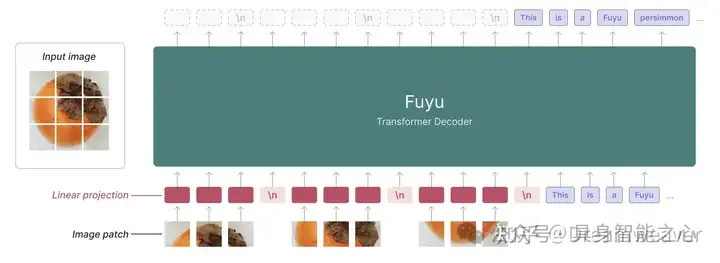

Fuyu-8B

【2023.10发布】https://huggingface.co/adept/fuyu-8b

模型架构和训练过程简单,易于scaling;支持任意图像分辨率;推理速度快

decoder-only的transformer,没有专门的图像编码器;image patch直接线性映射到transformer第一层

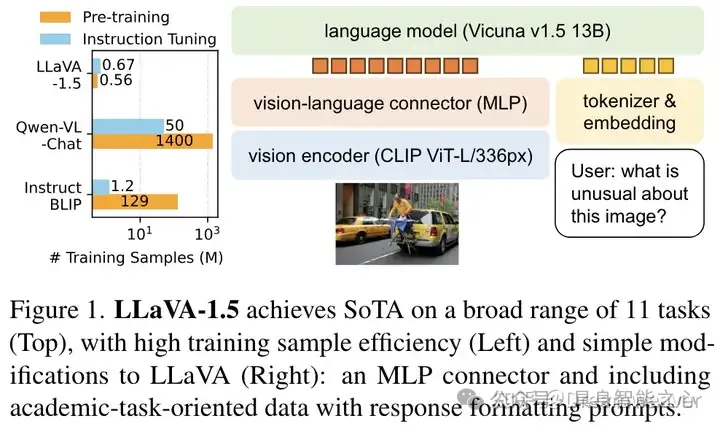

LLaVA-1.5

【2023.10发布】https://arxiv.org/abs/2310.03744

仍使用MLP作为模态连接,突出了训练的数据高效性

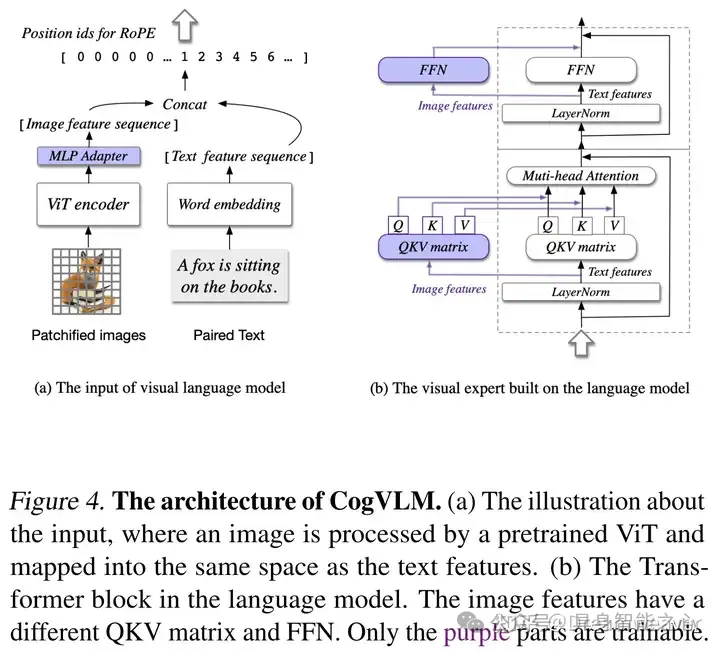

CogVLM

【2023.11发布】https://arxiv.org/abs/2311.03079

深度视觉-语言模态融合,而不影响LLM原有的语言能力:冻住LLM和ViT,在attention和FFN层训练一份视觉专家模块

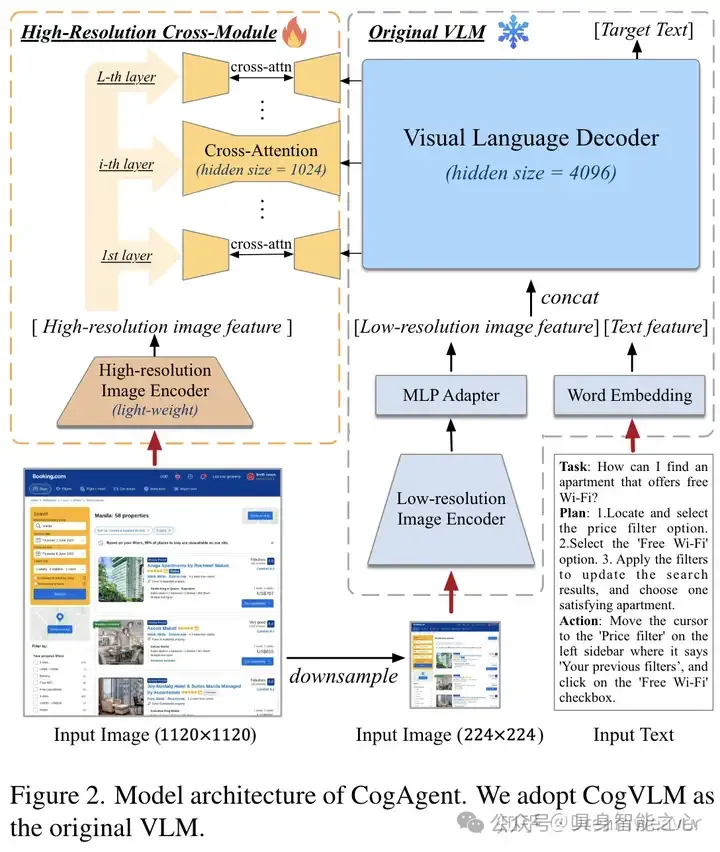

CogAgent

【2023.12发布】https://arxiv.org/abs/2312.08914

针对GUI场景的多模态理解和导引,使用高分辨率-低分辨率双编码器,支持1120x1120的屏幕输入

高分辨率分支使用更轻量的ViT,基于cross-attention将高分辨率图像特征与LLM每层进行融合

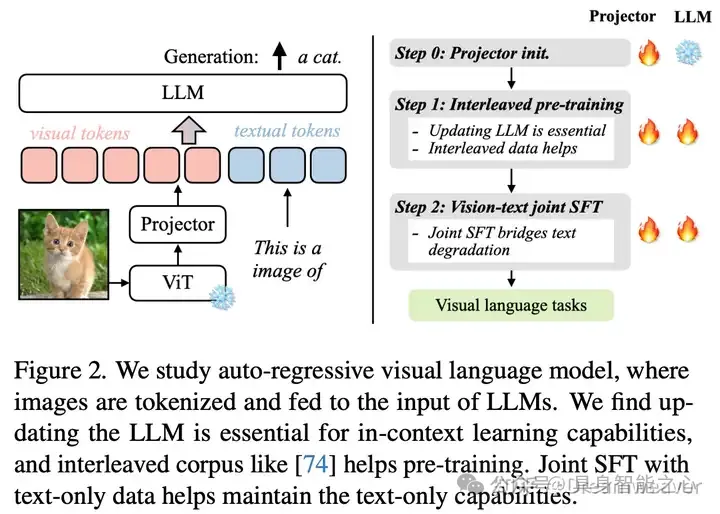

VILA

【2023.12发布】https://arxiv.org/abs/2312.07533

探索了视觉-语言模型训练的设计选择:

- 预训练阶段冻住LLM虽然能取得较好的zero-shot性能,但上下文学习能力依赖对LLM的微调

- 图文交错的预训练数据是有益的,只用图文数据对效果不够好

- 将纯文本的指令微调数据加入SFT阶段有助于缓解纯文本任务的能力退化,同时也能够增强视觉-语言任务的准确性

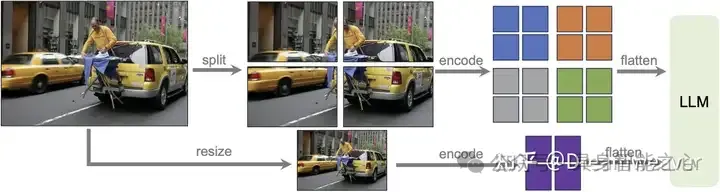

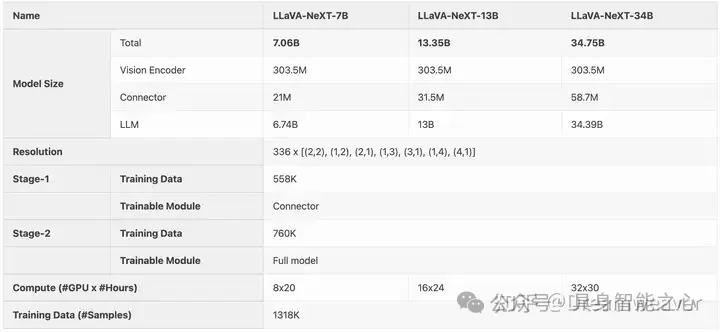

LLaVA-Next

【2024.01发布】https://llava-vl.github.io/blog/2024-01-30-llava-next/

相对于LLaVA-1.5,保持了极简的设计和数据高效性:

- 提高了输入图像的分辨率 (4x),支持3种纵横比:672x672, 336x1344, 1344x336

- 更好的视觉推理和OCR能力:更好的指令微调数据配比

- 更好的多场景视觉对话:更好的世界知识和逻辑推理

- 更高效的部署和推理:SGLang

动态高分辨率:视觉编码器支持336x336的图像输入,对于672x672的图像,按照{2,2}的grid split成4个图像patch过encoder,downsample到336x336也过encoder,特征拼接作为visual tokens输入到LLM中

收集高质量用户数据,包括真实场景中反映用户更广泛意图的指令数据,利用GPT-4V进行数据构造

多模态文档/图表数据,增强文档OCR和图表理解能力

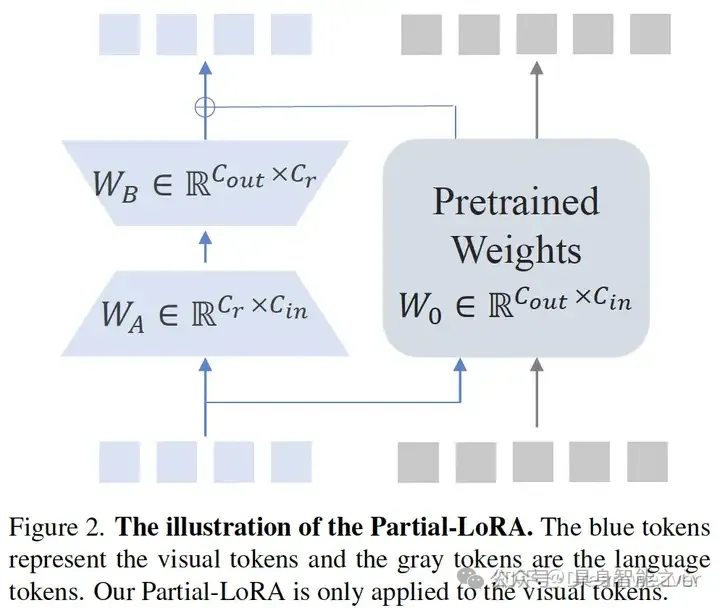

InternLM-XComposer2

【2024.01发布】https://arxiv.org/abs/2401.16420

提出了新的模态对齐方法partial LoRA:只在image token上添加LoRA参数,保证预训练语言知识的完整性,这样一个更轻量的视觉编码器同样有效

OpenAI CLIP ViT-L/14 + InternLM2-7B + partial LoRA (rank=256)

两阶段训练:

stage1. 预训练:冻住LLM,微调ViT和partial LoRA模块,包括通用语义对齐(理解图像基本内容)、世界知识对齐(进行复杂的知识推理)、视觉能力增强(OCR、物体定位、图表理解)

stage2. 监督微调:微调整个模型,包括多任务训练、自由形式图文排布

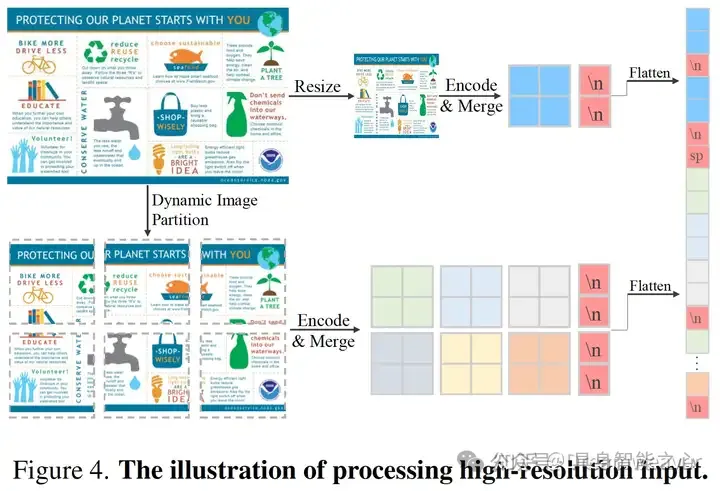

InternLM-XComposer2-4KHD

2024.04发布了4KHD版本:https://arxiv.org/abs/2404.06512

支持动态分辨率(336px → 4K (3840x1600)):改进了patch division范式,保持训练图像原有的纵横比,自动变化patch数目,基于336x336的ViT配置layout

动态图像划分:将输入图像resize and pad到336的整数倍宽高

结合图像的global和local视角:global视角由输入直接resize到336x336,使用sep token分隔两种视角的token

图像2D结构的换行符:可学习的\n token分隔图像token行

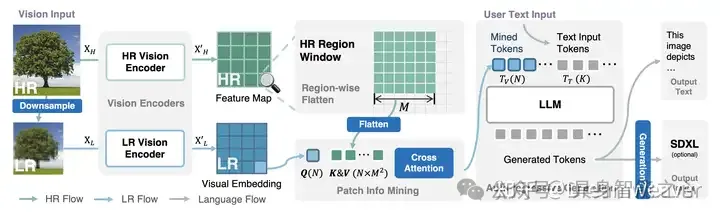

Mini-Gemini

【2024.03发布】https://arxiv.org/abs/2403.18814

使用双视觉编码器提取低分辨率embedding作为query,高分辨率特征区域作为key/value,两者之间做cross-attention,输出挖掘的tokens作为prompt前缀,输入到LLM做推理,外接图像解码器生成图像(SDXL)