本文经自动驾驶之心公众号授权转载,转载请联系出处。

原标题:Ray Denoising: Depth-aware Hard Negative Sampling for Multi-view 3D Object Detection

论文链接:https://arxiv.org/pdf/2402.03634

代码链接:https://github.com/LiewFeng/RayDN

作者单位:中国科学院大学 Mach Drive

论文思路:

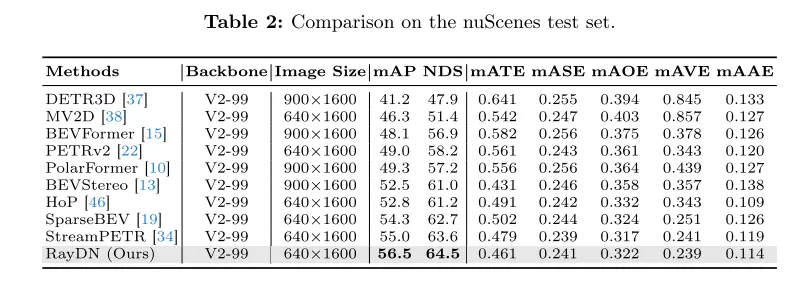

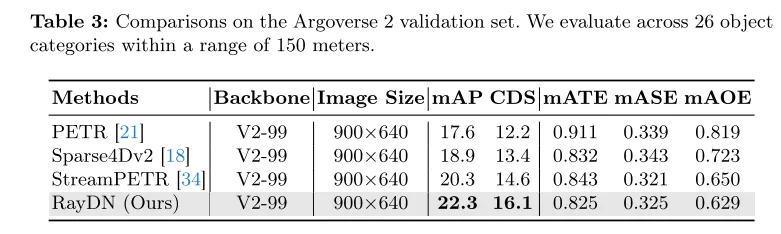

多视角3D目标检测系统由于图像深度估计的挑战,常常难以生成精确的预测,导致冗余和错误检测的增加。本文提出了一种创新方法— Ray Denoising ,通过沿着相机射线进行战略性采样来构建困难负样本,从而提高检测精度。这些负样本在视觉上难以与真正的正样本区分,使模型被迫学习深度感知特征,从而增强其区分真阳性和假阳性的能力。Ray Denoising 设计为一个即插即用的模块,兼容于任何DETR风格的多视角3D检测器,并且只在训练时增加了极少的计算成本,而不影响推理速度。本文的综合实验,包括详细的消融研究,一致表明 Ray Denoising 在多个数据集上均优于强基线方法。在NuScenes数据集上,相较于最先进的StreamPETR方法,它在 mAP 上提升了1.9%。在Argoverse 2数据集上也显示出显著的性能提升,突显了其良好的泛化能力。

主要贡献:

本文识别了沿同一射线的误检这一持续存在的挑战,这成为多视角3D目标检测器性能的瓶颈。

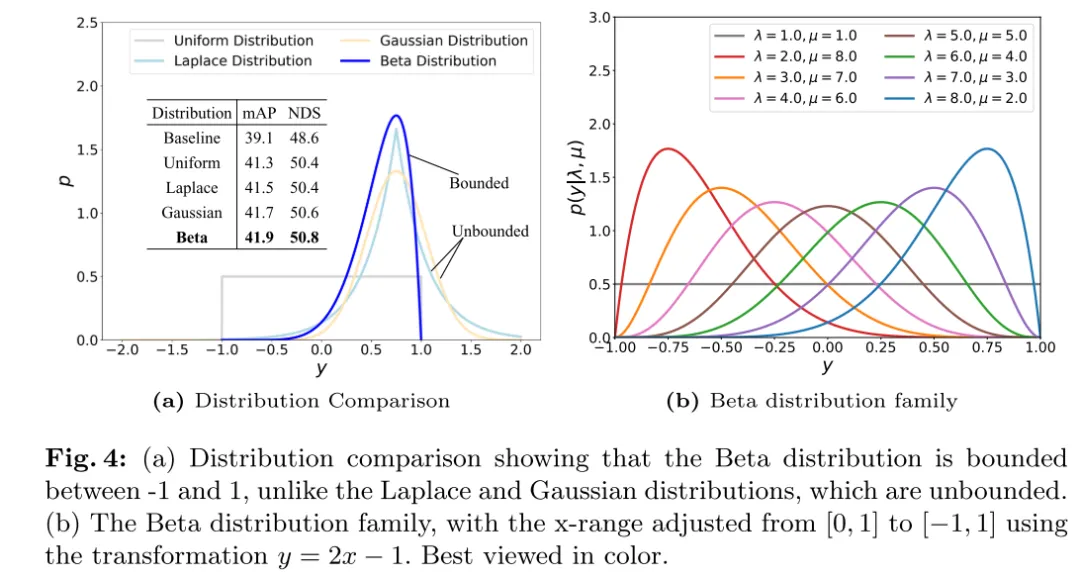

本文引入了 Ray Denoising ,这是一种新颖的去噪方法,利用Beta分布在射线方向上创建深度感知的困难负样本。该方法明确考虑了场景的3D结构,提供了一种灵活的解决方案,兼容任何DETR风格的多视角3D检测器,以解决沿射线的重复预测问题。

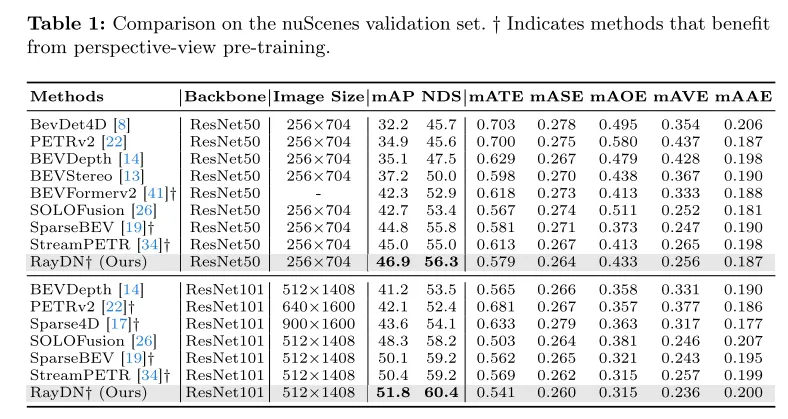

本文的方法在NuScenes数据集 [2] 上达到了最先进的结果,显著提升了多视角3D目标检测器的性能。具体来说,本文在 mAP 上相较于当前最先进的方法StreamPETR提升了1.9%,从而证明了 Ray Denoising 的有效性。

论文设计:

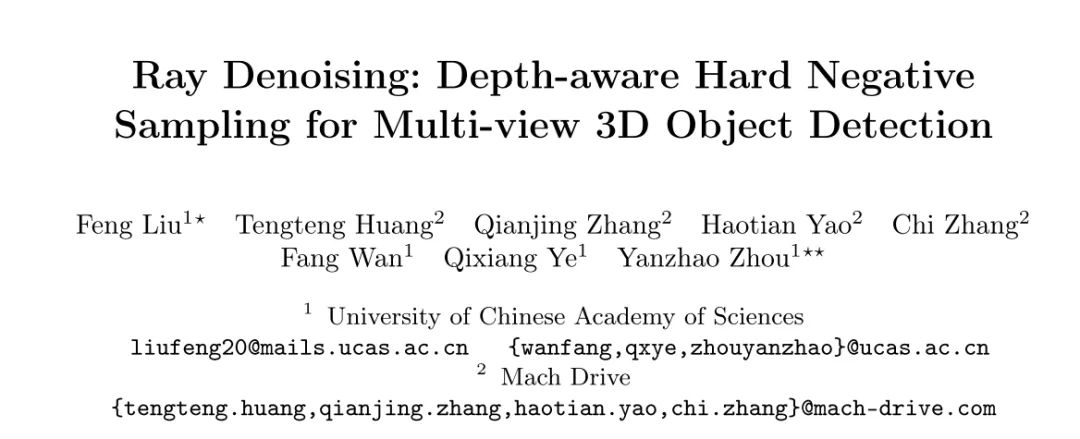

3D目标检测是自动驾驶系统中的关键组件,因而引起了计算机视觉领域的广泛关注。相比于基于LiDAR的解决方案,基于图像的3D目标检测由于其成本效益正经历着研究热潮 [9, 10, 13, 14, 37, 38]。在依赖于周围相机图像的多视角3D目标检测中,一个主要挑战是从图像中估计深度的难度,这会导致重复预测,如图1所示。

尽管在方法上有所改进,多视角3D目标检测器在减少由深度模糊引起的误检方面仍面临困难。近期的几项研究 [8, 15, 17, 19, 22, 26, 34, 41, 46] 试图通过引入时间信息来解决这一问题。然而,这些方法并未明确考虑场景的3D结构,从而限制了其进一步提升的潜力。

此外,先前的研究还探索了应用诸如非极大值抑制(Non-Maximum Suppression, NMS)和 Focal Loss 等通用技术来缓解重复预测问题。NMS作为一种后处理技术,主要针对具有高交并比(IoU)的误检,但当这些预测沿射线分散且IoU较低时,其效果不佳。Focal Loss 作为一种旨在减少高置信度误检的损失函数也被应用。然而,观察发现,使用 Focal Loss 的多视角3D目标检测器在有效解决沿同一射线的误检问题时仍然面临挑战。

本文的定量分析强调了解决与真实值(Ground Truth)沿同一射线的误检的重要性。通过利用真实值目标的精确位置数据,本文能够在最先进的StreamPETR方法 [34] 中识别并消除这些冗余预测。这一过程显著提升了 mAP 5.4%,突显了模型提升深度估计能力的关键需求。这一显著的改进表明,通过优化深度估计来抑制这些误检,能够显著提升整体检测性能的潜力。

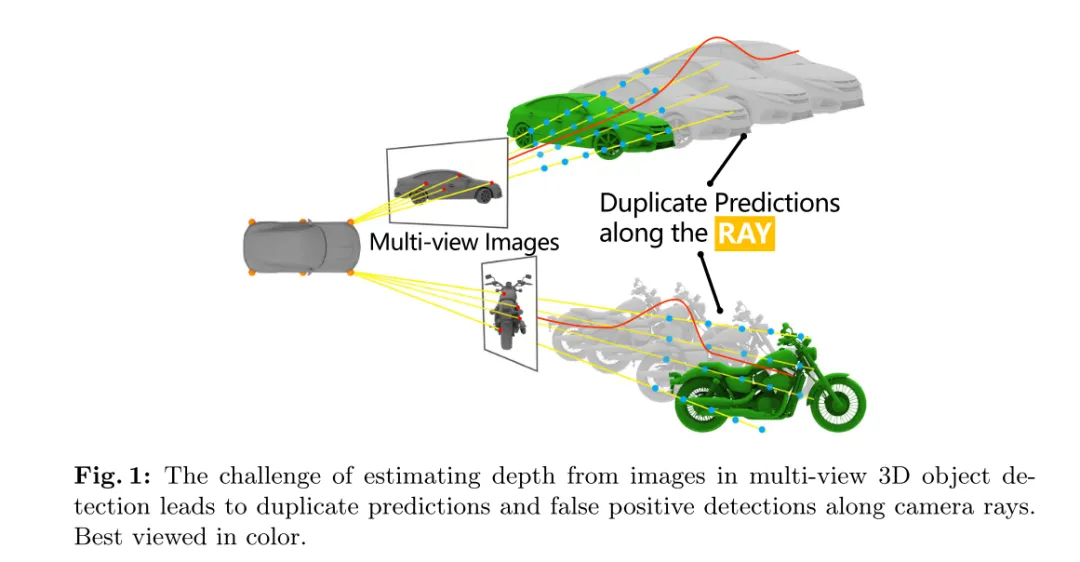

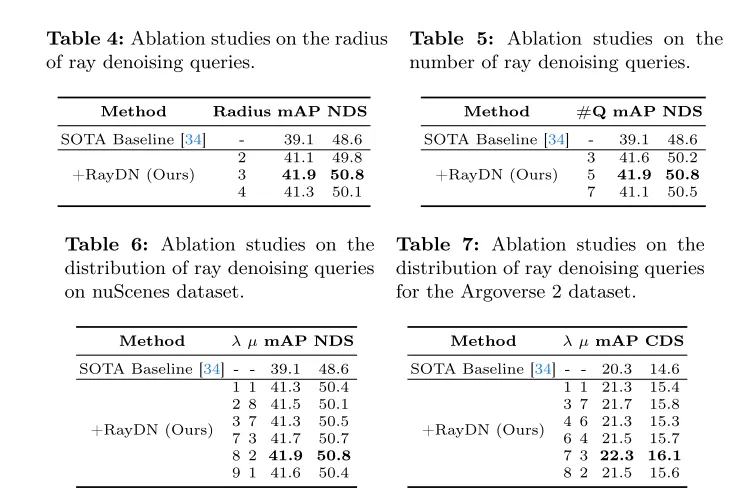

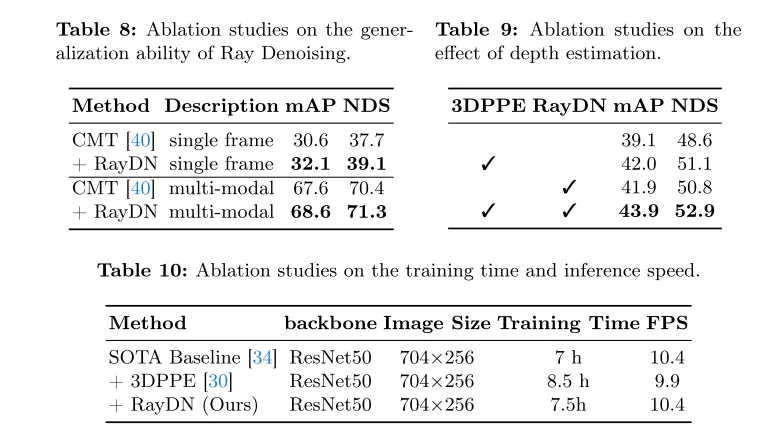

本文的关键观察是,由于传统多视角目标检测器的固有限制,误检常常沿着相机射线发生。由于每个像素的深度信息未能准确估计,位置嵌入只能编码射线方向。因此,同一射线上的查询将始终与图像中的相同视觉特征交互,导致沿该射线出现大量重复预测(误检)。这一情形突显了模型学习深度感知特征的需求,以便在视觉特征相同的情况下区分深度上的目标。本文提出了一种新方法,称为 Ray Denoising (简称RayDN)。该框架本质上具有灵活性,不限制用于采样深度感知困难负样本的分布选择。根据本文的消融研究,本文选择了Beta分布,因为它在捕捉模型可能生成的误检的空间分布方面表现出色。此选择使 Ray Denoising 能够创建用于去噪的深度感知困难负样本,从而增强模型学习更健壮特征和表征以区分沿射线的误检的能力,如图2所示。Ray Denoising 在训练阶段仅引入了极少的计算成本增加,而不会影响推理速度。

图1:在多视角3D目标检测中,从图像中估计深度的挑战导致沿相机射线的重复预测和误检。

图2:提出的 Ray Denoising 方法(右图)有效减少了在先前最先进方法StreamPETR [34](左图)中沿射线的误检(红色矩形高亮部分)。

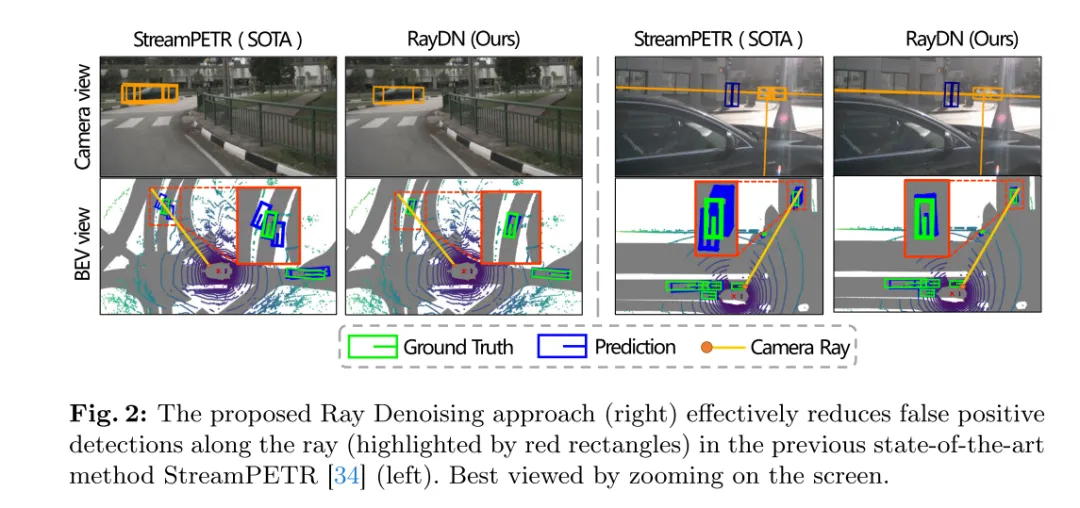

图3:Ray Denoising 方法的整体框架,这是一种即插即用的训练技术,适用于DETR风格的多视角3D目标检测器,重点在于提升模型区分深度中真阳性和假阳性的能力。通过投射射线和采样深度感知的去噪查询,有效解决了由于视觉深度估计固有困难而产生的误检问题,从而在检测性能上相较于强基线方法取得了显著提升。

讨论:

本文的 Ray Denoising (Ray Denoising)方法基于一个关键观察,即基于图像的3D检测系统往往难以区分沿相机射线的真阳性和假阳性。DETR风格的多视角3D目标检测器通过真实值监督隐式地学习深度估计。然而,可学习查询的随机分布参考点并未充分利用可用的真实值信息。尽管这些参考点在训练过程中会更新,但它们未能为每个场景中的每个目标提供足够的困难负样本。为了增强对真实值信息的利用,传统的去噪技术在训练期间引入了均匀分布在真实值目标周围的额外参考点。这些特定实例的参考点提高了检测性能 [19,22,34]。然而,它们忽视了多视角3D目标检测固有的深度模糊问题。由于每个像素缺乏精确的深度信息,位置嵌入只能编码射线方向,而不能编码深度。这导致同一射线上的查询与相同的图像特征交互,产生冗余预测。Ray Denoising 不同于传统技术,通过沿从相机到目标的射线战略性地生成参考点。这种方法明确考虑了场景中每个目标的3D结构,提供了足够数量的困难负样本。在训练过程中,这些 Ray Queries 在自注意力层中进行交互,有效引导模型抑制深度模糊的空间困难负样本。这种交互增强了检测器区分真阳性预测(目标)和假阳性预测(重复检测)的能力,从而提高了检测精度。

实验结果:

图4:(a) 分布比较显示,Beta分布在-1到1之间有界,而Laplace分布和高斯分布则是无界的。(b) Beta分布族,通过使用变换 将 x 范围从 调整到 。

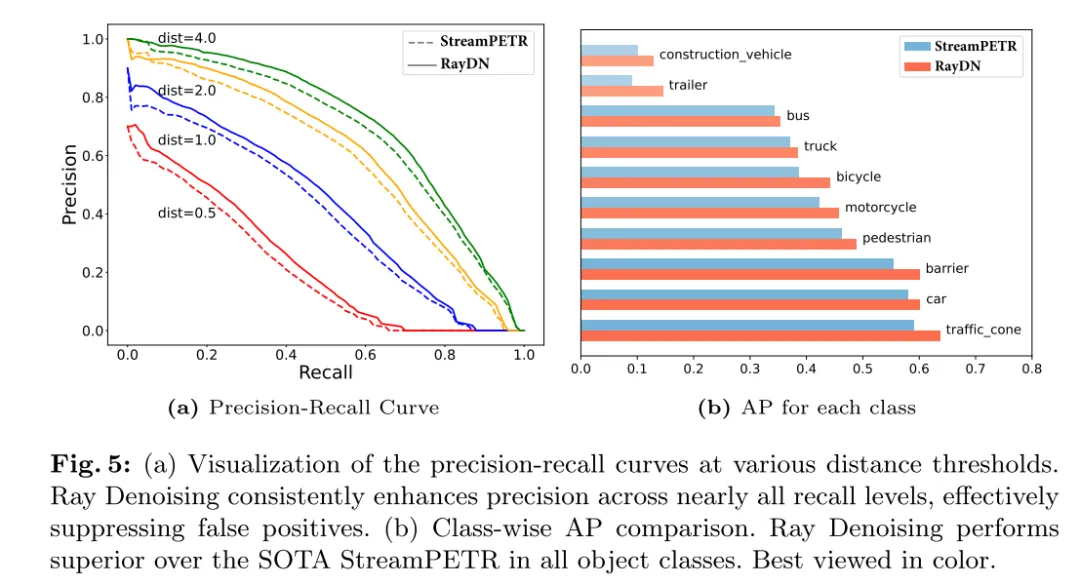

图5:(a) 不同距离阈值下的精确度-召回率(precision-recall)曲线可视化。Ray Denoising 在几乎所有召回率水平上均提升了精确度,有效抑制了误检。(b) 按类别的平均精度(AP)比较。Ray Denoising 在所有目标类别上均优于最先进的StreamPETR。

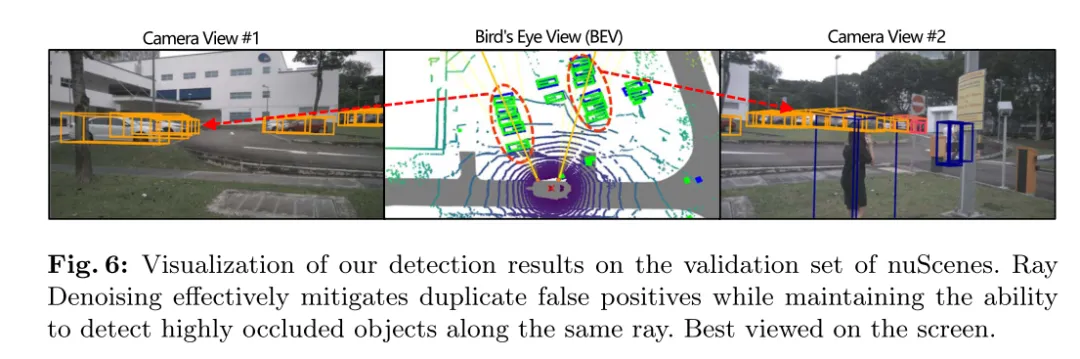

图6:本文在nuScenes验证集上的检测结果可视化。Ray Denoising 在有效减少重复误检的同时,保持了检测同一射线上的高度遮挡目标的能力。

总结:

本文引入了 Ray Denoising (Ray Denoising),这是一种旨在克服多视角3D目标检测中深度估计不准确这一关键挑战的方法。Ray Denoising 解决了沿相机射线发生的误检问题,这些误检是由于图像深度信息不精确直接导致的。通过利用场景的3D结构, Ray Denoising 促使模型学习深度感知特征,从而在不增加额外推理成本的情况下,提高了沿同一射线区分真阳性和假阳性的能力。本文在NuScenes和Argoverse 2数据集上的综合实验表明, Ray Denoising 始终显著优于强基线方法,在多视角3D目标检测中实现了新的最先进性能。