本文经自动驾驶之心公众号授权转载,转载请联系出处。

本文是对ECCV2024接受的文章 HTCL: 的介绍,HTCL在SemanticKITTI基准测试中超过了所有基于相机的方法,甚至在和OpenOccupancy基准测试中超过了LiDAR,实现了最先进的性能。代码已开源,欢迎大家试用和Star~

代码链接:https://github.com/Arlo0o/HTCL

论文链接:https://arxiv.org/abs/2407.02077

Demo video 展示:

我们对比了同样采用时序双目图像输入的VoxFormer-T,并用更少的输入帧数(3 vs. 4)取得了更好的预测效果,在场景整体布局、相机视野外区域、远距离动态物体等的预测中表现出明显优势。

Motivation

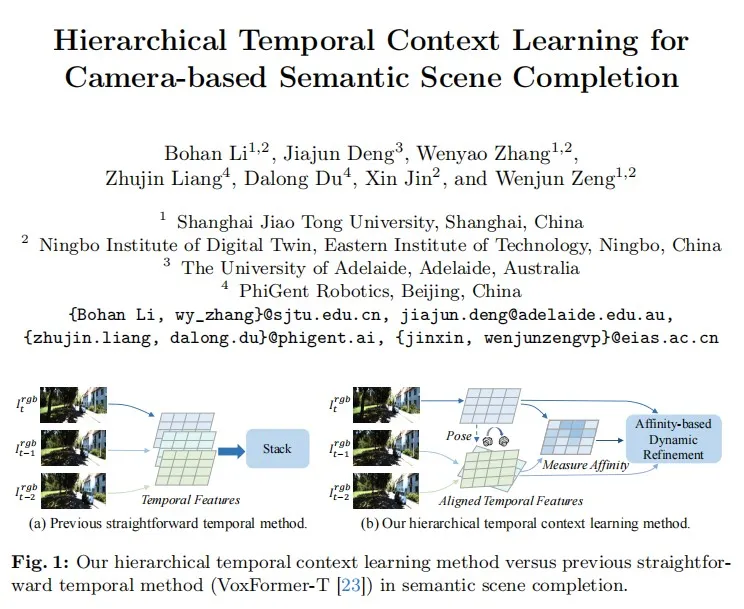

基于相机的三维语义场景补全(SSC)对于从有限的二维图像观测中预测复杂的三维场景信息至关重要。现有的主流解决方案通过对历史帧信息的粗略堆叠来试图补充当前视角下的不完整观测,这种简单的时序建模方式不可避免地减少了有效的视觉线索,增加了模型学习难度。

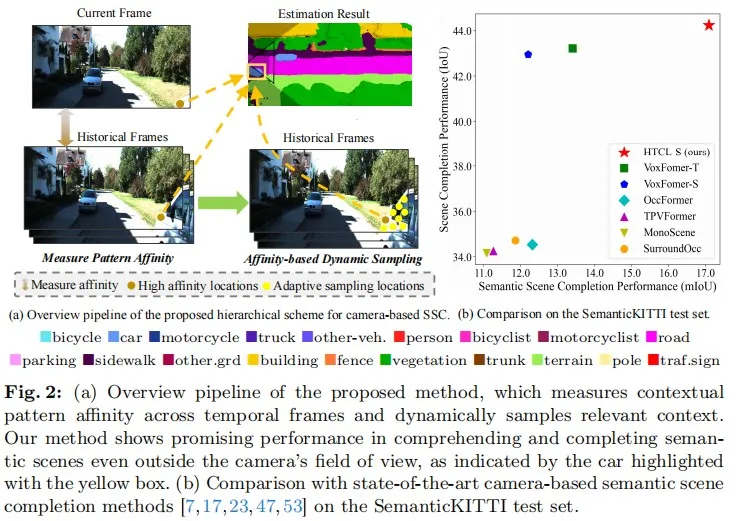

为了解决上述问题,我们提出了HTCL,一种新颖的分层时序上下文学习范式,用于改进基于相机的语义场景补全。HTCL将时序上下文学习分解为两个层次步骤:(a)跨帧亲和度测量;(b)基于亲和度的动态细化。首先,为了从冗余信息中分离关键相关上下文,我们提出了尺度感知隔离策略,用于构建多个独立的学习模块,进而建模细粒度上下文对应关系。随后,为了动态补偿不完整的观测结果,我们基于识别出的具有高亲和度特征的空间位置及其邻近的相关区域,自适应地细化特征采样位置。

Method

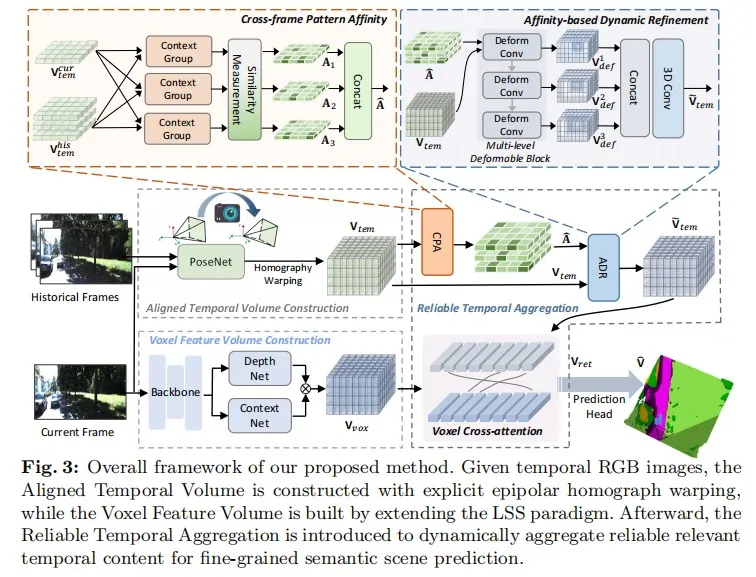

我们提出的分层时序上下文学习(HTCL)范式可以有效改进时序特征聚合的可靠性,从而实现精确的三维语义场景补全。HTCL从不同时间帧的RGB图像中分层地推断三维语义Occupancy,以实现细粒度的场景理解。如下图所示,我们提出的分层时时序下文建模包括两个顺序步骤:(1)显式地测量当前帧和历史帧之间的上下文特征亲和力,提取最相关的高亲和度特征;(2)基于高亲和力特征的空间位置及其附近的相关上下文自适应地细化采样位置,以动态补偿不完整的观测。HTCL在创新性方面主要做出了以下贡献:

- 提出了一种时序上下文学习范式,以用于动态和可靠的三维语义场景补全。

- 提出了一种具有尺度感知隔离和多个独立学习模块的亲和度测量策略,用于细粒度的上下文对应关系建模。

- 提出了一个基于亲和度的动态细化方案,以重新分配时序上下文信息,并自适应地补偿不完整的观测结果。

- HTCL在SemanticKITTI基准测试中超过了所有基于相机的方法,甚至在和OpenOccupancy基准测试中超过了LiDAR,实现了最先进的性能。

如上图所示,我们提出的方法整体框架主要由三个部分组成:Aligned Temporal Volume Construction,Voxel Feature Volume Construction,以及Reliable Temporal Aggregation。

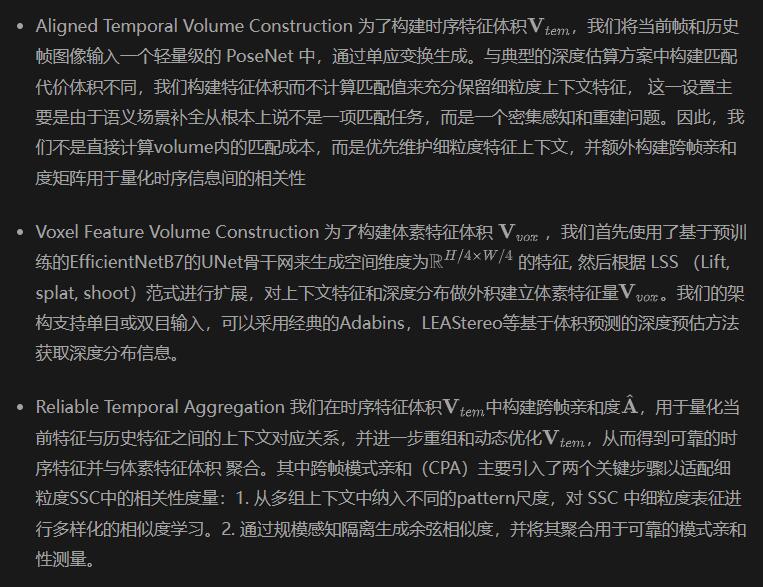

效果如下图所示,跨帧模式亲和(CPA)有效地表示了时间内容中的上下文对应关系。

鉴于我们的目标是完成并理解与当前帧相对应的三维场景,因此必须为最相关的位置分配更大的权重,同时也需要调查其邻近的相关区域以弥补不完整的观察结果。为此,我们提出基于亲和力的动态细化(ADR),根据已确定的高亲和性位置及其邻近相关区域,用三维可变形卷积自适应地改进特征采样位置。具体来说,我们通过引入基于亲和力的对应权重和可变形位置偏移来实现动态细化:

为了进一步通过分层上下文推理动态建模,我们通过考虑级联的不同特征层上下文信息 :

Experiment

实验表明,我们的方法在SemanticKITTI Benchmark上排名第一,并在OpenOccupancy BenchMark中取得了超过基于LiDAR方法的mIoU。

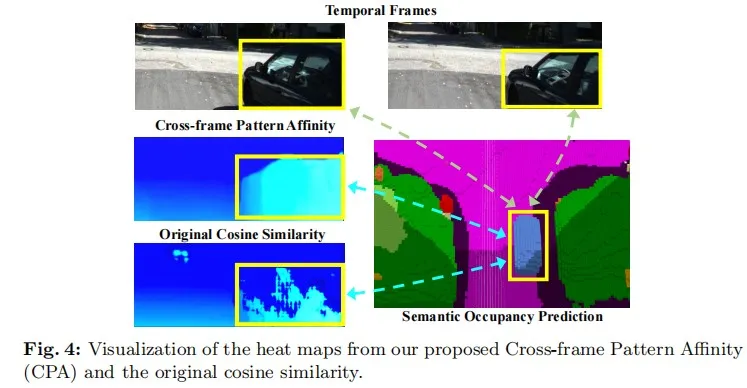

- 定量实验结果:

在SemanticKITTI基准测试中,我们提出的方法明显优于所有其他方法。与VoxFomer-T相比,我们的方法即使在较少的历史输入(3 vs. 4)中也取得了显著的相对增益。在OpenOccupancy基准测试中,尽管基于LiDAR的在IoU方面具有固有的优势,但我们的HTCL在mIoU方面超过了所有其他方法(包括基于LiDAR的LMSCNet和JS3C-Net ),证明了我们的方法在语义场景补全方面的有效性。

- 定性试验结果:

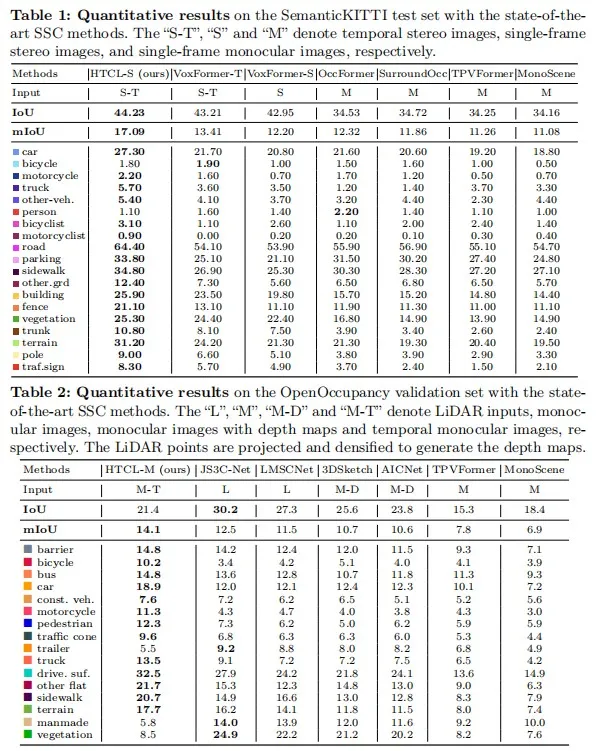

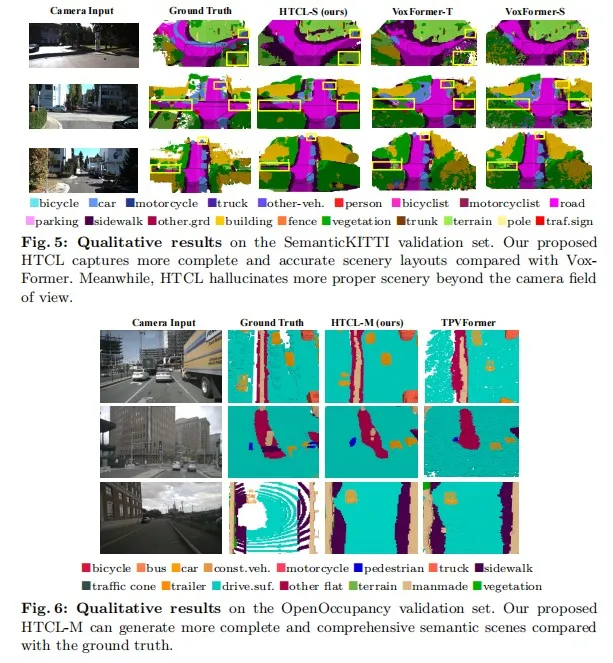

图5展示了我们提出的方法与VoxFormer在SemanticKITTI上的定性比较。可以观察到,真实世界的场景非常复杂,而注释的地面实况相对稀少,这给从有限的视觉线索中完全重建语义场景带来了挑战。与 VoxFormer 相比,我们的方法能捕捉到更完整、更准确的场景布局(如第二行和第三行的十字路口)。此外,我们的方法还能有效地补全摄像机视野外更多合适的景物(如第一行和第二行中的阴影区域),并在移动物体(如第二行中的卡车)方面表现出明显的优势。图6展示了我们的方法在 OpenOccupancy 上的预测结果,我们提出的方法与GT相比,可以生成的结果更密集、更真实的Semantic Occupancy。