一、电商知识图谱概览

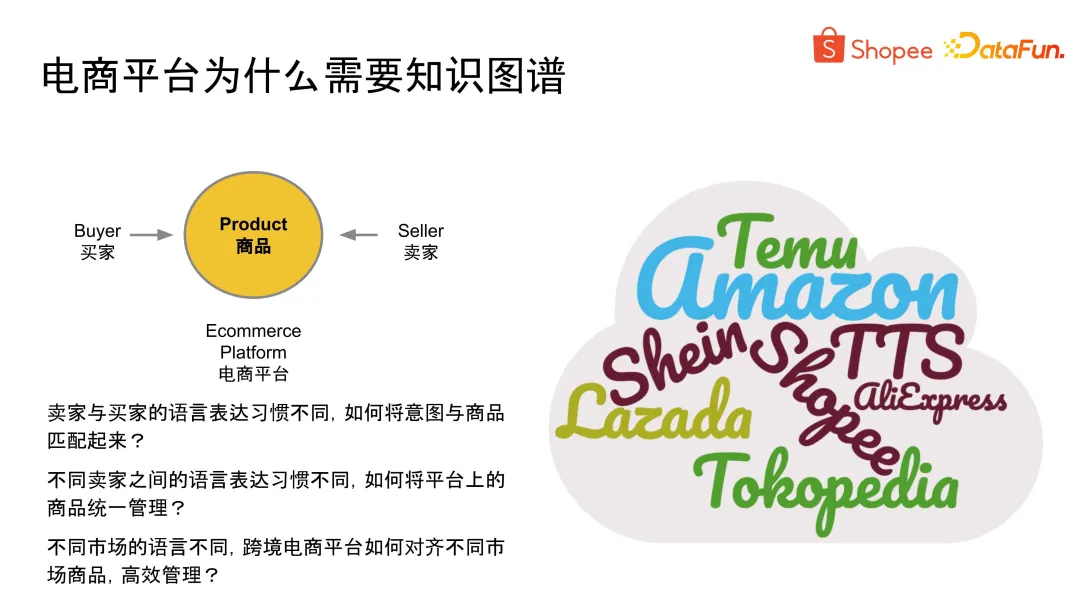

对于任何电商平台而言,商品都是至关重要的元素,它连接着买家和卖家。针对买家、卖家和电商平台这三个角色,我们需要解决以下问题:

- 首先,买家和卖家的表达习惯不同,如何高效地匹配买家的购买意图与卖家的商品信息,促成交易转化?

- 其次,不同卖家间存在语言表达习惯差异,例如新手和成熟卖家的区别,本地卖家和跨境卖家的区别等,如何统一管理平台上的商品,消除差异化?

- 另外,对于跨境电商平台,比如 Shopee,面临着跨越不同市场和语言的挑战,如何对齐不同市场的商品,实现高效管理?

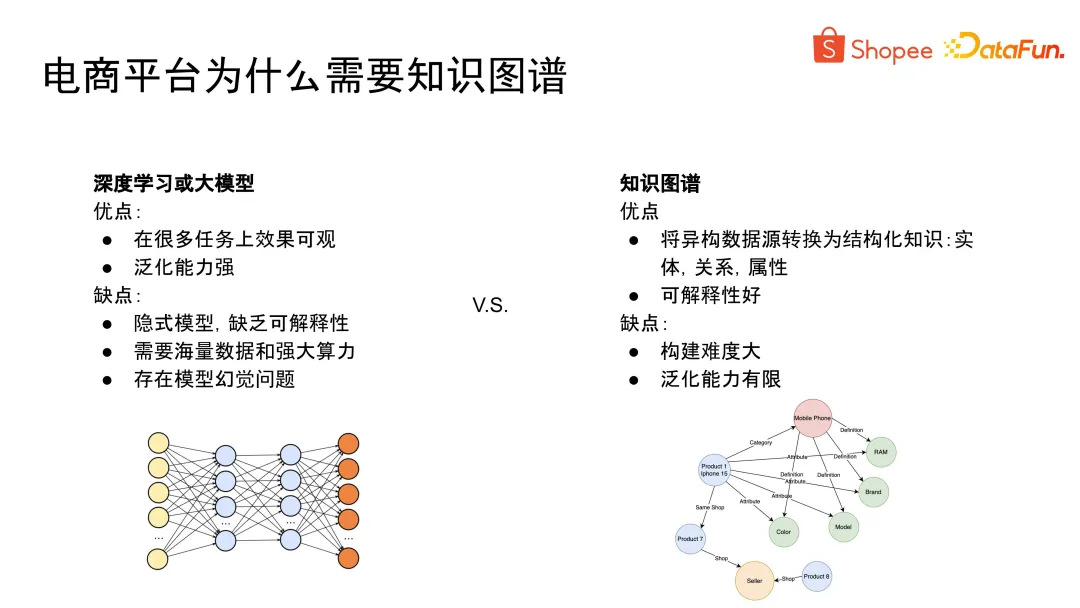

解决这些问题,我们可以采用多种方法,其中深度学习和大模型是其中的佼佼者,具有明显优势,能在许多任务上取得显著效果,并具有较强的泛化能力。然而,深度学习和大模型的缺点也显而易见,缺乏直观的可解释性,需要大量标注数据进行训练,并且需要强大的计算资源支持,同时大模型还存在幻觉问题。

相比之下,知识图谱的优点也很清晰,它可以将异构数据源转化为结构化知识,易于处理。通常,知识图谱由三个元素构成:实体、关系和属性,并通过实体-关系-实体的方式表达数据之间的关联关系。得益于这种清晰的数据表达方式,知识图谱的可解释性更强。但知识图谱也存在一些缺点,比如构建难度较大,且泛化能力相对有限,需要强大的推理能力或人工输入才能构建企业所需的泛化能力。

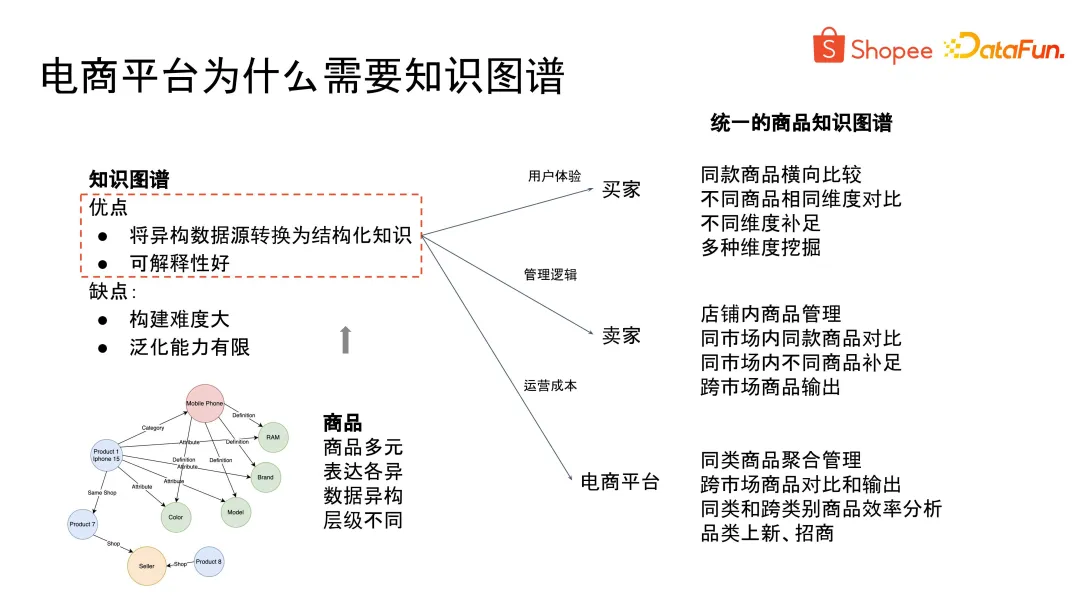

目前而言,知识图谱尚无法完全被深度学习或大型模型所替代。因为它所带来的优势能为买家、卖家和电商平台带来诸多好处。统一的商品知识图谱,能够高效提升用户体验,例如进行同款商品的横向比较,进行不同商品在相同维度上的对比,以及挖掘多种维度的商品信息等等。

对于卖家而言,可以通过知识图谱优化其管理逻辑,比如对于同一店铺内商品进行去重和质量优化等。同时,对于同市场内的同款商品,可以为卖家提供优化建议,提升其商品竞争力。还可以为同市场内不同商品补足提供及时的提醒。对于跨境电商平台,可以帮助卖家及时输出跨市场的爆品商品。

对于电商平台本身而言,通过电商知识图谱可以降低运营成本。例如,通过商品聚合管理可以大大降低管理维度,进行跨市场商品对比和输出,以及进行同类或跨类别商品的效率分析,从而帮助平台进行品类上新和招商等活动。

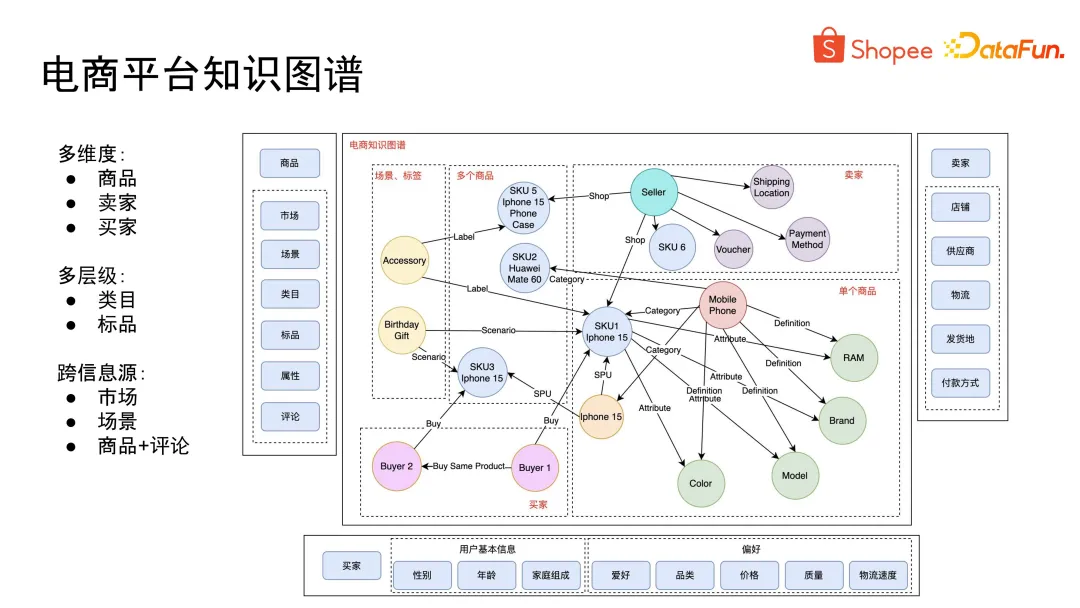

上图展示了电商知识图谱的基本形态,我们可以观察到,其中的信息是有很多维度、多层级,并且是跨多个信息源的。举例来说,卖家信息会补充商品基础内容以外的信息,比如优惠券、付款方式以及发货地等等。这些因素都在一定程度上影响着买家是否能够完成购买转化。通过这些图谱,我们能够有效地进行连接和关系推理。

接下来,将介绍知识图谱构建的基本方法。

二、电商知识图谱构建

1. 电商知识图谱构建难点

电商领域构建知识图谱面临的主要挑战包括:

- 首先是信息多元。信息来自多个来源,包括买家和卖家等。在某些情况下,商品本身的信息可能不完整,但我们可以从买家的评论中提取出有效的补充信息,以弥补这些缺失。另外,信息的表达方式也是多样的。例如,在上图的例子中,“ready stock”这个词是东南亚市场经常使用的表达方式,但在其他市场可能并不适用,比如拉美市场。

- 第二是质量参差不齐。比如,在这个例子中,卖家在标题中输入的品牌信息“Sumsung”实际上是错误的。这种拼写错误、信息错误、冗余或缺失在电商平台上非常常见。

- 第三是依赖领域知识。对于某些品类的商品,需要依赖领域知识来判断其准确性。例如,在摩托车这个品类中,“50CC”对于不太了解该领域的人来说并不明确,他们可能无法确定它指的是某个型号还是排量。因此,需要领域信息来帮助我们进行验证。

- 最后是数据量大。以 Shopee 为例,我们拥有数十亿种商品,涵盖了 8 个市场,使用了 6 种语言。如何将如此庞大的信息融合构建成一个统一的知识图谱,是一个巨大的挑战。

2. 电商知识图谱基本框架

电商领域构建知识图谱的基本框架都是从数据源出发,可能是同构信息,也可能是异构信息。第一步是进行信息抽取,然后进行知识的融合,最后进行知识的加工。在此不详细展开每一步骤的各个环节,仅针对其中的一些难点介绍我们对应的解决方案。

3. 电商知识图谱构建方法

(1)数据源

首先,让我们对齐一下信息源的名称。上图展示的是一个商品的详情页,其中包含了标题、图片、variation(也就是可以选择每个具体的 SKU 的部分)、结构化的商品详情,free-text 的商品描述,以及买家填写的评论信息。

(2)信息抽取

在进行信息抽取之前,我们想强调一点,对于电商平台来说,一个重要的基石就是进行 Ontology 的定义和结构化。为什么这么重要呢?因为商品信息非常丰富,我们并不需要抽取所有的信息内容,很多时候只需要抽取对我们的实际应用和业务诉求有影响的关键信息就足够了。

构建方法基本上可以分为两大类:一是通过领域专家知识进行构建,二是通过数据进行主动挖掘。第一种方法需要大量人力,我们最近也在研究如何通过数据主动挖掘,发现一些未知的本体形式和结构。

以 Shopee 为例,我们的 Ontology 结构主要分为两层:

- 第一层是基础定义层,包括一些基础的元素,如类别和属性。类别又分为多个层级,从 L1 到 L5,属性也包括关键属性和销售属性,这些都与实际业务场景密切相关。

- 在基础定义层的基础上,我们可以根据这些基础元素进行排列组合,形成组合定义层,例如场景、标签、标品等。对于像春日露营这样的场景,通常我们会跨越多个类目进行组合。对于“户外防水装备”这个标签,则户外运动类别商品具备防水属性才符合要求。对于标品,定义会相对严格,需要完全符合一些类目或属性的定义,才能称之为同一个标品。

下面介绍信息抽取中的难点以及相应的解决方案。

以类目信息提取为例,我们的输入信息基本上就是商品,包含图片和标题。了解了这个信息源之后,我们就可以清楚地了解到,信息质量参差不齐。例如,在第一个商品例子中,从图片很难分辨出要销售的商品主体,因为背景嘈杂。但是通过商品的其它图片,通过一些质量较高的、能够突出反映要销售的商品主体的图片,可以发现要卖的商品是鼠标垫。针对这种情况,我们可以在多个信息输入源中筛选出更高质量的信息,再作为模型的输入,效果会更好。

其次,信息还可能模糊或不完整。例如,右边的例子中,单看图片可能会认为是一个乐器架子鼓,但实际上在标题中会发现它是儿童乐器玩具,应属于儿童玩具类目,而不是乐器类目,这是一个较大的差异。

同时,对于跨境电商平台来说,多语言适配也是非常重要的。像 code switch 在我们的场景下是非常常见的。

针对信息参差不齐的情况,我们有针对性地对文本和图片信息分别进行了质量评估。例如,对于文本,我们采用了多种方法。首先是一些简单的基于规则的方法,凭借先验知识来判断,比如标题过短或过长的商品信息质量通常不会很高。除此之外,我们还训练了许多模型来判断文本的质量,比如一些多任务模型,输入是商品标题,一方面可以对文本进行分类,另一方面可以抽取标题中的关键词。一个重要的假设是,高质量的关键词(通常是一些品类词)或标题,它们所对应的类别输出应该是一致的。基于这一假设,我们构建了一个多任务模型进行学习。整合文本各维度评估,从而得到文本质量评分。

另一方面,我们也对图片质量进行评估,考虑因素包括像素、是否包含多个实体、是否包含文字信息、背景是否嘈杂等等。结合这些信息,可以得到综合的图片质量评分。

通过文本和图片质量评分,我们可以在众多输入信息源中筛选出更高质量的信息,从而为后续模型的最终预测提供数据源的质量保障。

针对信息模糊或不完整的情况,我们采取的方案是根据文本和图片进行交叉验证。提到文本和图片的交叉验证,大家可能会首先想到多模态模型,我们也进行了许多相关尝试。我们微调了 ALBEF 模型,通过图像和文本的对比学习结构,直接预测对应的品类。

我们还重点优化了图像和文本的表示学习,融入了多语言商品信息,建立了 Labse-DinoV2-Vit 等模型,在一些难以区分的类目中,效果得到了显著提升。

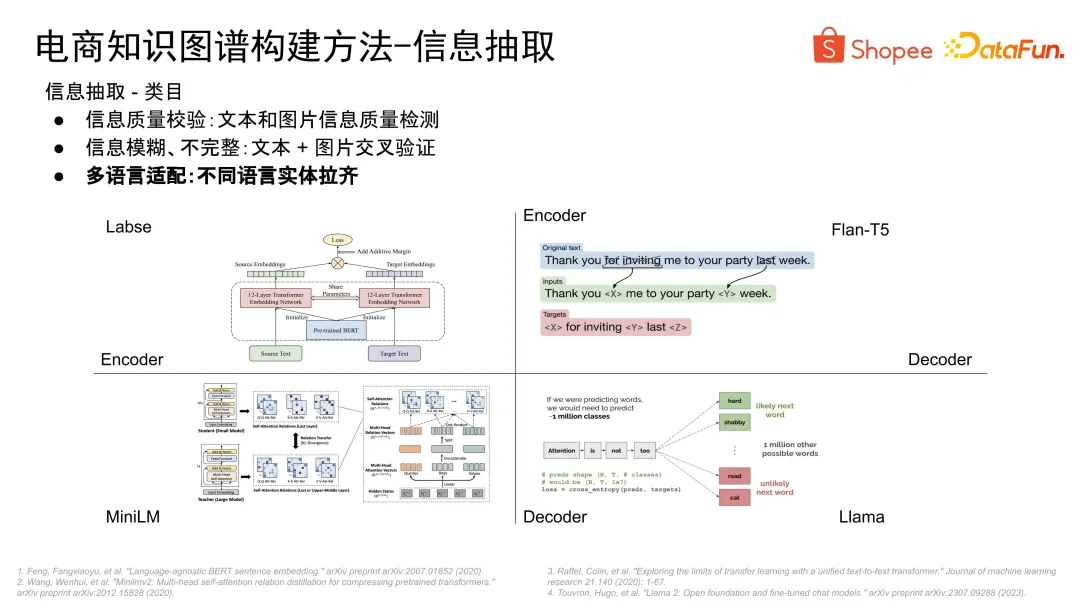

多语言适配方面,我们尝试了许多语言模型,例如 Labse 结构模型,用来多语言之间信息对齐,还对比了编码器解码器结构模型,例如 Flan-T5,以及解码器模型 Llama 系列等,分别在多语言电商商品信息上进行微调。由于这些模型结构本身较大,在实际的推理过程中需要较快的速度,因此我们也尝试通过 MiniLM 等方式对模型进行压缩。

(3)知识融合

信息抽取后,下一步是知识融合,这里的难点是实体消歧。下面将结合类目和属性具体问题来介绍我们的解决方案。

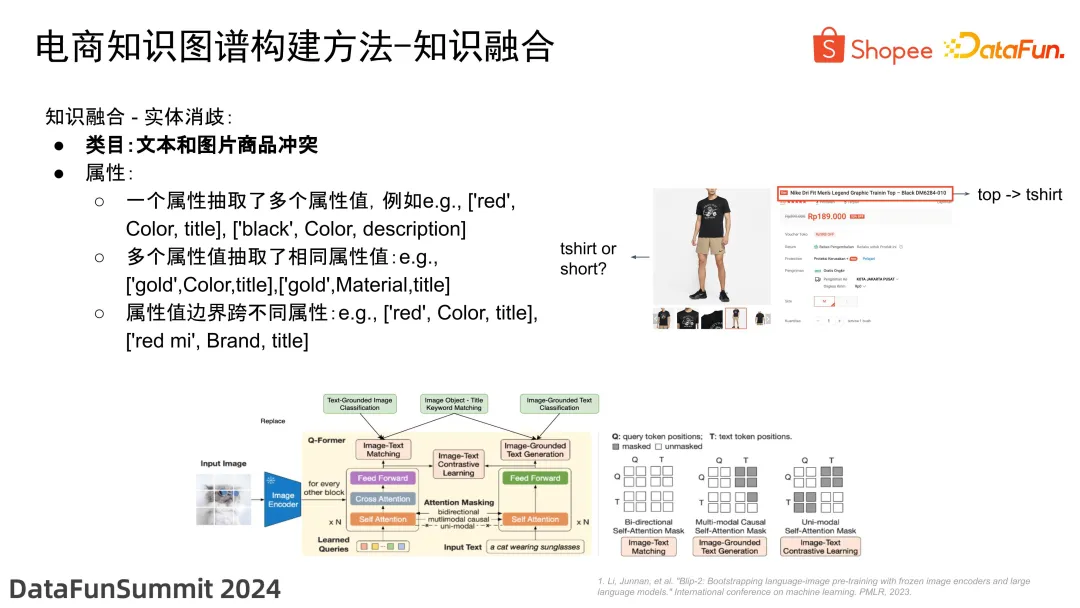

首先,对于类目而言,输入是文本和对应的图片,消歧问题体现在文本和图片信息之间的一些冲突。以上图右边的例子为例,商品图片质量是相对较高的,然而仅凭图片难以确定是在卖上衣、短裤还是整套服装,通过标题我们可以明确推断出是在售卖上衣。因此,我们结合文本和图像对齐的任务,训练了一些模型,其中一个典型的框架 Blip。我们借助这个框架,做了一些改进。

然而,文本和图像对齐任务需要文本和图片的语义表达尽可能匹配,但在电商平台应用场景中并非总是如此。例如,在上一例子中,图片中只有上衣部分能与标题对齐,另一方面,标题中也会包含图片中未显示的信息,卖家通常会添加一些图片中无法表现的属性信息。因此,这些信息并不是完全对齐的。

针对这一领域特定的问题,我们调整了模型,例如进行了文本引导的图像生成分类,以及图像引导的文本分类,因为它们并不是一个对称的关系。同时我们还加了对齐信息的约束,例如不希望发生颜色匹配但商品却不匹配的情况,因此限定了图片中的实体对象和文本中的关键商品词进行对齐匹配。

此外,在属性识别任务中,实体消歧也有一些难点。例如,一个属性可能存在多个属性值,比如颜色属性在标题中抽取到的颜色是红色,但在描述中抽取出的颜色是黑色,哪一个是正确的呢,还是它们需要结合起来使用?另一个例子是,多个属性抽取到相同的属性值,例如颜色和材质同时抽取到了“gold”,那么两者都正确吗,还是只适用于其中一个?还有某些属性值可能跨越不同属性,例如在标题中抽取到的颜色是“red”,但在品牌中又抽取到了“red mi”,这时“red”既涉及到颜色属性,又涉及到品牌属性。

针对这些问题,我们尝试了一些解决方案。首先,我们搭建了常用 NER 模型,例如 BERT NER,用于属性提取。随着大型模型的发展,我们也利用了生成式模型的能力,尝试主动生成属性值,以期提高效果。我们在 T5 模型基础上,结合电商领域属性抽取的任务特性,用 prompt tuning 的方法训练了模型。我们惊喜地发现,在一些难以处理的、容易产生歧义的案例中,准确率有了显著提升。

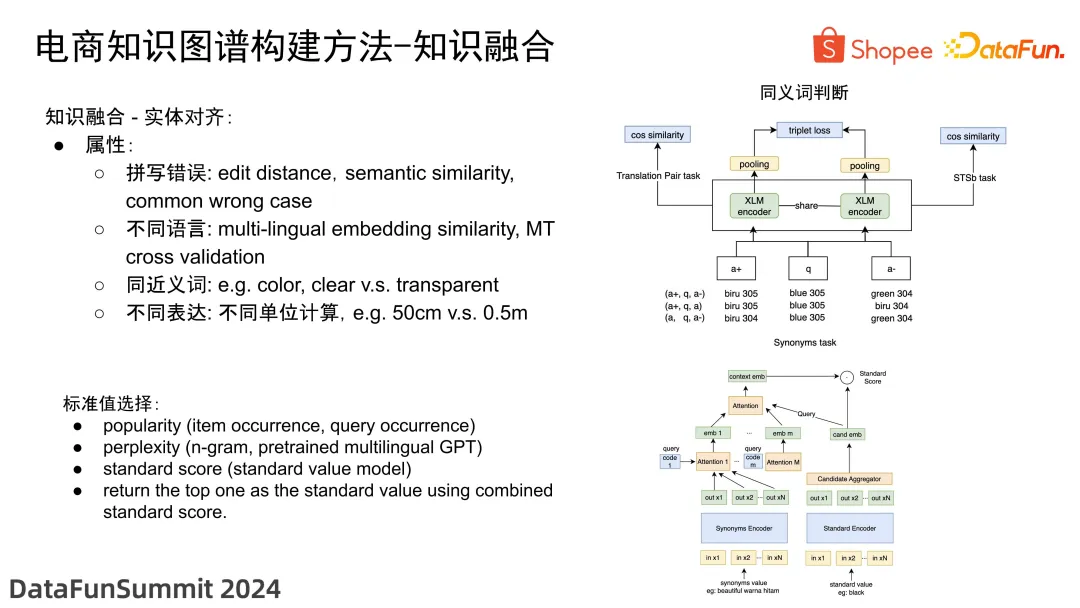

知识融合的另一个难题是实体对齐。以属性为例,在实体对齐中涉及多种类型。我们的目标是对齐同一属性值的不同表达方式。对于拼写错误的问题,可以通过编辑距离、语义相似度、常见错误集合等方法处理。对于不同语言的问题,可以使用多语言嵌入相似度和模型翻译等方法解决。同义词和近义词的区分可能会有一些困难,因此我们借鉴了 Labse 模型框架,训练了一个同义词模型。重点区分词形相似但语义差别很大,以及不同词形但语义相近的情况。还有不同单位的情况。例如,一个人可能用"50cm",另一个人用"0.5m",我们针对这种情况进行了单位转换计算等处理。

当对齐这些词后会发现同一属性词可能有很多选项。在众多选项中,我们需要选择一个标准词来代表相同的含义。选择标准词的标准有很多,比如流行度,即哪些词的使用频率最高。然而,流行度并不适用于所有场景。举例来说,在印尼市场中,错误拼写的使用最多,但错误拼写并不能在许多情况下准确表达商品的含义,因此我们还考虑了其他因素,如困惑度和标准表达能力,用来更准确的代表属性值集合。综合考虑这些因素,我们训练了一个模型,选择相应的标准值。

(4)知识加工

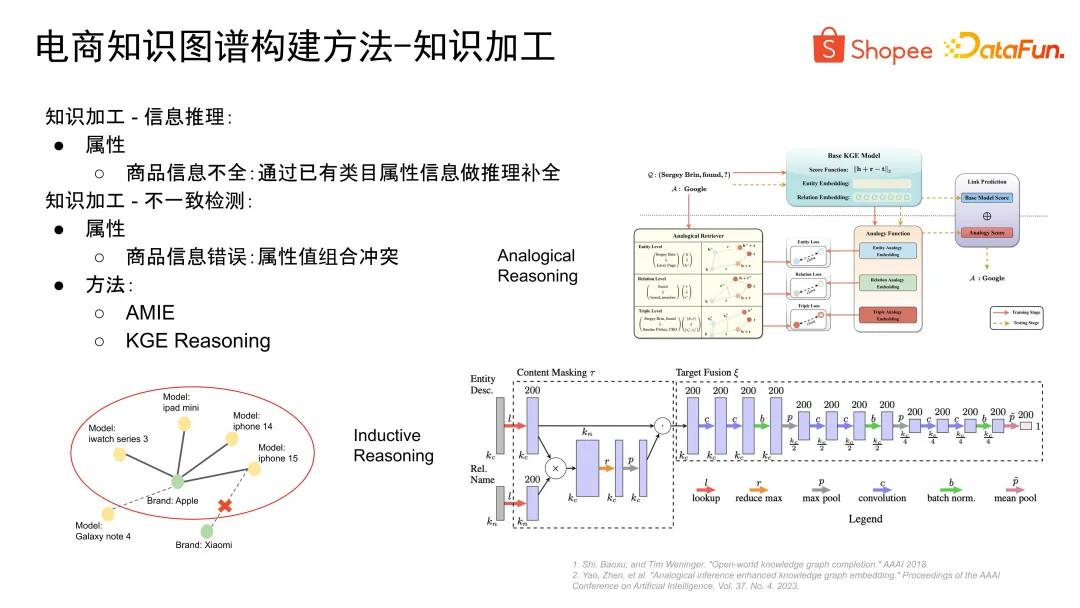

在知识加工这一步中,将着重讨论信息推理和不一致检测。这两个任务之所以被放在一起讨论,是因为它们其实是相互关联的。通过一些信息,我们可以进行推理,同时我们也可以反向利用推理结果来校验提取信息的准确性。如果存在冲突,那么很可能其中一个任务出现了错误,因此这两个任务可以进行双向校验。

在这个任务中,仍以属性为例来介绍相应的方法。传统方法通常使用关联规则挖掘。例如,在左图例子中,我们看品牌和型号之间的关系,如果提取到一个商品型号是 iPhone 15,那我们可以反向推理出对应的品牌一定是苹果(Apple),这是一种单向推理。但如果我们已经知道一个商品的品牌是小米,而型号却是 iPhone 15,那显然这个关系是错误的,提取结果是错误的。

除了传统方法外,我们还结合了知识图谱嵌入推理的方法。例如,通过归纳推理,可以给定一些头实体和它们的描述文本信息,然后预测它们与其他实体之间是否存在某种关系。通过这种方式可以进行信息的补全。

最近,我们还发现了一些研究是类比推理,即进行平行关系的推演。类比推理可以基于已有节点之间关系形态,类比扩展到其他节点之间的相似关系结构。

归纳推理和类比推理,都可以用于知识图谱补全。其中,归纳推理相当于从一个点出发,推理出不同方向的关系或连接的实体,可能存在于图中,也可能不存在。而类比推理则是进行平行关系的推演。它们适用于不同场景下的知识图谱补全。在电商领域中,我们经常面临信息不完整的情况,因此进行知识推理和补全尤为重要。

三、电商知识图谱应用

接下来,介绍知识图谱在电商领域中的一些具体应用案例。

首先,知识图谱可以有效地与流量侧进行结合。在搜索场景中,以 VLP 场景为例,可以帮助处理查询,包括识别商品的特定属性和标签,然后将这些属性和标签直接注入到相应的索引系统中。当出现相关查询并解析出对应的属性和标签时,就可以进行高效的属性和标签对齐。通过这种方式,帮助搜索系统补充召回了大量相关数据,同时也提升了排序过程中的相关性。最终,转化效率也得到了显著提升。

在推荐场景下,也有多种应用。以每日发现场景为例,在类别基础之上,我们提供了更细粒度的品类信息。可以在召回过程中补充细粒度品类召回,同时,在向用户展示商品时,将相邻商品的同品类信息进行打散,从而增加了用户看到信息的丰富度。我们发现用户的兴趣度明显提升,例如在 impression、点击率等指标中都有明显的改善。

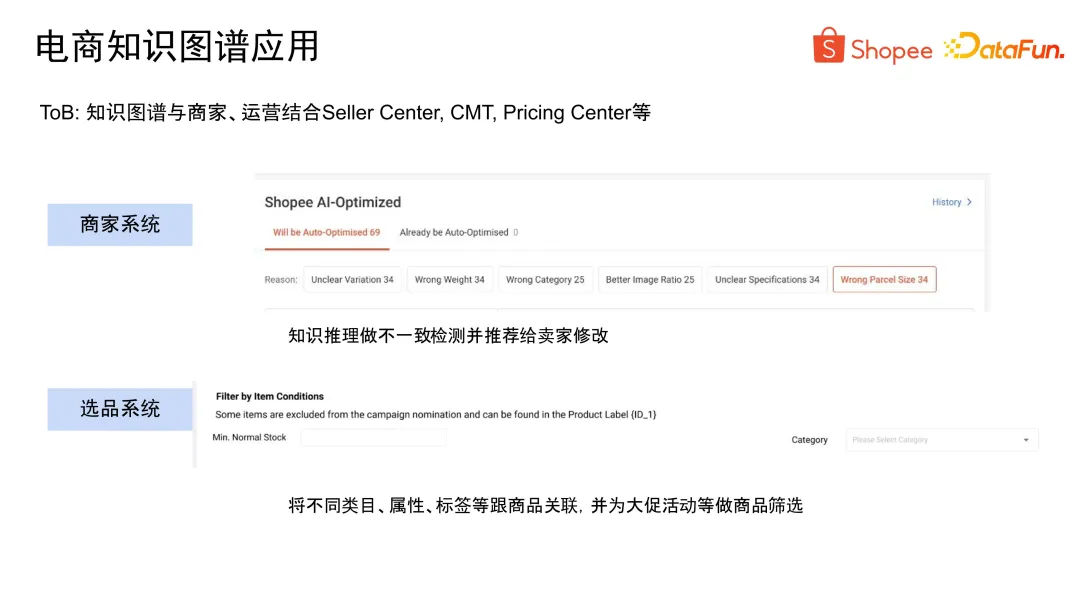

除了与流量侧的结合,我们在运营侧也有许多应用案例。例如,与商家系统结合,通过对数据的分析,针对类目填写不正确、属性填写不标准等问题,为商家提供优化建议和方案。

此外,还与选品系统结合,为商品打上不同类别、属性和标签等标识。运营团队可以根据每个卖场想要表达的主题,灵活组合他们想要推荐的商品。这样,选品筛选更加高效,选出的商品也更相关。

四、知识图谱与大模型探索

最后,来探讨一下知识图谱与大模型的结合。

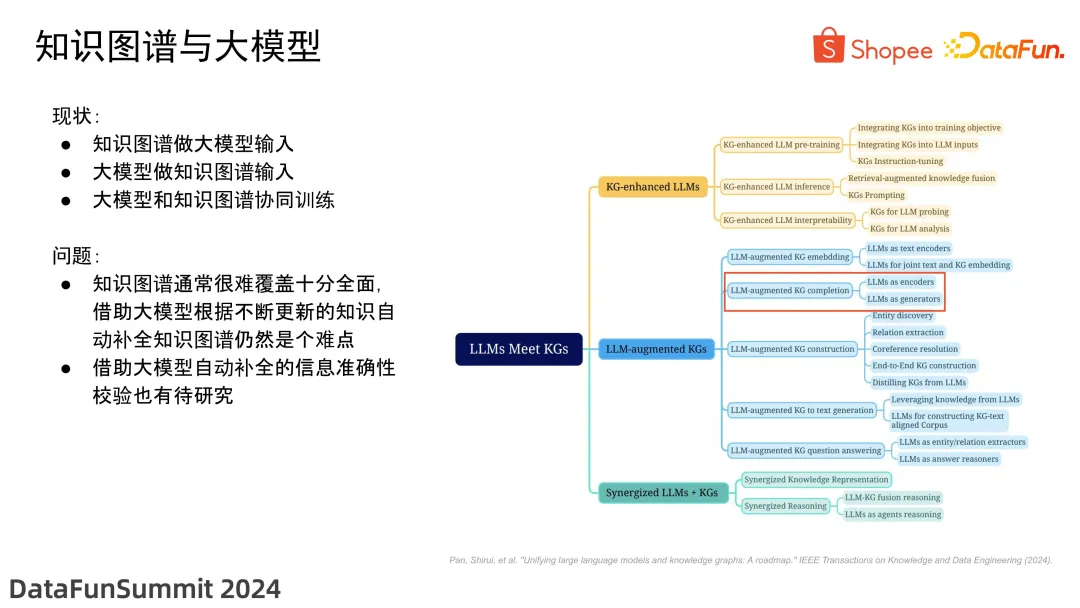

目前有三种主要的结合方式:第一种是将知识图谱作为大模型的输入;第二种是将大模型作为知识图谱的输入;第三种是双方进行协同训练。

上图中展示的结构图来自一篇整理得非常清晰的调查报告,推荐大家阅读,这里不做赘述。仅分享一个有趣的发现,在整个知识梳理中,我们发现了一个比较薄弱的环节,即知识图谱的补全。尽管知识图谱补全的机制在理论上比较容易理解,例如归纳推理和类比推理,但在真实应用中相关工作和成功案例仍然比较少。

在知识图谱构建中,一个重要问题是如何更全面地覆盖知识。如何借助大型模型根据不断更新的自然知识来补充知识图谱仍然是一个难题。此外,由于大型模型天然存在一些知识幻觉的问题,如何自动验证补充信息的准确性也是亟待研究的一个问题。

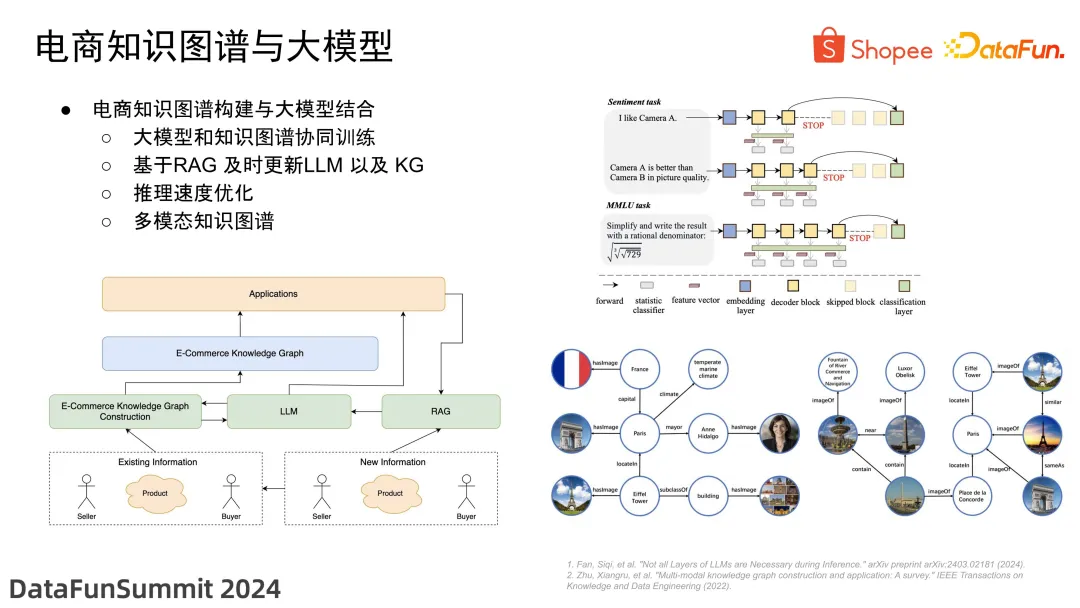

让我们进一步聚焦于电商领域中知识图谱与大型模型的结合方式。之前提到的三种结合方式在这里都是适用的。除此之外,在电商领域,信息的更新速度非常快,每天我们都会有数十万甚至上百万个新商品的注入和更新。在这种情况下,如何利用现有技术,例如 RAG,来帮助大型模型和知识图谱实现及时更新,同时及时响应实际应用场景,这也是值得研究的一个重点方向。

在及时更新的过程中,我们又如何将实时发现的知识与已有的知识图谱进行融合和去重,并将其沉淀下来,作为未来的基础使用,这其中也有很多细节值得探讨。

此外,推理速度的优化,也是一个老生常谈的问题,特别是在实际应用场景中,包括电商平台等,大型模型的推理速度往往会是一个很大的瓶颈。目前已经有很多加速的方式,例如量化、模型压缩等,在这不做过多展开。

这里分享一篇有趣的研究。该研究并不是关注于使用什么技术来压缩模型或量化推理,而是通过应用层面的观察发现,针对不同任务,并不一定需要运行大型模型的所有层级,对于一些简单任务,可能只需跑完浅层的信息推理即可得出最终结论,而对于较难的任务再适配更多层模型信息。这为我们提供了一个新思路,在优化时可以考虑结合不同的应用场景进行选择性的适配。

另外,多模态知识图谱也是一个方向。对于电商平台来说,所有信息源天然都是多模态的,包括文本、图片和视频等。我们可以尝试高效地将这些不同模态的信息源融合到知识图谱中,并将其整合到更多下游应用中。

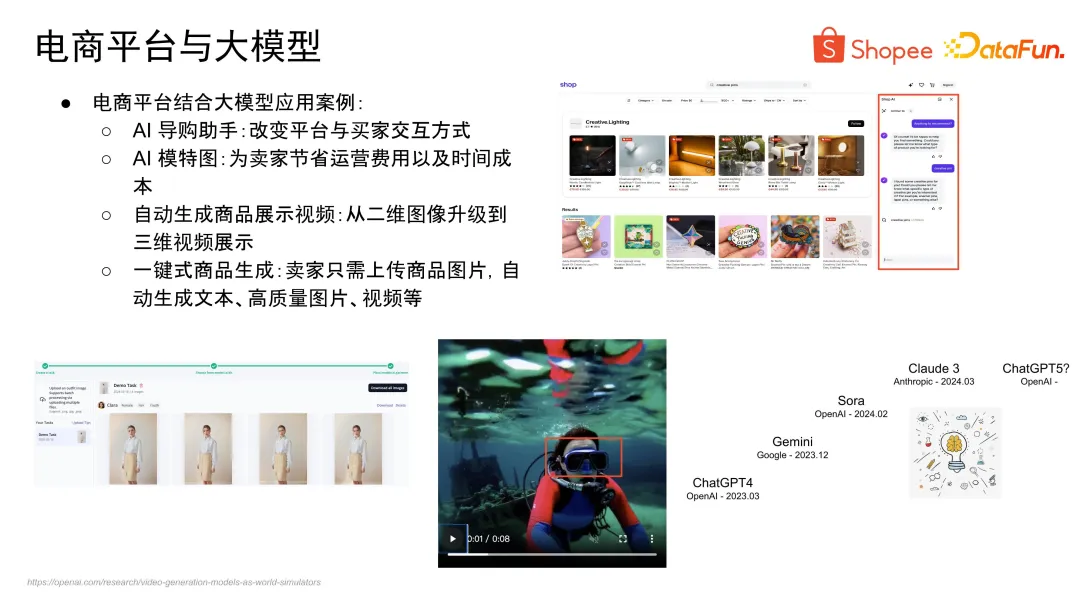

从整个电商平台的视角来看,也有很多与大型模型结合的成功应用案例。例如,最近许多平台都在尝试 AI 助手,最初是受搜索平台结合 AI 助手启发而来的,通过强大的搜索引擎和建模系统来改变平台和卖家之间的互动方式。当然,这需要经过一些实践验证,以确保符合用户的购物习惯,并根据反馈进行迭代更新。

除此之外,还可以帮助卖家生成 AI 模特图,从而节省运营成本和时间。还可以通过二维图像,甚至文字描述,升级到三维视频展示,结合实际商品的应用场景,为卖家创造更直观的展示效果。

近期,多模态大语言模型出现了爆发式增长,如 ChatGPT-4、Gemini、Sora、Claude 3 等,它们提供了强大的多模态大语言模型能力。这些模型的出现引发了对于未来是否能够实现一键式商品生成的讨论。尽管有许多声称是一键式商品生成,但实际上需要卖家进行大量手动输入。然而,如果这些模型能够应用到实际场景中,也许真的只需要卖家上传一张商品图片,就可以自动生成商品标题、描述、高质量图片,甚至视频等等。这些应用场景都具有很大的潜力。

最后对本次分享进行一下总结。首先,我们通过电商知识图谱概览,分析了为什么电商平台需要知识图谱,它可以为卖家、买家和平台带来哪些帮助。接着,依照电商知识图谱构建的基本流程,针对其中的难点分享了我们的解决方案。第三部分介绍了实际的应用场景和效果。最后探讨了知识图谱以及电商平台与大模型的结合。在未来,知识图谱加大模型将会有更广泛的应用场景。

五、问答环节

Q1:质量分的判断是用垂直模型吗?是不是能够用语言模型呢?

A1:质量分的部分可以使用语言模型进行判断。然而,最重要的是明确定义质量分所要识别的内容。通过具体任务定义,语言模型是一种解决方案。

Q2:实体语义消歧或实体合并有哪些好的方法或建议?比如两个不同的地址如何识别为同一个地址?

A2:实体消歧涉及到诸如地址等的关联。建议首先获取领域知识,并结合辅助信息进行判断,如物流路径是否一致、收件人是否集中等。此外,可以通过上下文信息辅助判断,但准确性可能受限。

Q3:当训练数据很少时,大模型在知识抽取上如何更好地应用?

A3:在训练数据有限时,可以借助大模型的 prompt 功能,并结合技术如 COT,利用少量输入信息进行推理和泛化。

Q4:知识图谱给大模型白名单,大模型给知识图谱构建,有推荐的工具或算法吗?

A4:目前尚未有统一的工具或算法。研究领域涉及众多算法和应用方式,建议深入研究相关文献以获取更多信息。

Q5:知识图谱和电商品分类、商品库有重复性,可以直接用商品库关联大模型吗?

A5:直接使用商品库关联大模型可能存在问题,因为商品库数量庞大,且大模型输入信息量也较大。需根据具体场景考虑是否需要全部信息关联,可能只需少量输入即可实现目的。

以上就是本次分享的内容,谢谢大家。