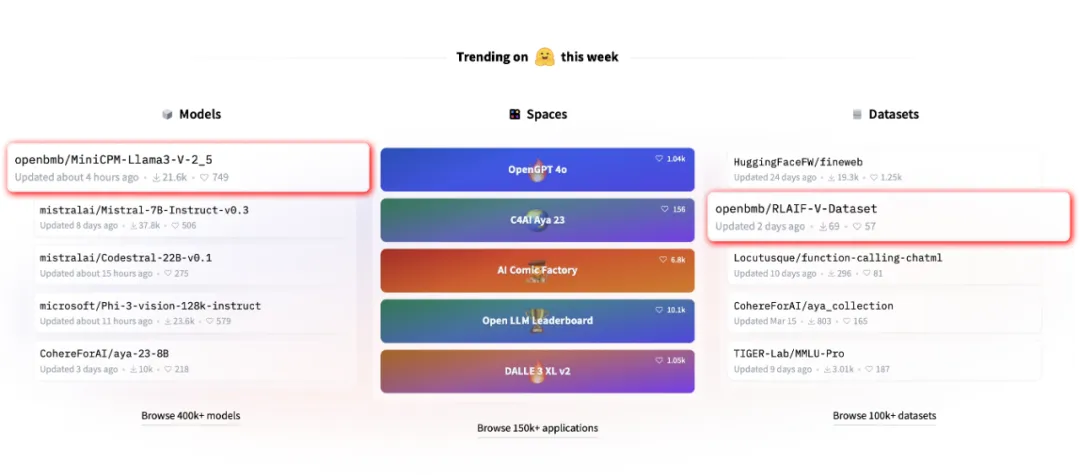

近期,由清华大学自然语言处理实验室联合面壁智能推出的全新开源多模态大模型 MiniCPM-Llama3-V 2.5 引起了广泛关注,在发布后火速登顶 Hugging Face、GitHub、Papers With Code 的 Trending 榜首,与 Meta、微软、谷歌等科技巨头共同从全球 66 万模型中脱颖而出。与此同时,该模型使用的多模态对齐数据集也登上了 Hugging Face Trending 第二位。

仅有 8B 体量的 MiniCPM-Llama3-V 2.5 不仅在多模态综合性能上超越了商用闭源的 GPT-4V、Gemini Pro、Claude3,同时在模型可信度方面也达到了开源模型中的最高水平。其出色的性能离不开背后的一项关键性技术 ——RLAIF-V。这项技术基于完全开源的范式进行多模态大模型的对齐,实现了超越 GPT-4V 的可信度。

- 论文:RLAIF-V: Aligning MLLMs through Open-Source AI Feedback for Super GPT-4V Trustworthiness

- 论文地址: https://arxiv.org/abs/2405.17220

- 项目地址:https://github.com/RLHF-V/RLAIF-V

- DEMO:https://huggingface.co/spaces/openbmb/RLAIF-V-12B

RLAIF-V 核心特点

从亦步亦趋迈向切磋琢磨,通过开源反馈实现超越 GPT-4V 的可信度。

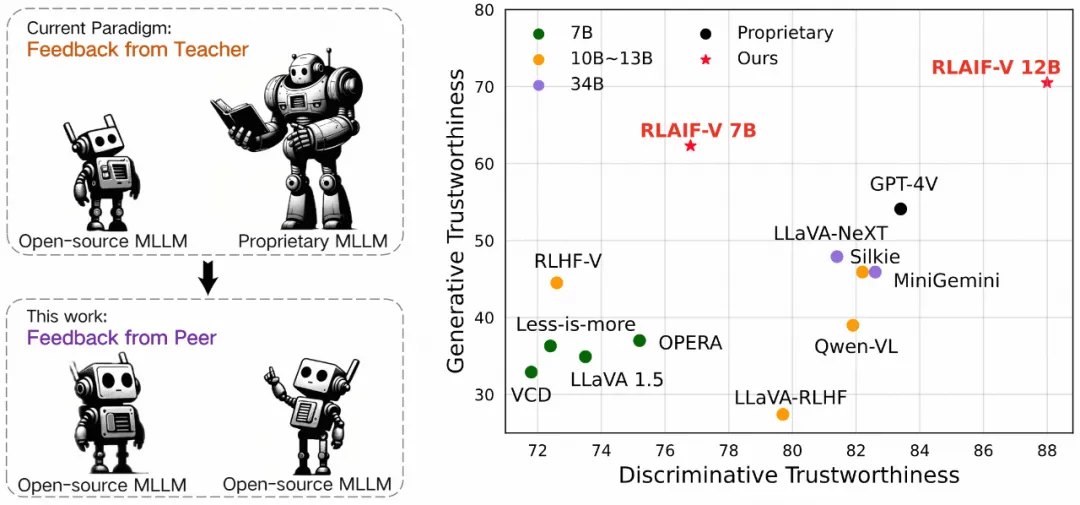

已有的多模态大模型对齐方案主要采用蒸馏 GPT-4V 等昂贵的闭源模型的方式,实际上提供了一种模仿的方法(“亦步亦趋”)。随着开源社区的不断发展,我们急需一种能够让开源模型利用能力相仿或者相同的模型提供反馈,进行自动对齐的方案(“切磋琢磨”)。RLAIF-V 通过无偏候选构造和分而治之的反馈收集策略,可以从 OmniLMM 12B 等常规开源模型收集大规模的高质量反馈数据。通过充分利用这些数据,RLAIF-V 12B 模型在生成任务和判别任务中都实现了超越 GPT-4V 的可信度。

RLAIF-V 学习范式与模型可信度对比

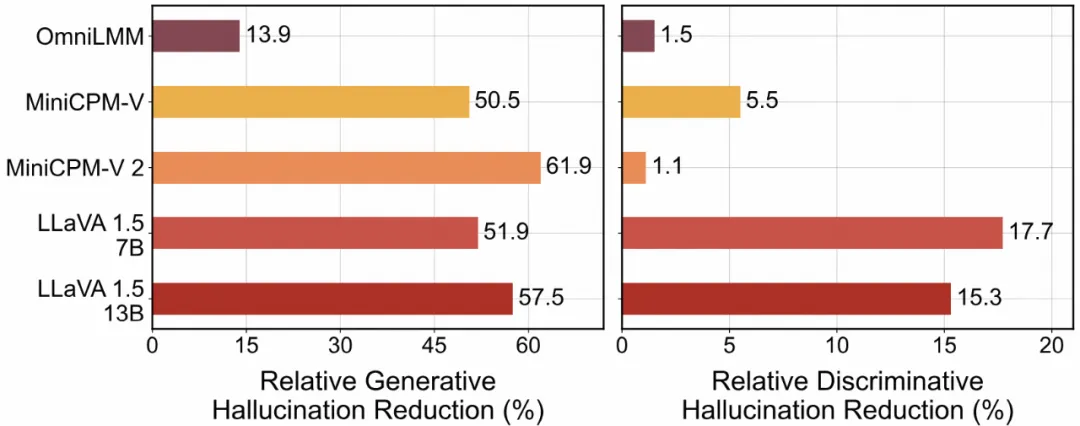

具备优秀泛用性的大规模高质量反馈数据。

研究团队将训练 RLAIF-V 7B 和 RLAIF-V 12B 过程中所构造的高质量对齐数据整理为规模超过 83k 的多任务多模态对齐数据集 RLAIF-V Dataset,包括图片详细描述、图片知识问答、文字识别等多类指令,图片种类覆盖照片、艺术作品、名人、地标、场景文字等。实验表明,该数据集可有效减少 LLaVA 1.5, MiniCPM-V 等不同多模态大模型在多种任务中的幻觉,展现出了优秀的泛用性。

RLAIF-V 数据泛用性

迭代对齐的高效反馈学习。

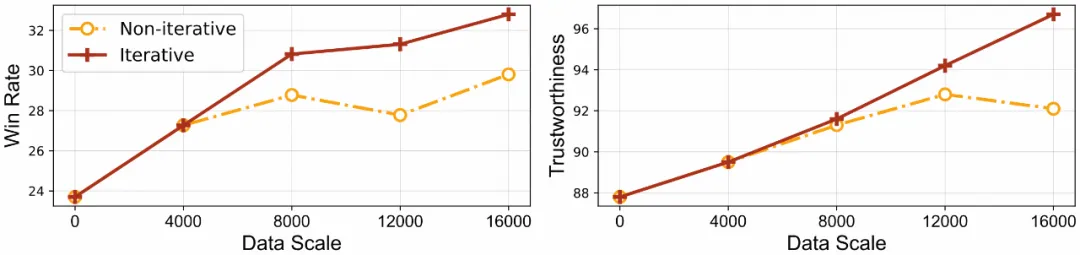

在现有的模型训练中,采用的偏好数据是静态的,但随着训练的进行,模型的输出分布却在不断变化,这导致训练数据分布与模型真实分布产生偏移,从而无法充分利用偏好数据,影响模型的对齐效率。RLAIF-V 采用了迭代的方式进行对齐训练,相较于非迭代方法表现出了更高的学习效率和更好的性能,具有更优秀的规模效应。

迭代与非迭代式训练的效果对比

更可靠全面的多模态评测集 RefoMB。

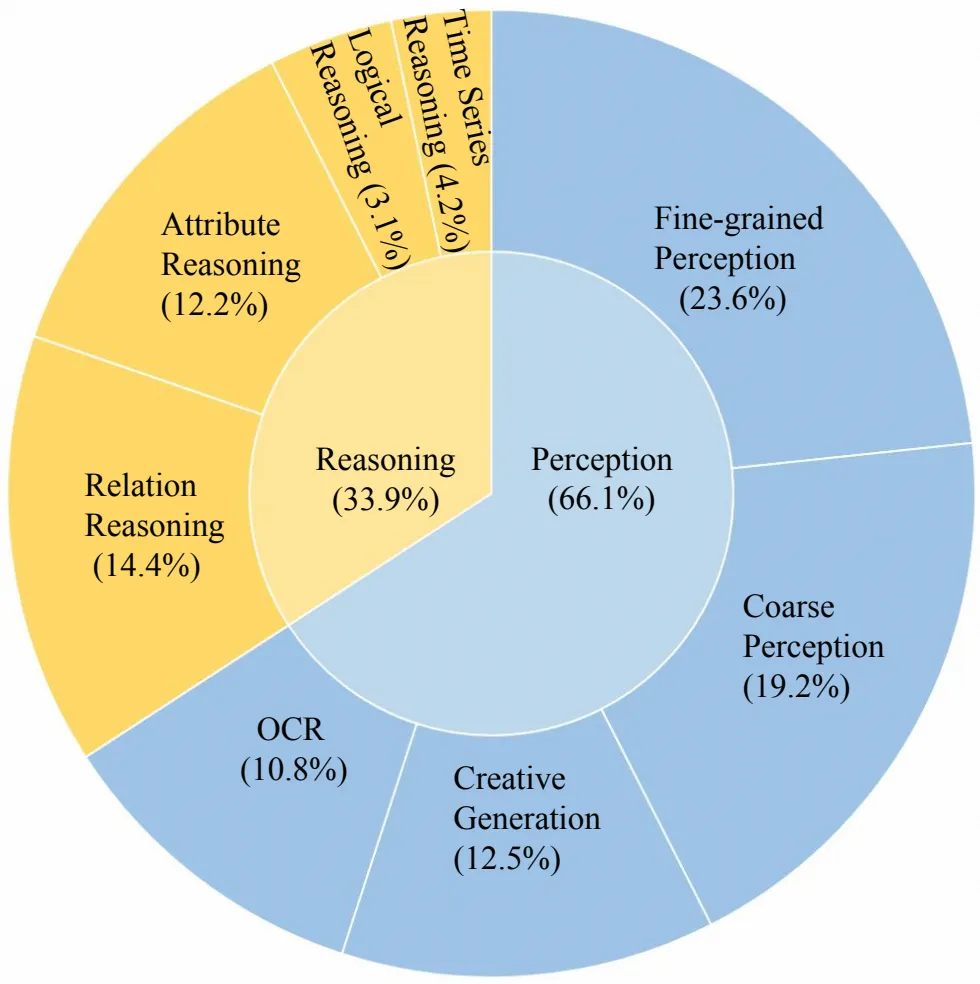

随着模型能力的发展,已有的评测集或存在评测饱和的情况,或评测准确性不足,从而难以正确区分不同可信度的模型。为此,RLAIF-V 提出了新的 RefoMB 评测集,其指令覆盖了多模态模型感知和推理任务中的 8 个子能力,并包含了卡通图片、富文字图片、照片等多样化的图片类型,用于评估现有多模态模型在开放生成时的回复可信度和通用性能。通过人工标注图片详细描述作为评判参考,RefoMB 有效提高了评测准确性,人工一致性可以达到 96%。

RefoMB 指令类型分布

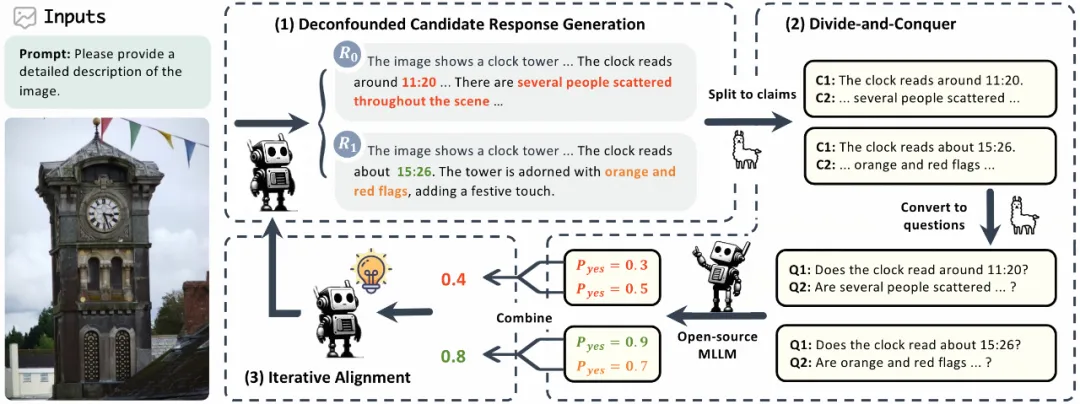

RLAIF-V 框架

RLAIF-V 包含两项创新方法:数据层面,提出完全基于开源模型的高质量反馈数据构造方法;算法层面,采用迭代对齐算法进行模型优化。

RLAIF-V 框架

大规模高质量开源模型反馈数据的构造

为了减小反馈对齐数据的获取成本,实现规模化的反馈对齐数据获取,并提高开源多模态大模型提供反馈的质量,研究团队结合分而治之的思想,提出了如下数据构造流程以实现高质量开源模型反馈的获取:

- 无偏候选回复生成(deconfounded candidate response generation):使用随机解码方法生成多个候选响应。在这种生成方式下,不同回复来自一个相同的分布,有效消除了样本对之间的文本风格差异等混淆因素,使训练过程专注于内容的可信度,从而提高数据效率。

- 分而治之(divide-and-conquer):将复杂的响应分解为更简单、可以单独评估的子问题。这种简化使开源多模态大模型可以提供更可靠的反馈。

应用这种数据构造方法,我们不仅可以利用具有更高模型性能的开源多模态大模型为性能较弱的模型提供反馈,还能够通过模型自身反馈的方式,使 OmniLMM 12B 模型实现超越 GPT-4V 的可信度。

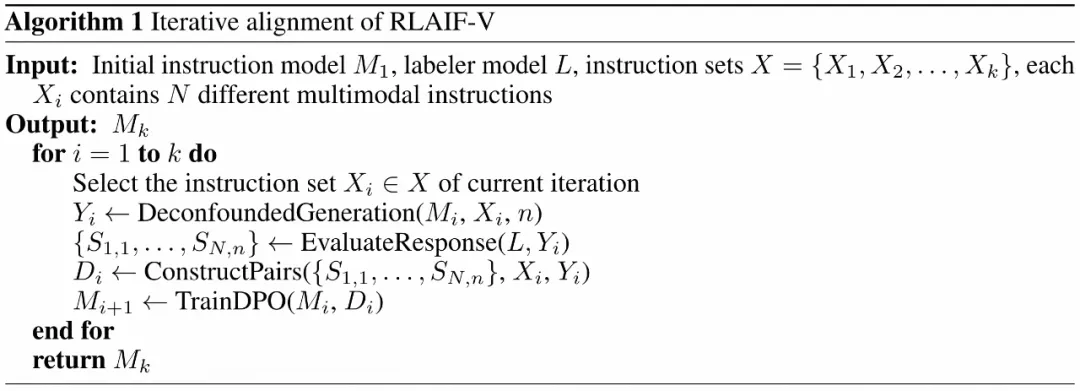

迭代对齐算法

为了缓解现有对齐算法存在的分布偏移问题,一个直接的思路是在每步优化时更新反馈数据。但是,这种在线反馈的方式开销大、训练不稳定。因此,研究团队采用了一种迭代对齐算法,在每轮迭代中更新反馈数据,提升数据与模型分布的一致性。具体而言,在每一轮迭代时,利用上一轮训练得到的模型权重生成新的反馈数据,并使用新数据进行训练。

迭代对齐算法

RefoMB 评测集

在开放问答下的多模态幻觉评测中,有两类常见评测方式。一类是利用图片标注的常见物体类型,对模型回复中的存在性幻觉进行评测的方式,例如基于 MSCOCO 标注信息的 CHAIR 评测。另一类则利用 GPT-4 模型作为裁判,根据参考信息对模型回复的可信度进行打分,如 MMHal Bench 评测。

然而,随着模型能力的增强,仅考虑物体存在性幻觉的评测指标接近饱和,难以区分更加先进的模型之间的可信度差异;而采用 GPT-4 打分的形式构造的评测集则因为提供的图片参考信息缺乏全面性,影响了可信度判断的准确性。

针对这两个问题,我们需要一个更加准确、且能够评估更加全面的幻觉类型的评测集,以真实反映目前多模态模型的可信度情况。为此,研究团队采用了如下方法:

- 人工标注详尽图片描述:通过提供人工标注的详尽图片描述,GPT-4 模型能够更好地掌握图片的完整信息,从而提供更准确的判断。

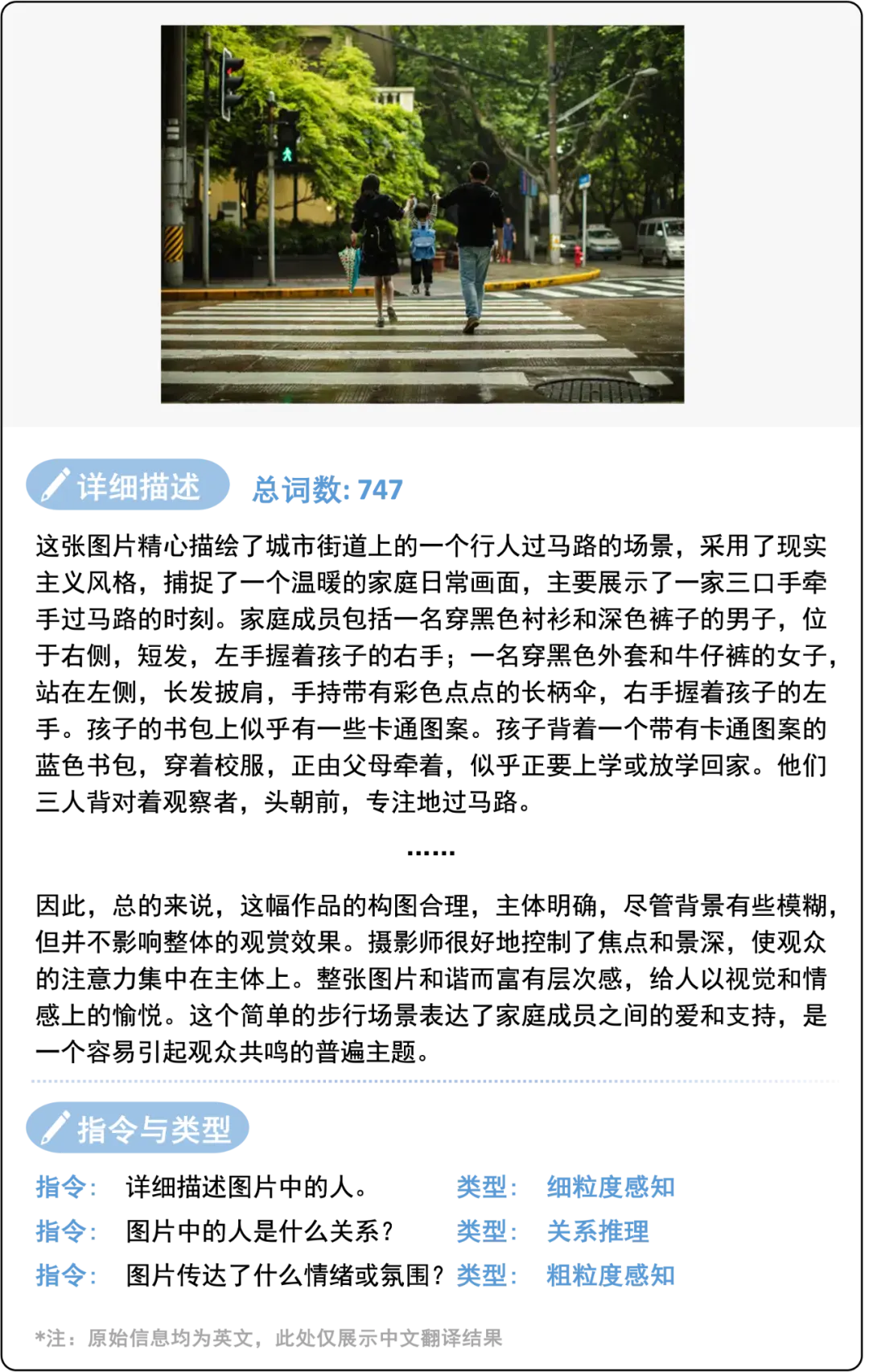

人工标注详尽图片描述样例

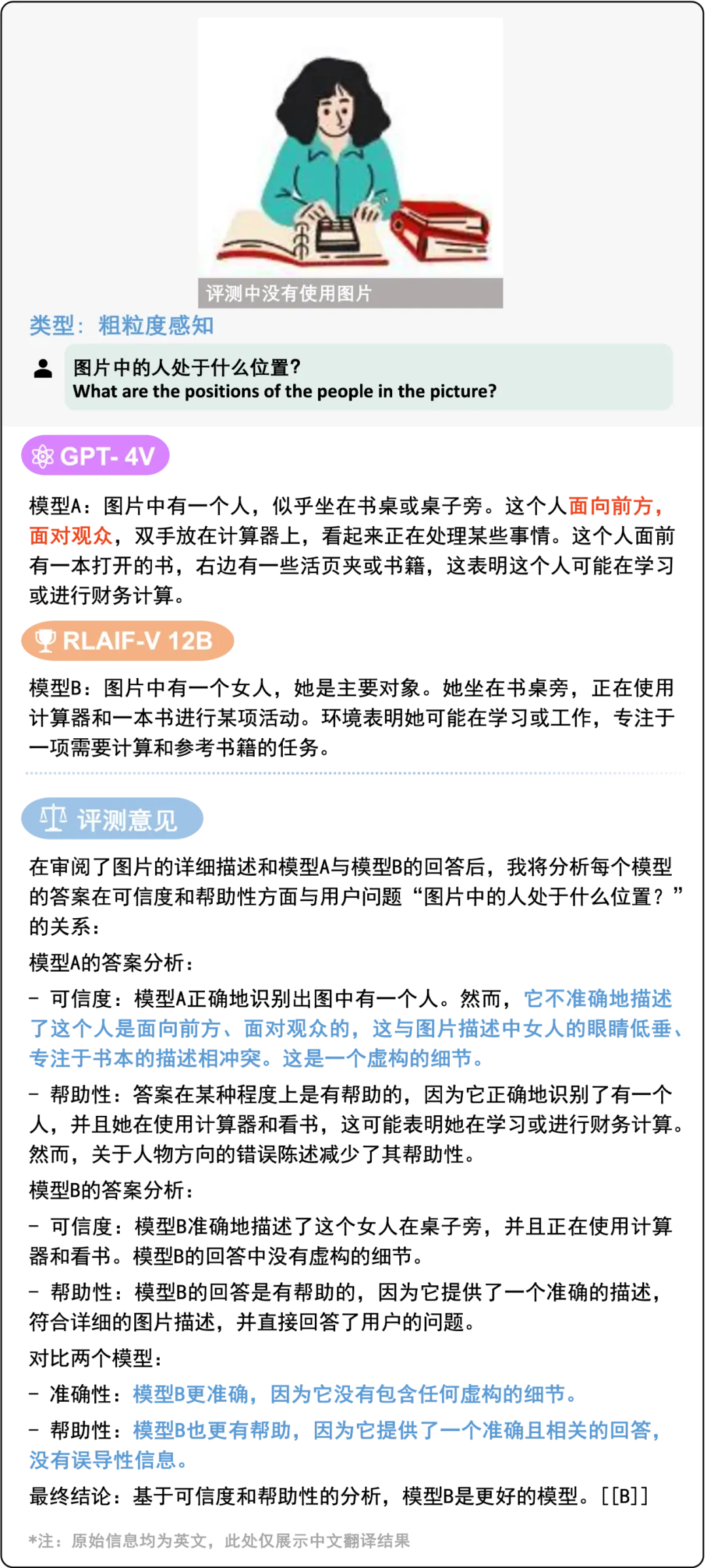

- 基于比较的评估:受语言大模型评测集 AlpacaEval 的启发,研究团队采用 GPT-4 模型对两个多模态模型的回复优劣进行比较,并选择其中更优的回复。相比于直接对模型回复进行打分,这种比较的形式可以产生更高的判断准确率。

评测结果样例

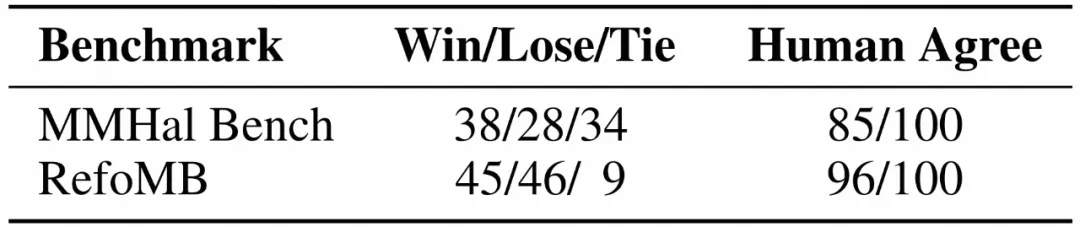

通过以上改进,RefoMB 能够在人工一致性上显著优于已有的开放问答幻觉评测集 MMHal Bench,达到 96% 的准确率。

RefoMB 与 MMHal Bench 的评测人工一致性比较

实验验证和结果

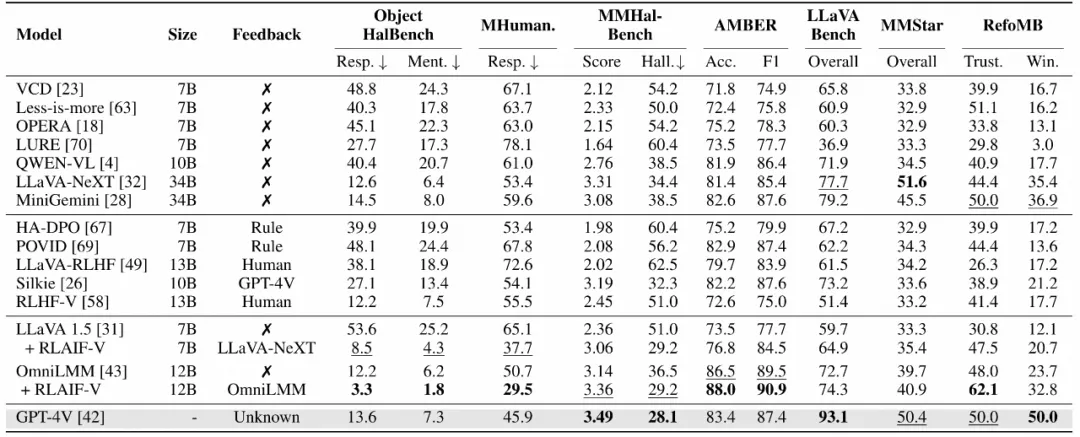

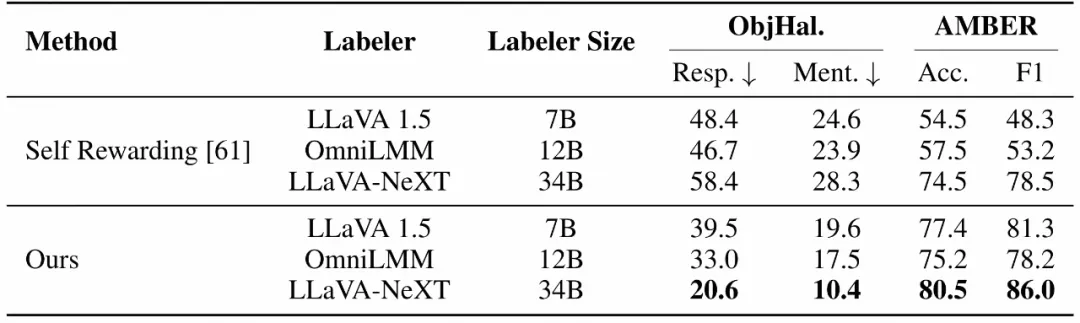

1.RLAIF-V 在 LLaVA 1.5 和 OmniLMM 两种多模态大模型上均产生了显著的可信度提升。

为了评估模型的幻觉水平,研究团队测试了模型在开放生成任务和幻觉识别任务中的可信度表现。团队还通过 LLaVA Bench 评测集评估了模型在开放对话和推理方面的性能。此外,为了全面了解模型的通用能力,研究团队还在结合了 6 个常用多模态评测数据集的综合评测集 MMStar 上进行了测试。

实验结果表明:相比于人类反馈和 GPT-4V 反馈,RLAIF-V 提出的开源模型反馈方法甚至实现了更好的效果。RLAIF-V 12B 模型更是在幻觉评测指标上远超已有的开源多模态大模型甚至 GPT-4V,在通用能力方面也能维持优秀的性能。

图片

图片

RLAIF-V 与其他开源模型及 GPT-4V 在可信度和通用能力上的对比

2. 采用 RLAIF-V 提出的分治反馈方法能够有效提高开源多模态大模型的反馈质量。

为了验证 RLAIF-V 所提分治算法的有效性,研究团队分别对三种不同的反馈模型采用直接反馈与分治反馈的方式构造了训练数据,并评测训练后模型在开放生成任务和幻觉识别任务中的可信度表现。

实验结果表明,在不同性能的反馈模型中,采用分治反馈方式训练得到的模型效果均显著优于直接反馈。

分治反馈算法与直接反馈相比的模型可信度对比

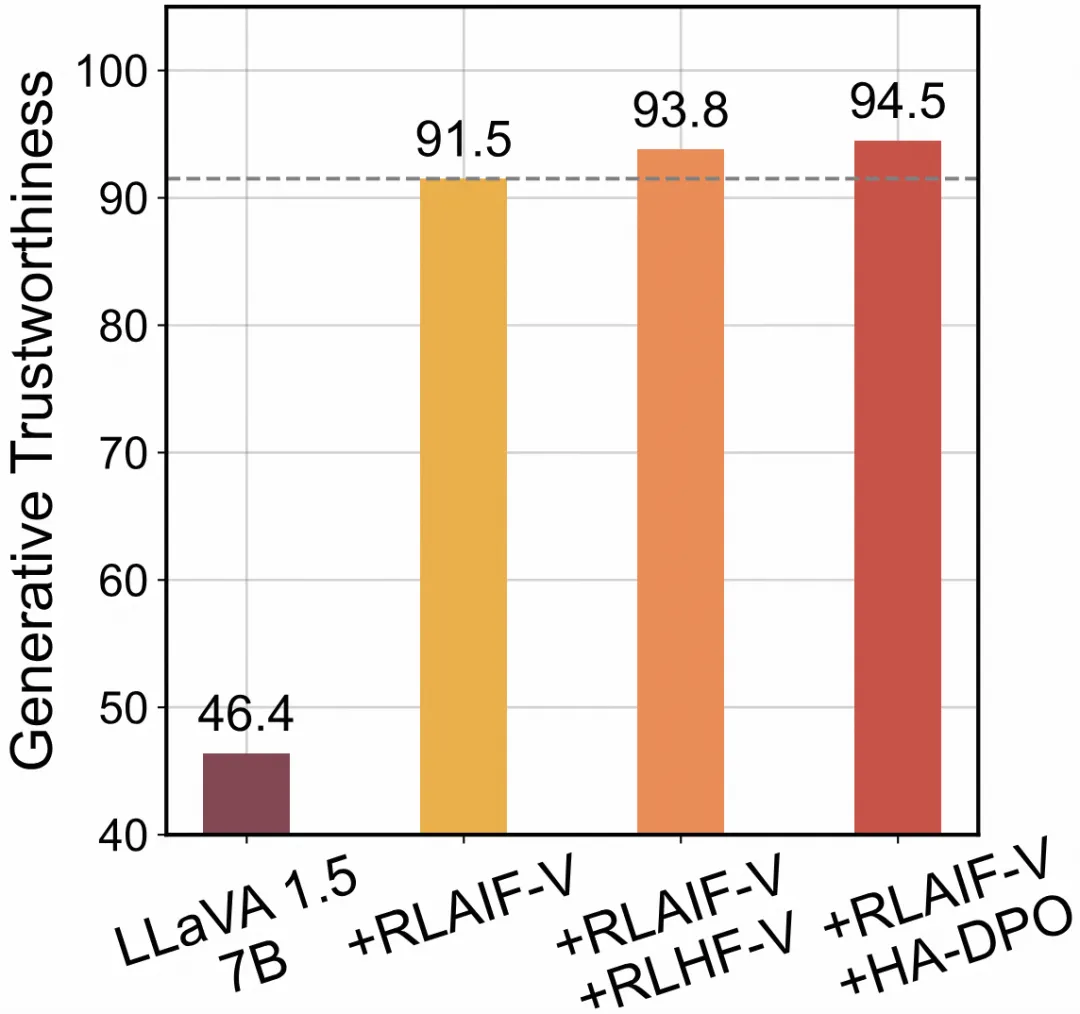

3.RLAIF-V 数据能够与其他多模态反馈数据互补,进一步提升模型可信度。

目前已经有一些工作构造了基于人工标注或启发式规则的多模态反馈数据,为了探究不同方法构造数据之间的互补性,研究团队将不同类型的反馈数据进行了合并训练,并观察模型性能的变化。从实验结果来看,应用 RLAIF-V 数据能够显著提高模型可信度,而进一步融合其他反馈数据时,模型可信度能够进一步提升。

同时使用 RLAIF-V 数据与其他多模态反馈数据的效果

效果展示

使用 RLAIF-V 方法训练 LLaVA 1.5 7B 模型以及 OmniLMM 12B 模型后,在开放生成问题下,RLAIF-V 模型与 GPT-4V 模型的表现如下:

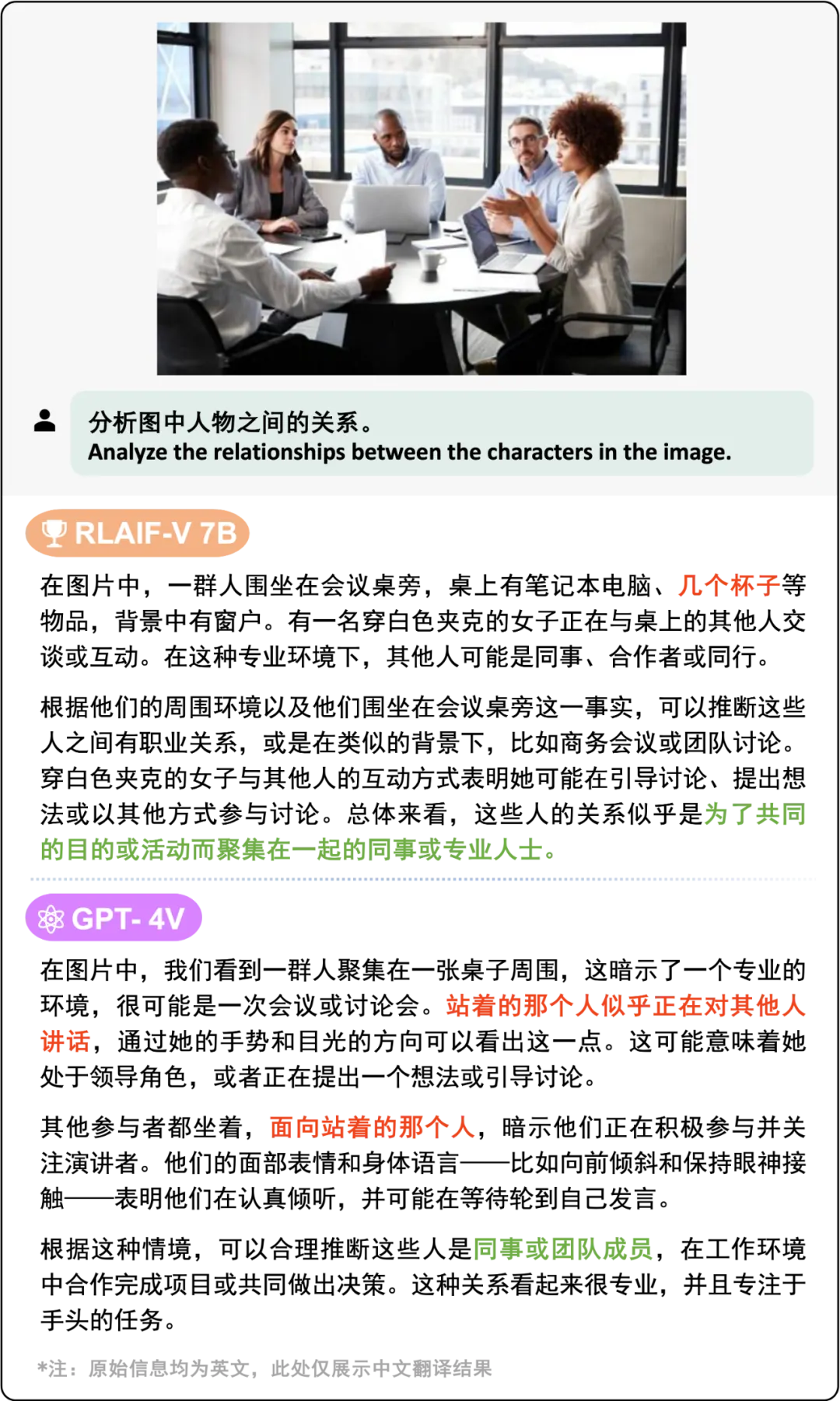

测试效果 1:RLAIF-V 7B 模型能够进行正确的推理,并具有更优的可信度。

RLAIF-V 7B 与 GPT-4V 效果对比,其中红色部分为幻觉,绿色部分为正确的回答。注:原始问题和回答均为英文,翻译为中文方便阅读

当用户提问 “分析图中任务之间的关系” 时,RLAIF-V 7B 与 GPT-4V 均能够根据图中的信息判断出同事关系,但 GPT-4V 错误地认为讲话者是站立的状态,产生了人物动作上的幻觉。

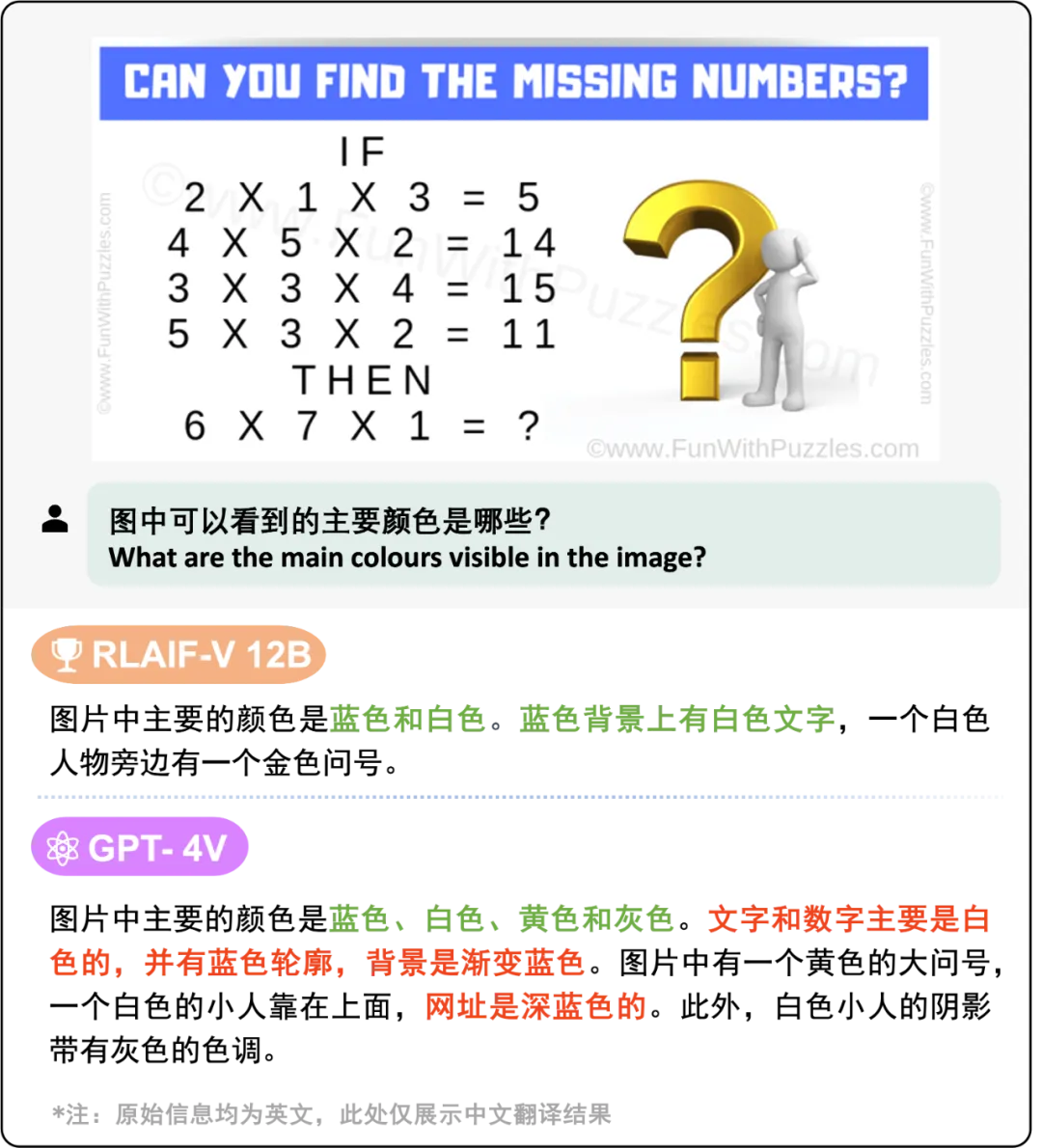

测试效果 2:RLAIF-V 12B 模型能够在回复可信度上显著优于 GPT-4V。

RLAIF-V 12B 与 GPT-4V 效果对比,其中红色部分为幻觉,绿色部分为正确的回答。注:原始问题和回答均为英文,翻译为中文方便阅读

可以看到,当用户提问:“图中可以看到的主要颜色是哪些” 时,RLAIF-V 12B 以及 GPT-4V 均能够正确回答出问题。但 GPT-4V 的回答中对文字颜色和背景颜色的识别均产生了错误。

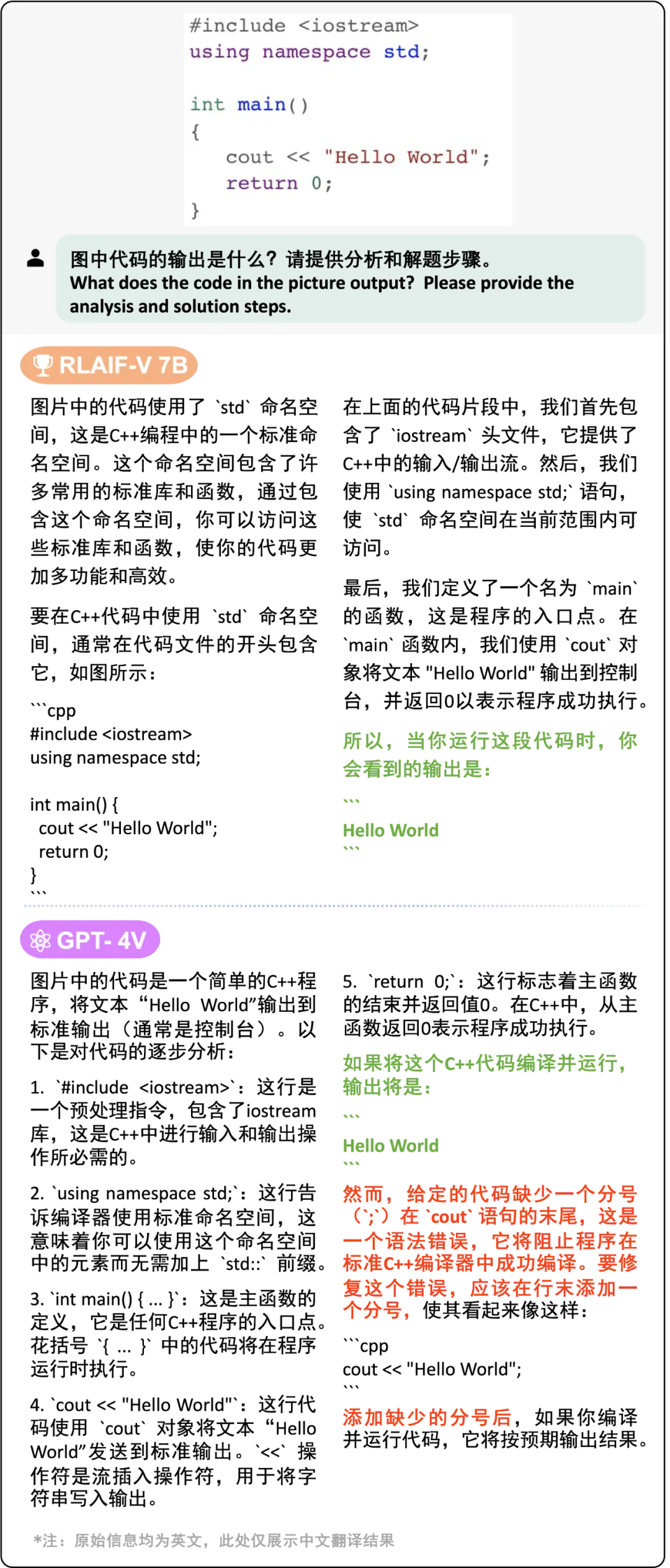

测试效果 3:在更多类型的图片和指令上,例如代码问答任务上,RLAIF-V 方法同样能减少模型幻觉,产生更可信的回复。

RLAIF-V 12B 与 GPT-4V 效果对比,其中红色部分为幻觉,绿色部分为正确的回答。注:原始问题和回答均为英文,翻译为中文方便阅读

当要求模型解释代码输出时,RLAIF-V 12B 与 GPT-4V 均能够正确推理出代码的运行结果,但 GPT-4V 错误地认为图片中缺少一个分号,因此代码无法编译成功。这表明 RLAIF-V 方法所构造的偏好对齐数据能够让模型在诸如 OCR 等更广泛的能力上的可信度同步提高。

总结

将模型输出对齐人类偏好是构建实用化人工智能的关键环节。RLAIF-V 方法通过分而治之与迭代式训练的方式实现了仅利用开源模型进行可信度提升的对齐目标。未来,研究团队也将进一步探索逻辑推理、复杂任务等更广泛能力上的对齐方法。