以ChatGPT与Sora为代表的AIGC技术,正在以令人惊叹的自动化、智能化能力席卷文字创作、软件开发、影视后期等领域。打工人的“技能树”上若缺少了AI方向的技能,都可能会让自己在AI时代的竞争力大幅降低。那么不妨猜猜看,一向会第一时间利用各类新技术的黑客,会不会把AI技术融入到自己的攻击流程中?

那是必然的!

延伸阅读,点击链接了解 Akamai cloud-computing

攻防两端,AI应用并非对称发展

双刃剑一般的生成式AI一方面能帮助企业员工释放生产力;但到了黑客手中,也会成为一种发起狂轰滥炸饱和式攻击的智能化武器。近期,文生视频大模型Sora高逼真度的人物形象塑造,就在惊艳业界的同时,让人不禁担心同类技术是否会被黑客滥用于深度伪造的“换脸”社会工程攻击上。而很快就出现了一个实例:有网络犯罪分子通过AI换脸技术巧设圈套,诈骗香港职员2亿港币。

除了来自外部的威胁会用到AI,随着企业内部对AI的应用逐渐深入,这也会导致出现一些新的挑战。AI高度普及的大趋势下,AI工具正在纳入多行业的工作流程中。Forrester研究咨询公司预测,2024年有60%员工会在工作中使用自己的AI工具,但这会带来监管和合规性挑战。因为这是一种员工自知、公司层面未知的影子AI。譬如,这种员工可能会使用AI扫描数百个PPT内容,一旦扫描内容涉及企业机密,便有可能存在数据泄露的风险。

很多企业已经注意到这种情况,并开始采取一定的措施。IBM GenAI安全报告数据显示,51%高管们表示,去年自己在AI网络安全方面的预算相比2021年增加了51%。预计到2025年,预算将进一步增加43%。

那么有了想法和目标,具体又该如何应对?既然是AI造成的威胁,能否用AI技术来防范?答案是肯定的!

AI已成为影响云安全的新“变量”

攻击多样化

黑客对AI的武器化滥用,正在催化与激化出多种多样的安全风险,包括由于ML模型缺陷导致的敏感数据泄露,以及恶意行为者滥用AI实施的网络钓鱼或社会工程攻击。此外,AI生成的文本、图像、视频等内容作品,也存在潜在的版权风险。

常见AI风险威胁 | ||

社会工程 | 勒索病毒 | 网络钓鱼 |

数据投毒 | 数据泄露 | 版权侵害 |

攻击界面增加

AI大模型在企业间的普及应用,得益于云服务提供的巨量算力。为实现低延迟、高可靠的响应速度,企业更需要使用云端的计算、存储、网络资源。从集中式的云端,到分布式的边缘区域,当下的攻击界面已延展至边缘数据中心,以及更多的边缘设备和应用系统(如物联网),这让安全的防护逻辑也更趋向于边缘侧,中心化的安全架构将很难实现AI架构的安全需求。

边缘安全关注点 | ||

边缘位置 | 边缘设备 | 边缘威胁 |

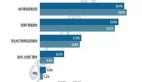

攻击巨量高频

基于AI武器化工具的自动化能力,黑客发起攻击的体量与频次持续飙升。威胁情报公司SlashNext报告显示,从2022年底到2023年第三季度,恶意网络钓鱼邮件出现了1265%的增幅。应对海量高频的攻击体量,仅依靠企业IT团队的人工运维,将不足以构筑强有力的安全防线。

AI时代,Akamai给出四大云安全对策

鉴于“黑客 + AI”所进化出的高频、多样、大面积攻击形态,2024年将成为企业夯实AI云安全基础的关键一年。在多种攻击样式中,上文提及的社会工程攻击已成为网络犯罪分子的首选武器。黑客通过精心巧设的骗局手法,从财务、人事等非IT部门雇员入手,撕开企业的安全缺口。

针对AI的安全防御缺口有多大呢?相关数据显示,有94%的高管已意识到部署AI解决方案之前确保安全非常重要;但在未来六个月内,仅有24%创新型AI项目,将包含网络安全组件。

为什么层出不穷的网络犯罪分子总是能策划出“令人信服”的高仿钓鱼邮件、仿冒网站、假面会议等骗局?这是由于借助AI更容易查到受害者的个人隐私信息、生物信息、社会关系信息,并通过生成式AI技术进行深度模拟与伪造。面对从种种维度渗透入侵的攻击“诱饵”,整个数字化社会与企业组织全员,都需要提升云安全素养,展开针对恶意AI的“全员反诈”。

为了帮助企业构筑安全防线,善用AI提升安全识别力,Akamai提出了下列四条对策:

- 定期展开云安全培训,培养全员AI应用素养:泛滥于视频宣传等领域的AI深度伪造,对舆论的影响力和破坏力惊人。全社会与企业组织成员,均需展开相关培养,培养全员AI素养来提升识别欺诈的意识,以及安全应用AI的标准操作。

- 不仅仅依赖IT部门,全员协同共构安全防线:多云与边缘创新趋势下,攻击界面持续扩张,API与供应链攻击无孔不入。由于AI架构的变化以及AI工具使用范围的扩大,整个的安全体系更需要下沉,组织不仅要借助IT部门预测不断变化的威胁,还要定期评估组织的整体安全和风险态势,全员共构安全防线。

- 真正做好安全基础工作,仍然是第一防御要务:从AI基础架构、核心组件、通信协议、基础算法等方面,依旧存在传统的安全威胁。要做好AI的安全防护,更需要在威胁的识别、可视化、零信任、微隔离、API安全等方面,夯实安全基础防护。防控AI大模型的数据泄露风险,即可采用零信任架构与API可视化和行为分析。

- 用AI点亮安全视野,提升全域威胁可见性:以AI对抗AI是当下的一大云安全策略。利用AI的深度学习能力,建立攻击识别模型,提升攻击识别度、降低误报率。Akamai云安全产品中便融合有深度学习算法,可助力企业客户对恶意爬虫与钓鱼攻击的识别;借助AI大模型能力,还能够收集到更多威胁情报,通过深度分析得到更精准的威胁感知和预警。

应对黑客在滥用AI上所取得不对称优势,Akamai现有传统人工智能类产品能力,可以帮助客户检测到“异常情况、攻击情况、碰撞攻击、帐号盗用”等风险,在安全事件发生前提升对威胁的可见性。

基于ML算法构建的三大优势

1、可扩展性

对于Akamai全球智能云平台捕获的大量数据,可由机器学习算法来完成分析,以此来应对黑客的规模化饱和攻击的巨大体量。

2、动态识别

机器学习算法对于攻击的识别,并非静态的签名模式,而是可以动态提取字段,多角度进行赋分、判别攻击的类别和等级。

3、自动运维

机器学习算法获得新数据时,会更新规则、动态调整策略,采用Deny模式,进而解放安全运维的人力操作,智能实现安全策略的部署、检测、优化等功能。

同时,面对层出不穷的网络钓鱼、勒索软件攻击、DDoS高峰恶意流量冲击等AI助攻下的巨量威胁,Akamai也有针对性地积淀与构建了一系列云安全产品线,缓解AI所带来的潜在安全威胁。

注入AI能力的云安全产品矩阵

Akamai App & API Protector

提供给自适应安全保护引擎,自动为企业的应用程序和API推送更新的保护措施;借助Akamai管理的更新和机器学习赋能的自主调优,可尽可能减少工作量,无需进行耗时的手动维护。

Akamai Bot Manager

使用AI模型检测高级爬虫程序,进行用户行为分析、浏览器指纹识别等主动安全防御;基于每天数十亿的爬虫程序请求和登录,从更真实、更具价值的数据中获取情报。

Akamai Guardicore Segmentation

输出全域IT基础架构的动态安全图谱,查看用户实时和过往的进程级颗粒度活动,借助AI建议、用于修复勒索软件和常见案例的模板以及精确工作负载属性,跨混合云、本地和传统系统保护关键资产,实现更具精细粒度的AI微分段模式。

Akamai Hunt

Akamai Hunt托管威胁搜寻服务,在收集到分段部署的本地数据和DNS传感器中全局数据等信号源后,可以将AI/ML分析应用于多个遥测源和收集的信号,快速检测威胁;随后,通过详细的实时告警提供相关见解和抵御威胁的安全信息。

云边一体,AI向未来

回顾Akamai云安全创新历程,自2016年以来,Akamai一直在利用深度学习AI帮助客户部署安全解决方案。借助AI工具支持分析和分类Akamai每天观察到的超过450TB新攻击数据和11万亿次DNS查询,构建有全球范围内的云安全可见性。

伴随着企业愈发需在边缘获取高性价比、高稳定性、超低延迟的算力资源与安全防护,Akamai也在持续研究如何更好地使用大语言模型和生成式AI, 未来将进一步增强Akamai Connected Cloud等云计算、云安全、云分发产品矩阵效能,助力客户贴近终端用户的计算、安全与内容交付需求,焕新智能开发与安全运维体验,全方位释放生产力,加速全球化市场布局。

如您所在的企业也在考虑采购云服务或进行云迁移,

点击链接了解Akamai Linode的解决方案