Ollama

Ollama 是一个开源的大型语言模型(LLM)服务工具,它允许用户在本地机器上运行和部署大型语言模型。Ollama 设计为一个框架,旨在简化在 Docker 容器中部署和管理大型语言模型的过程,使得这一过程变得简单快捷。用户可以通过简单的命令行操作,快速在本地运行如 Llama 3 这样的开源大型语言模型。

应用模型

注意:推荐下载 GGUF文件格式的模型,可以快速简洁的导入 Ollama 中。

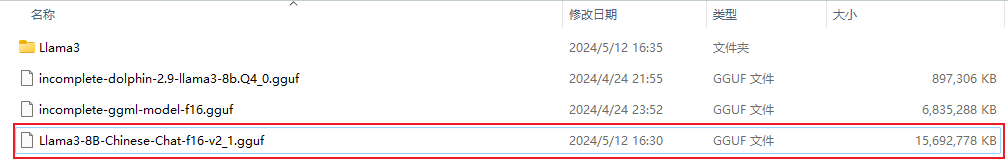

0X01 下载模型文件

下载地址:https://huggingface.co/shenzhi-wang/Llama3-8B-Chinese-Chat-GGUF-8bit/tree/main。

下载 Llama3-8B-Chinese-Chat-q8_0-v2_1.gguf 模型文件。

图片

图片

0X02 编写模型文件

Modelfile文件内容如下:

0X03 创建 Ollama 模型

使用ollama create命令可以根据Modelfile创建一个新的模型:

这个命令会读取Modelfile中的配置,并创建一个名为tinywan-Llama3-8B-Chinese的新模型。

通过命令ollama list查看模型列表:

0X04 运行 Ollama 模型

使用 ollama run 命令来验证tinywan-Llama3-8B-Chinese新模型:

模型测试

REST API

除了命令行界面,OLlama还提供了REST API,使得您可以通过HTTP请求与模型交互。这对于在Web应用程序中集成ollama尤其有用。

请求

要生成模型的响应,您可以发送一个POST请求到 /api/generate:

响应

返回一个JSON对象流:

更多了解:https://github.com/ollama/ollama/blob/main/docs/api.md

meta-llama

项目开源地址:https://github.com/meta-llama/llama3

图片

图片

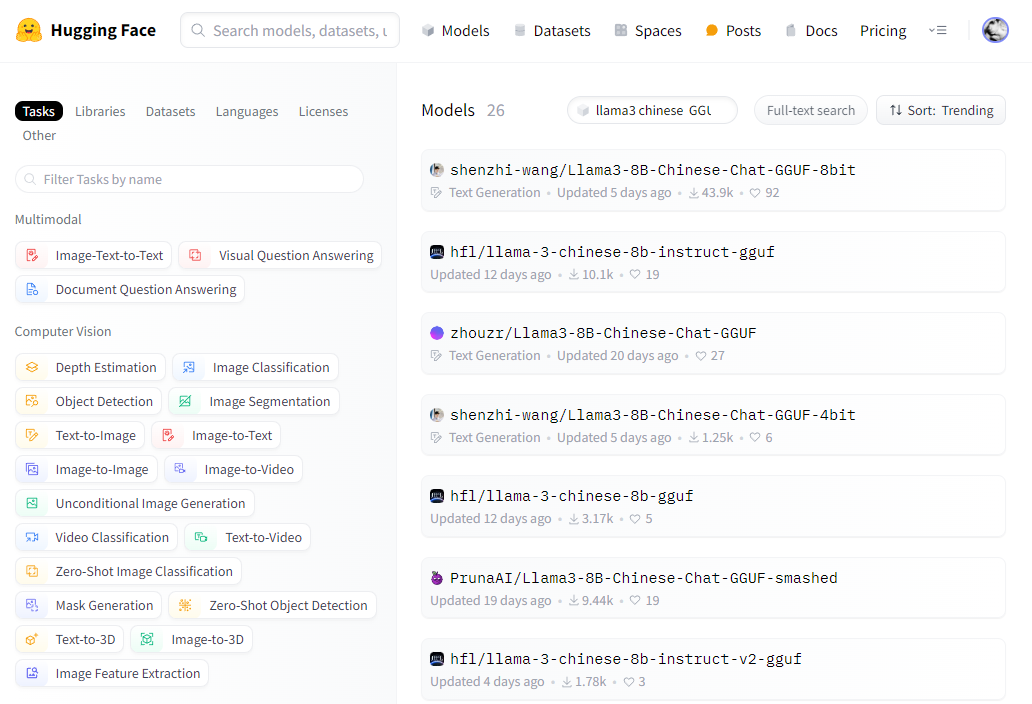

模型下载直接在在Hugging Face上下载就是了。模型地址:https://huggingface.co/models。

注意:推荐下载GGUF文件格式的模型,可以快速简洁的导入Ollama中。有了gguf格式的模型文件这样就不需要通过llama.cpp项目进行模型格式转换了。

图片

图片

其他

删除模型

如果需要删除一个本地的模型,可以使用ollama rm命令。这将从您的本地环境中删除名为my-model的模型。

复制模型

您可以使用ollama cp命令复制一个模型,创建一个新的模型副本: