当前人工智能技术面临的最大风险是大语言模型(LLM)和生成式人工智能技术的发展和应用速度已经远远超过了安全和治理的速度。

OpenAI、Anthropic、谷歌和微软等公司的生成式人工智能和大语言模型产品的使用正呈指数级增长。与此同时,开源大语言模型方案也在高速成长,HuggingFace等开源人工智能社区为技术社区提供了大量开源模型、数据集和AI应用。

为了追赶人工智能的发展脚步,OWASP、OpenSSF、CISA等行业组织正在积极开发和提供人工智能安全与治理关键资源,例如OWASP AI Exchange、AI安全和隐私指南以及大语言模型十大风险清单(LLMTop10)。

近日,OWASP发布了大语言模型网络安全与治理清单,填补了生成式人工智能安全治理的空白,具体内容如下:

OWASP对AI类型与威胁的定义

OWASP大语言模型网络安全与治理清单对人工智能、机器学习、生成式人工智能和大语言模型之间的区别给出了定义。

例如,OWASP对生成式人工智能的定义是:一种专注于创建新数据的机器学习,而大语言模型是一种用于处理和生成类人文本的人工智能模型——它们根据所提供的输入进行预测,并且输出是类似人类产生的“自然内容”。

对于此前发布的“大语言模型十大威胁清单”,OWASP认为它可以帮助网络安全从业者跟上快速发展的AI技术,识别关键威胁并确保企业拥有基本的安全控制措施来保护和支持采用生成式人工智能和大语言模型的业务。但OWASP认为该清单并不详尽,而且需要根据生成式人工智能的发展而不断完善。

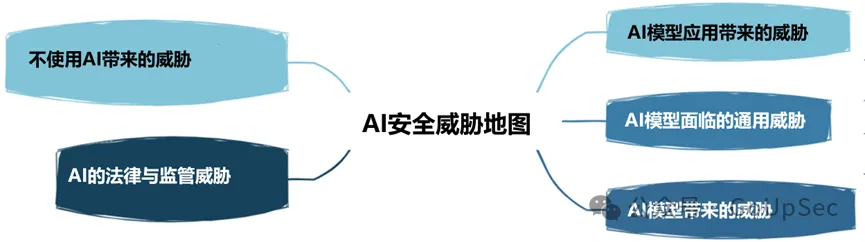

OWASP将AI安全威胁分为以下五种:

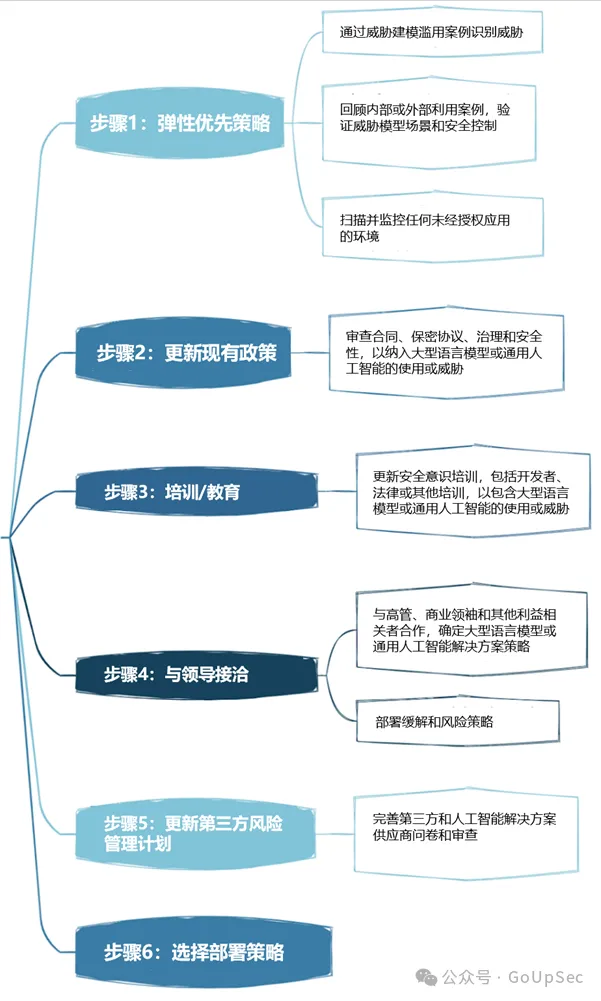

OWASP的大语言模型安全治理策略部署分为六步:

以下是OWASP大语言模型网路安全与治理清单:

1.对手风险

大语言模型的对手风险不仅涉及竞争对手,还涉及攻击者,其关注点不仅是攻击态势,还包括商业态势。这包括了解竞争对手如何使用人工智能来推动业务成果,以及更新内部流程和政策(例如事件响应计划(IRP)),以应对生成式人工智能攻击和事件。

2.威胁建模

威胁建模是一种日益流行的安全技术,随着安全设计系统理念的推广而获得越来越多的关注,得到了美国网络安全和基础设施安全局(CISA)等权威机构的认可。威胁建模需要思考攻击者如何利用大型语言模型和生成式人工智能来加速漏洞利用,企业检测恶意大型语言模型的能力,以及组织是否能够保护大型语言模型和生成式人工智能平台与内部系统和环境的连接。

3.人工智能资产清单

“你无法保护未知的资产”这句格言也适用于生成式人工智能和大语言模型领域。OWASP清单的这部分内容涉及对内部开发的人工智能解决方案以及外部工具和平台进行人工智能资产清单编制。

OWASP强调,企业不仅要了解内部使用了哪些工具和服务,还要了解其所有权,即谁对这些工具和服务的使用负责。清单还建议将人工智能组件包含在软件材料清单(SBOM)中,并记录人工智能数据源及其各自的敏感性。

除了对现有人工智能工具进行清单编制之外,企业还应该建立一个安全流程将未来的AI工具和服务添加到清单中。

4.人工智能安全和隐私意识培训

人们常说“人是最大的安全漏洞”,企业只有将人工智能安全和隐私培训合理集成到其生成式人工智能和大语言模型的应用过程中,才能极大缓解人的风险。

这包括帮助员工了解现有生成式人工智能/大语言模型计划、技术及其功能,以及关键的安全注意事项,例如数据泄漏。此外,建立信任和透明的安全文化至关重要。

企业内部的信任和透明文化也有助于避免影子AI威胁,否则,员工将“偷偷“使用影子AI而不告诉IT和安全团队。

5.人工智能项目的商业论证

就像云计算一样,大多数企业实际上并没有为生成式人工智能和大语言模型等新技术应用制定连贯的战略性商业论证,很容易盲目跟风,陷入炒作。没有合理的商业论证,企业的人工智能应用很可能会产生糟糕结果并增加风险。

6.治理

没有治理,企业就无法建立人工智能的责任机制和明确目标。OWASP清单建议企业为人工智能应用制定RACI图表(责任分配矩阵),记录并分配风险责任和治理任务,建立全企业范围的人工智能政策和流程。

7.法律

随着人工智能技术的飞速发展,其法律影响不容低估,并可能在给企业带来财务和声誉的重大风险。

人工智能法务涉及一系列活动,例如人工智能产品质保、人工智能最终用户许可协议(EULA)、使用人工智能工具开发的代码的所有权、知识产权风险和合同赔偿条款等。简而言之,请确保企业的法律团队或专家了解企业使用生成式人工智能和大语言模型时应该开展的各种配套法律活动。

8.监管

人工智能监管法规也在迅速发展,例如欧盟的人工智能法案,其他国家和地区的法规也将很快出台。企业应该了解所在国家的人工智能合规要求,例如员工监控,并清楚地了解其人工智能供应商如何存储和删除数据以及如何监管其使用。

9.使用或实施大语言模型解决方案

使用大型语言模型解决方案需要考虑特定的风险和控制措施。OWASP清单列出了诸如访问控制、训练管道安全、映射数据工作流以及了解大型语言模型模型和供应链中存在的或潜在的漏洞等项目。此外,还需要对供应商进行第三方审计、渗透测试甚至代码审查,这些工作既要初始进行,也要持续进行。

10.测试、评估、验证和确认(TEVV)

TEVV流程是NIST在其人工智能框架中特别推荐的流程。这涉及在整个人工智能模型生命周期中建立持续的测试、评估、验证和验证,以及提供有关人工智能模型功能、安全性和可靠性的执行指标。

11.模型卡和风险卡

为了合乎道德地部署大语言模型,OWASP清单要求企业使用模型和风险卡,这些卡可用于让用户理解和信任人工智能系统,并公开解决偏见和隐私等潜在的负面后果。

这些卡片可以包含模型详细信息、架构、训练数据方法和性能指标等项目。还强调考虑负责任的人工智能所需要考虑的因素以及对公平和透明度的关注。

12RAG:大语言模型优化

检索增强生成(RAG)是一种优化大语言模型从特定来源检索相关数据能力的方法。它是优化预训练模型或根据新数据重新训练现有模型提高性能的方法之一。OWASP建议企业实施RAG,以最大限度地提高大语言模型的价值和有效性。

13.AI红队

最后,OWASP清单强调了人工智能红队的重要性,后者模拟人工智能系统的对抗性攻击,以识别漏洞并验证现有的控制和防御。OWASP强调,红队应该是生成式人工智能和大语言模型的综合安全解决方案不可或缺的一部分。

值得注意的是,企业还需要清楚地了解外部生成式人工智能和大语言模型供应商的红队服务和系统要求与能力,以避免违反政策,甚至陷入法律麻烦。