在人工智能“战争”中,科技巨头们一直在竞相构建更大的语言模型,一个令人惊讶的新趋势正在出现:小就是新的大。

随着大语言模型 (LLM) 的进展出现一些停滞迹象,研究人员和开发人员越来越多地将注意力转向小语言模型 (SLM)。这些紧凑、高效且适应性强的人工智能模型正在挑战“越大越好”的观念,有望改变我们进行人工智能开发的方式。

LLM 是否开始趋于稳定?

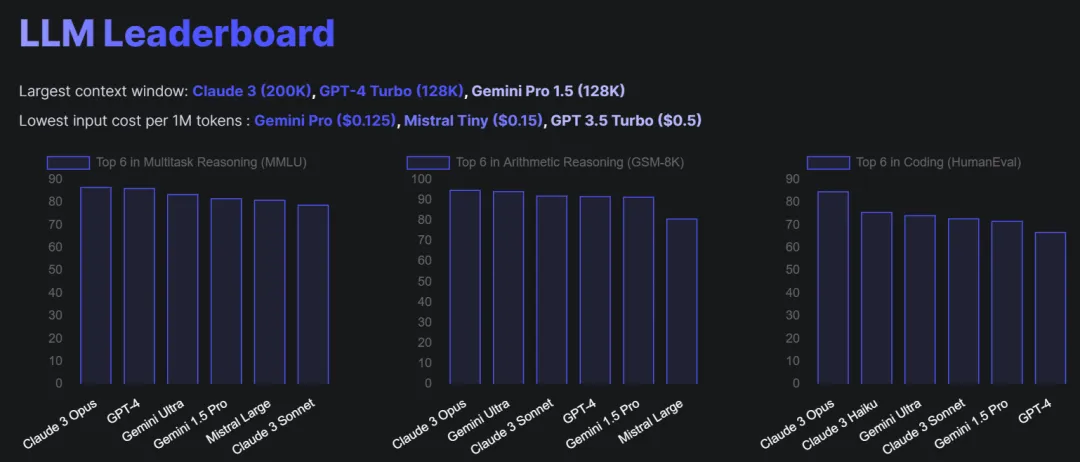

Vellum 和 HuggingFace 最近发布的绩效比较表明,LLM 之间的绩效差距正在迅速缩小。这种趋势在多项选择题、推理和数学问题等特定任务中尤其明显,其中顶级模型之间的性能差异很小。

LLM 排行榜。(来源:vellum)

LLM 排行榜。(来源:vellum)

例如,在选择题中,Claude 3 Opus、GPT-4 和 Gemini Ultra 的得分都在 83% 以上,而在推理任务中,Claude 3 Opus、GPT-4 和 Gemini 1.5 Pro 的准确率都超过 92%。

有趣的是,甚至像 Mixtral 8x7B 和 Llama 2 – 70B 这样的较小模型在某些领域(例如推理和多项选择题)也显示出了有希望的结果,它们在这些领域的表现优于一些较大的模型。这表明模型的大小可能不是性能的唯一决定因素,架构、训练数据和微调技术等其他方面可能发挥重要作用。

Uber 人工智能前负责人、《重启人工智能》(Rebooting AI)一书的作者加里•马库斯(Gary Marcus)表示:“如果你从经验上看,最近发表的十几篇文章都与 GPT-4处于同一领域。”这本书讲述了如何构建值得信赖的人工智能。

“其中一些比 GPT-4 好一点,但没有质的飞跃。我想每个人都会说 GPT-4 比 GPT-3.5 领先了一大步。一年多来没有发生任何[量子跃迁]。”马库斯说。

随着性能差距不断缩小,越来越多的模型展现出有竞争力的结果,这就提出了 LLM 是否确实开始趋于稳定的问题。如果这种趋势持续下去,它可能会对语言模型的未来开发和部署产生重大影响,可能会将重点从简单地增加模型大小转移到探索更高效和专业的架构。

LLM方法的缺点

LLM 虽然无可否认地强大,但也有明显的缺点。首先,训练LLM需要大量的数据,需要数十亿甚至数万亿的参数。这使得训练过程极其耗费资源,训练和运行 LLM 所需的计算能力和能源消耗是惊人的。这导致成本高昂,使得较小的组织或个人很难参与核心的LLM开发。在去年 MIT 的一次活动上,OpenAI 首席执行官 Sam Altman 表示,训练 GPT-4 的成本至少为 1 亿美元。

与 LLM 合作所需的工具和技术的复杂性也为开发人员带来了陡峭的学习曲线,进一步限制了可访问性。对于开发人员来说,从培训到构建和部署模型的周期时间很长,这会减慢开发和实验的速度。

剑桥大学最近发表的一篇论文显示,公司可以花费 90 天或更长时间来部署单个机器学习 (ML) 模型。

论文链接:https://doi.org/10.1145/3533378

LLM 的另一个重要问题是他们容易产生幻觉——产生看似合理但实际上并不真实的输出。这源于 LLM 的训练方式是根据训练数据中的模式预测下一个最可能的单词,而不是真正理解信息。因此,LLM 可以自信地提出虚假陈述、编造事实或以无意义的方式组合不相关的概念。检测和减轻这些幻觉是开发可靠且值得信赖的语言模型的持续挑战。

“如果你用它来解决高风险问题,你不想侮辱你的客户,或者得到不良的医疗信息,或者用它来驾驶汽车并在那里冒险。这仍然是一个问题,”马库斯警告说。

LLM 的规模和黑盒性质也使它们难以解释和调试,这对于建立对模型输出的信任至关重要。训练数据和算法中的偏差可能会导致不公平、不准确甚至有害的输出。

正如谷歌 Gemini 所见,使 LLM “安全”和可靠的技术也会降低其有效性。此外,LLM 的集中性质引起了人们对权力和控制权集中在少数大型科技公司手中的担忧。

输入小语言模型 (SLM)

SLM 是 LLM 的更精简版本,参数更少,设计更简单。他们需要更少的数据和训练时间——几分钟或几个小时,而 LLM 需要几天的时间。这使得 SLM 在现场或较小的设备上实施起来更加高效和直接。

SLM 的主要优势之一是它们适合特定应用。由于它们的范围更集中并且需要的数据更少,因此与大型通用模型相比,它们可以更轻松地针对特定领域或任务进行微调。这种定制使公司能够创建能够非常有效地满足其特定需求的 SLM,例如情绪分析、命名实体识别或特定领域的问答。与使用更通用的模型相比,SLM 的专业性质可以提高这些目标应用程序的性能和效率。

与 LLM 相比,SLM 也不太容易在其特定领域内出现未被发现的幻觉。SLM 通常在特定于其预期领域或应用程序的更窄且更有针对性的数据集上进行训练,这有助于模型学习与其任务最相关的模式、词汇和信息。这种关注减少了产生不相关、意外或不一致输出的可能性。凭借更少的参数和更精简的架构,SLM 不太容易捕获和放大训练数据中的噪声或错误。

人工智能初创公司 HuggingFace 的首席执行官 Clem Delangue 表示,高达 99% 的用例可以使用 SLM 来解决,并预测 2024 年将是 SLM 年。

HuggingFace 的平台使开发人员能够构建、训练和部署机器学习模型,今年早些时候宣布与谷歌建立战略合作伙伴关系。两家公司随后将 HuggingFace 集成到 Google 的 Vertex AI 中,使开发人员能够通过 Google Vertex Model Garden 快速部署数千个模型。

谷歌 Gemma 有些爱

在最初将 LLM 方面的优势让给 OpenAI 后,谷歌正在积极寻求 SLM 机会。早在二月份,谷歌就推出了 Gemma,这是一系列新的小语言模型,旨在提高效率和用户友好性。与其他 SLM 一样,Gemma 模型可以在各种日常设备上运行,例如智能手机、平板电脑或笔记本电脑,无需特殊硬件或广泛优化。

自 Gemma 发布以来,经过训练的模型上个月在 HuggingFace 上的下载量已超过 400,000 次,并且已经出现了一些令人兴奋的项目。

例如,Cerule 是一个强大的图像和语言模型,它将 Gemma 2B 与 Google 的 SigLIP 相结合,并在海量图像和文本数据集上进行了训练。Cerule 利用高效的数据选择技术,这表明它无需大量数据或计算即可实现高性能。这意味着 Cerule 可能非常适合新兴的边缘计算用例。

另一个例子是 CodeGemma,它是 Gemma 的专门版本,专注于编码和数学推理。CodeGemma 提供了针对各种编码相关活动量身定制的三种不同模型,使开发人员更容易使用和高效地使用高级编码工具。

小语言模型的变革潜力

随着人工智能社区不断探索小语言模型的潜力,更快的开发周期、更高的效率以及根据特定需求定制模型的能力的优势变得越来越明显。SLM 准备通过提供经济高效且有针对性的解决方案,实现人工智能访问的民主化并推动跨行业创新。

SLM 在边缘的部署为金融、娱乐、汽车系统、教育、电子商务和医疗保健等各个领域的实时、个性化和安全应用开辟了新的可能性。

通过在本地处理数据并减少对云基础设施的依赖,使用 SLM 的边缘计算可实现更快的响应时间、改善数据隐私并增强用户体验。这种去中心化的人工智能方法有可能改变企业和消费者与技术互动的方式,在现实世界中创造更加个性化和直观的体验。

由于 LLM 面临与计算资源相关的挑战并可能达到性能瓶颈,SLM 的兴起有望使人工智能生态系统以惊人的速度发展。