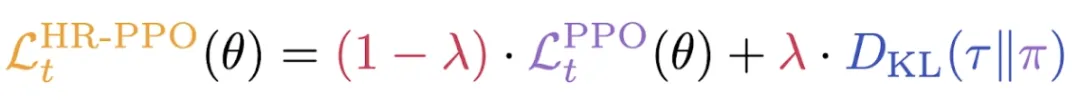

自动驾驶汽车面临的一个核心挑战是如何与人类合作。因此,在模拟环境中,将现实中的人类代理纳入到自主驾驶系统的可扩展训练和评估中至关重要。模拟代理通常是通过模仿大规模、高质量的人类驾驶数据集来开发的。然而,纯粹的模仿学习代理在多代理闭环环境中执行时经验上具有较高的碰撞率。为了构建在闭环设置中既逼真又有效的代理,研究人员提出了一种名为 Human-Regularized PPO(HR-PPO) 的多代理方法,其中代理通过与一个人类参考策略做自我对弈训练,并对偏离人类参考策略的行为施加了小的惩罚。与以往的方法相比,该方法以强化学习为主,仅利用了30分钟的不完美人类示范数据。在大量的多代理交通场景的评估中,HR-PPO 代理在实现目标方面非常有效,成功率达到 93%,越出道路的比率为 3.5%,碰撞率为 3%。与此同时,HR-PPO 代理以类似人类驾驶的方式行驶,在与人类驾驶协调的代理指标上表现出相当大的改进,特别是在高度互动的情景中。

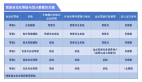

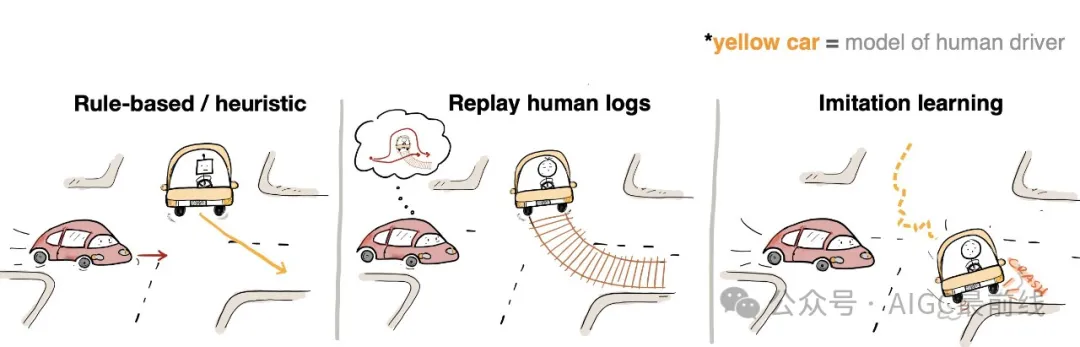

当前的驾驶模拟器提供了基本的交互代理 - 简单的车辆跟随模型、基于规则的代理、记录的人类驾驶日志或模仿学习代理。这些模型无法创建具有挑战性的协调场景,或者在闭环中具有高碰撞率。

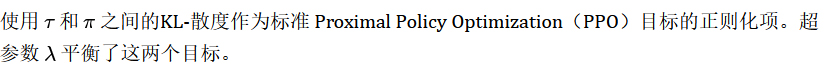

为了构建在闭环设置中既逼真又有效的代理,研究人员提出了Human-Regularized PPO (HR-PPO),一种多代理方法,通过自我对弈训练,并对偏离人类参考策略的行为施加了小的惩罚。

方法

- 步骤1:模仿学习

通过对人类驾驶示范进行模仿学习,获取人类参考策略。

- 步骤2:引导自我对弈

代理在多代理设置中进行训练,每个场景最多可容纳50个代理。目标函数如下:

实验结果

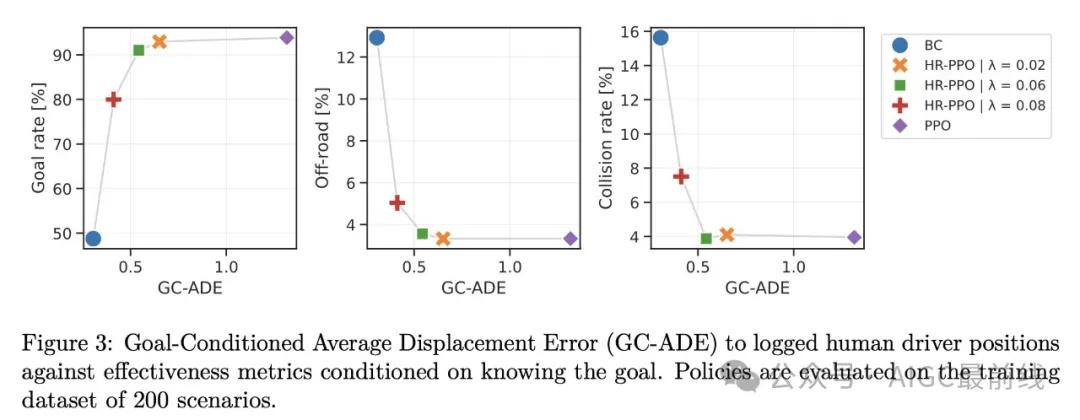

在大量的多代理交通场景中,研究人员发现可以同时实现效果和逼真度。HR-PPO 代理在四种不同逼真度指标上实现了显著的人类相似性改进,同时达到了与 PPO 相似的性能水平。

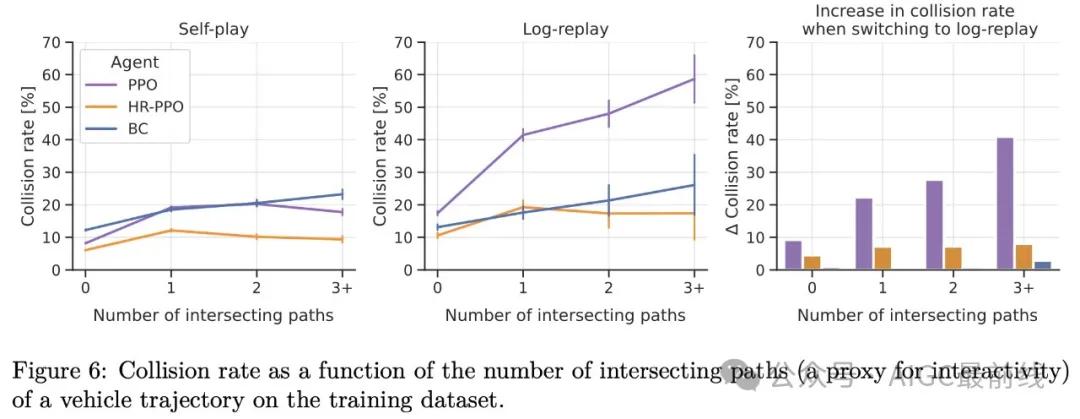

HR-PPO 代理在衡量与人类驾驶协调的代理指标上显示出相当大的改进,特别是在需要代理之间协调的高度互动场景中。在互动场景中,HR-PPO 在 PPO 的基础上提升了 20-40%。

有趣的是,它们甚至表现出比直接在代理的测试分布上训练的代理更好的性能。这表明,多代理训练可能比单一代理训练提供了额外的好处。

为什么 HR-PPO 代理与人类驾驶日志更兼容呢?

- HR-PPO 代理的驾驶风格类似于人类驾驶员,这使得它更容易适应人类驾驶日志的行为;

- HR-PPO 代理与其他车辆保持更多距离,从而降低了碰撞的风险。

译自(有删改):https://sites.google.com/view/driving-partners