初识Kafka:你的现场DJ

Apache Kafka是一个开源的流处理平台,可用于处理和分析实时数据。就像一位DJ,Apache Kafka在数据的洪流之间表现出了无与伦比的调度能力。它可以从各种来源接收大量的实时数据,如跟踪用户的在线活动,或者诸如音频流的持续数据流,然后将这些数据正确分发到等待处理的程序。

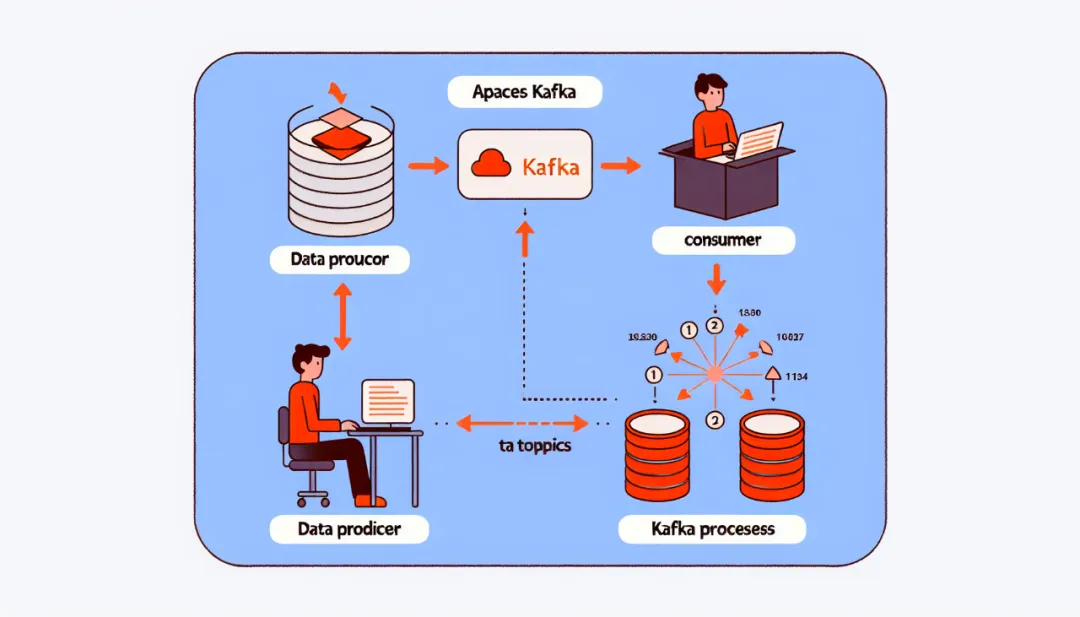

Apache Kafka的核心构件包括Producer(生产者), Consumer(消费者), Broker(代理)和 Topic(主题)。Producer负责接收和发送数据,Consumer从Kafka拉取数据进行处理,所有的读写操作都通过Broker进行调度,并以Topic作为数据的分类依据。

在音乐界的Kafka:强大的实时数据处理引擎

在音乐界,Apache Kafka可以实现榜单的实时更新,对听众的偏好进行实时反馈,甚至还可以跟踪和分析一首歌的流行度。所有这些都依赖于Kafka高效、可靠和可扩展的流处理能力。

以普通的音乐播放器为例,当用户点击播放键时,播放器可以将这个行为作为一个事件发送到Kafka,其他正在监听这个类型事件的应用程序,如排行榜生成器,可以实时接收到这个消息并更新榜单。

创建实时音乐排行榜:Kafka的应用实例

首先,生成一条播放歌曲的事件,并发送到Kafka,这个过程是由Producer来完成的。每当用户点击播放一首歌曲时,前端网页或APP就会生成一条播放歌曲的事件,然后调用后台服务的API,将这个事件发送给后台服务。后台服务接收到这个事件后,将其转化为Kafka所需要的格式,然后调用Kafka Producer API,将这条事件发送到Kafka。这个过程可能需要几十毫秒到几百毫秒,取决于网络速度、代码效率等因素。

然后,Kafka会接收到这条事件,并将其写入存储在硬盘上的日志文件,这个过程通常非常快,只需要几毫秒。同时,Kafka会将这个事件复制到其他的Broker上,以提高数据的可靠性。

接下来,排行榜程序作为Kafka的Consumer,会周期性地读取Kafka的数据。排行榜程序可以设置自己的读取速度,例如每秒读取一次,或者每收到10条新的事件就读取一次等。每次读取,它都会得到一批新的播放歌曲的事件。然后,排行榜程序会把这批新的事件传递给排行榜算法,由算法根据这批事件来更新排行榜的状态。

下面是一个使用Java Kafka客户端API的例子:

生产者发送播放音乐的事件

import org.apache.kafka.clients.producer.*;

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("key.serializer","org.apache.kafka.common.serialization.StringSerializer");

props.put("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

Producer<String, String> producer = new KafkaProducer<>(props);

try {

for(int i = 0; i < 100; i++)

producer.send(new ProducerRecord<String, String>("my-topic", Integer.toString(i), Integer.toString(i)));

}

catch (Exception e) {

e.printStackTrace();

}

finally {

producer.close();

}消费者订阅并处理播放音乐的事件

import org.apache.kafka.clients.consumer.*;

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("group.id", "test");

props.put("enable.auto.commit", "true");

props.put("key.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

props.put("value.deserializer", "org.apache.kafka.common.serialization.StringDeserializer");

KafkaConsumer<String, String> consumer = new KafkaConsumer<>(props);

consumer.subscribe(Arrays.asList("my-topic"));

while (true) {

ConsumerRecords<String, String> records = consumer.poll(100);

for (ConsumerRecord<String, String> record : records)

System.out.printf("offset = %d, key = %s, value = %s%n", record.offset(), record.key(), record.value());

}同时,这个消费者还具有处理数据的职责。通常,我们会使用Multi-Threaded Processing或使用Kafka Streams库来处理大量的并发数据。

图片

图片

常遇到的问题和解决办法:Kafka的最佳实践

在实际使用Kafka时,我们可能会遇到各种问题。以下是一些最普遍的问题以及解决方案的代码示例。

数据延迟:数据延迟可能是由许多因素引起的,包括网络延迟、Kafka系统负载、消息生产者写入的速度、同时处理的消费者的数量,还有Kafka的内部过程延迟等。

使用Kafka Streams进行流处理是一种优化数据延迟的方式。Kafka Streams API允许你在生产者和消费者之间建立流处理管道,实现“实时”处理:

import org.apache.kafka.streams.*;

import org.apache.kafka.streams.kstream.*;

stream = new StreamsBuilder()

.stream("my-input-topic", Consumed.with(Serdes.String(), Serdes.String()))

.mapValues(value -> String.valueOf(value.length())) // Transform the values into their length.

.to("my-output-topic", Produced.with(Serdes.String(), Serdes.String())); // Write back to Kafka.

// Now run the Streams pipeline:

KafkaStreams streams = new KafkaStreams(builder.build(), props);

streams.start();以上代码示例展示了如何运用mapValues操作在Kafka Streams中将值转换为它们的长度。通过创建一系列的流操作,可以实现复杂的数据转换和处理,从而最小化延迟。

数据丢失:Kafka消息可能因为各种删去丢失,如网络问题,系统崩溃或Kafka内部错误等。

为防止消息丢失,你可以设置生产者的acks参数为all,这样生产者会等待所有副本节点的应答。这种方式可以最大限度的防止数据丢失:

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("acks", "all"); // Wait for acknowledgments from all replicas

props.put("retries", 0); // If set to greater than zero the client will resend any record.

Producer<String, String> producer = new KafkaProducer<>(props);在消费者侧,为防止数据丢失,你应该定期提交偏移量,并且在程序启动时从最近提交的偏移量开始消费,这可以防止重复数据和数据丢失:

Properties props = new Properties();

props.put("bootstrap.servers", "localhost:9092");

props.put("group.id", "group1");

props.put("enable.auto.commit", "false");

KafkaConsumer<String, String> consumer = new KafkaConsumer<>(props);

while (true) {

ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(100));

for (ConsumerRecord<String, String> record : records) {

// process record

}

consumer.commitSync(); // manually commit the offset

}以上代码展示了禁用自动提交偏移量,并在处理完记录后手动提交偏移量。

本文介绍了Apache Kafka的基础用法,并通过音乐排行榜实例展示其应用。同时,讨论了如何应对使用中的数据延迟与丢失问题并给出了解决方案。