今天,由 Transformer 作者之一 Aidan Gomez 参与创立的人工智能初创公司 Cohere 迎来了自家大模型的发布。

Cohere 推出的模型名为「Command-R」,参数量为 35B,它是一个针对大规模生产工作负载的全新大语言模型研究版本。该模型属于「可扩展」模型类别,能够平衡高效率和高精度, 使企业用户超越概念验证,进入生产阶段。

作为一种生成模型,Command-R 针对检索增强生成(RAG)等长上下文任务以及使用外部 API 和工具进行了优化。该模型旨在与自家行业领先的嵌入(Embed)和重新排序(Rerank)模型配合使用,为 RAG 应用程序提供一流的集成,并在企业用例中具有出色表现。

就其架构而言,Command-R 是一种使用优化后 transformer 架构的自回归语言模型。在预训练后,模型使用监督微调(SFT)和偏好训练使自身与人类偏好保持一致,并实现有用性和安全性。

具体而言,Command-R 具有以下功能特征:

- RAG 和工具使用方面的高度准确性

- 低延迟、高吞吐量

- 更长的 128k 上下文和更低的价格

- 跨 10 种主要语言的强大功能

- HuggingFace 上提供模型权重以供研究和评估

Command-R 可以在 Cohere 的托管 API 上使用,并在不久的将来在主要云服务商上可用。Command-R 是一系列模型中的首个版本,提高了对企业大规模采用至关重要的功能。

目前,Cohere 在 Huggingface 上开放了模型权重。

Huggingface 地址:https://huggingface.co/CohereForAI/c4ai-command-r-v01

高性能检索增强生成(RAG)

检索增强生成(RAG)已成为大语言模型部署中的关键模式。通过 RAG,企业能够让模型访问原本无法获得的私有知识,搜索私有数据库并使用相关信息形成响应,从而准确性和实用性将显著提升。RAG 的关键组件是:

- 检索:搜索与响应用户相关的信息语料库。

- 增强生成:使用检索到的信息形成更明智的响应。

对于检索,Cohere 的 Embed 模型通过搜索数百万甚至数十亿文档来改善上下文和语义理解,显著提高了检索步骤的实用性和准确性。同时,Cohere 的 Rerank 模型有助于进一步提高检索到信息的价值,优化相关性和个性化等自定义指标的结果。

对于增强生成,通过识别最相关的信息,Command-R 可以总结、分析、打包这些信息,并帮助员工提高工作效率或者创造全新的产品体验。Command-R 的独特之处在于:该模型的输出带有明确的引文,可以降低出现幻觉的风险,并能够从源材料中呈现更多背景信息。

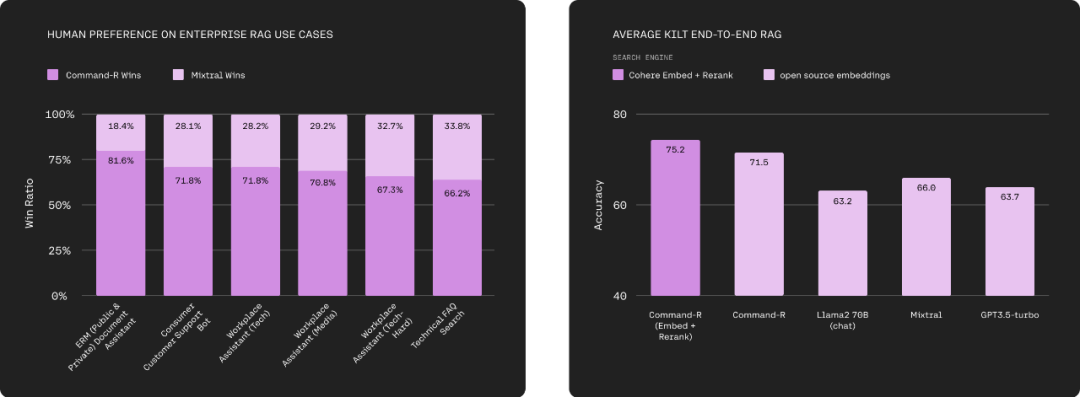

即使不使用自家的 Embed 和 Rerank 模型,Command-R 在可扩展的生成模型类别中也优于其他模型。不过当配合使用时,领先优势显著扩大,从而在更复杂的领域实现更高的性能。

下图左为 Command-R 与 Mixtral 在一系列与企业相关的 RAG 应用上,进行了 Head-to-Head 整体人类偏好评估,充分考虑流畅度、答案实用性和引用。图右为 Command-R(Embed+Rerank)、Command-R 与 Llama 2 70B(chat)、Mixtral、GPT3.5-Turbo 等模型在 Natural Questions、TriviaQA 和 HotpotQA 等基准上的比较结果。Cohere 的大模型实现了领先。

强大的工具使用能力

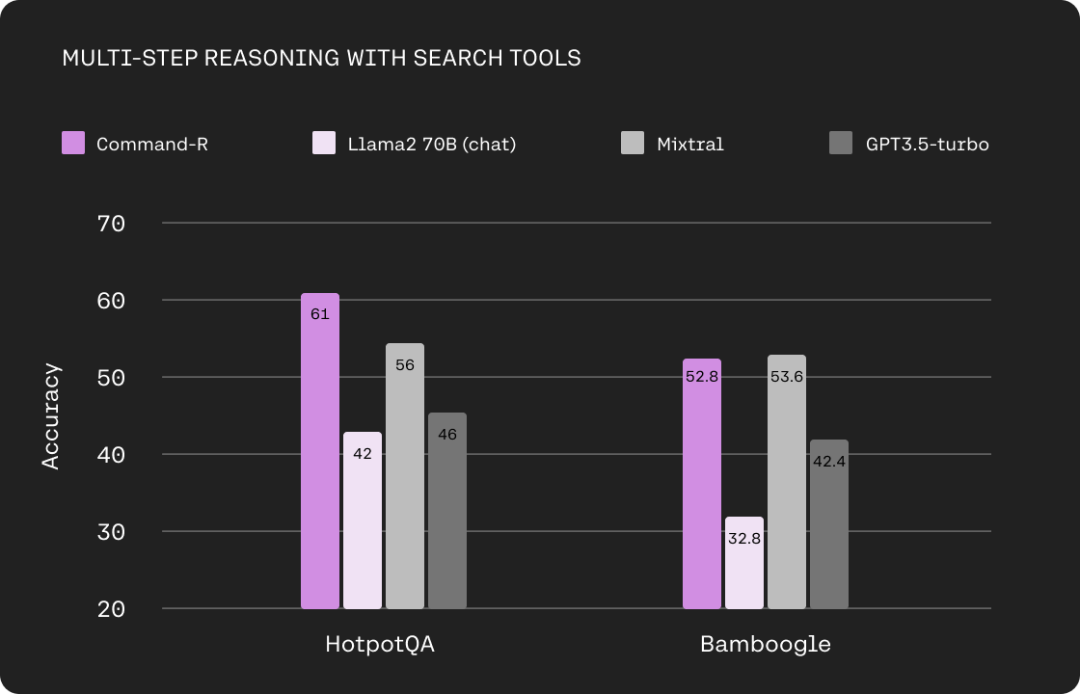

大语言模型应该是核心的推理引擎,可以自动执行任务并采取实际行动,而不仅仅提取和生成文本的机器。Command-R 通过使用工具(API)来实现这一目标,例如代码解释器和其他用户定义的工具,使模型能够自动执行高度复杂的任务。

Tool Use 功能使企业开发人员能够将 Command-R 转变为引擎,以支持需要使用「数据库和软件工具等内部基础设施」以及「CRM、搜索引擎等外部工具」的任务和工作流程的自动化。这样一来,我们可以实现跨多个系统且需要复杂推理和决策的耗时手动任务的自动化。

下图为 Command-R 与 Llama 2 70B(chat)、Mixtral、GPT3.5-turbo,在使用搜索工具时的多步推理能力比较。这里使用到的数据集为 HotpotQA 和 Bamboogle。

多语言生成能力

Command-R 模型擅长全球 10 种主要商业语言,包括英语、法语、西班牙语、意大利语、德语、葡萄牙语、日语、韩语、阿拉伯语和中文。

此外,Cohere 的 Embed 和 Rerank 模型本身就支持 100 多种语言。这使得用户能够从大量数据源中得出答案,无论使用何种语言,都能以母语提供清晰准确的对话。

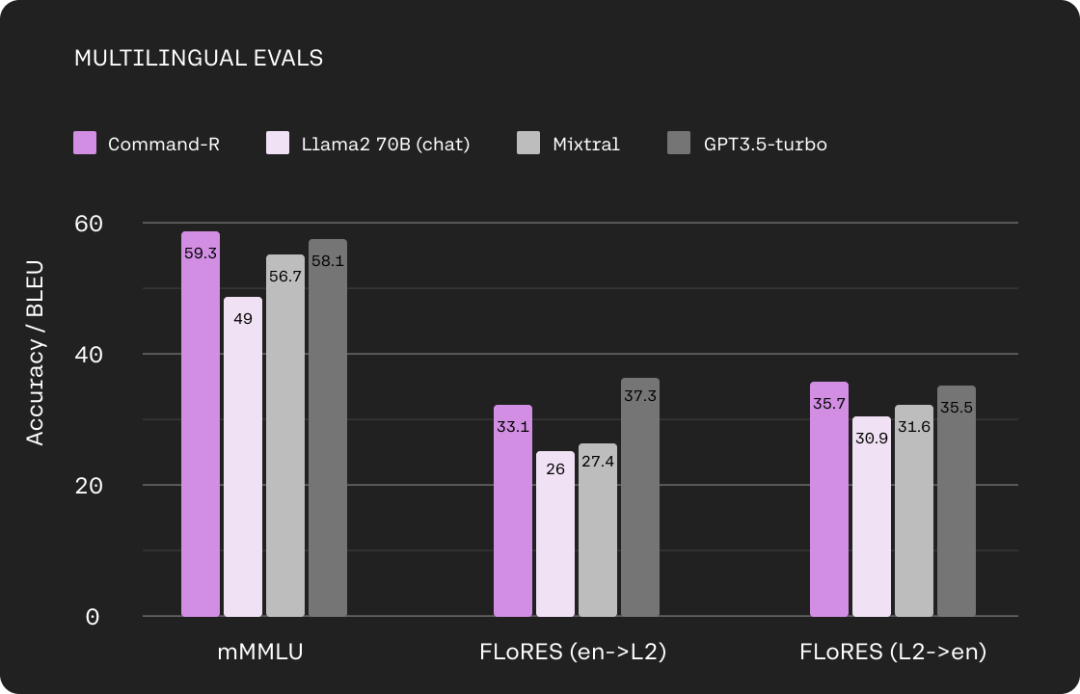

下图为 Command-R 与 Llama 2 70B(chat)、Mixtral、GPT3.5-turbo 在多语言 MMLU 和 FLORES 上的比较。

更长的上下文和更低的价格

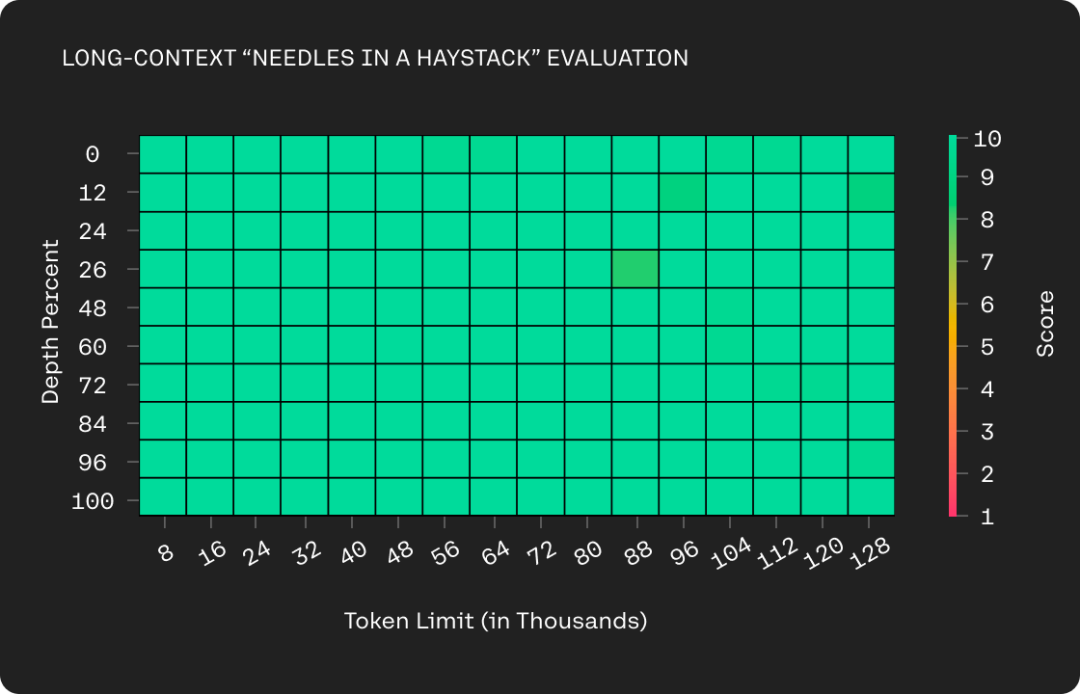

Command-R 支持了更长的上下文窗口 ——128k tokens。此次升级还降低了 Cohere 托管 API 的价格,并显著提高了 Cohere 私有云部署的效率。通过将更长的上下文窗口与更便宜的定价相结合,Command-R 解锁了 RAG 用例,其中附加上下文可以显著提高性能。

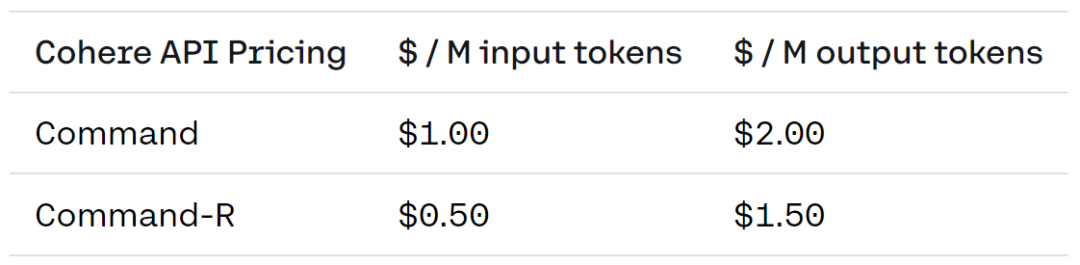

具体定价如下,其中 Command 版本 100 万输入 tokens 1 美元,100 万输出 tokens 2 美元;Command-R 版本 100 万输入 tokens 0.5 美元,100 万输出 tokens 1.5 美元。

不久后,Cohere 还将放出一份简短的技术报告,展示更多模型细节。

博客地址:https://txt.cohere.com/command-r/