这两天,英国王室的 P 图事件闹得沸沸扬扬。

3 月 10 日,威廉与凯特的 X 官方账号分享了一张凯特王妃和 3 个孩子的合影。然而,这张本意为辟谣的照片却掀起了一场「大家来找茬」的游戏,眼尖的网友发现了多处修图痕迹:

还有一些猜测是,这张照片是由 AI 生成的。照片中人物数量比较多,且是相互依靠的动作,AI 直接生成的结果未必有这么自然,但也不能排除「局部 AI 生成」的可能性。

随后,凯特王妃为「发布修改过的照片」正式道歉:「和许多业余摄影师一样,我偶尔也会尝试修图。我想为昨天我们分享的家庭照片引起的任何混乱表示歉意。我希望每个人有一个非常快乐的母亲节。」

在 AI 图片生成技术不断进化的今天,修图已经不一定需要非常复杂的程序。

可以简化到什么程度呢?只要在给模型的提示词的最后加个图片参考链接,就能换脸、换头发、换衣服,而且肉眼绝对看不出瑕疵。

就比如下方这两张 OpenAI CEO 的照片,你会不会以为是山姆・奥特曼在玩 COS?

言归正传,这张图片来自 Midjourney 刚刚发布的一项新功能 ——「角色参考」(Character Reference),让用户几秒之内可以实现「移花接木」。

用过 Stability AI、Midjourney、OpenAI 等公司图像生成产品的人肯定知道,在新生成图像中保持角色一致性曾经是比较困难的事情。

AI 会为输入的每一个提示生成新的内容,即使提示重复出现或使用了一些相同的关键词。这非常适合生成全新的内容,但不适用于有叙事连续性的场景。如果你是为电影、小说或漫画书做设计,肯定希望让一个或多个一模一样的角色出现在不同的场景和环境中,且使用不同的面部表情和道具。

所以这次,Midjourney 引入了一个新标签「-cref」(Character Reference 的缩写),我们可以将其添加到 Midjourney Discord 的文本提示词末尾,让模型从 URL 中匹配角色的面部特征、体型甚至服装。如下图:

这意味着,Midjourney 将从一个创意工具进化为一个提升专业生产力的工具。

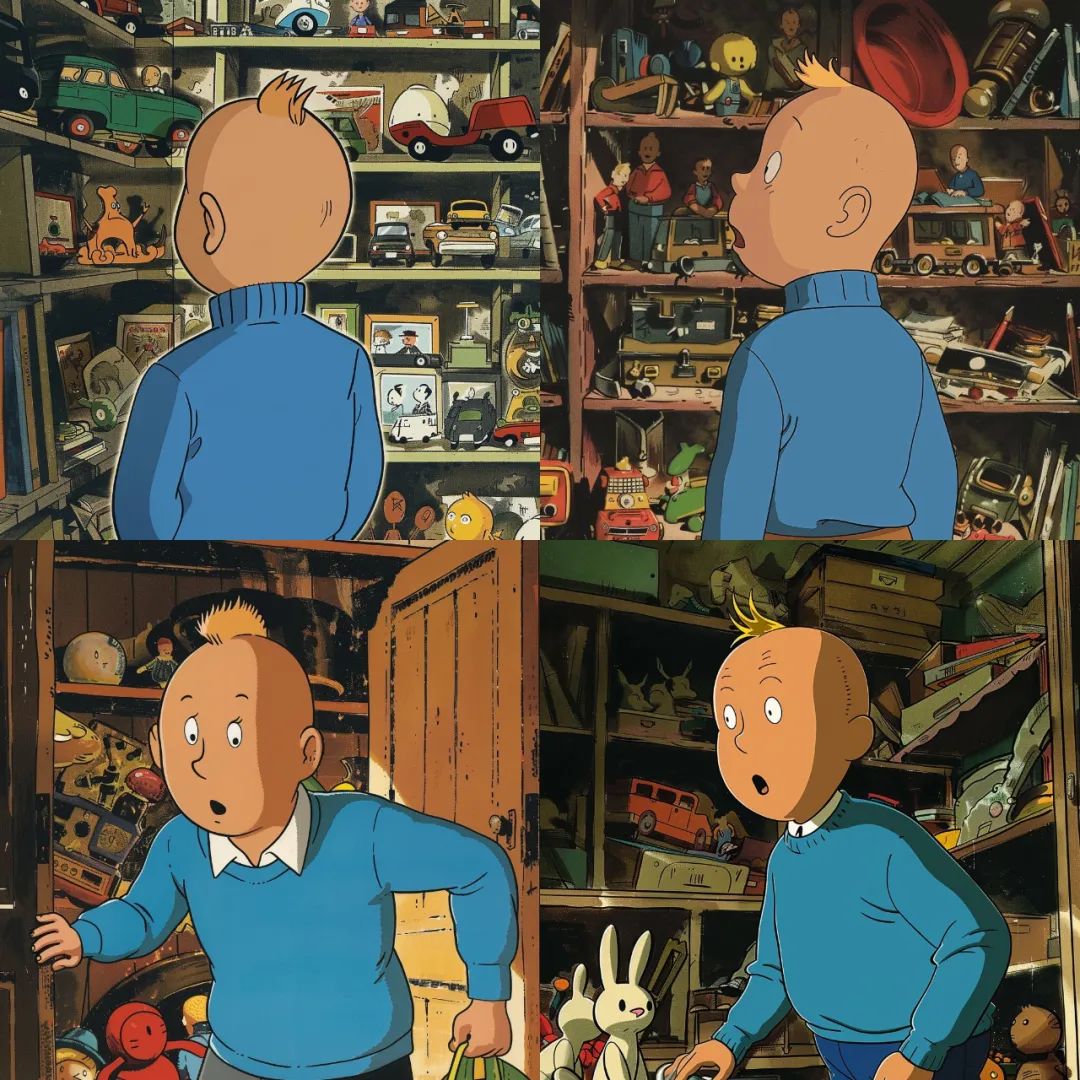

比如这两组动画设计:

所以,如何使用这项功能呢?

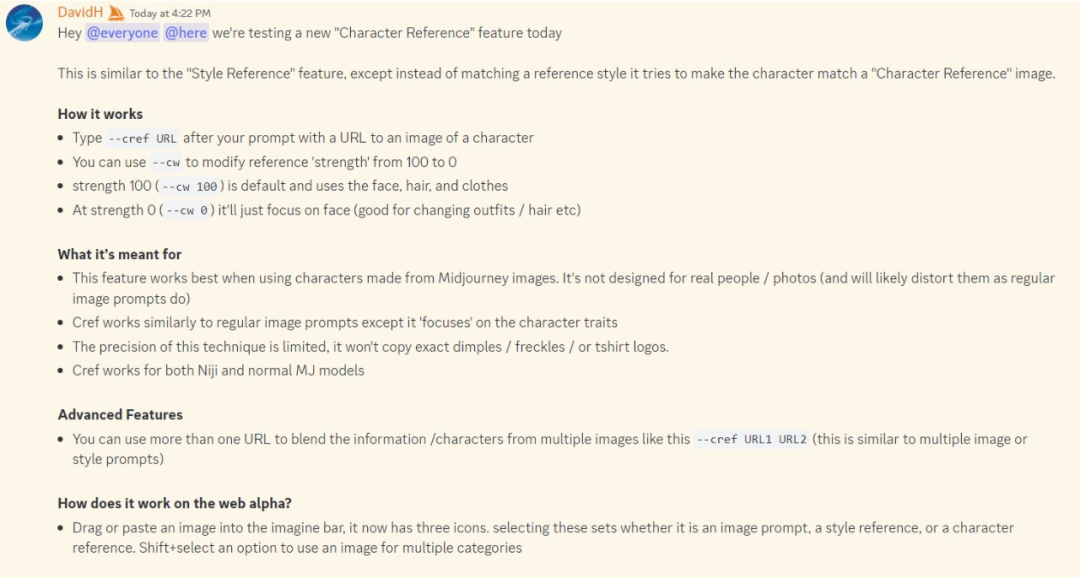

Midjourney 创始人 David Holz 提供了一份完整说明:

使用方法很简单:在提示词后键入 -cref URL,并输入角色图像的 URL。

用户可以用「cw」来修改参考的「强度」,数值可以是 0 到 100。

强度 100 (-cw 100) 是默认值,使用脸部、头发和衣服;强度 0 (-cw 0) 时,它将只关注脸部(适合更换服装 / 头发等)。

有几点需要注意:

- 该功能之前生成的 Midjourney 图像配合使用效果最佳,不是为真人照片设计的,并且可能会像常规图像提示一样发生扭曲;

- Cref 的工作方式与常规图像提示类似,只是比较专注于角色特征;

- 这项技术的精度是有限的,不会复制精确的酒窝 / 雀斑 / 或 T 恤标志;

- 可以使用多个 URL 来混合多张图像中的信息 / 角色。

该功能也适用于非人物图像的生成,我们可以提供一张白色背景的原始图像,然后在不同的场景中将其融入:

感兴趣的你,不妨一试。