OpenAI又迎来一位AI大将。

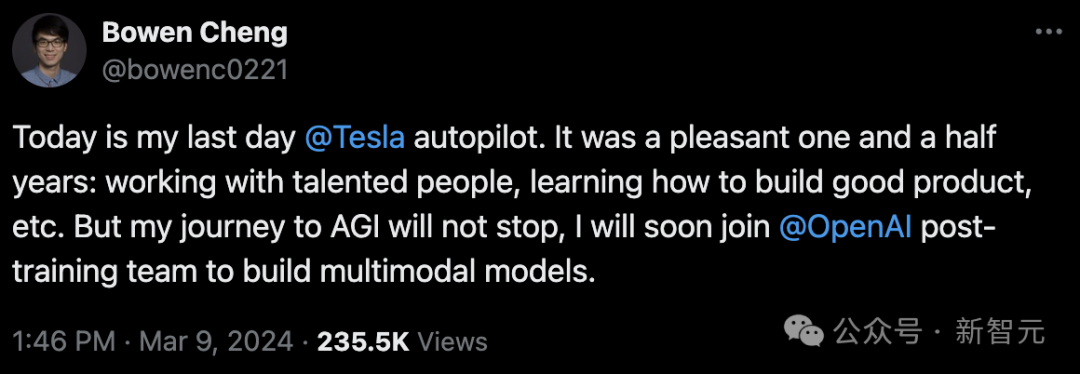

最近,华人科学家程博文官宣离职特斯拉,即将加入OpenAI专攻多模态模型的研究。

图片

图片

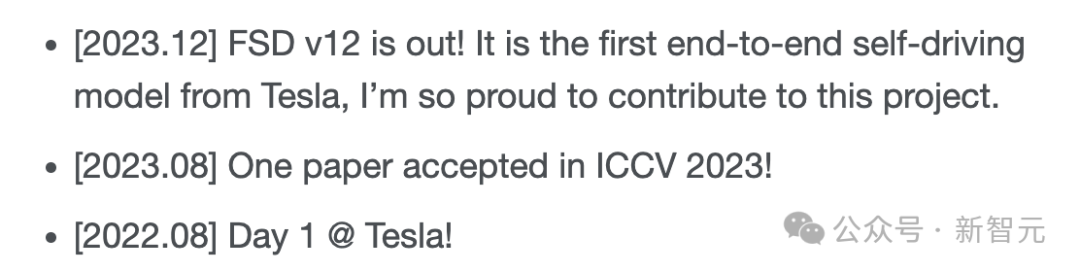

今天是我在特斯拉自动驾驶部门的最后一天,这一年半的经历真的很棒:有机会与才华横溢的同事们共事,学习了如何开发出色的产品等等。但我向通用人工智能(AGI)进发的脚步不会因此而停歇,不久后,我将加入OpenAI的后训练(post-training)团队,参与构建多模态模型的工作。

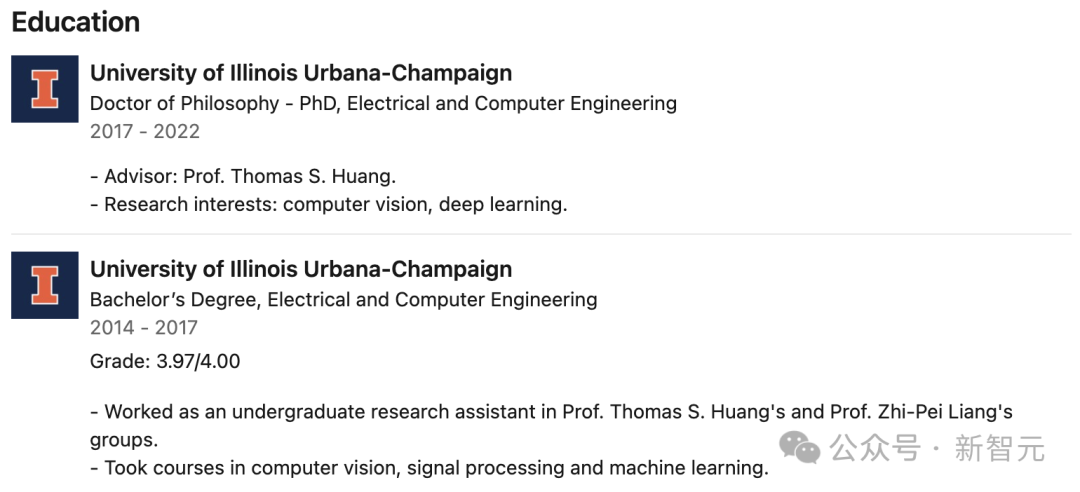

值得一提的是,程博文博士毕业于伊利诺伊大学厄巴纳-香槟分校(UIUC),导师就是大名鼎鼎的计算机科学家Thomas Huang。

黄煦涛于2020年4月逝世

黄煦涛于2020年4月逝世

OpenAI视频生成科学家Will Depue、技术人员Farzad Khorasani等人纷纷对他表示欢迎。

图片

图片

图片

图片

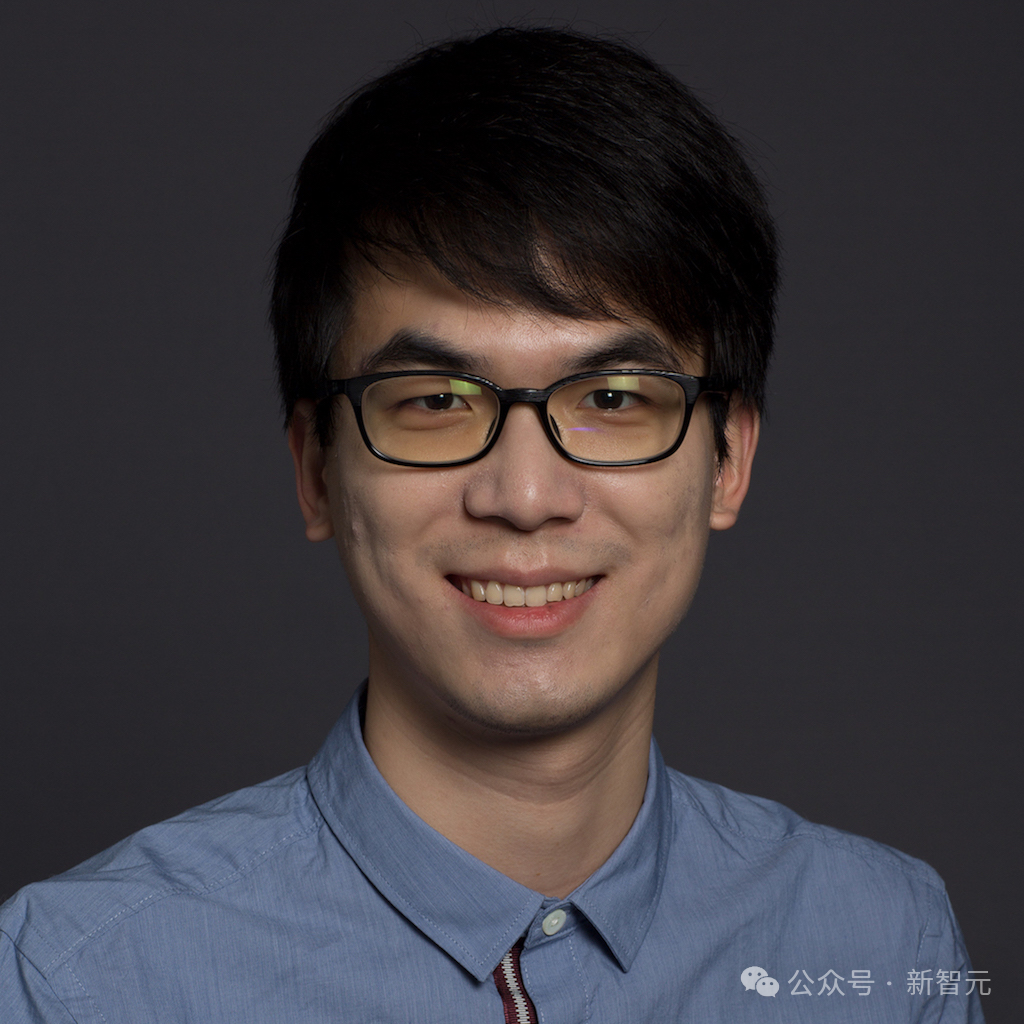

程博文是谁?

图片

图片

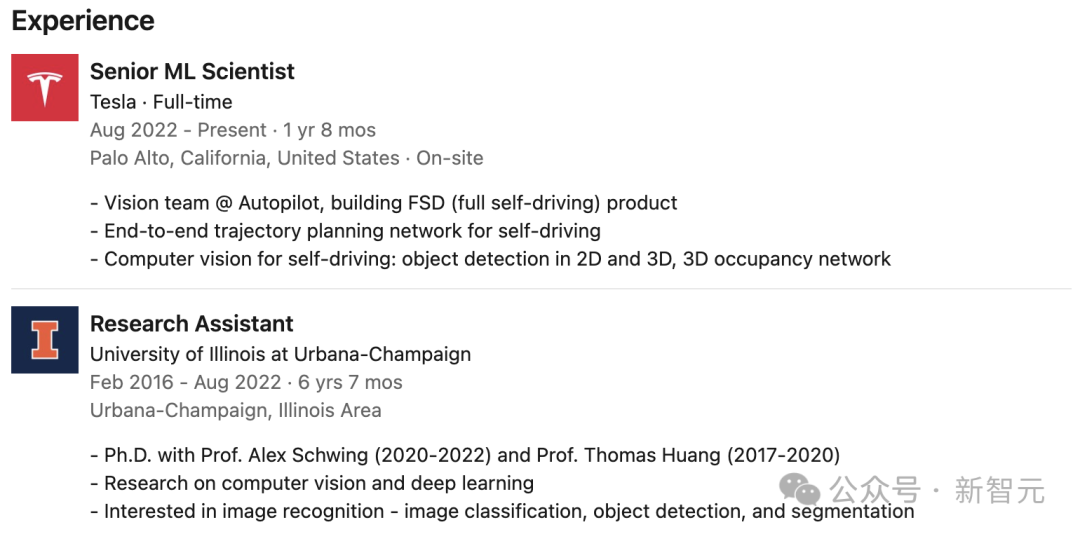

2022年,程博文正式入职特斯拉,成为自动驾驶团队的一位资深研究科学家。

在此期间,他的主要工作重心——开发全自动驾驶(FSD)系统,包括特斯拉最新的FSD v12。

图片

图片

程博文曾在UIUC获得了电气与计算机工程(ECE)的博士学位,期间由Alexander Schwing教授和Thomas Huang教授指导(2017-2020年)。

在攻读研究生学位之前,他于2017年在UIUC完成了电气与计算机工程的学士学位学习。

图片

图片

程博文还曾在Facebook AI Research、谷歌研究院、微软研究院和微软亚洲研究院实习。

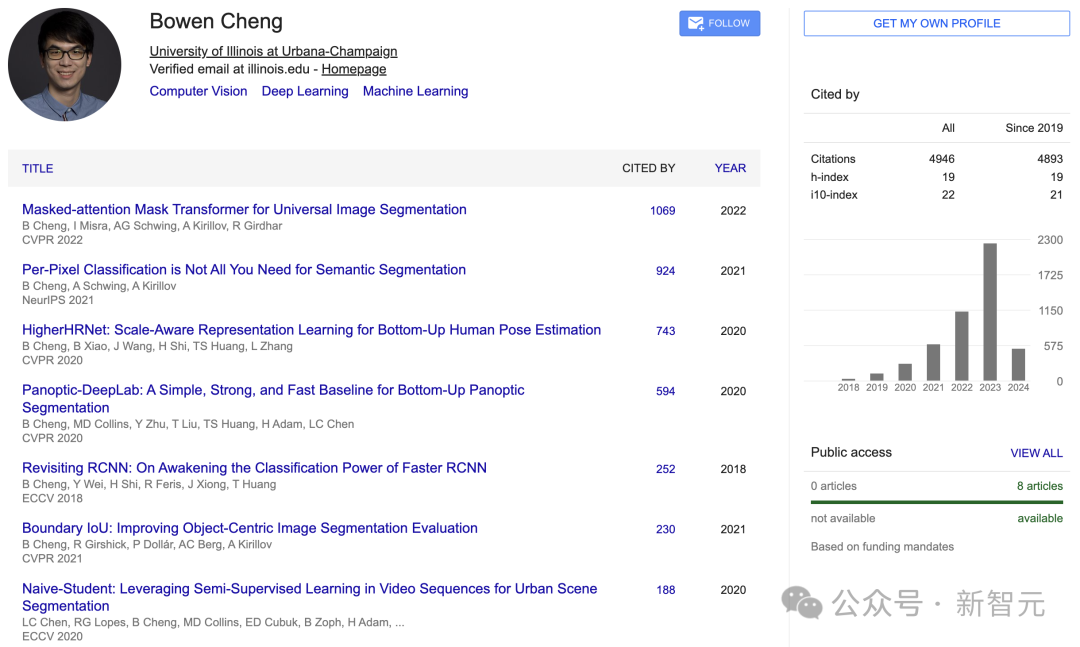

个人主页中,他提到了自己的研究兴趣,覆盖了计算机视觉和机器学习。

在特斯拉,程博文将自己视为一位「全栈研究员」,不仅将最新研究成果应用于全自动驾驶技术的产品化进程中,还参与了产品开发的全周期工作,包括数据引擎、模型设计与训练、模型集成等方面。

图片

图片

最近,他正致力于开发自动驾驶的端到端规划网络。

作为一位专注于计算机视觉和机器学习的研究者,程博文对多模态嵌入式智能体很感兴趣。

具体来说,他希望打造出能够(1)理解人类以任何形式发出的命令;(2)根据内置知识或利用工具以期望的方式执行任务并生成结果;(3)通过吸取常识知识和人类反馈进行学习的AI助手,如自动驾驶汽车、聊天机器人等。

过往项目:重点在「分割」

图片

图片

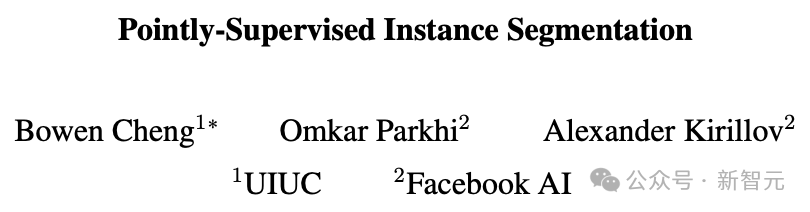

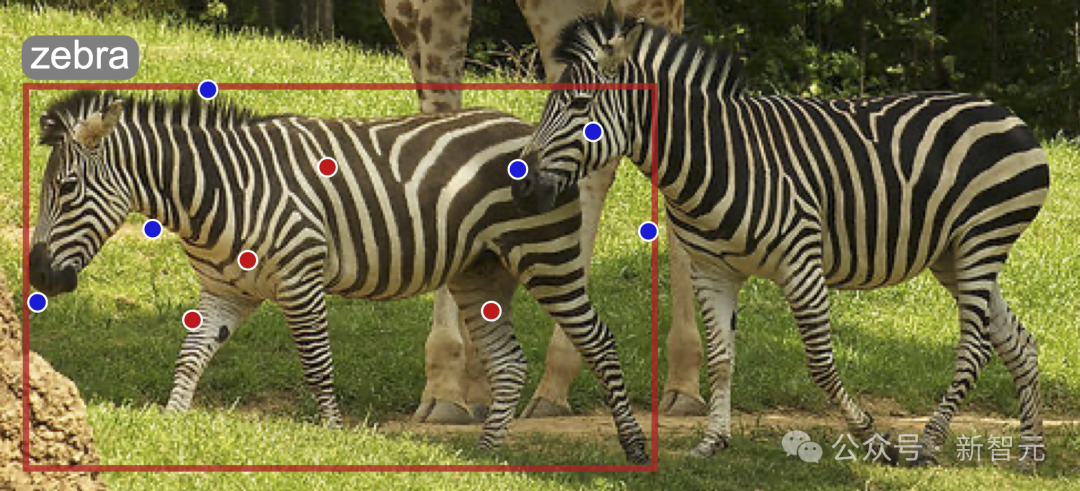

程博文获得CVPR 2022 Oral的一篇论文提出了基于点的实例级注释——是实例分割的一种新的弱监督形式。

图片

图片

论文地址:https://arxiv.org/abs/2104.06404

它将标准边界框注释与每个边界框内均匀采样的标记点相结合。

研究表明,为完全掩码监督而开发的现有实例分割模型(如Mask R-CNN),可以在不做任何重大修改的情况下,通过基于点的注释进行无缝训练。

实验中,在COCO、PASCAL VOC、Cityscapes和LVIS上训练的Mask R-CNN模型,在每个对象只有10个注释点的情况下,其完全监督性能达到了94%-98%的水平。

与比对象掩码相比,这种基于点的注释收集速度快约5倍,让高质量的实例分割更容易用于新数据。

图片

图片

另外,受新注释形式的启发,研究人员还对PointRend实例分割模块提出了修改建议。

对于每个对象,被称为Implicit PointRend的新架构会为一个函数生成参数,该函数会进行最终的点级掩码预测。

Implicit PointRend更为简单明了,只需使用一个点级掩码损失。

实验表明,新模块更适合基于点的监督方式。

图片

图片

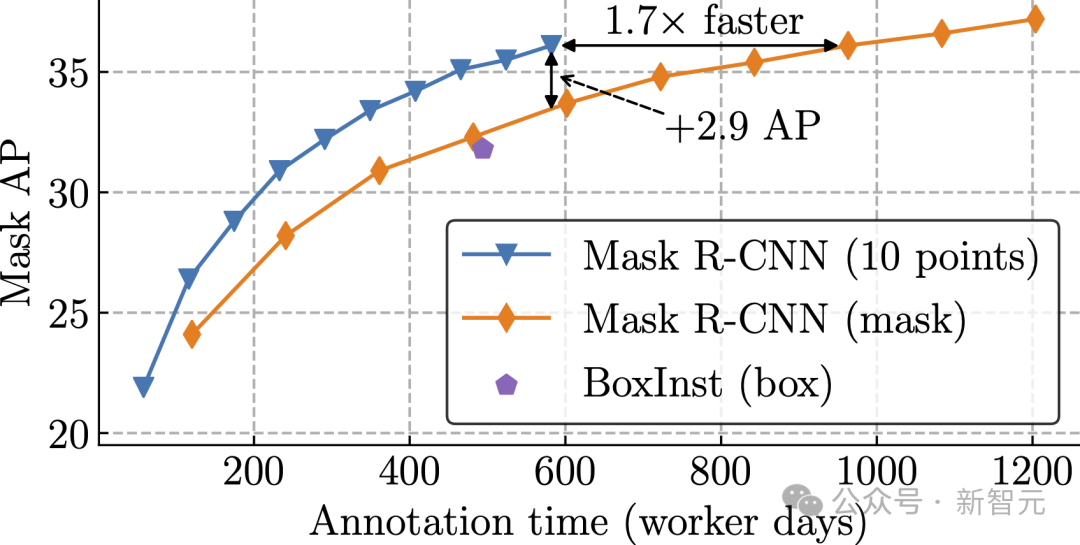

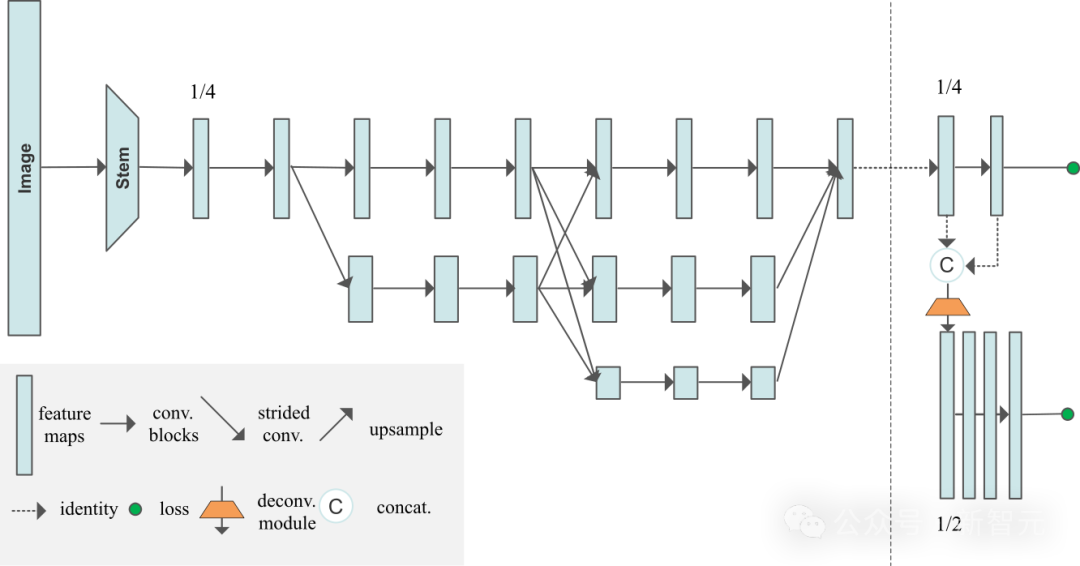

CVPR 2022上另一篇录用论文,也是关于图像分割的研究。

是Maskformer算法的进阶。

图片

图片

论文地址:https://arxiv.org/abs/2112.01527

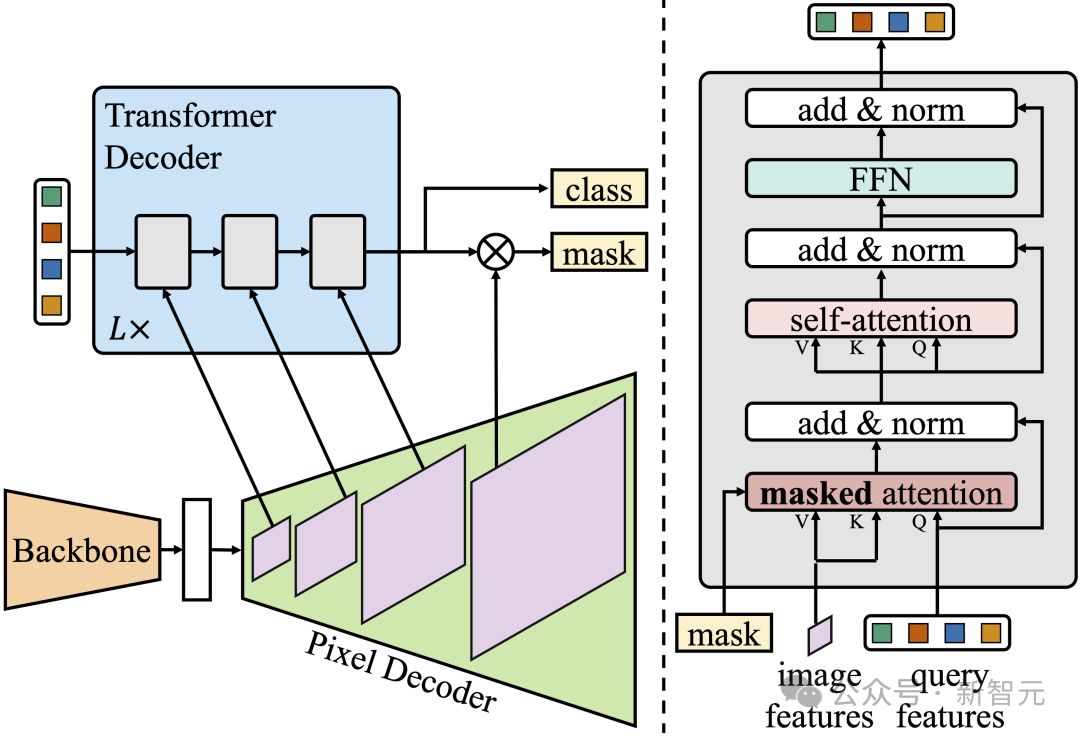

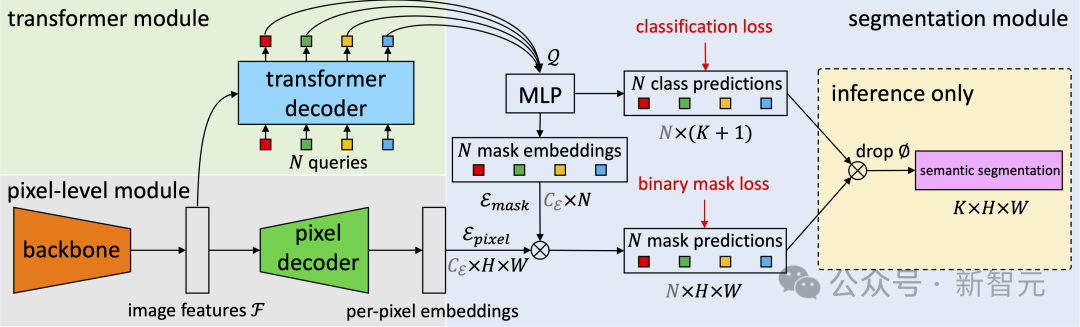

论文中,他提出的Mask2Former在图像分割,包括语义分割、实例分割、视频语义分割、视频实例分割等领域中逐渐变成了一个基础模型。

Mask2Former的关键组件包括掩码注意力,通过限制预测掩码区域内的交叉注意力来提取局部特征。

图片

图片

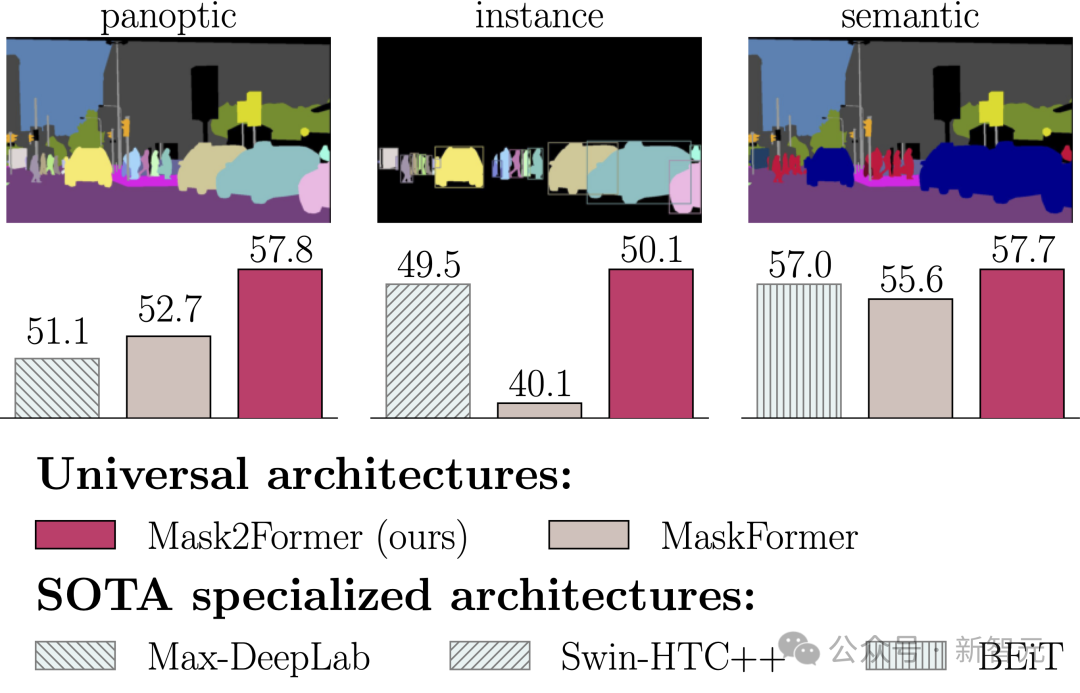

除了将研究工作量减少至少3倍外,它在四个流行数据集上的表现还大大优于最佳专业架构。

最值得注意的是,Mask2Former在全景分割(COCO上为57.8 PQ)、实例分割(COCO上为50.1 AP)和语义分割(ADE20K上为57.7 mIoU)方面都刷新了SOTA。

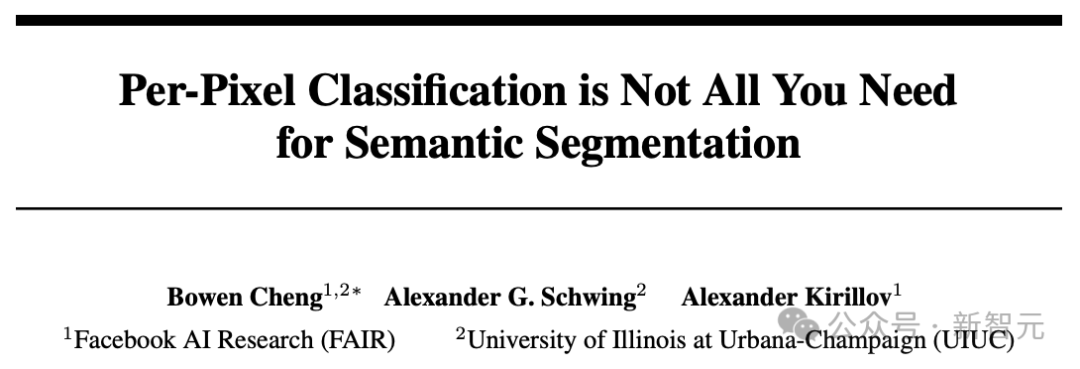

而下面这篇就是Mask2Former的前身MaskFormer,被NeurIPS 2021 Spotlight录用。

图片

图片

论文地址:https://arxiv.org/abs/2107.06278

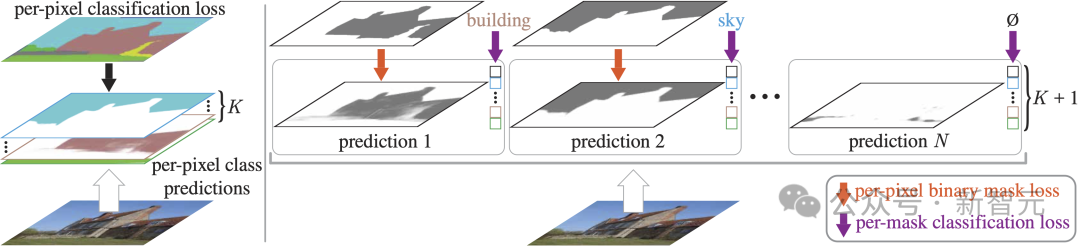

在作者看来,传统的逐像素分类的方法不足以通用。

为此全新提出的MaskFormer,是一种简单的掩码分类模型,可预测一组二进制掩码,每个掩码都与单个全局类标签预测相关联。

图片

图片

他们所提出的基于掩码分类的方法,简化了语义和全景分割任务的有效方法。

特别是,研究人员观察到,当类别数量较多时,MaskFormer的表现优于按像素分类的基准方法。

具体来说,MaskFormer基于掩码分类的方法优于最先进的语义分割模型(在ADE20K上为55.6 mIoU)和全景分割模型(在COCO上为52.7 PQ)。

图片

图片

程博文在CVPR 2020上,拿下的两篇论文,都得到了黄煦涛的指导。

图片

图片

论文地址:https://arxiv.org/abs/1911.10194

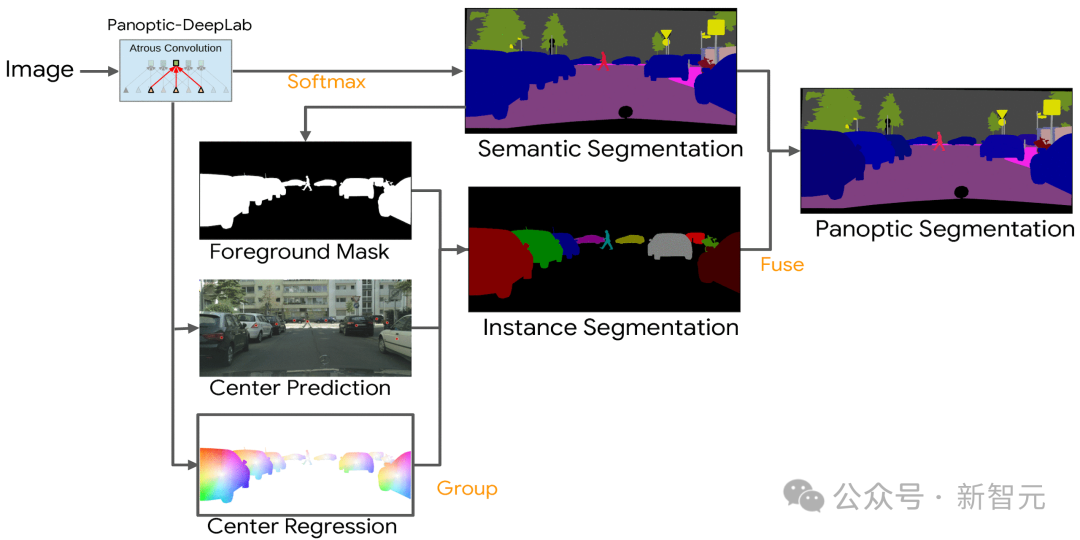

这篇论文介绍了Panoptic-DeepLab——一个简单、强大、快速的全景分割系统。

旨在为自下而上的方法建立一个坚实的基线,在获得快速推理速度的同时,实现与两阶段方法相当的性能。

图片

图片

还有一篇提出了HigherHRNet,一种全新的自下而上的人体姿势估计方法,用于使用高分辨率特征金字塔学习尺度感知表示。

图片

图片

论文地址:https://arxiv.org/abs/1908.10357

图片

图片

参考资料:

https://twitter.com/bowenc0221/status/1766339742818533636