我们知道,大模型到 GPT-3.5 这种千亿体量以后,训练和推理的算力就不是普通创业公司所能承担的了,人们用起来速度也会很慢。

但自本周起,这种观念已成为历史。

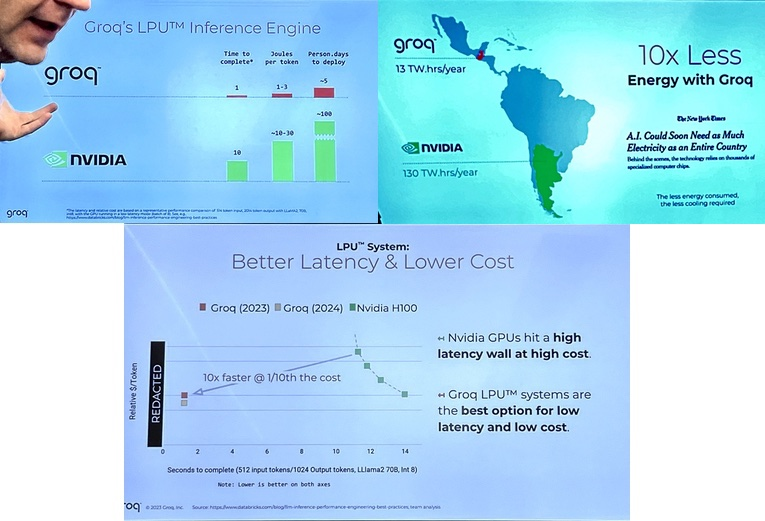

有名为 Groq 的初创公司开发出一种机器学习处理器,据称在大语言模型任务上彻底击败了 GPU—— 比英伟达的 GPU 快 10 倍,而成本仅为 GPU 的 10%,只需要十分之一的电力。

这是在 Groq 上运行 Llama 2 的速度:

来源:https://twitter.com/emollick/status/1759633391098732967

这是 Groq(Llama 2)和 ChatGPT 面对同一个 prompt 的表现:

图源:https://x.com/JayScambler/status/1759372542530261154?s=20

图源:https://x.com/JayScambler/status/1759372542530261154?s=20

尽管看起来不可思议,但事实就是如此,感兴趣的朋友不妨一试。

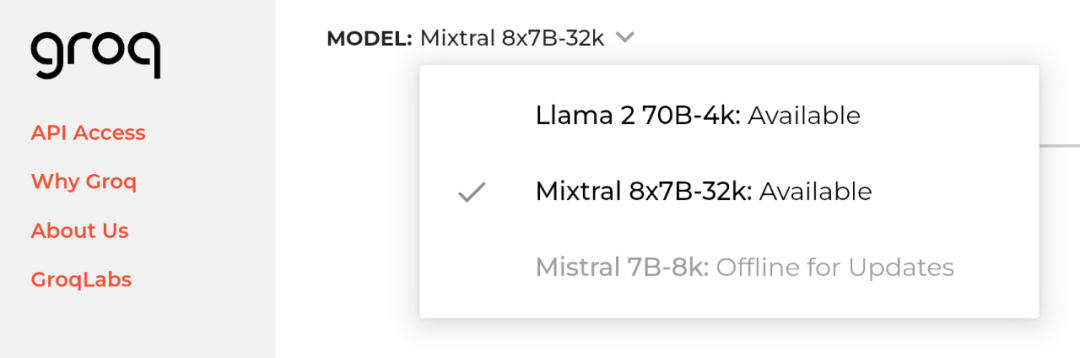

目前,Groq 的官网提供了试用体验,有这些模型可选:

官网地址:https://groq.com/

Groq 的处理器名为 LPU(语言处理单元),是一种新型的端到端处理单元系统,可以为具备序列组件的计算密集型应用(比如 LLM)提供极快的推理速度。

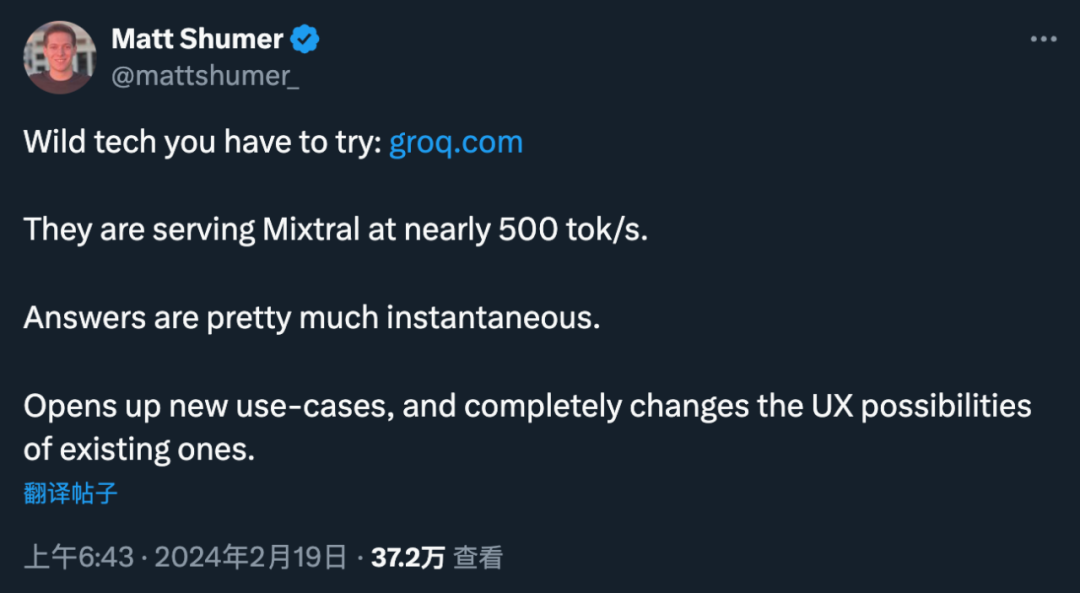

它带动的大模型速度能达到前所未有的 500 Token/s,并且实现了极低的延迟。

用硬件加速软件,总能给人一种力大砖飞的感觉。Groq 还在 LPU 上运行了最新锐的开源模型 Mixtral,模型在不到一秒的时间内回复了包含数百个单词的事实性的、引用的答案(其中四分之三的时间是用来搜索):

Groq 放出的 Demo 视频下,有人评论道:这也太快了,不该这么快。

有网友因此提出建议:因为大模型生成内容的速度太快,所以从用户体验的角度来看不应该再自动翻页了,因为人眼看不过来。

或许在 LPU 的加持下,生成式 AI 真的要如同 Gartner 最近预测所言:在两年内对搜索引擎构成巨大威胁了。仔细一想也确实合理,毕竟当年神经网络就是被 GPU 算力的发展带飞的。

至于为什么这么快?

有人分析,GPU 专为具有数百个核心的并行处理而设计,主要用于图形渲染,而 LPU 的架构旨在为 AI 计算提供确定性的性能。

LPU 的架构不同于 GPU 使用的 SIMD(单指令、多数据)模型,而是采用更精简的方法,消除了对复杂调度硬件的需求。这种设计允许有效利用每个时钟周期,确保一致的延迟和吞吐量。

能源效率是 LPU 相对于 GPU 的另一个值得注意的优势。通过减少与管理多个线程相关的开销并避免核心利用率不足,LPU 可以提供更多的每瓦计算量,将其定位为更环保的替代方案。

Groq 的芯片设计允许将多个 TSP 连接在一起,不会出现 GPU 集群中的传统瓶颈,使其具有极高的可扩展性。随着更多 LPU 的添加,这可以实现性能的线性扩展,从而简化大规模 AI 模型的硬件要求,并使开发人员更轻松地扩展其应用程序,而无需重新架构其系统。

在 A100 和 H100 相对紧缺的时代,LPU 或许会成为大模型开发商的新选择。

Groq 成立于 2016 年,这家公司的创始团队出自谷歌,曾经设计了谷歌自研 AI 芯片张量处理单元 TPU 系列。据官网介绍,Groq 公司创始人、首席执行官 Jonathan Ross 曾经承担了 TPU 的 20% 工作。

Jonathan Ross。

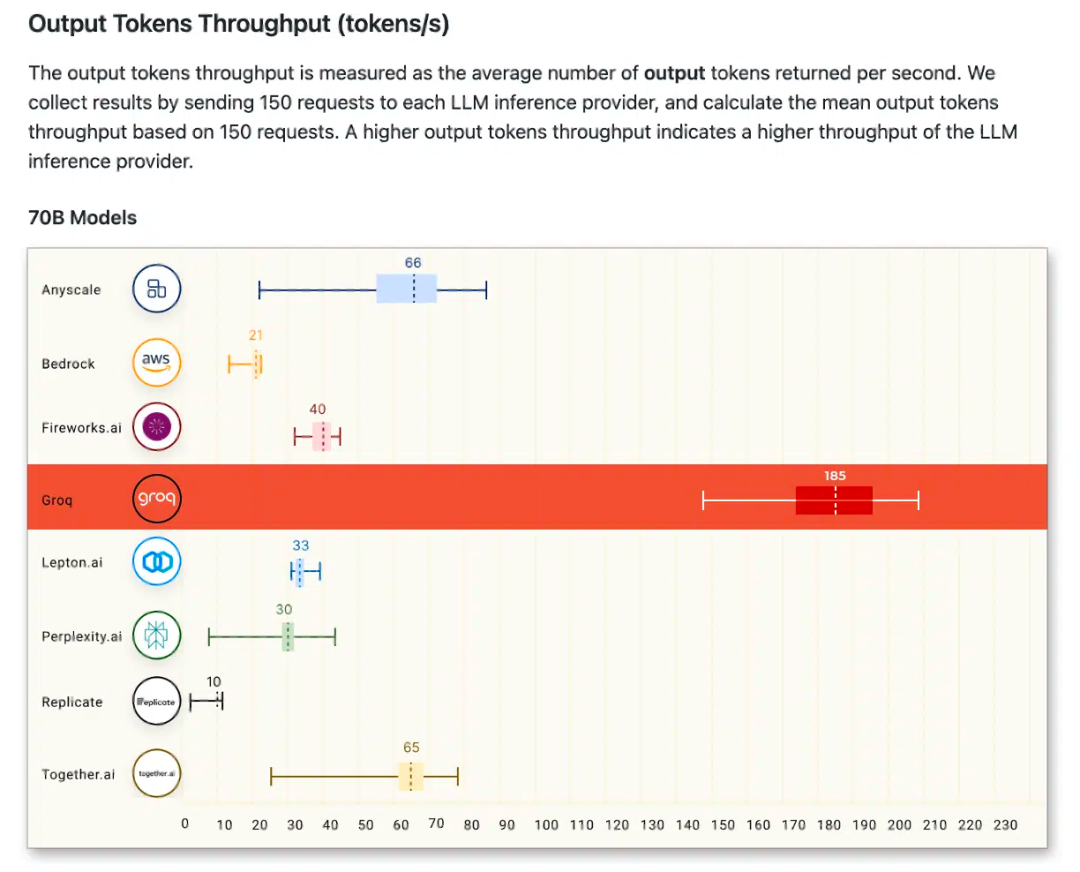

在去年的高性能计算会议 SC23 上,Groq 就展示过在 LPU 上运行 LLM 的全球最佳低延迟性能。当时,Groq 能够以每秒超过 280 个 Token 的速度生成回复,刷新了 Llama-2 70B 推理的性能记录。

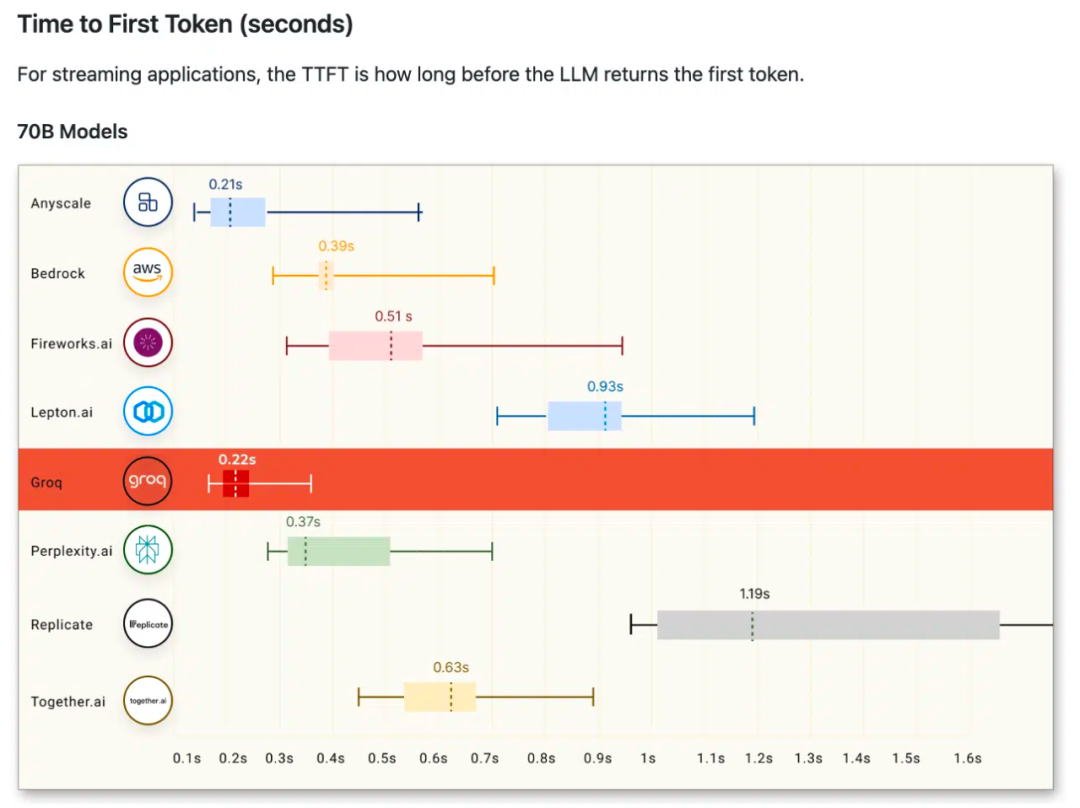

今年 1 月,Groq 首次参与公开基准测试,就在 Anyscale 的 LLMPerf 排行榜上取得了突出的成绩,远超其他基于云的推理提供商。

图源:https://github.com/ray-project/llmperf-leaderboard?tab=readme-ov-file

图源:https://github.com/ray-project/llmperf-leaderboard?tab=readme-ov-file

人工智能已经在科技界掀起了一场风暴。2023 年可能是世界意识到人工智能将成为现实的一年,而 2024 年则是人工智能真正成为现实而不仅仅是假设的一年。这是 Jonathan Ross 曾经表达的一个观点。

当我们拥有 100 万 Token 上下文的 Gemini Pro 1.5、每秒 500 Token 推理速度的 Groq、推理能力更进一步的 GPT-5,梦想还会远吗?