GPT-5何时到来,会有什么能力?

来自艾伦人工智能研究所(Allen Institute for AI)的新模型告诉你答案。

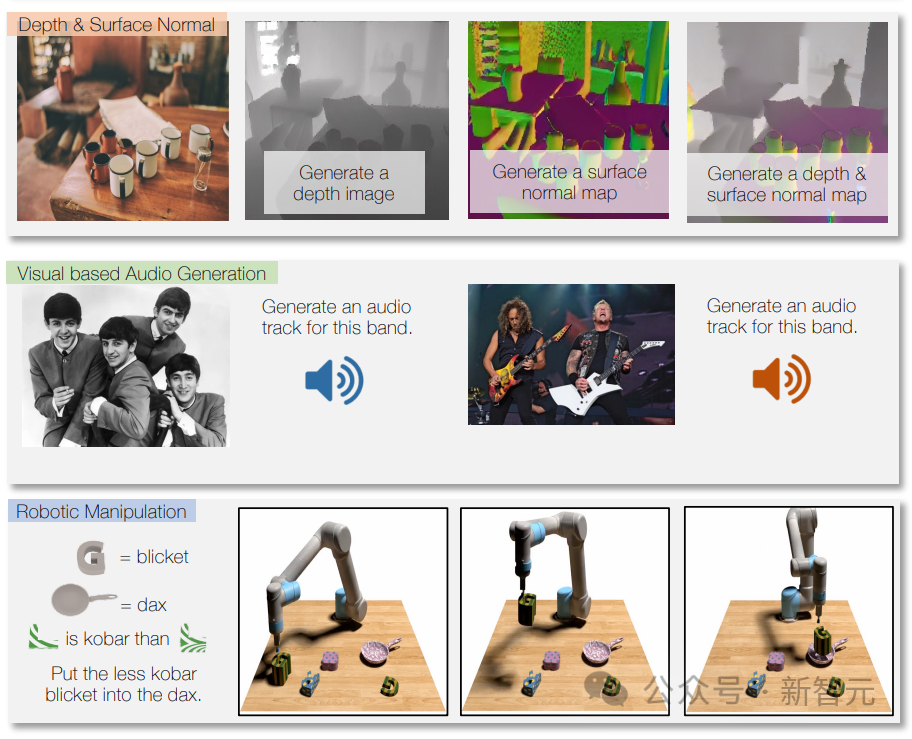

艾伦人工智能研究所推出的Unified-IO 2是第一个可以处理和生成文本、图像、音频、视频和动作序列的模型。

这个新的高级人工智能模型使用几十亿个数据点进行训练,虽然模型大小只有7B,却展现出迄今为止最广泛的多模态能力。

论文地址:https://arxiv.org/pdf/2312.17172.pdf

那么,Unified-IO 2和GPT-5有什么关系呢?

早在2022年6月,艾伦人工智能研究所就推出了第一代Unified-IO,它是首批能够处理图像和语言的多模态模型之一。

大约在同一时间,OpenAI正在内部测试GPT-4,并在2023年3月正式发布。

所以,Unified-IO可以看作是对于未来大规模AI模型的前瞻。

也就是说,OpenAI可能正在内部测试GPT-5,并将在几个月后发布。

而本次Unified-IO 2向我们展现的能力,也将是我们在新的一年可以期待的内容:

GPT-5等新的AI模型可以处理更多模态,通过广泛的学习以本地方式执行许多任务,并且对与物体和机器人的交互有基本的了解。

Unified-IO 2的训练数据包括:10亿个图像-文本对、1 万亿个文本标记、1.8亿个视频剪辑、1.3亿张带文本的图像、300万个3D资产和100万个机器人代理运动序列。

研究团队将总共120多个数据集组合成一个600 TB的包,涵盖220个视觉、语言、听觉和动作任务。

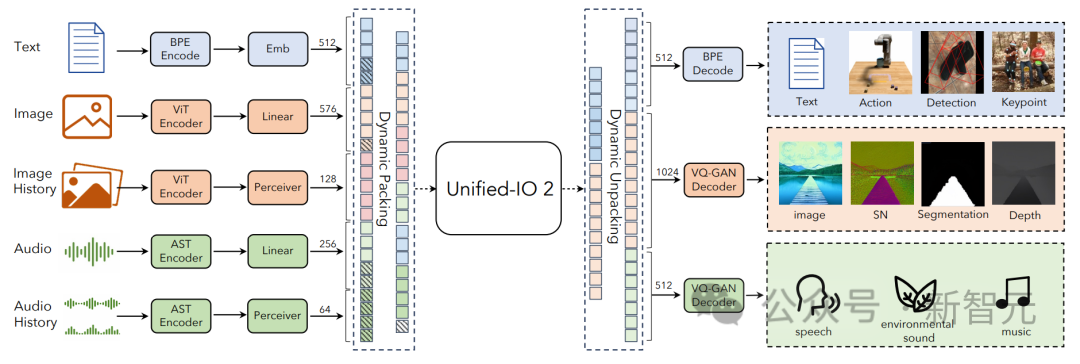

Unified-IO 2采用编码器-解码器架构,并进行了一些更改,以稳定训练并有效利用多模态信号。

模型可以回答问题、根据指令撰写文本、以及分析文本内容。

模型还可以识别图像内容,提供图像描述,执行图像处理任务,并根据文本描述创建新图像。

它还可以根据描述或说明生成音乐或声音,以及分析视频并回答有关视频的问题。

通过使用机器人数据进行训练,Unified-IO 2还可以为机器人系统生成动作,例如将指令转换为机器人的动作序列。

由于多模态训练,它还可以处理不同的模态,例如,在图像上标记某个音轨使用的乐器。

Unified-IO 2在超过35个基准测试中表现良好,包括图像生成和理解、自然语言理解、视频和音频理解以及机器人操作。

在大多数任务中,它能够比肩专用模型,甚至更胜一筹。

在图像任务的GRIT基准测试中,Unified-IO 2获得了目前的最高分(GRIT用于测试模型如何处理图像噪声和其他问题)。

研究人员现在计划进一步扩展Unified-IO 2,提高数据质量,并将编码器-解码器模型,转换为行业标准的解码器模型架构。

Unified-IO 2

Unified-IO 2是第一个能够理解和生成图像、文本、音频和动作的自回归多模态模型。

为了统一不同的模态,研究人员将输入和输出(图像、文本、音频、动作、边界框等)标记到一个共享的语义空间中,然后使用单个编码器-解码器转换器模型对其进行处理。

由于训练模型所采用的数据量庞大,而且来自各种不同的模态,研究人员采取了一系列技术来改进整个训练过程。

为了有效地促进跨多种模态的自监督学习信号,研究人员开发了一种新型的去噪器目标的多模态混合,结合了跨模态的去噪和生成。

还开发了动态打包,可将训练吞吐量提高4倍,以处理高度可变的序列。

为了克服训练中的稳定性和可扩展性问题,研究人员在感知器重采样器上做了架构更改,包括2D旋转嵌入、QK归一化和缩放余弦注意力机制。

对于指令调整,确保每个任务都有一个明确的提示,无论是使用现有任务还是制作新任务。另外还包括开放式任务,并为不太常见的模式创建合成任务,以增强任务和教学的多样性。

统一任务表示

将多模态数据编码到共享表示空间中的标记序列,包括以下几个方面:

文本、稀疏结构和操作

文本输入和输出使用LLaMA中的字节对编码进行标记化,边界框、关键点和相机姿势等稀疏结构被离散化,然后使用添加到词汇表中的1000个特殊标记进行编码。

点使用两个标记(x,y)进行编码,盒子用四个标记(左上角和右下角)的序列进行编码,3D长方体用12个标记表示(编码投影中心、虚拟深度、对数归一化框尺寸、和连续同心旋转)。

对于具身任务,离散的机器人动作被生成为文本命令(例如,「向前移动」)。特殊标记用于对机器人的状态进行编码(例如位置和旋转)。

图像和密集结构

图像使用预先训练的视觉转换器(ViT)进行编码。将ViT的第二层和倒数第二层的补丁特征连接起来,以捕获低级和高级视觉信息。

生成图像时,使用VQ-GAN将图像转换为离散标记,这里采用patch大小为8 × 8的密集预训练VQ-GAN模型,将256 × 256的图像编码为1024个token,码本大小为16512。

然后将每个像素的标签(包括深度、表面法线和二进制分割掩码)表示为RGB图像。

音频

U-IO 2将长达4.08秒的音频编码为频谱图,然后使用预先训练的音频频谱图转换器(AST)对频谱图进行编码,并通过连接AST的第二层和倒数第二层特征并应用线性层来构建输入嵌入,就像图像ViT一样。

生成音频时,使用ViT-VQGAN将音频转换为离散的标记,模型的patch大小为8 × 8,将256 × 128的频谱图编码为512个token,码本大小为8196。

图像和音频历史记录

模型最多允许提供四个额外的图像和音频片段作为输入,这些元素也使用ViT或AST进行编码,随后使用感知器重采样器,进一步将特征压缩为较少数量(图像为32个,音频为16个)。

这大大缩短了序列长度,并允许模型在使用历史记录中的元素作为上下文时,以高细节检查图像或音频片段。

稳定训练的模型架构和技术

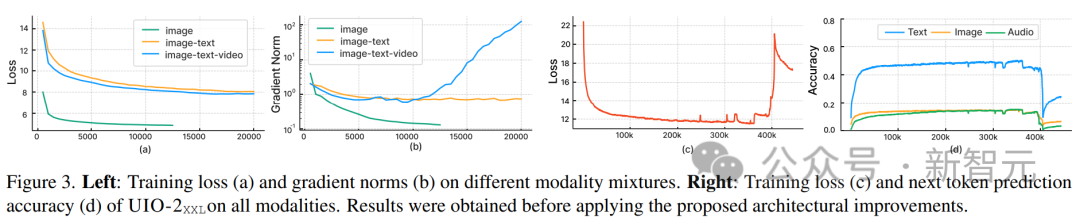

研究人员观察到,随着我们集成其他模式,使用 U-IO 之后的标准实现会导致训练越来越不稳定。

如下图(a)和(b)所示,仅对图像生成(绿色曲线)进行训练会导致稳定的损失和梯度范数收敛。

与单一模态相比,引入图像和文本任务的组合(橙色曲线)略微增加了梯度范数,但保持稳定。然而,包含视频模态(蓝色曲线)会导致梯度范数的无限制升级。

如图中(c)和(d)所示,当模型的XXL版本在所有模态上训练时,损失在350k步后爆炸,下一个标记预测精度在400k步时显著下降。

为了解决这个问题,研究人员进行了各种架构更改:

在每个Transformer层应用旋转位置嵌入(RoPE)。对于非文本模态,将RoPE扩展到二维位置;当包括图像和音频模态时,将LayerNorm应用于点积注意力计算之前的Q和K。

另外,使用感知器重采样器,将每个图像帧和音频片段压缩成固定数量的标记,并使用缩放余弦注意力在感知者中应用更严格的归一化,这显著稳定了训练。

为了避免数值不稳定,还启用了float32注意力对数,并在预训练期间冻结ViT和 AST,并在指令调整结束时对其进行微调。

上图显示,尽管输入和输出模态存在异质性,但模型的预训练损失是稳定的。

多模态训练目标

本文遵循UL2范式。对于图像和音频目标,这里定义了两种类似的范式:

[R]:掩码去噪,随机屏蔽x%的输入图像或音频补丁特征,并让模型重新构建它;

[S]:要求模型在其他输入模态条件下生成目标模态。

在训练期间,用模态标记([Text]、[Image] 或 [Audio])和范式标记([R]、[S] 或 [X])作为输入文本的前缀,以指示任务,并使用动态遮罩进行自回归。

如上图所示,图像和音频屏蔽去噪的一个问题是解码器侧的信息泄漏。

这里的解决方案是在解码器中屏蔽token(除非在预测这个token),这不会干扰因果预测,同时又消除了数据泄漏。

效率优化

对大量多模态数据进行训练,会导致转换器输入和输出的序列长度高度可变。

这里使用打包来解决这个问题:多个示例的标记被打包到一个序列中,并屏蔽注意力以防止转换器在示例之间交叉参与。

在训练过程中,使用启发式算法来重新排列流式传输到模型的数据,以便将长样本与可以打包的短样本相匹配。本文的动态打包使训练吞吐量增加了近4倍。

指令调优

多模态指令调优是使模型具备各种模态的不同技能和能力,甚至适应新的和独特的指令的关键过程。

研究人员通过结合广泛的监督数据集和任务来构建多模态指令调优数据集。

指令调谐数据的分布如上图所示。总体而言,指令调优组合包括60%的提示数据、30%从预训练中继承下来的数据(为了避免灾难性的遗忘)、6%使用现有数据源构建的任务增强数据、以及4%自由格式文本(以实现类似聊天的回复)。