在CTR预估中,主流都采用特征embedding+MLP的方式,其中特征非常关键。然而对于相同的特征,在不同的样本中,表征是相同的,这种方式输入到下游模型,会限制模型的表达能力。

为了解决这个问题,CTR预估领域提出了一系列相关工作,被称为特征增强模块。特征增强模块根据不同的样本,对embedding层的输出结果进行一次矫正,以适应不同样本的特征表示,提升模型的表达能力。

最近,复旦大学和微软亚研院联合发布了一篇特征增强工作的总结,对比了不同特征增强模块实现方法的效果。下面给大家介绍一下几种特征增强模块的实现方法,以及本文进行的相关对比实验。

论文标题:A Comprehensive Summarization and Evaluation of Feature Refinement Modules for CTR Prediction

论文标题:A Comprehensive Summarization and Evaluation of Feature Refinement Modules for CTR Prediction

下载地址:https://arxiv.org/pdf/2311.04625v1.pdf

1、特征增强建模思路

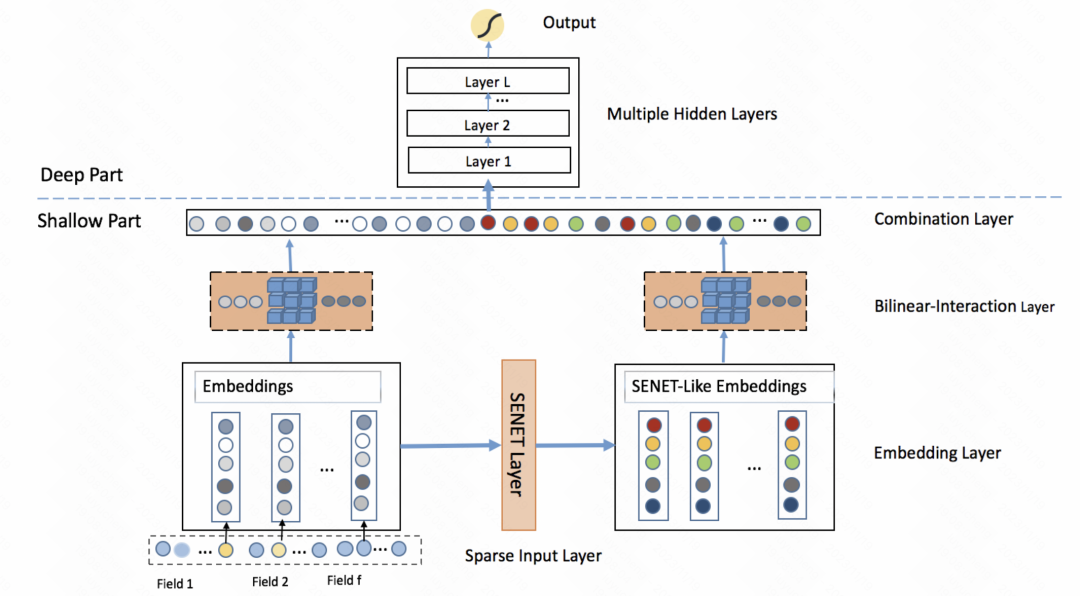

特征增强模块,旨在提升CTR预估模型中Embedding层的表达能力,实现相同特征在不同样本下的表征差异化。特征增强模块可以用下面这个统一公式表达,输入原始的Embedding,经过一个函数后,生成这个样本个性化的Embedding。

图片

图片

这类方法的大致思路为,在得到初始的每个特征的embedding后,使用样本本身的表征,对特征embedding做一个变换,得到当前样本的个性化embedding。下面给大家介绍一些经典的特征增强模块建模方法。

2、特征增强经典方法

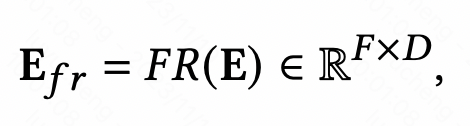

An Input-aware Factorization Machine for Sparse Prediction(IJCAI 2019)这篇文章在embedding层之后增加了一个reweight层,将样本初始embedding输入到一个MLP中得到一个表征样本的向量,使用softmax进行归一化。Softmax后的每个元素对应一个特征,代表这个特征的重要程度,使用这个softmax结果和每个对应特征的初始embedding相乘,实现样本粒度的特征embedding加权。

图片

图片

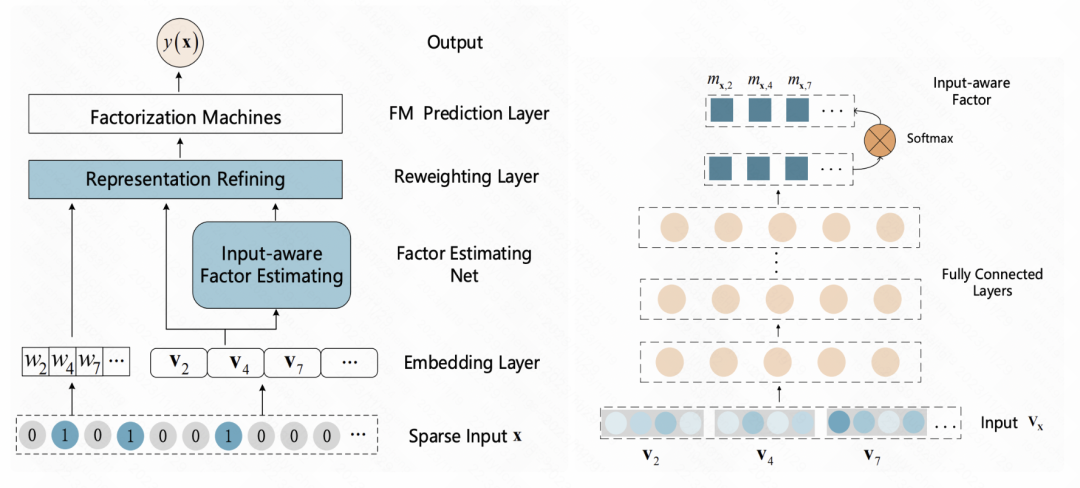

FiBiNET: Combining Feature Importance and Bilinear feature Interaction for Click-Through Rate Prediction(RecSys 2019)也是类似的思路,为每个样本学习一个特征的个性化权重。整个过程分为squeeze、extraction、reweight三个步骤。在squeeze中,将每个特征embedding通过pooling得到一个其对应的统计标量。在extraction中,将这些标量输入到MLP中,得到每个特征的权重。最后,使用这个权重和每个特征embedding向量相乘,得到加权后的embedding结果,相当于在样本粒度做一个特征重要性筛选。

图片

图片

A Dual Input-aware Factorization Machine for CTR Prediction(IJCAI 2020)和上一篇文章类似,也是利用self-attention对特征进行一层增强。整体分为vector-wise和bit-wise两个模块。Vector-wise将每个特征的embedding当成序列中的一个元素,输入到Transformer中得到融合后的特征表示;bit-wise部分使用多层MLP对原始特征进行映射。两部分的输入结果相加后,得到每个特征元素的权重,乘到对应的原始特征的每一位上,得到增强后的特征。

图片

图片

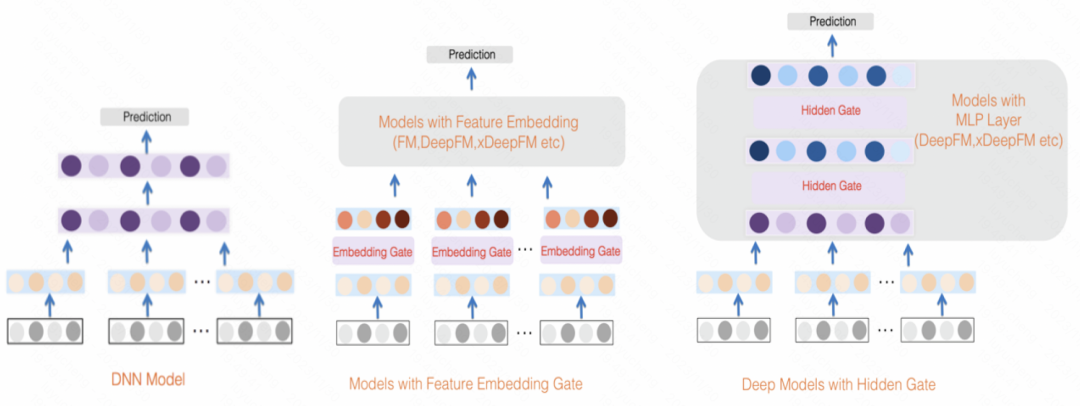

GateNet: Gating-Enhanced Deep Network for Click-Through Rate Prediction(2020)利用每个特征的初始embedding过一个MLP和sigmoid函数生成其独立的特征权重分,同时也使用MLP对所有特征进行映射生成bit-wise的权重分,两者融合对输入特征进行加权。除了特征层外,在MLP的隐层,也利用类似的方法,对每个隐层的输入进行加权。

图片

图片

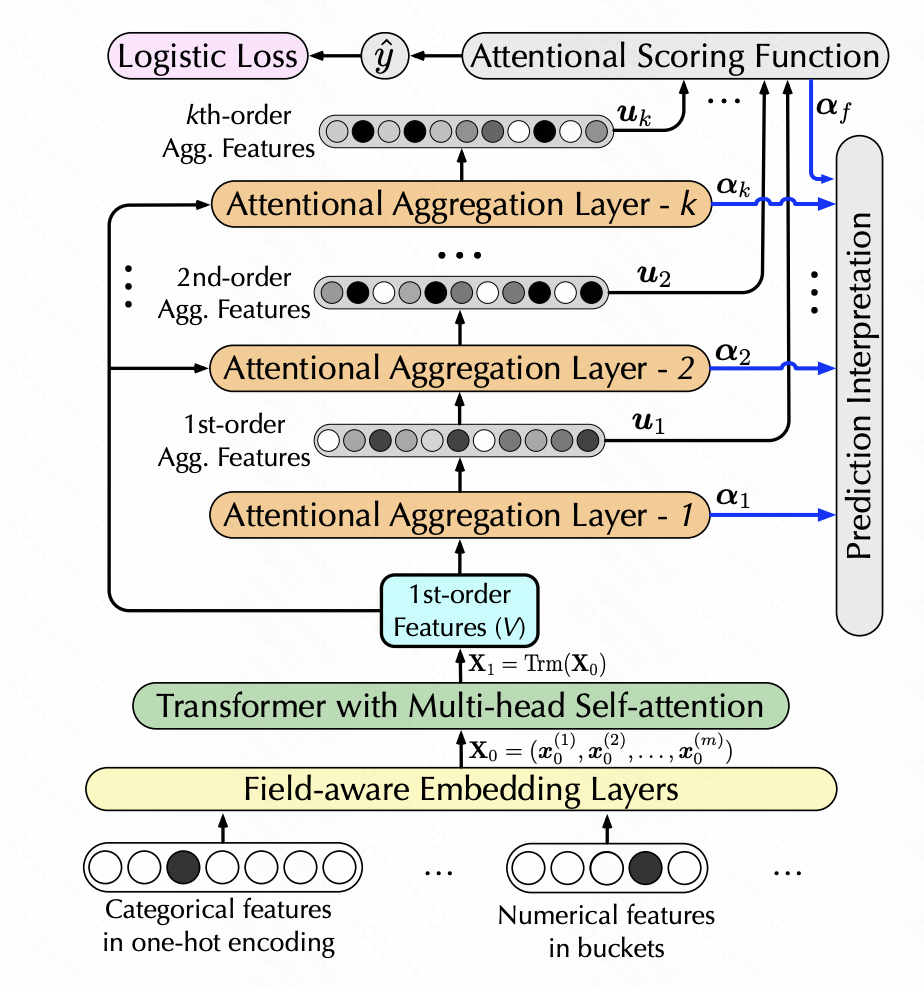

Interpretable Click-Through Rate Prediction through Hierarchical Attention(WSDM 2020)也是利用self-attention实现特征的转换,但是增加了高阶特征的生成。这里面使用层次self-attention,每一层的self-attention以上一层sefl-attention的输出作为输入,每一层增加了一阶高阶特征组合,实现层次多阶特征提取。具体来说,每一层进行self-attention后,将生成的新特征矩阵经过softmax得到每个特征的权重,根据权重对原始特征加权新的特征,再和原始特征进行一次点积,实现增加一阶的特征交叉。

图片

图片

ContextNet: A Click-Through Rate Prediction Framework Using Contextual information to Refine Feature Embedding(2021)也是类似的做法,使用一个MLP将所有特征映射成一个每个特征embedding尺寸的维度,对原始特征做一个缩放,文中针对每个特征使用了个性化的MLP参数。通过这种方式,利用样本中的其他特征作为上下位增强每个特征。

图片

图片

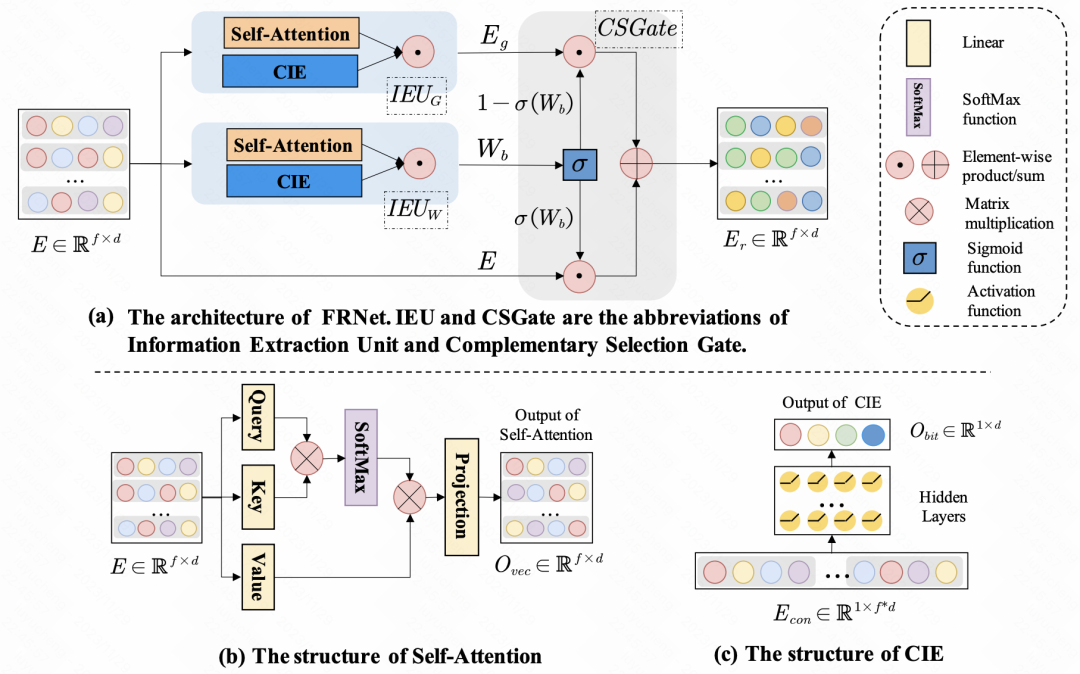

Enhancing CTR Prediction with Context-Aware Feature Representation Learning(SIGIR 2022)采用了self-attention进行特征增强,对于一组输入特征,每个特征对于其他特征的影响程度是不同的,通过self-attention,对每个特征的embedding进行一次self-attention,实现样本内特征间的信息交互。除了特征间的交互,文中也利用MLP进行bit级别的信息交互。上述生成的新embedding,会通过一个gate网络,和原始的embedding进行融合,得到最终refine后的特征表示。

图片

图片

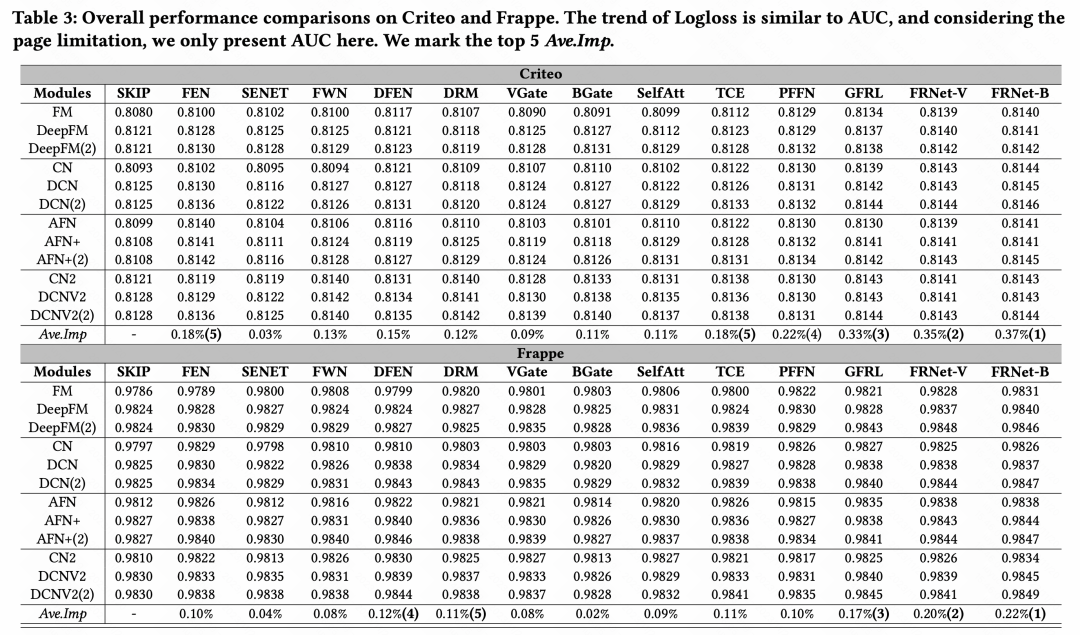

3、实验效果

文中进行了各类特征增强方法的效果对比,整体结论为,在众多特征增强模块中,GFRL、FRNet-V、FRNetB 表现的最好,并且效果要优于其他的特征增强方法。