12 月 13 日消息,微软公司今天发布新闻稿,表示旗下的 Phi-2 2.7B 模型,在多个方面都优于谷歌发布的 Gemini Nano-2 3.2B。

Phi-2 2.7B 模型

IT之家今年 11 月报道,微软在 Ignite 2023 大会上,宣布了拥有 27 亿参数的 Phi-2,性能方面相比较此前版本有明显提升。

微软于今年 6 月发布 Phi-1,只有 13 亿参数,适用于 QA 问答、聊天格式和代码等等场景。该模型完全基于高质量数据进行训练,在基准测试中的表现比同类模型高出 10 倍。

微软今年 9 月更新发布了 Phi-1.5 版本,同样为 13 亿参数,可以写诗、写电子邮件和故事,以及总结文本。在常识、语言理解和推理的基准测试中,该模型在某些领域能够跟上多达 100 亿个参数的模型。

微软现在更新发布的 Phi-2 拥有 27 亿参数,规模虽然比此前版本翻番,但相比较其它主流语言模型,依然小很多。

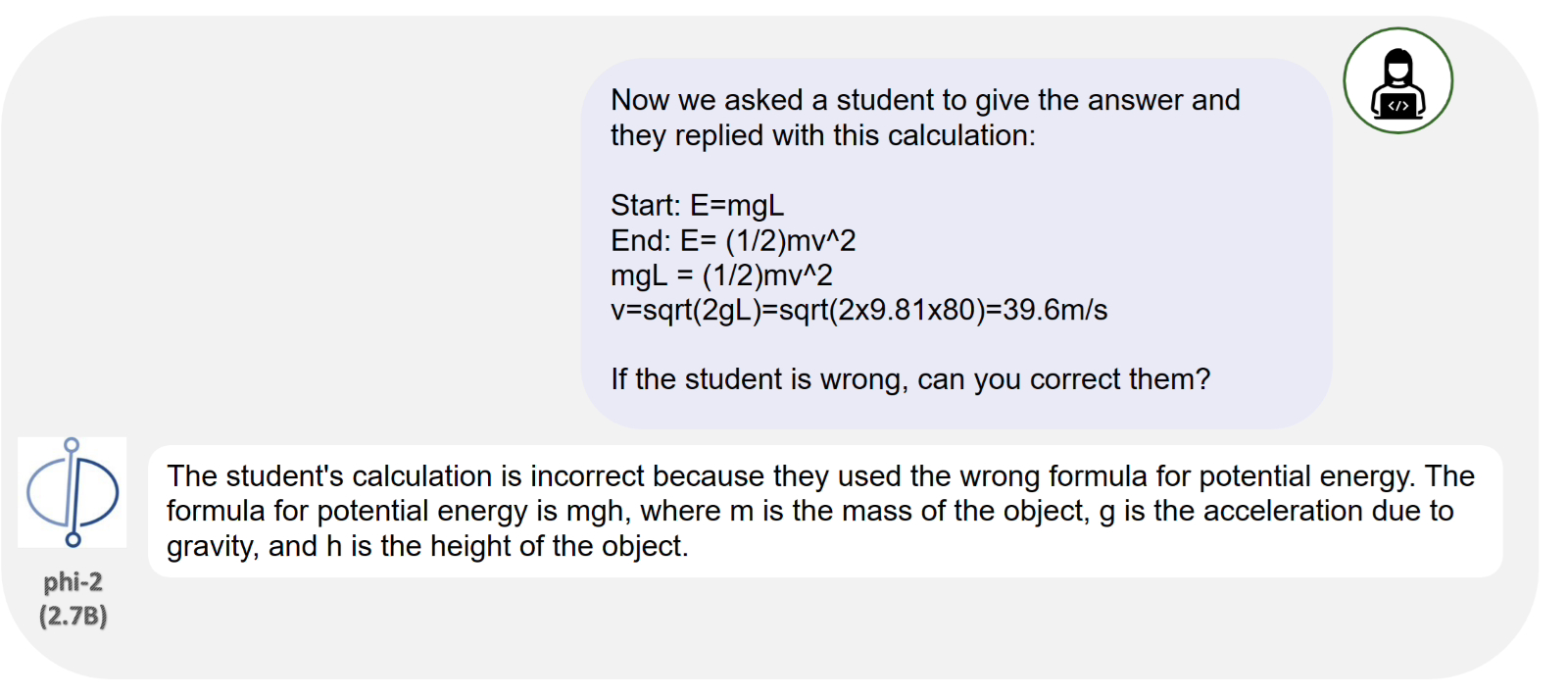

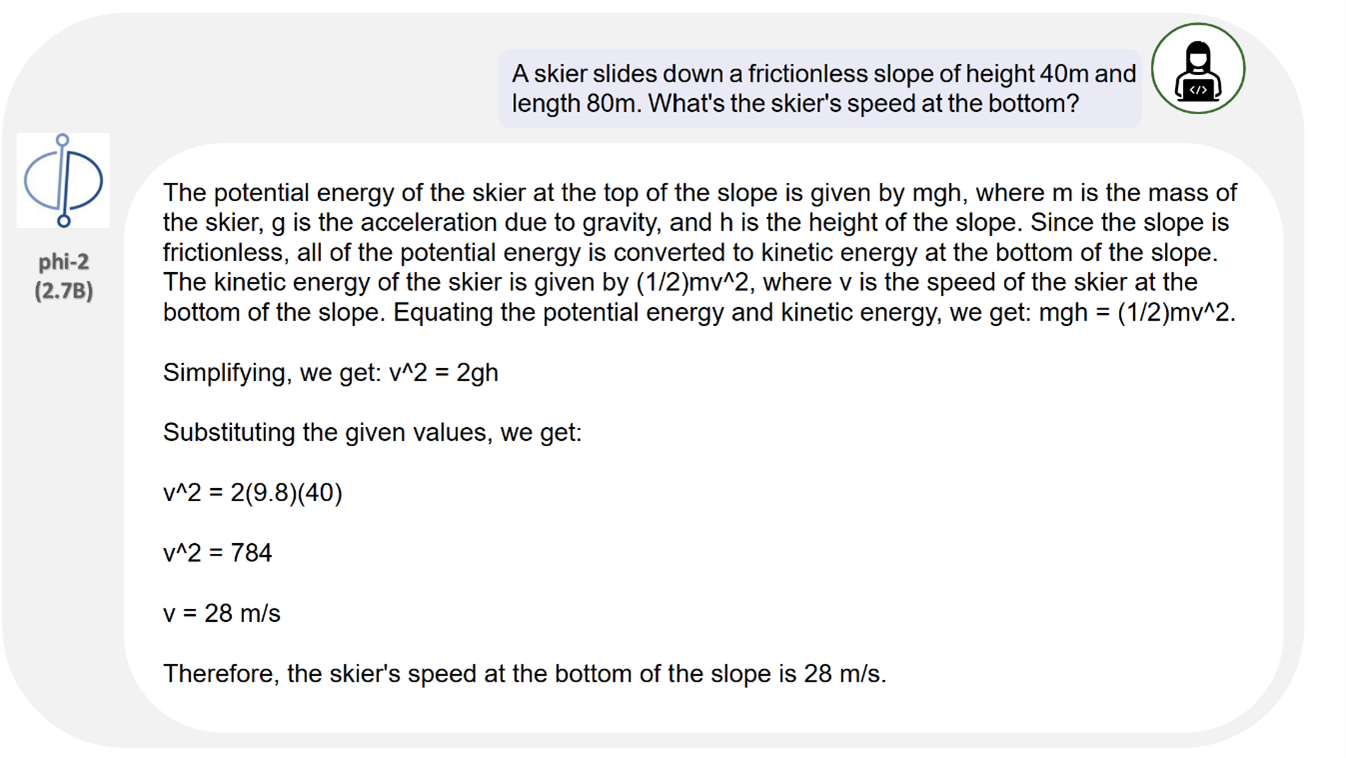

微软表示 Phi-2 在逻辑推理和安全性方面显示出显著的改进。通过正确的微调和定制,小型语言模型是云和边缘应用程序的强大工具。

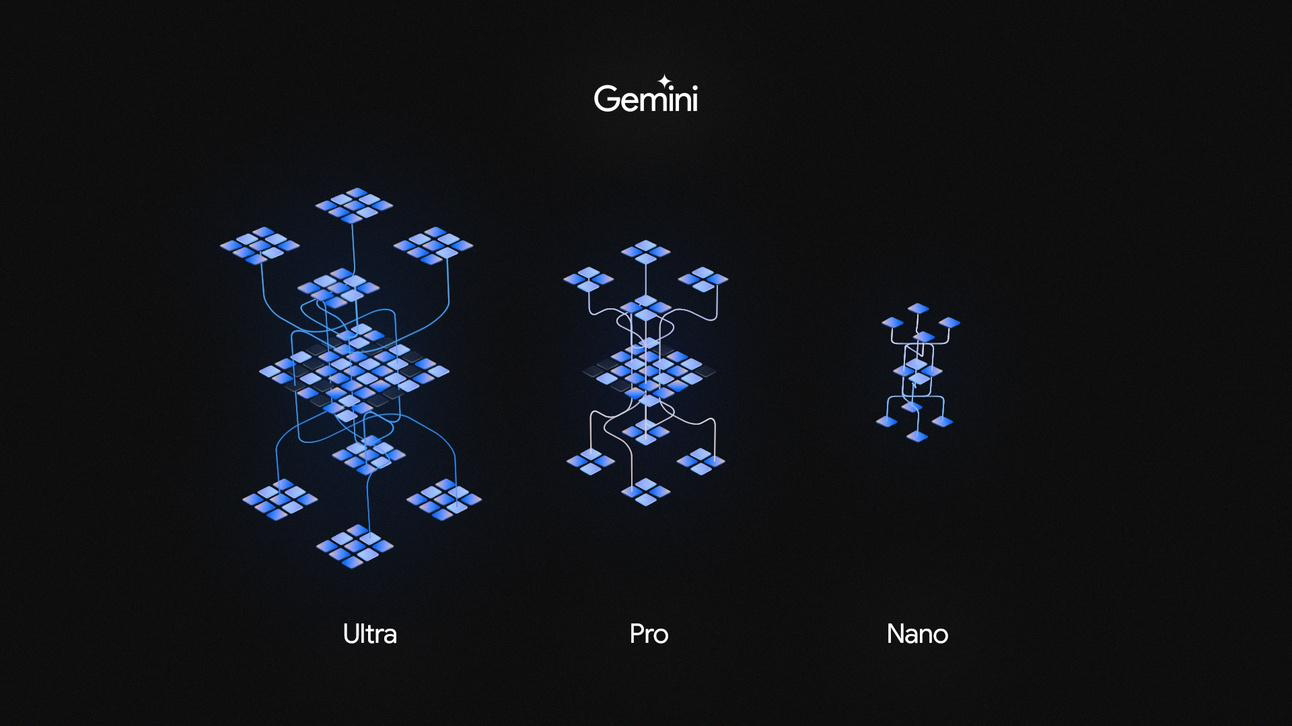

谷歌 Gemini Nano-2 3.2B

Gemini Nano 是一个专门为在小型设备上本地运行而构建的模型版本,最新 2.0 版本有 32 亿参数,将率先装备在 Pixel 8 Pro 机型上。

在录音场景下,选中录音文件并点击“Transcript(文本稿)”标签,再点击顶部的“总结”按钮,该 App 将会生成多条与录音内容有关的要点。

在 Gboard 输入法中,Gemini Nano 将会实现“具有对话意识的高质量回复”,其中 WhatsApp 将是第一个支持智能回复的 App,明年其他 App 也将陆续获得支持。

对比

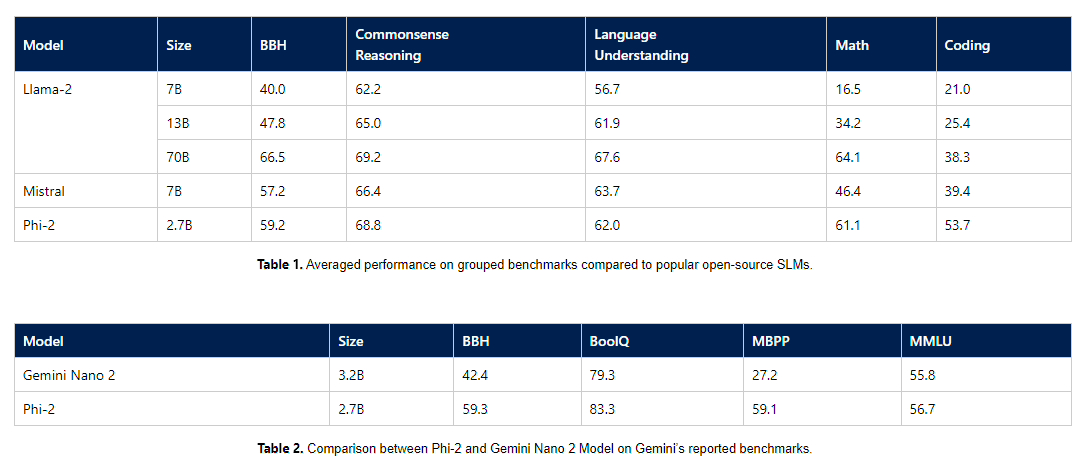

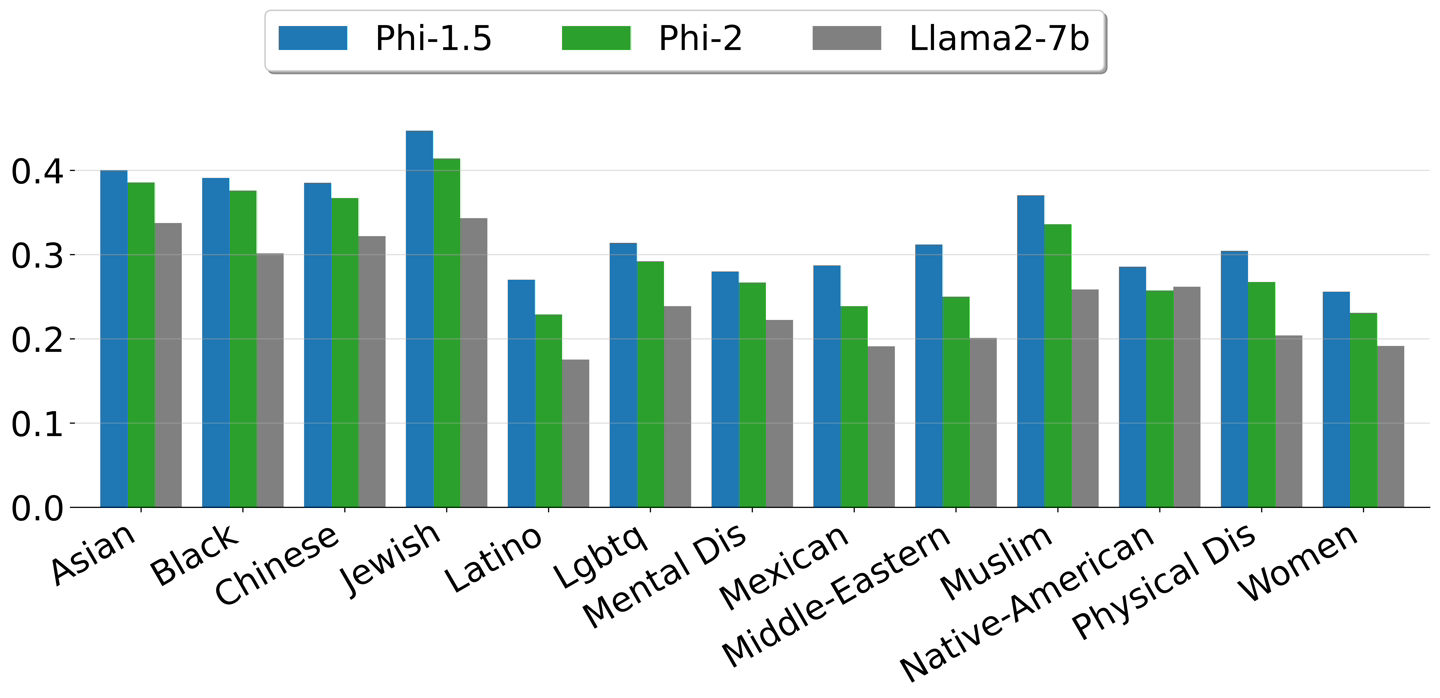

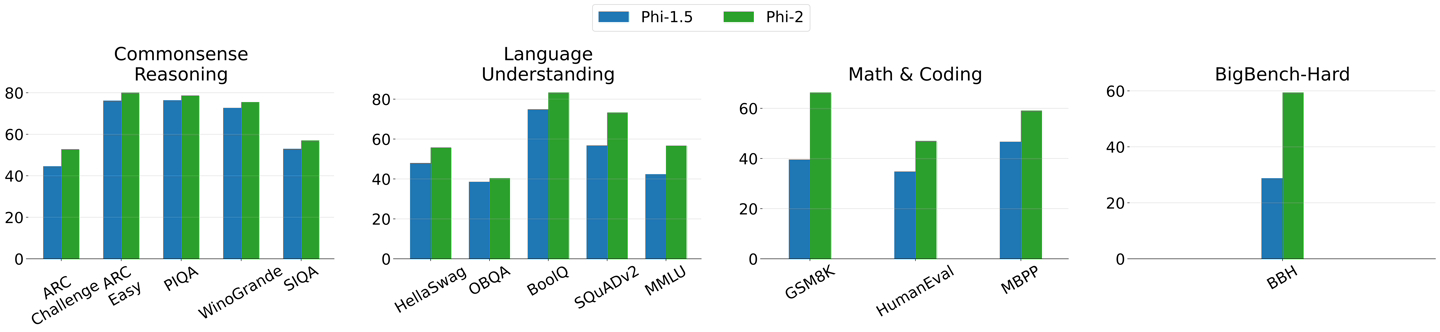

微软在最新博文中,对比了 Phi-2 模型和谷歌的 Gemini Nano-2 模型,表示 Phi-2 多项性能均优于 Gemini Nano-2 模型。

微软还对比表示其 Phi-2 性能,已经超过了 70 亿参数和 130 亿参数的 Llama-2,以及 70 亿参数的 Mistral。

IT之家附上微软官方博文地址,感兴趣的用户可以深入阅读。