本文经自动驾驶之心公众号授权转载,转载请联系出处。

自主驾驶在复杂场景下的目标检测任务至关重要,而毫米波雷达和视觉融合是确保障碍物精准检测的主流解决方案。本论文详细介绍了基于毫米波雷达和视觉融合的障碍物检测方法,从任务介绍、评估标准和数据集三方面展开。

并对毫米波雷达和视觉融合过程的传感器部署、传感器标定和传感器融合(融合方法分为数据级、决策级和特征级融合方法)三个部分进行了汇总讨论。

此外,还介绍了三维(3D)目标检测、自动驾驶中的激光雷达和视觉融合以及多模态信息融合,并进行了展望。

背景介绍

较高level的自动驾驶车辆面临的挑战之一是复杂场景中的精确目标检测,当前的视觉目标检测算法已经达到了性能上限,因为检测算法在实践中面临非常复杂的情况。

对于自动驾驶场景,障碍物主要包括行人、汽车、卡车、自行车和摩托车,视觉范围内的障碍物具有不同的尺度和长宽比。此外,障碍物之间可能存在不同程度的遮挡,并且由于暴雨、大雪和大雾等极端天气,障碍物的外观可能会模糊,从而导致检测性能大大降低[13]。研究表明,CNN对未经训练的场景泛化能力较差[14]。

camera不足以独立完成自动驾驶感知任务,与视觉传感器相比,毫米波雷达的检测性能受极端天气的影响较小[15]、[16]。此外,毫米波雷达不仅测量距离,还可以利用运动物体反射信号的多普勒效应测量速度矢量[17]、[18]。然而,毫米波雷达无法提供目标的轮廓信息,并且难以区分相对静止的目标。从这个方面看,视觉传感器和毫米波雷达的探测能力可以相互补充。基于毫米波雷达和视觉融合的检测算法可以显著提高自主车辆的感知能力,帮助车辆更好地应对复杂场景中的目标检测任务。

基于毫米波雷达和视觉融合的目标检测过程如下图所示,毫米波雷达与视觉融合过程包括三个部分:传感器选择、传感器标定和传感器融合,为了实现毫米波雷达和视觉融合目标检测的预期性能,需要解决以下挑战:

- 同一时间和空间的标定校准;

- 融合不同传感器的数据以实现best性能的目标检测;

最近几年,大部分综述集中在视觉检测上,很少有radar-camera融合相关的paper,对雷达和视觉融合缺乏深入分析,本论文将重点介绍低成本毫米波雷达和视觉融合解决方案。

检测任务定义

二维(2D)目标检测使用2D box在车辆的视觉图像中选择检测到的障碍物目标,然后对目标进行分类和定位。这里的定位指的是图像中目标的定位,而不是真实世界中目标相对于车辆的定位。

在三维(3D)目标检测中,使用3D box定位目标,不仅是图像中确定目标的位置,而且还确定了现实世界中目标的姿态和位置。

评价标准

主要使用AP和AR权衡目标检测中的准确度和召回率,通过将召回值和精度值分别作为水平轴和垂直轴,可以获得精度召回(PR)曲线,平均精度(mAP)表示检测模型的合并结果,可通过计算所有类别的平均AP值获得。

以自动驾驶KITTI数据集为例,对于2D对象检测,通过比较检测边界框和gt边界框之间的IoU是否大于阈值来确定目标定位的正确性[22]。然而在自主驾驶的研究中,三维目标检测目前更具吸引力。KITTI正式规定,对于车辆,正确预测要求预测的3D框与真实3D框重叠70%以上,而对于行人和自行车,则要求3D框重叠50%[24]。

相关数据集

相关数据集主要包括:Apolloscape、KITTI、Cityscapes、Waymo Open Dataset、nuScenes等;

Apolloscape

百度在2017年创建的阿波罗开放平台的part,它使用Reigl激光雷达收集点云,Reigl生成的三维点云比Velodyne生成的点云更精确、密度更高。目前,ApolloScape已经打开了147000帧像素级语义标注图像,包括感知分类和道路网络数据等。

KITTI

KITTI数据集[22],由德国卡尔斯鲁厄理工学院和美国丰田学院建立,是目前最常用的自动驾驶数据集。该团队使用了一辆配备camera和Velodyne激光雷达的大众汽车在德国卡尔斯鲁厄开车6小时,记录交通信息。数据集为每个序列提供原始图像和精确的三维box以及类标签。类主要包括汽车、面包车、卡车、行人、自行车和电车。

Cityscapes

由三个德国实验室联合提供:戴姆勒、马克斯·普朗克信息研究所和达姆施塔特科技大学。它是一个语义理解图像-城市街道场景数据集,主要包含来自50多个城市的5000张城市环境中驾驶场景的高质量像素级标注图像(2975张用于training,500张用于val,1525张用于test,共19个类别)。此外,它还有20000张粗略的标注图像。

Waymo Open Dataset

Waymo数据集是Alphabet股份有限公司旗下自动驾驶公司Waymo的开源项目。它由Waymo自动驾驶汽车在各种条件下收集的标定数据组成,包括覆盖25个城市的1000多万英里自动驾驶里程数据。数据集中包括激光雷达点云和视觉图像。车辆、行人、骑自行车的人和标志都经过了精心标记,该团队完成了1200多万条3D标注和120万条2D标注。

nuScenes

nuTonomy建立的Nuscene数据集[29]是现有最大的自动驾驶数据集,这是第一个配备全自动车辆传感器的数据集。该数据集不仅提供相机和激光雷达数据,还包含radar数据,是目前唯一一个包含雷达数据的数据集。nuScenes提供的三维边界框标注不仅包含23个类,还包含8个属性,包括行人姿势、车辆状态等。

传感器部署

绝大多数汽车制造商采用了radar和摄像头相结合的传感器配置方案,除了特斯拉,其他制造商也使用了融合传感技术,将激光雷达、毫米波雷达和camera结合起来。可以得出结论,使用radar和视觉融合的传感解决方案是当前自主驾驶车辆障碍物检测领域的主流趋势,主要因为radar和camera具有互补的特性。

领域方案传感器部署汇总:

Lidar、Radar、Camera三类传感器性能对比:

毫米波雷达作为自动驾驶车辆上常见和必要的传感器,具有远距离探测、低成本和动态目标可探测性的特点。由于这些优点,车辆的感应能力和安全性得到了提高[37]。与激光雷达相比,毫米波雷达的优势主要体现在应对恶劣天气和低部署成本方面[36]。此外,它还有以下优点:

- 毫米波雷达可以探测250米范围内的障碍物,这对自主驾驶的安全至关重要,而激光雷达的探测范围在150米范围内[41]。

- 毫米波雷达可以基于多普勒效应测量目标车辆的相对速度,分辨率为0.1m/s,这对于自主驾驶中的车辆决策至关重要[41]。

与毫米波雷达相比,激光雷达具有以下优点[38]、[39]:

- 激光雷达比毫米波雷达具有相对较高的角度分辨率和检测精度。此外,毫米波雷达数据更稀疏;

- 激光雷达的测量包含语义信息,并满足先进自主驾驶的感知要求,而毫米波雷达缺乏这一点;

- 无法从毫米波雷达测量中完全滤除杂波,导致雷达信号处理中出现错误;

radar是探测距离和径向速度的最佳传感器。它具有“全天候”功能,特别是考虑到它在夜间仍能正常工作。然而,雷达无法区分颜色,目标分类能力较差[36]。camera具有良好的颜色感知和分类能力,角度分辨率能力不弱于激光雷达[36]。然而,它们在估计速度和距离方面受到限制[40]。此外,图像处理依赖于车载芯片算力,而不需要毫米波雷达的信息处理。充分利用雷达感应信息可以大大节省计算资源[36]。通过比较radar和摄像机的特性,可以发现它们之间有许多互补的特性。因此,将radar和视觉融合感知技术应用于障碍物检测领域,可以有效提高感知精度,增强自主车辆的目标检测能力。毫米波雷达或激光雷达和视觉融合都很有用。

传感器标定

不同传感器的空间位置和采样频率不同,同一目标的不同传感器的传感信息可能不匹配。因此,校准不同传感器的传感信息非常必要,毫米波雷达返回的检测信息是雷达点,camera接收视觉图像。以nuScenes[29]的相机和毫米波雷达数据作为示例。该数据集提供的数据已通过帧同步处理,因此不需要时间同步,下图效果可通过空间坐标变换获得。雷达点的RGB值由横向速度、纵向速度和距离这三个物理量转换而来,雷达点的颜色表示与雷达点对应的对象的物理状态。一般而言,传感器校准包括坐标标定[42]–[48]、雷达点滤波[43]、[45]和误差校准[49]–[51]。

坐标系标定

坐标标定的目的是将雷达点与图像中的目标进行匹配。对于坐标标定,最常用的方法分为坐标变换方法[45]、[46]、传感器验证方法[42]、[44]、[47]和基于视觉的方法[43]、[52]。

坐标变换法通过矩阵运算将同一坐标系下的雷达信息和视觉信息统一起来。[46]根据毫米波雷达和视觉传感器的空间位置坐标,通过坐标变换方法完成空间校准。针对不同传感器采样率引起的时间不一致性,采用线程同步方法实现图像帧和毫米波雷达数据的同时采集。[45]使用了基于伪逆的点对齐方法,该方法使用最小二乘法获得坐标变换矩阵。传统的坐标变换无法生成目标的精确位置,给最终结果带来误差。[53]Wang等人提出了一个校准实验,在不使用专用工具和雷达反射强度的情况下,将真实坐标投影到雷达探测图中,这削弱了对校准误差的依赖性。

传感器验证方法利用同一物体上不同传感器的检测信息相互校准多个传感器。在[42]中,传感器验证包括两个步骤。首先通过雷达生成目标列表,然后通过视觉信息对列表进行验证。[47]经过radar坐标变换后,首先粗略搜索图像,然后与雷达信息进行比较。比较结果将目标分为两类:匹配目标和非匹配目标。在[44]中,Streubel等人设计了一种融合时隙方法,匹配雷达和视觉在同一时隙中检测到的对象。

基于视觉的方法:[52]使用运动立体技术实现雷达目标和图像目标的匹配。[43]Huang等人使用自适应背景减法来检测图像中的运动目标,生成候选区域,并通过判断目标是否存在来验证目标雷达点是否位于候选区域。

Radar点滤波

雷达点滤波的目的是滤除噪声和无用的检测结果,以避免这些雷达点造成的误判。[45]Guo等人提出了一种利用帧内聚类和帧间跟踪信息进行噪声滤波和有效目标提取的方法。在[43]中,通过毫米波雷达获得的速度和角速度信息对雷达点进行滤波。然后对无效雷达点进行滤波,从而减少树木和桥梁等固定目标对毫米波雷达的影响。

误差校准

由于传感器或数学计算中的误差,校准的雷达点可能存在误差。一些文章提出了纠正这些错误的方法。在[50]中,提出了一种基于交互式微调的方法,对投影在视觉图像上的雷达点进行最终校正。[51]中的作者提出了一种改进的扩展卡尔曼滤波(EKF)算法,用于建模不同传感器的测量误差。在[49]中,分析了各种坐标对检测结果的影响,并提出了一种半积分笛卡尔坐标表示方法,将所有信息转换为随宿主车辆移动的坐标系。目前使用开源数据集时,不需要进行误差校准。然而,如果数据集是自制的,则雷达滤波和纠错是必要的技术步骤。

基于传感器融合的检测任务

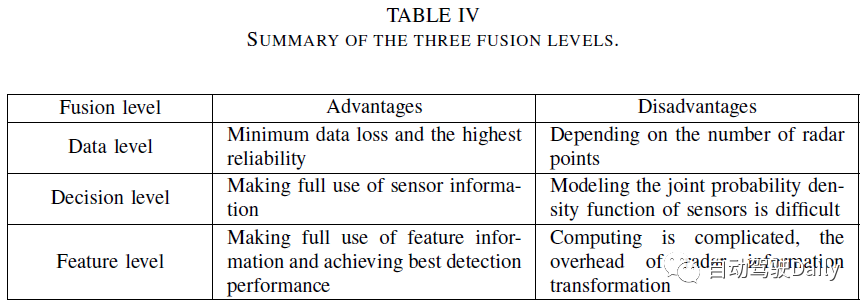

一般来说,毫米波雷达和视觉融合分为三个层次,包括数据层、决策层和特征层。数据级融合是毫米波雷达和摄像机检测到的数据的融合,具有最小的数据丢失和最高的可靠性。决策级融合是毫米波雷达和摄像机检测结果的融合。特征级融合需要提取雷达特征信息,然后将其与图像特征融合。

数据层融合

数据级融合是一种成熟的融合方案,目前还不是主流的研究趋势。然而,其融合不同传感器信息的想法仍有参考价值。如下表所示,数据级融合首先基于雷达点[42]、[45]、[54]、[55]生成感兴趣区域(ROI)。然后根据ROI提取视觉图像的对应区域。最后,使用特征提取器和分类器对这些图像进行目标检测[45]、[47]、[53]、[55]–[61]。

一些文献使用神经网络进行目标检测和分类[61]、[62]。对于数据级融合,有效雷达点的数量直接影响最终的检测结果。如果图像的某一部分中没有雷达点,则该部分将被忽略。该方案缩小了目标检测的搜索空间,节省了计算资源,同时留下了安全隐患。数据级融合过程如图4所示。

ROI的生成

ROI是图像中的选定区域,与纯图像处理方案相比,数据级融合方案使用雷达点生成ROI,这可以显著提高ROI生成的速度[42]。初始ROI的大小由障碍物和毫米波雷达之间的距离决定[45]。

目标检测

由于图像中目标位置和大小的不确定性,基于视觉的目标检测通常采用滑动窗口和多尺度策略,产生大量候选框,导致检测效率低。毫米波雷达与视觉融合方案避免了滑动窗口方法,降低了计算成本,提高了检测效率。

决策层融合

决策级融合是目前主流的融合方案,该过程如下表所示:

雷达的优势在于纵向距离,视觉传感器的优势在于水平视野。决策级融合可以兼顾这两方面的优点,充分利用传感信息。决策级融合滤波算法的挑战是建模两种检测信息的联合概率密度函数,决策级融合主要包括两个步骤:传感信息处理[65]–[69]、[71]和决策融合[66]、[72]–[78]、[84]。

传感信息处理

传感信息的处理包括雷达信息和视觉信息。雷达探测结果生成一个物体列表,并包含物体的速度和距离等信息[65]、[66];视觉信息处理对图像执行目标检测算法,定位2D位置。

决策融合

车辆检测的决策级融合融合不同传感器的检测结果,主流滤波算法应用贝叶斯理论[72]、[73]、卡尔曼滤波框架[74]–[76]和Dempster-Shafer理论[66]。在一些文献中,雷达检测目标列表用于验证视觉检测结果[77]、[78],此外,参考文献[84]提出了运动立体算法来调整和细化最终检测结果。

基于贝叶斯理论的融合方法

参考文献[72]提出了一种基于贝叶斯理论的方法,通过使用概率推理方法来解决多传感器数据融合问题,称为贝叶斯规划。当添加新的传感器时,传统的多传感器融合算法不再适用。融合算法在[73]中进行了模块化和推广,并提出了一种基于贝叶斯网络的动态融合方案,以提高每个融合算法的可重用性。

基于卡尔曼滤波的融合方法

[74]基于李群的EKF框架,提出了一种使用特殊欧几里德群的决策级融合滤波器。参考文献[75]提出了一种融合框架,可以在3D空间和2D图像平面中同时跟踪检测对象。类似于卡尔曼滤波器的不确定性驱动机制用于均衡不同质量的传感结果。在[76]中,雷达首先检测到给定图像,以粗略搜索目标。然后使用经过训练的点检测器来获得对象的边界框。采用基于卡尔曼滤波的信息融合方法,证明了集中式和分散式信息融合方案的功能等价性。

基于Dempster-Shafer理论的融合方法

参考文献[66]提出了基于Dempster-Shafer理论的决策级融合,将多个传感器的检测列表作为输入,使用其中一个作为临时evidence 网格,并将其与当前evidence 网格融合,最后执行聚类处理,在evidence 网格中确定了目标。

基于雷达验证的融合方法

参考文献[77]将视觉检测和雷达检测生成的目标列表重叠,以生成唯一的车辆列表。雷达数据用于验证视觉检测结果,如果存在与雷达数据中的视觉检测结果匹配的目标,则蓝色框将被标记为强假设。否则,如果没有目标,它不会被丢弃:一个绿框将被标记为弱假设。参考文献[78]提出了一种多目标跟踪(MTT)算法,该算法可以通过评估雷达散射中心的跟踪分数来实时校正被跟踪目标列表。利用立体视觉信息拟合目标车辆的轮廓,并利用与目标车辆匹配的雷达目标校正其位置。

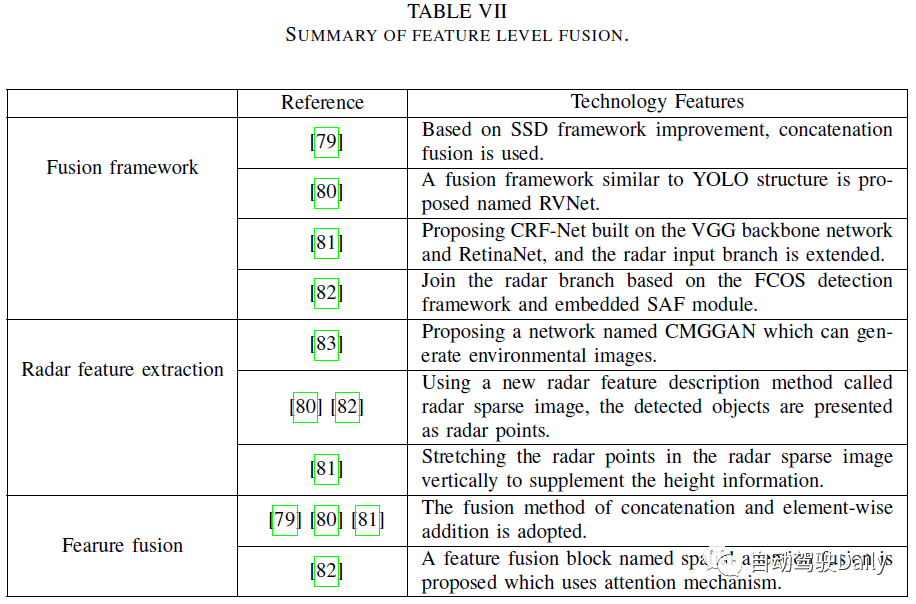

特征级融合

特征级融合是近年来出现的一种新方案,该过程如下表所示:

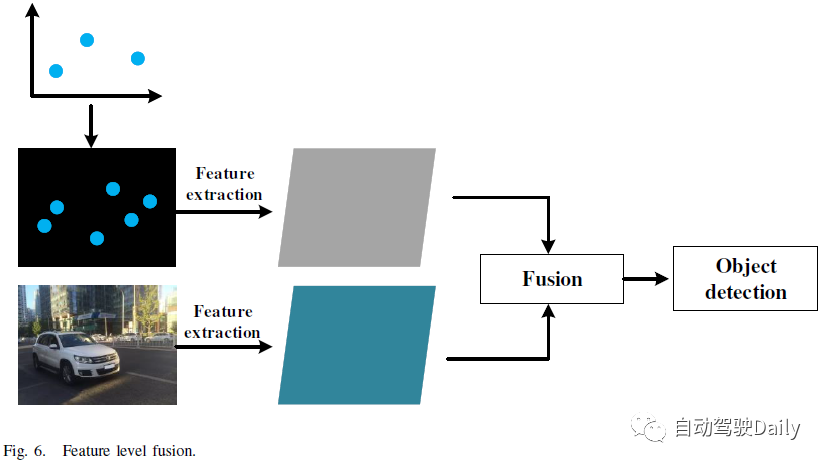

在特征级融合方法[79]–[83]中,使用额外的雷达输入分支是一种常见的方法,基于CNN的目标检测模型可以有效地学习图像特征信息。通过将雷达检测信息转化为图像形式,检测模型可以同时学习雷达和视觉特征信息,实现特征级融合,特征级融合过程如下图所示:

基于CNN的融合框架

雷达特征提取的目的是变换雷达信息,因为雷达信息不能与图像信息直接融合。雷达特征提取主要采用将雷达点转换到图像平面生成雷达图像的方法。多通道变换后的雷达图像包含雷达检测到的所有环境特征,每个通道表示一个物理量,如距离、纵向速度、横向速度等。参考文献[83]提出了一种新的条件多生成器生成对抗网络(CMGGAN),该网络利用雷达传感器的测量数据生成类似camera图像,包括雷达传感器检测到的所有环境特征。[80]提出了一种新的雷达特征描述方法,称为雷达稀疏图像,雷达稀疏图像是416×416三通道图像,其大小直接对应于视觉图像的大小,这三个通道包含雷达点速度和深度特征信息。在[82]中,Chang等人将雷达点处的深度、水平和垂直信息转换为不同通道的真实像素值。对于没有雷达点的区域,他们将像素值设置为0,并使用以雷达点为中心的圆圈渲染雷达图像。在[81]中,考虑到雷达检测结果中缺乏高度信息,Nobis等人在垂直方向上拉伸投影雷达点,以便更好地将其与图像整合。雷达信息的特征以像素值的形式存储在增强图像中。此外,还提出了一种地面真值噪声滤波器来滤除无效雷达点。

特征融合

基本特征融合方法可分为两类:级联和元素相加。前者将雷达特征矩阵和图像特征矩阵连接成多通道矩阵,而后者将两个矩阵合并成一个矩阵。

[79]设置了两种融合方法:级联和逐元素相加,实验结果表明这两种融合方式都提高了检测性能。按逐元素添加方法在手动标注的测试集上性能更好,而级联方法在生成的测试集中性能更好。[82]中提出了一种用于传感器特征融合的新块,称为空间注意融合(SAF)。使用SAF块生成注意力权重矩阵,以融合雷达和视觉特征。同时,[82]将SAF方法与三种逐元素加法、乘法和级联方法进行了比较,结果表明,SAF具有最佳性能。此外,[82]在Faster R-CNN上进行了泛化实验,SAF模型也提高了检测性能。

挑战和未来趋势

Challenges

对于目标检测任务,目前的研究成果已经取得了优异的性能,然而,这些成果大多是二维目标检测。在真实的自动驾驶场景中,复杂的交通环境通常需要3D目标检测来更准确地感知环境信息,当前3D对象检测网络的性能远低于2D检测的水平。因此,提高三维目标检测的精度不仅是自动驾驶领域的一项挑战,也是目标检测任务中的一项重大挑战。

毫米波雷达和视觉的融合仍然存在挑战,这是本文的重点。毫米波雷达的最大缺点是雷达特征稀疏,与视觉图像相比,毫米波雷达提供的信息非常少,无法带来显著的性能改进。此外,毫米波雷达和视觉的特征信息是否可以进一步整合,以及它们之间的相关互信息是否已经挖掘出来,还有待研究。因此,毫米波雷达视觉融合仍然面临两大挑战:稀疏感知信息和更有效的融合,这也是多传感器融合领域的两大挑战!

Future Trends

作者认为有三个主要趋势,其中之一是3D对象检测:提高三维目标检测的精度将是一个主要的研究趋势。其余两个趋势涉及雷达视觉融合。一方面,有必要整合新的传感信息,即增加新的传感器,如激光雷达,它在自动驾驶方面取得了优异的性能;另一方面,有必要探索传感信息融合的新方法,如多模态融合。

基于多传感器融合的三维目标检测还在基于视觉的目标检测网络的基础上增加了雷达输入分支和信息融合模块。参考文献[91]使用了一种类似于特征级融合的方案,首先通过2D检测将雷达点绘制成矩形区域,然后执行3D检测。此外,由于激光雷达具有丰富的特征,可以重建物体轮廓,更容易估计三维box,因此,利用激光雷达进行多传感器融合三维物体检测的研究较多。

随着激光雷达成本的降低,配备激光雷达的自动驾驶车辆已成为一种趋势。然而,激光雷达不能替代毫米波雷达,毫米波雷达有其独特的优势。激光雷达具有更高的探测精度,它们相辅相成,激光雷达和视觉的融合在自动驾驶中正变得很有价值。无论是毫米波雷达还是激光雷达,其传感信息在不同模式下都是相同的环境信息。雷达感测信息和视觉信息也是不同模态的信息。将雷达视觉融合视为多模态信息融合,可能有更好的解决方案。此外,在自动驾驶领域,数据集提供的毫米波雷达数据是后处理数据。然而,从信息保护的角度来看,后处理雷达数据中包含的信息量必须相对于原始数据丢失。如果将原始雷达检测数据和视觉图像视为两种不同的传感信息模式进行融合,则可以获得更丰富的传感信息。多模态信息融合的挑战在于如何完美地组合不同模态的信息及其携带的噪声,以及如何挖掘相关信息以帮助理解同一事物。

原文链接:https://mp.weixin.qq.com/s/Oc_rKRgxiYdA8JkJGILHVg