看!现在正有四位小姐姐在你面前大秀热舞:

以为是某些主播在短视频平台发布的作品?

No,No,No。

真实答案是:假的,生成的,而且还是只靠了一张图的那种!

真实的打开方式是这样的:

这就是来自新加坡国立大学和字节跳动最新的一项研究,名叫MagicAnimate。

它的作用简单来说可以总结为一个公式:一张图片 + 一组动作 = 毫无违和感的视频。

然后啊,这项技术一经公布,可谓是在科技圈里掀起了不小的波澜,众多科技大佬和极客们纷纷下场耍了起来。

就连HuggingFace CTO都拿自己的头像体验了一把:

顺便还风趣地开了句玩笑:

这算是健身了吧?我这周可以不去健身房了。

还有相当与时俱进的网友,拿着刚出炉的GTA6(侠盗猎车手6)预告片中的人物玩了一把:

甚至就连表情包们也成了网友们pick的对象……

MagicAnimate可以说是把科技圈的目光聚焦到了自己身上,因此也有网友调侃说:

OpenAI可以休息一下了。

火,着实是火。

一张图即可生成一段舞

那么如此火爆的MagicAnimate,该如何“食用”?

话不多说,我们现在就来手把手地体验一次。

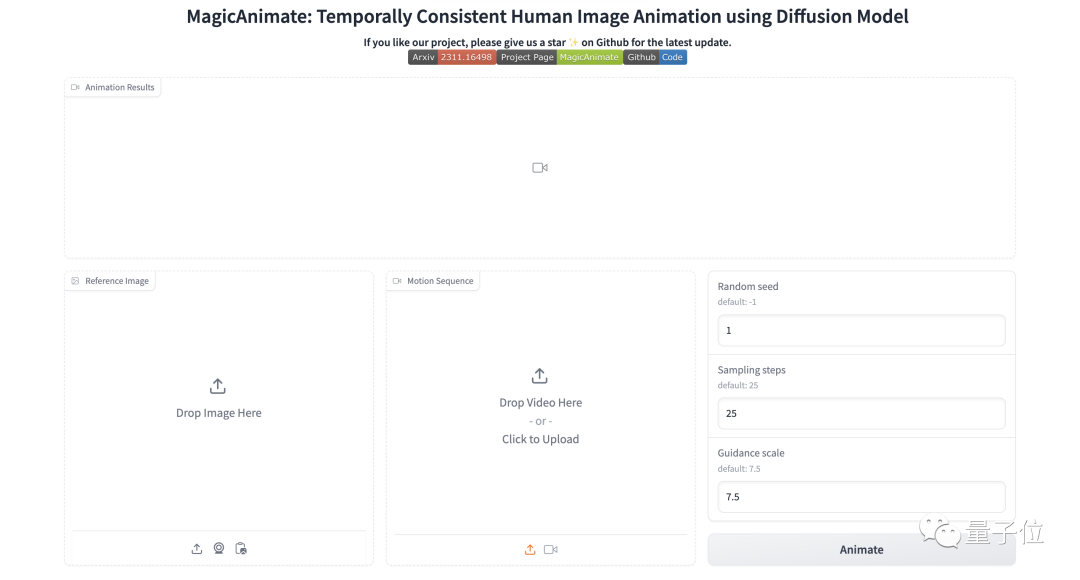

目前项目团队已经在HuggingFace中开放了在线体验的页面:

操作也是非常得简单,只需三步即可:

- 上传一张静态人物照片

- 上传想要生成的动作demo视频

- 调整参数,点击“Animate”即可

例如下面就是鄙人照片和一段近期席卷全球的《科目三》舞蹈片段:

△视频源:抖音(ID:QC0217)

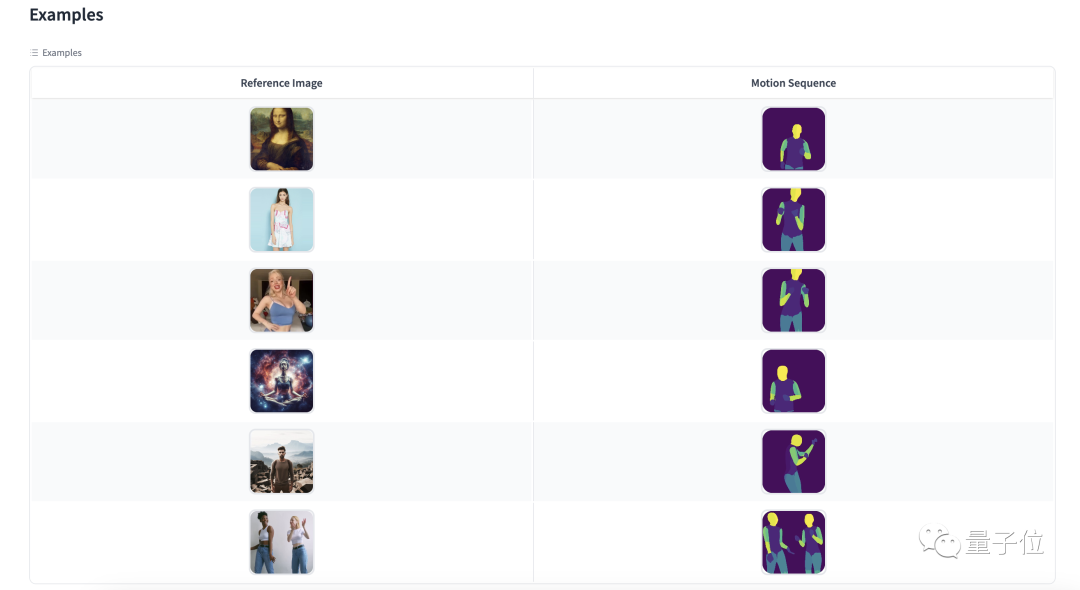

也可以选择页面下方提供的模版进行体验:

不过需要注意的是,由于MagicAnimate目前过于火爆,在生成的过程中可能会出现“宕机”的情况:

即便成功“食用”,可能也得排大队 ……

……

(没错!截至发稿,还是没有等到结果!)

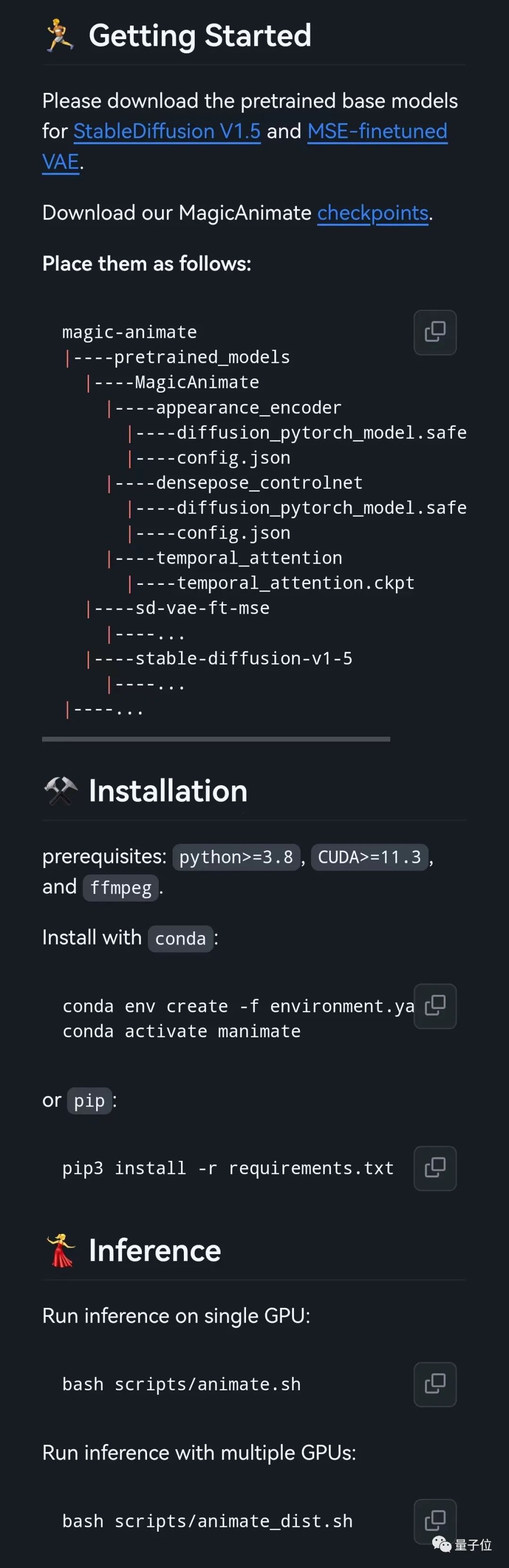

除此之外,MagicAnimate在GitHub中也给出了本地体验的方式,感兴趣的小伙伴可以试试哦~

那么接下来的一个问题便是:

怎么做到的?

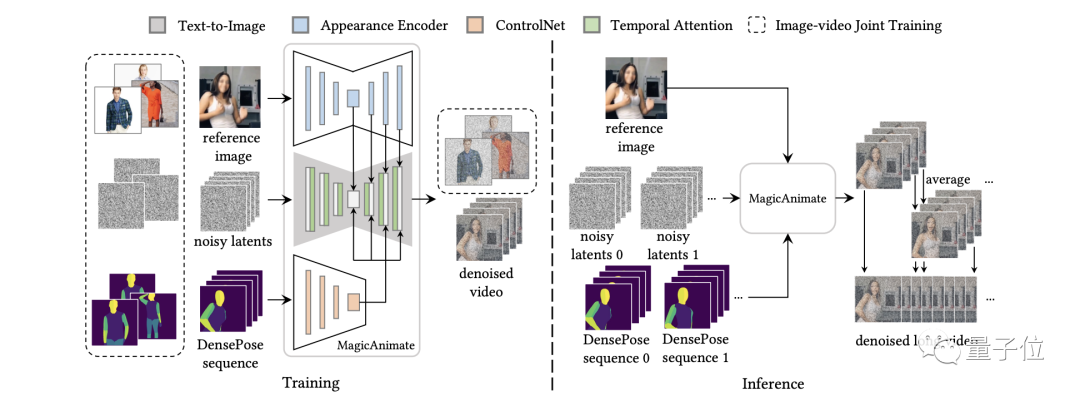

整体而言,MagicAnimate采用的是基于扩散模型(diffusion)的一个框架,目的就是增强时间一致性、保持参考图像的真实性,并提高动画保真度。

为此,团队首先开发了一个视频扩散模型(Temporal Consistency Modeling)来编码时间信息。

这个模型通过在扩散网络中加入时间注意力模块,来编码时间信息,从而确保动画中各帧之间的时间一致性。

其次,为了保持帧间的外观一致性,团队引入了一种新的外观编码器(Appearance Encoder)来保留参考图像的复杂细节。

这个编码器与以往使用CLIP编码的方法不同,能够提取密集的视觉特征来引导动画,从而更好地保留身份、背景和服装等信息。

在这两项创新技术的基础之上,团队进一步采用了一种简单的视频融合技术(Video Fusion Technique)来促进长视频动画的平滑过渡。

最终,在两个基准上的实验表明,MagicAnimate的结果要远优于以往的方法。

尤其是在具有挑战性的TikTok舞蹈数据集上,MagicAnimate在视频保真度方面比最强基线高出38%以上!

团队所给出的定性比较如下:

以及与cross-ID的SOTA基线相比,结果如下:

One More Thing

不得不说,诸如MagicAnimate的项目最近着实是有点火爆。

这不,在它“出道”前不久,阿里团队也发布了一个名叫Animate Anyone的项目,同样是只要“一张图”和“想要的动作”:

由此,也有网友发出了疑问:

这似乎是MagicAnimate和AnimateAnyone之间的战争。谁更胜一筹?

你觉得呢?

论文地址:https://arxiv.org/abs/2311.16498