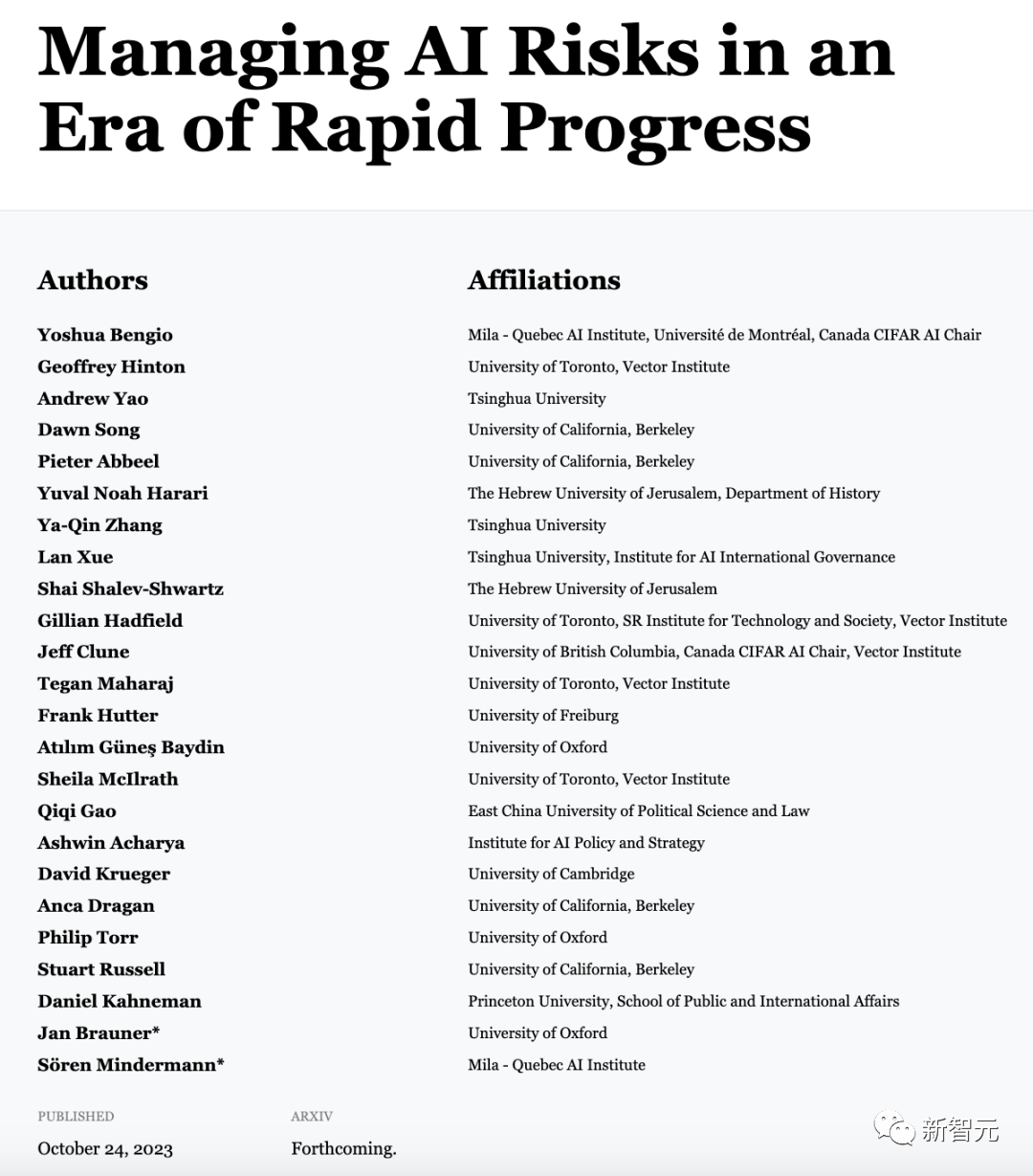

就在前几天,Benjio等一批大佬针对人工智能可能危及人类命运的议题,又一次公开签署了一封联名信。

Hinton,Benjio在信中继续呼吁加强对于AI技术发展的监管。

然而,以LeCun为首的「LLM成不了气候」派公开表态,AI监管弊大于利!

他们认为,相比于去担心「AI将引发世界末日」这种虚无缥缈风险,AI强监管所带来的「巨头垄断」,才是需要从业人员和政策制定者关心的紧迫问题。

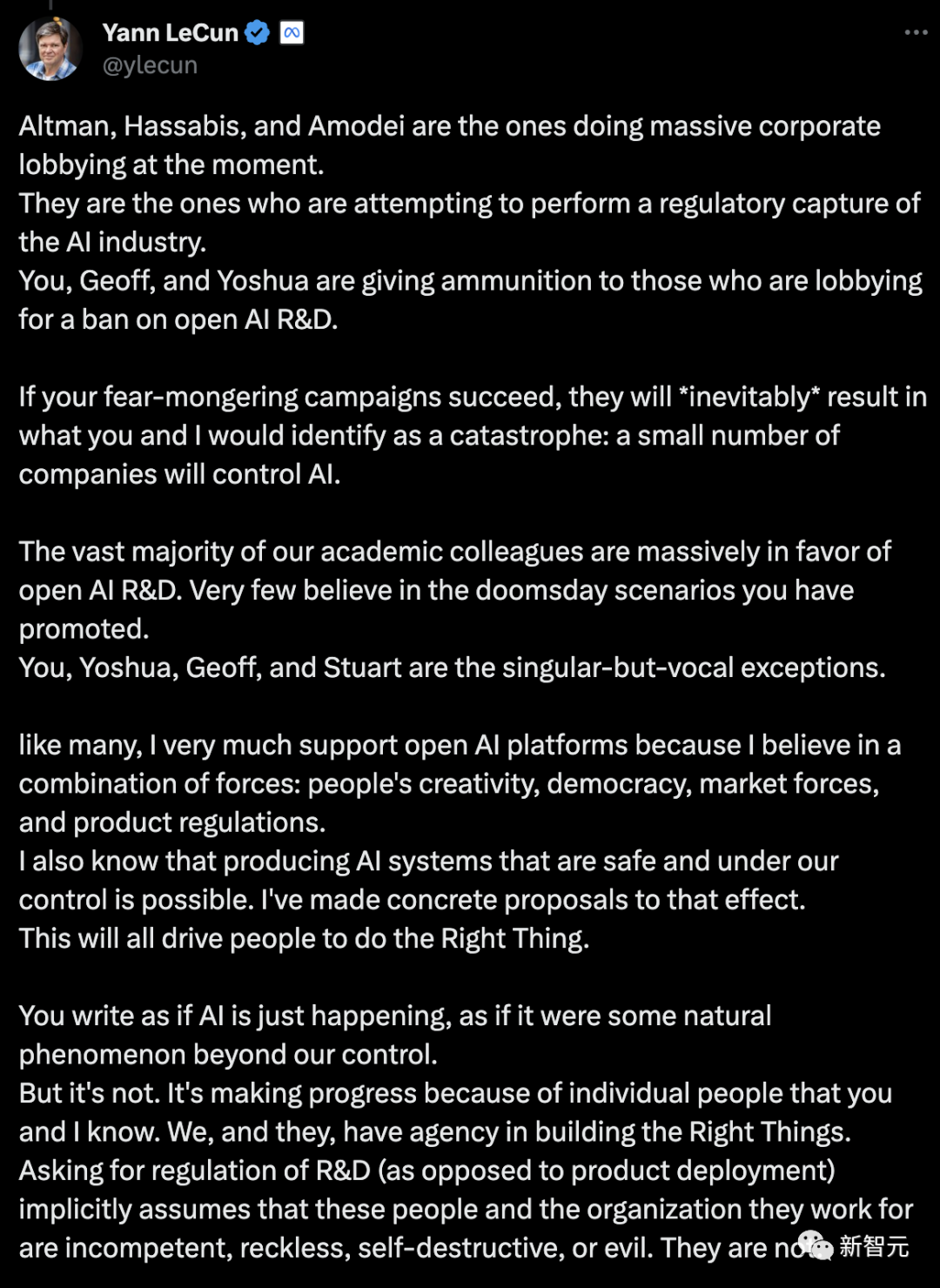

LeCun直接在推上点名了Sam Altman和DeepMind的Hassabis等人,认为他们试图通过游说监管来巩固自己的行业地位,阻碍AI开源的推进。

而且最近外媒爆出,吴恩达虽然在「LLM潜力」问题上,与LeCun有所分歧,但同样认为,不应该对AI技术的发展进行全面的严格监管。

「当你把这两个糟糕的想法放在一起时,你会得到一个非常非常愚蠢的想法——试图要求人工智能获得许可的政策提案,」吴恩达在接受「Financial Review」采访时表示。

而除了不断有业界大佬下场开撕之外,各国的政策制定者也已经开始行动。

美国政府已经出台行政命令,要求所有「前沿大模型」公司在训练模型时必须要通知政府。

而且还要求企业评估AI产品对于劳动力市场的影响情况。

吴恩达站队LeCun:AI技术必须开放

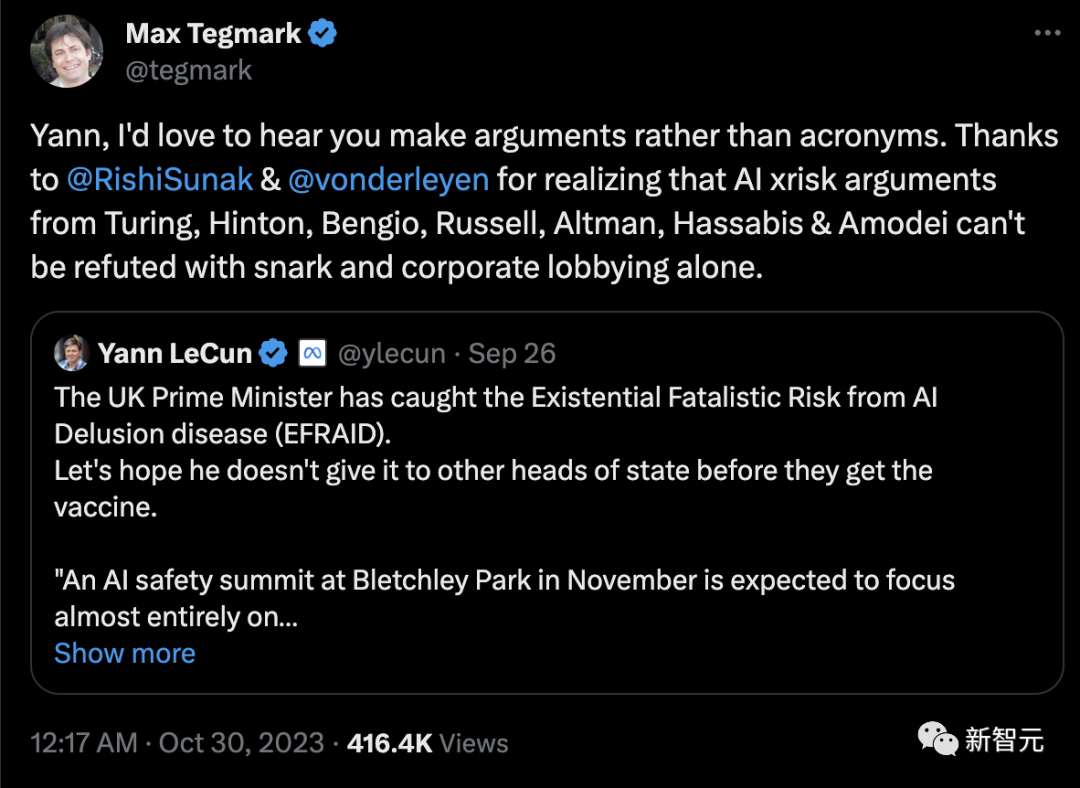

LeCun是在与MIT教授,知名物理学家,AI学者Tegmark的讨论中集中表达了自己对于最近联名信的看法的。

他认为「Sam Altman(OpenAI)、Hassabis(DeepMind)和Amodei(Anthropic)目前正在进行大规模的企业游说活动。他们是那些试图对人工智能行业进行监管的人。

Tegmark、Hinton和Benjio正在为那些游说禁止开放人工智能研发的人提供弹药。」

而吴恩达在最近接受媒体采访时表示,对AI技术发展进行强监管是一个「阴谋」。

「当你把这两个糟糕的想法放在一起时,你会得到一个非常非常愚蠢的想法,即试图要求人工智能获得许可的政策提案,」他在接受采访表示。

「这会摧毁创新,」吴恩达强调。「肯定有一些大型科技公司不愿意与开源AI竞争,因此他们正在制造对AI导致人类灭绝的恐惧。」

「这一直是游说者寻求的立法武器,而这对开源社区来说是非常有害的,」他说。

「我不认为没有监管是正确的答案,但随着许多国家监管的发展方向,我认为没有监管会比现在的情况更好」

而对于Sam Altman,吴恩达也表示了不同的看法,「Sam是我在斯坦福大学的学生之一。他和我一起实习。我不想专门谈论他,因为我读不懂他的想法,但是……我觉得有很多大公司会发现不必与开源LLM竞争会少很多麻烦。」

而很多网友担心大佬们的关系会不会受到论战的影响,不过LeCun前段时间发的一条推特很好地回应了这个问题。

「君子和而不同」,观点的差异不影响他们亦师亦友的亲密关系。

监管已经开始层层加码

前不久白宫公布了拜登总统期待已久的人工智能技术行政命令,以期最大限度地减少人工智能系统给公众带来的一些风险。

对于美国来说,人工智能已迅速深入从搜索引擎到华尔街等各个领域。专家们对这场人工智能军备竞赛,包括随之而来的失业、金融崩溃,以及深度造假等问题提出了严重担忧。

然而,该行政命令几乎没有为因人工智能系统而面临失业或收入减少的工人提供具体保护。

到目前为止,人工智能带来的罢工问题仍然使好莱坞等娱乐业陷入停滞,原因就在于AI的应用减少了好莱坞作家和演员们的工作机会。

再往前一点,今年三月,英国政府公布了一份白皮书来保护AI领域的创新,却在短短两个月后就开始讨论对AI的发展进行监管和限制。

自去年OpenAI的ChatGPT问世以来,它所表现出的惊艳的能力使得众多领域的目光都聚焦在它上面。

随着人工智能在各行各业的应用越来越广泛、越来越深入,有关AI的安全性问题也同样引起人们的思考,甚至于有一股「末世论」甚嚣尘上。

「面对全球威胁,人类表现出了非凡的团结,核不扩散方面的国际合作就证明了这一点。我们认为,人工智能系统带来的风险至少需要同样的谨慎和协调。」