AI风险管理,再度被AI大佬提上了日程。

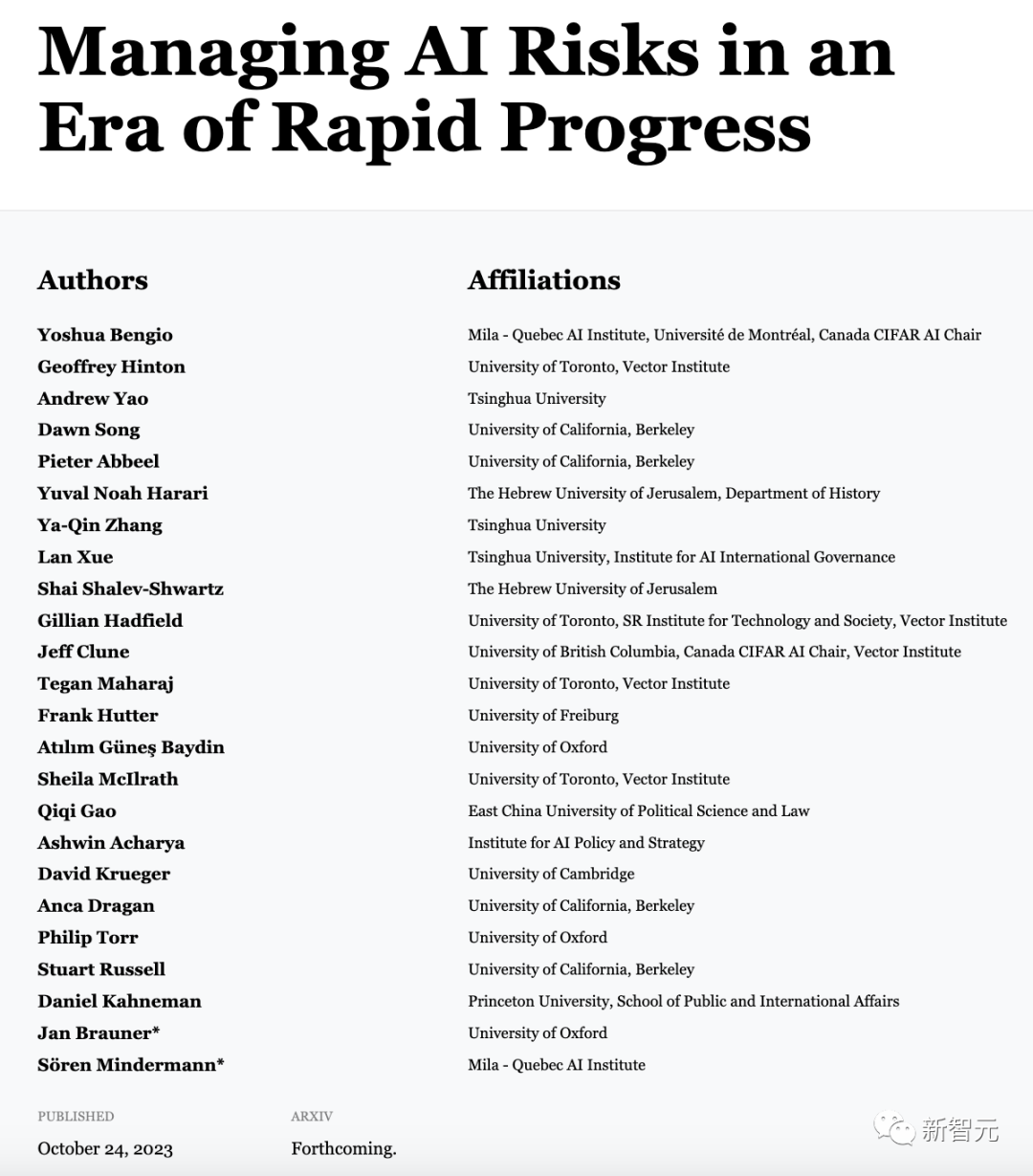

就在刚刚,一封由Bengio、Hinton、姚期智(Andrew Yao)、张亚勤等知名专家签署的联名信引起了许多人的关注。

这篇题为「在快速发展的时代管理人工智能风险」的文章,也即将发表在arXiv上。

有网友称,已经太晚了。

联名信全文

在AI的快速发展中,本文作者对即将到来的强大AI系统的大规模风险达成了共识。他们呼吁在开发这些系统之前,采取紧急治理措施,并在AI研发中向安全和道德实践进行重大转变。

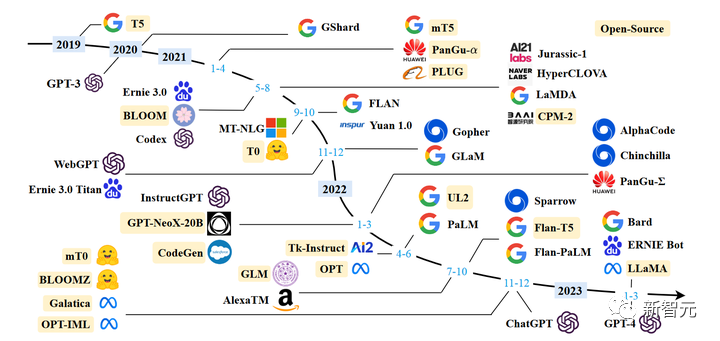

2019年,GPT-2能力很有限,还无法可靠地数到10。

仅仅4年后,深度学习系统就可以编写软件,按需生成逼真的场景,对知识性话题提供建议,并结合语言和图像处理来控制机器人。

随着AI开发者扩大这些系统的规模,一些未预见的能力和行为,会在没有明确编程的情况下自发地出现。

AI的发展太过迅速,已经远远超出人们的预期。而AI进步的速度,可能会再次让我们感到惊讶。

当前的深度学习系统仍然缺乏重要的能力,我们不知道需要多长时间才能开发它们。

然而,科技公司们正在竞相开发AGI系,以匹配或超越人类在大多数认知工作方面的能力。

他们正在迅速部署更多资源,并开发新技术来提高AI的能力。

AI本身的进步也可以加速开发进,如用AI助手自动化编程和数据采集,以进一步改进AI系统。

我们没有理由认为,AI的进步会在达到人类智力时停止。事实上,AI已经在蛋白质折叠或策略游戏等细分领域超越了人类。

与人类相比,AI系统可以更快地行动,学习更多知识,并以更高的带宽进行通信。

此外,它们可以通过使用大量的计算资源进行扩展,并且可以以数以百万计的速度复制。

AI的进步速度足以令人震惊!科技公司拥有充足的现金储备,可以很快将最新的训练的模型规模扩大100-1000倍。

再加上AI研发的持续增长和自动化,我们必须认真对待AGI系统在本十年或未来十年内,在许多关键领域超越人类能力的可能性。

这将会发生什么?

如果管理得当、分配公平,先进的AI系统可以帮助人类治愈疾病、提高生活水平并保护我们的生态系统。AI提供的机会是巨大的。

但是伴随着先进的AI能力而来的是大规模的风险,目前我们无法很好地应对这些风险。

人类正在投入大量资源来使AI系统更加强大,但在安全性和减轻伤害方面的投入则要少得多。

要让AI成为一种社会福音,我们必须重新定位。仅仅推动AI能力的发展是不够的。

我们已经落后于重新定位AI的进度。

我们必须提前预测AI可能造成的危害和新风险,并尽早做好防范最大风险的准备,不要等到风险出现才应对。

就拿世界气候变化来说,等了几十年才被承认和应对。

而对AI来说,几十年可能太长了。

社会规模风险

AI系统可能会在越来越多的任务中迅速超越人类。

如果这些系统没有经过仔细地设计和部署,它们就会带来一系列社会规模的风险。

它们有可能放大社会不公正,侵蚀社会稳定,削弱我们对社会基础现实的共同理解。

它们还可能导致大规模犯罪或恐怖活动。特别是在少数强大的参与者手中,AI可能会加剧全球不平等,或者促进自动化战争、定制化的大规模操纵和普遍监控。

随着公司正在开发自主的AI,其中许多风险可能很快会被放大,并产生新的风险:这些系统可以计划、在现实中采取行动和追求目标。

虽然当前的AI系统的自主性有限,但正在努力改变这一点例如,非自主的GPT-4模型很快就适应了浏览网页,设计和执行化学实验,并利用软件工具,包括其他AI模型。

如果我们构建高度先进的自主AI,我们就有可能创建追求不良目标的系统。恶意行为者可能有意植入有害目标。

此外,目前没有人知道如何可靠地将AI行为与复杂的价值观联系起来。

即使是善意的开发人员也可能无意中构建追求非预期目标的AI系统——尤其是如果为了赢AI竞赛,他们忽视了昂贵的安全测试和人类监督。

一旦自主AI系统追求不良的目标,被恶意行为者植入或意外植入,我们可能无法控制它们。软件控制是一个古老且未解决的问题:计算机病毒长期以来就能繁殖并避免被检测。

然而,AI正在被攻击、社会操纵、欺骗和战略规划等关键领域取得进展。先进的自主AI系统将带来前所未有的控制挑战。

为了推进不良的目标,未来的自主AI系统可以使用恶意策略——从人类那里学习或独立开发——作为达到目的的手段。

AI系统可以获得人类信任,获得财务资源,影响关键决策者,并与人类参与者和其他AI系统结成联盟。

避免人为干预,他们可以像计算机病毒一样在全球服务器网络中复制它们的算法。

AI助手已经在全球范围内共同编写大量计算机代码;未来的AI系统可以插入并利用安全漏洞来控制我们通信、媒体、银行、供应链、政府背后的计算机系统。

在公开冲突中,AI系统可以使用生物武器。获得这些技术的AI只会延续现有趋势,使军事活动、生物研究和AI开发本身自动化。

如果AI系统以足够的技能实施这些战略,人类将很难干预。

最后,如果人类自愿让渡影响力,AI可能不需要谋取。随着自治AI系统在速度和成本效益上越来越胜过人类工作者,一个两难困境出现了。

公司、政府可能被迫广泛部署AI系统,并裁减昂贵的人工核查AI决策的环节,否则就面临被竞争对手超越的风险。

因此,自主AI系统可以越来越多地承担关键的社会角色。

如果没有足够的谨慎,我们可能不可逆转地失去对自主AI系统的控制,导致人类干预无效。

大规模网络犯罪、社会操纵和其他突出的危害可能会迅速升级。这种不受控制的AI进步可能最终导致大规模生命和生物圈损失,以及人类边缘化甚至灭绝。

虚假信息和算法歧视等危害今天已经很明显了,其他危害正有萌芽的迹象。

应对正在发生的危害和预测新出现的风险至关重要。这不是一个非此即彼的问题。当前和新出现的风险通常有相似的机制、模式和解决方案。投资治理框架和AI安全将在多个方面取得成果。

一条前进路

如果今天开发出先进的自主AI系统,我们将不知道如何让它们变得安全,也不知道如何正确测试它们的安全性。

即使我们这样做了,政府也缺乏防止滥用和维护安全实践的机构。

然而,这并不意味着没有可行的前进道路。

为了确保积极的结果,我们可以也必须在AI安全和伦理方面取得研究突破,并迅速建立有效的政府监督。

重新定位技术研发

我们需要研究突破,来解决当今在创建具有安全和道德目标的AI方面的一些技术挑战。

其中一些挑战不太可能通过简单地提高AI系统的能力来解决,这包括:

- 监督和诚实:更强大的AI系统能够更好地利用监督和测试中的弱点,比如,产生虚假但令人信服的输出

- 鲁棒性:AI系统在新情况下的行为不可预测(在分布转移或对抗性输入情况下)

- 可解释性:AI决策是不透明的。到目前为止,我们只能通过反复试验来测试大型模型。我们需要学会了解它们的内部运作

- 风险评估:前沿AI系统开发出仅在训练期间甚至部署后才发现的不可预见的能力,需要更好的评估来检测危险能力。

- 应对新出现的挑战:更强大的未来AI系统可能会表现出,我们迄今为止仅在理论模型中看到的故障模式。例如,AI系统可能会学会假装服从,或利用我们的安全目标和关闭机制中的弱点,来推进特定目标。

鉴于利害关系,我们呼吁主要科技公司和公共投资者将至少1/3的AI研发预算,用于确保安全和合乎道德的使用,与他们为AI能力提供的资金相当。

解决这些问题,着眼于强大的未来系统,必须成为我们领域的核心。

紧急治理措施

我们迫切需要国家机构和国际治理来执行标准,以防止鲁莽行为和滥用。

从制药到金融系统和核能,许多技术领域表明,社会既需要也有效地利用治理来降低风险。

然而,目前还没有类似的AI治理框架。

没有这些框架,公司和国家为了获得竞争优势,可能会在牺牲安全性的同时提升AI能力,或者将关键的社会角色交给几乎没有人类监督的AI系统。

就像制造商将废物排放到河流中以降低成本一样,他们可能会试图获得AI发展的回报,同时让社会来处理后果。

为了跟上快速进展,避免僵化的法律,国家机构需要强大的技术专长和迅速行动的权威。为了应对国际竞争动态,他们需要促成国际协议和伙伴关系的能力。

为了保护低风险使用和学术研究,他们应该避免为小型和可预测的AI模型设置过度的官僚障碍。

最紧迫的审查应该是前沿的AI系统:少数最强大的AI系统——在价值数十亿美元的超级计算机上训练——将具有最危险和最不可预测的能力。

为了实现有效监管,政府迫切需要对AI发展的全面洞察。监管者应该要求模型注册、举报人保护、事件报告以及对模型开发和超级计算机使用的监控。

监管机构还需要在部署前访问先进的AI系统,以评估它们的危险力,例自我复制、闯入计算机系统或使大流行病原体广泛可获取等等。

对于有危险力的AI系统,我们需要各种治理机制的组合与风险规模相匹配。

监管机构应制定,取决于模型能力的国家和国际安全标准。他们还应让前沿AI开发商和所有者对其模型造成的可以合理预见和预防的伤害承担法律责任。

这些措施可以防止伤害,并创造急需的安全投资动力。

未来能力非凡的AI系统需要进一步的措施,例如可以规避人类控制的模型。

在足够保护措施就绪之前,政府必须准备好对其开发颁发许可,暂停开发以应对令人担忧的能力,强制执行访问控制,并要求对州级黑客采取强有力的信息安全措施。

为了在法规出台之前架起桥梁,主要AI公司应该迅速制定「如果-那么承诺」:如果在其AI系统中发现特定的红线能力,他们将采取具体的安全措施。这些承诺不仅要详细还要独立审查。

AI可能是塑造本世纪的技术。

虽然AI能力正在迅速发展,但安全和治理方面的进展却落后了。

为了引导AI走向积极的结果,远离灾难,我们需要重新定位。

如果我们有足够的智慧,一条负责任的路就在那里。

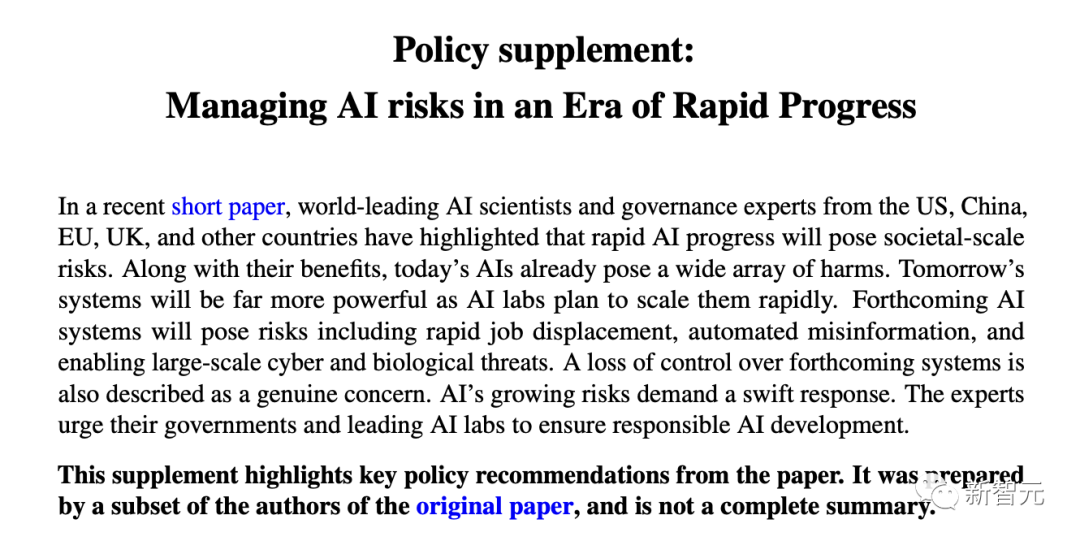

政策补充

除了以上正文内容,文中还附有政策补充的部分。

具体了解,请参考链接内容。

地址:https://managing-ai-risks.com/policy_supplement.pdf