随着GPT-3等大语言模型的出现,自然语言处理(NLP)领域取得了重大突破。这些语言模型具有生成类人文本的能力,并且已经在各种场景中得到应用,例如:聊天机器人、翻译。

然而,当涉及到专业化和定制化的应用场景时,通用的大语言模型可能在专业知识方面会有所不足。用专业的语料库对这些模型进行微调往往昂贵且耗时。“检索增强生成”(RAG)为专业化应用提供了一个新技术方案。

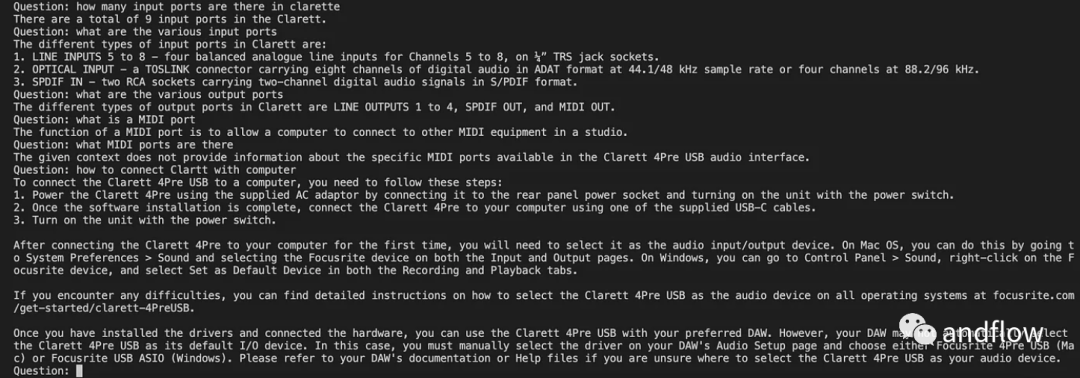

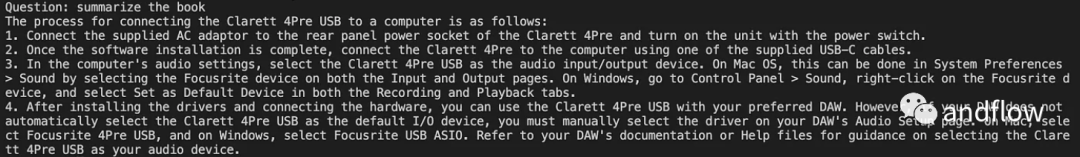

下面我们主要介绍RAG如何工作,并通过一个实际的例子,将产品手册作为专业语料库,使用GPT-3.5 Turbo来作为问答模型,验证其有效性。

案例:开发一个聊天机器人,可以回答有关特定产品的知识。该企业的产品自己独特的用户手册。

RAG介绍

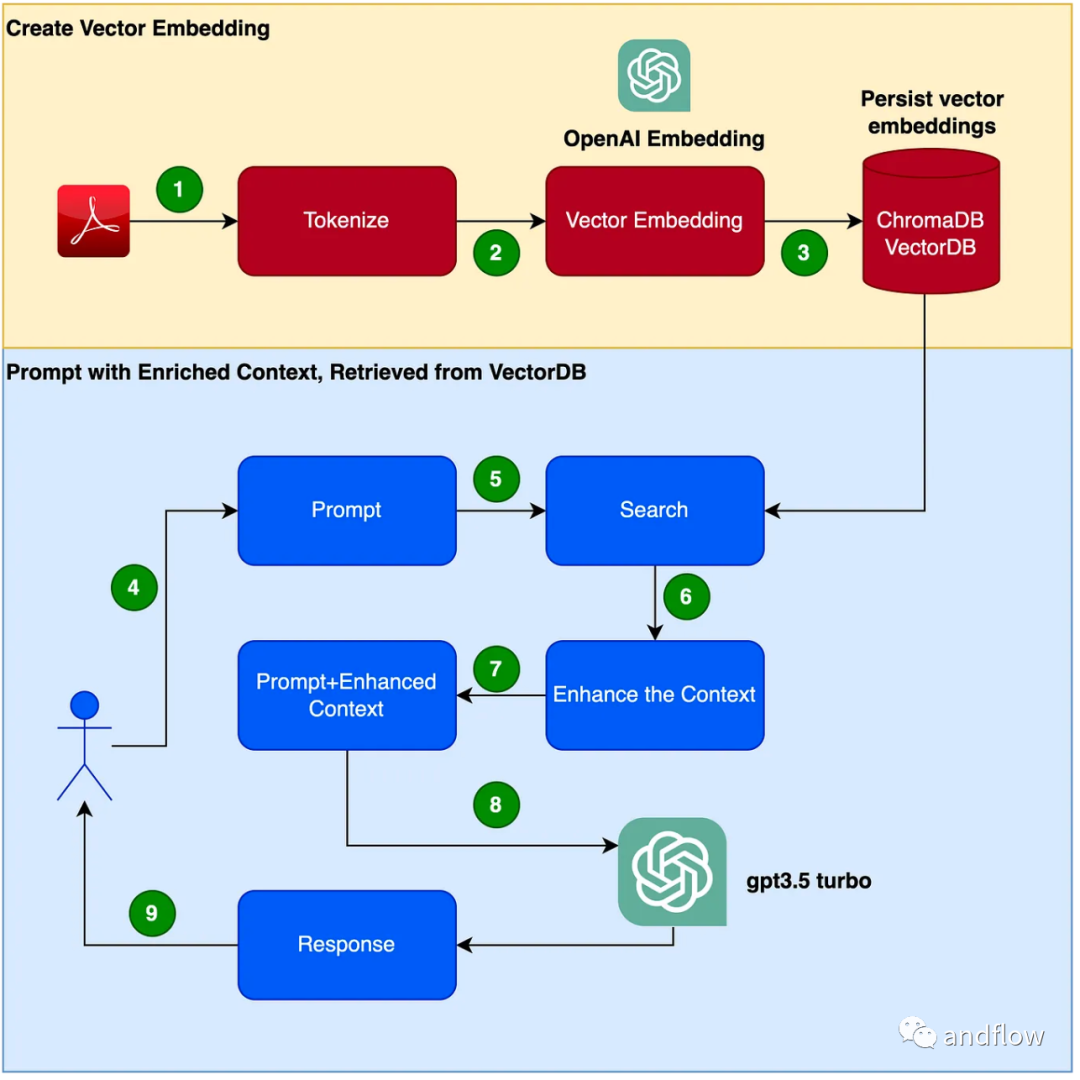

RAG 提供了一个有效的方式来解决在特定领域的问答,主要将行业知识转化为向量进行存储和检索,通过知识检索的结果与用户问题结合形成Prompt,最后利用大模型生成合适的回答。检索机制与语言模型的相结合,增强了大模型的响应能力。

下面是创建聊天机器人程序的步骤:

- 读取PDF(用户手册PDF文件)并使用chunk_size为1000个令牌进行令牌化。

- 创建向量(可以使用OpenAI EmbeddingsAPI来创建向量)。

- 在本地向量库中存储向量。我们将使用ChromaDB作为向量数据库(向量数据库也可以使用Pinecone或其他产品替代)。

- 用户发出具有查询/问题的提示。

- 根据用户的问题从向量数据库检索出知识上下文数据。这个知识上下文数据将在后续步骤中与提示词结合使用,来增强提示词,通常被称为上下文丰富。

- 提示词包含用户问题和增强的上下文知识一起被传递给LLM

- LLM 基于此上下文进行回答。

动手开发

(1)设置Python虚拟环境 设置一个虚拟环境来沙箱化我们的Python,以避免任何版本或依赖项冲突。执行以下命令以创建新的Python虚拟环境。

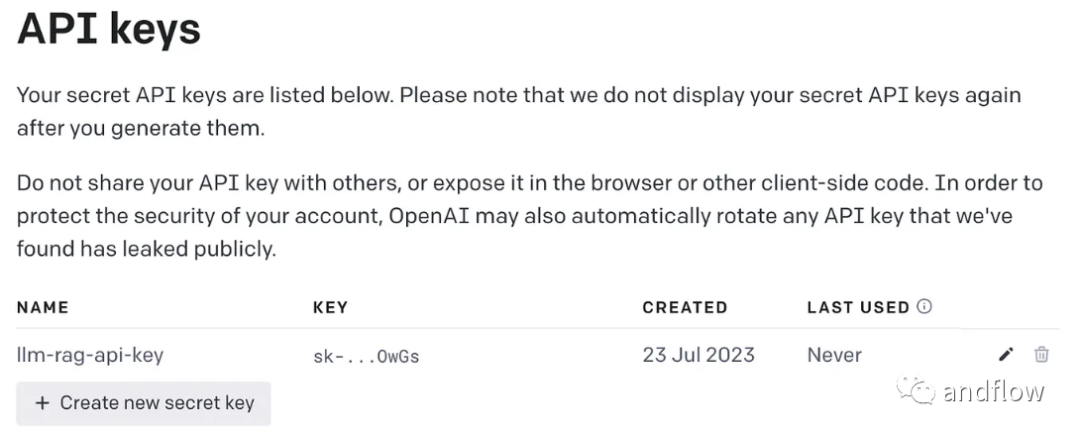

(2)创建OpenAI密钥

需要一个OpenAI密钥来访问GPT。

(3)安装依赖库

安装程序需要的各种依赖项。包括以下几个库:

- lanchain:一个开发LLM应用程序的框架。

- chromaDB:这是用于持久化向量嵌入的VectorDB。

- unstructured:用于预处理Word/PDF文档。

- tiktoken: Tokenizer framework

- pypdf:读取和处理PDF文档的框架。

- openai:访问OpenAI的框架。

创建一个环境变量来存储OpenAI密钥。

(4)将用户手册PDF文件转化为向量并将其存储在ChromaDB中

导入所有将要使用的依赖库和函数。

读取PDF,标记化文档并拆分文档。

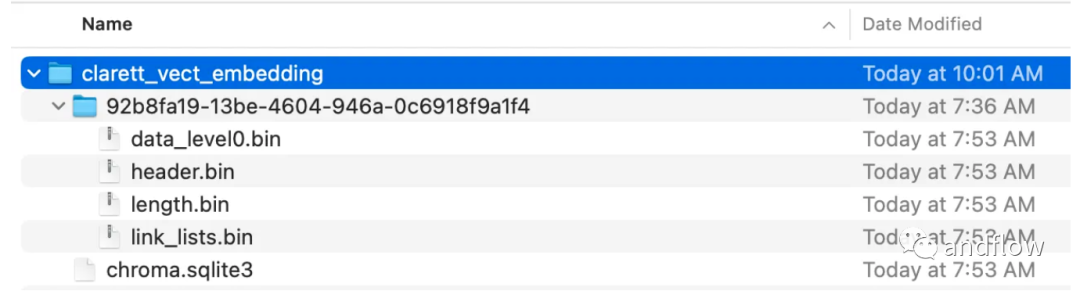

创建一个chroma集合,和一个存储chroma数据的本地目录。然后,创建一个向量(embeddings)并将其存储在ChromaDB中。

执行此代码后,您应该看到一个已经创建好的文件夹,用于存储向量。

将向量嵌入存储在ChromaDB后,接着使用LangChain中的ConversationalRetrievalChain API来启动一个聊天历史组件。

初始化了langchan之后,我们可以使用它来聊天/Q A。下面的代码中,接受用户输入的问题,并在用户输入'done'之后,将问题传递给LLM,以获得答复并打印出来。

总之

RAG将GPT等语言模型的优势与信息检索的优势结合在一起。通过使用特定的知识上下文的信息提高提示词的丰富程度,使语言模型能够生成更准确的和知识上下文相关的回答。RAG提供了一种比“微调”更高效且具有成本效益的解决方案,为行业应用或企业应用提供可定制化的交互方案。