10月9日,Hinton面对《60分钟》的采访,再次表示了对人工智能可能会接管人类的担忧。

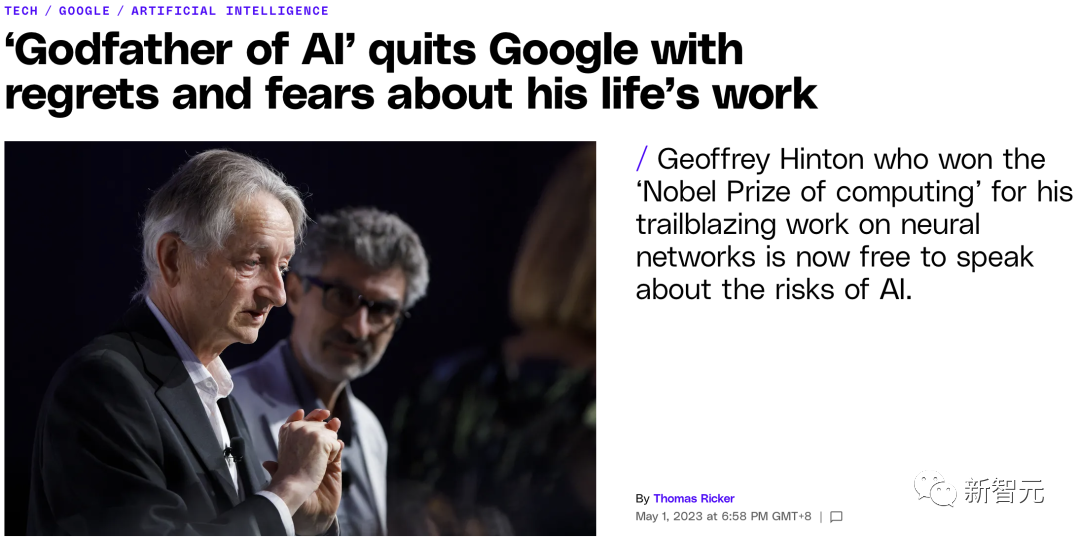

但早在今年5月,「人工智能教父」Geoffrey Hinton为了能自由谈论人工智能的风险,宣布了从谷歌离职。

之后,Hinton在各种公开场合中都表达了对人工智能风险的担忧。

在一次采访中,Hinton甚至表示:「我对自己的毕生工作,感到非常后悔」。

而在如火如荼的人工智能井喷之年,人们已经难以停下冲锋的步伐。

虽然在今年3月底,有上千名技术领袖签署了呼吁暂停开发比GPT-4更强大的人工智能的联名书。

但在9月24日的YC校友分享会上,Altman透露了OpenAI的下一代大模型GPT-5和GPT-6的消息。

与此同时,作为开源社区的领袖Meta,也在不断开发新的大模型。在7月,发布了在各项性能都得到提升,水平接近ChatGPT的Llama 2。

随着大模型性能的不断提升,安全隐患和威胁的阴影始终如达摩克里斯之剑悬在人类头顶。

有人认为担心人工智能的风险还为之过早,如Meta的首席科学家、同样是图灵奖得主的Hinton的弟子Yann LeCun多次表示,人们夸大了人工智能的风险。

但也有一些人坚持,「与生存相关的风险,如何重视都是不为过的」。

Hinton便是其中之一。

Hinton:AI接管人类的可能性

在与《连线》的记者对话时,Hinton从以下几个方面表达了对人工智能风险的担忧。

首先是人工智能的智能的不断增长。

Hinton认为,我们正在进入这样一个时代:人工智能正变得比人类更聪明,它们能够根据自身经验和理解来做出决定。

虽然图灵奖得主Bengio等用88页论证了人工智能目前还不具备意识,但不论是Bengio还是Hinton,都认为未来人工智能可能会发展出自我意识。

未来人工智能将会取代人类,成为地球上智商最高的存在。

决定模型智能的是学习的能力,Hinton解释了人工智能的学习过程。

人工智能能够进行学习,是因为人类设计了相应算法,但模型因此产生的神经网络是复杂的,并不完全为人所知。

这一过程被Hinton比作设计进化的原理,他承认随着人工智能对更复杂任务的处理,其内部运作对于人类而言将会变得越来越神秘、且不可知。

此外,Hinton还表示了对人工智能系统会自己编写代码来修改自己的担心,这可能会导致人类对人工智能失去控制。

除了人工智能的失控风险,Hinton还讨论了人工智能操纵人类的风险,指出了在自主战场机器人、假新闻和就业偏见等领域的潜在后果。

但比这些更糟糕的是,Hinton强调了围绕人工智能的不确定性,以及在未知领域航行所面临的挑战。

「我们正在进入一个非常不确定的时期,我们正在处理以前从未做过的事情。通常,当你第一次处理一些完全新奇的事情时,你肯定会犯错。但我们不能在这些事情上犯错。」

但Hinton也肯定了人工智能做出的贡献。

随着人工智能在现实世界中各种落地应用,在办公、科学发现、医疗等方面都极大地提升了人类的效率。

Hinton特别强调了人工智能在医疗保健领域的巨大优势,尤其是医学图像识别和药物设计等,任务谷歌DeepMind推出的Alpha Fold是一个绝佳的例证。

Hinton对人工智能在这一领域的积极影响表示乐观。

对于人工智能的未来,Hinton虽然没有预言人工智能一定会接管人类,但他承认了这将是我们可能的未来。

因此,Hinton一直敦促面对人工智能发展的潜力,人类对自身的安全进行必要的保护措施。

其他对人工智能风险的担忧

此前,纽约大学教授马库斯也表达了相同的担忧。

「是人类快要灭亡了比较重要,还是编码更快、跟机器人聊天更重要?」

马库斯认为,虽然AGI还太遥远,但LLM已经很危险了,而最危险的是,现在AI已经在给各种犯罪行为提供便利了。

「在这个时代,我们每天都要自问,我们究竟想要什么类型的AI,有的时候走慢一点未尝不好,因为我们的每一小步都会对未来产生深远的影响。」

ChatGPT之父、OpenAI CEO Sam Altman也曾公开表示,超级智能AI的风险可能会远远超出我们的预料。

在技术研究员Lex Fridman的播客中,Altman对高级人工智能的潜在危险发出了预警。

他表示自己最担心的是,AI造成的虚假信息问题,以及经济上的冲击,以及其他还没出现的种种问题,这些危害可能远远超过了人类能应对的程度。

他提出了这样一种可能性:大语言模型可以影响、甚至是主宰社交媒体用户的体验和互动。

「打个比方,我们怎么会知道,大语言模型没有在推特上指挥大家的思想流动呢?」

Altman说,「我认为,作为OpenAI,我们有责任为我们向世界推出的工具负责。」

「AI工具将给人类带来巨大的好处,但是,你知道的,工具既有好处也有坏处,」他补充道。「我们会把坏处降到最低,把好处最大化。」

虽然GPT-4模型很了不起,但认识到人工智能的局限性并避免将其拟人化也很重要。

同样地,对于「AI消灭人类」这个问题,比尔盖茨也已经忧心多年了。

很多年来,盖茨一直表示,人工智能技术已经变得过于强大,甚至可能引发战争或被用来制造武器。

他声称,不仅现实生活中的「007反派」可能利用它来操纵世界大国,而且人工智能本身也可能失控,对人类造成极大威胁。

在他看来,当超级智能被开发出来,它的思考速度会远远赶超人类。

它能做到人脑所能做的一切,最可怕的是,它的记忆内存大小和运行速度根本不受限。

这些被称为「超级」AI的实体可能会设定自己的目标,不知道会干出什么事。

而公众也开始发出自己的声音。

面对大公司之间的大模型「军备竞赛」,Meta因为向公众开放了Llama 2的模型权重而遭到了公民抗议。

公众担心Meta这项释放模型权重的策略,可以让任何人都能依照自身利益修改模型。

同时,因为权重的开放,意味着其他人无法召回这些的模型。这对利用大模型来实施网络犯罪几乎提供了无限制的生长土壤。

现在,对于全人类来说,似乎「to be,or not to be」已成为了迫在眉睫、不得不面对的问题。