最近在逛 Github 的时候发现了一款神器,叫做 Open Interpreter,主要是用来实现在本地和大语言模型进行交互的,通过大语言模型将自然语言转换为脚本代码,然后在本地执行从而实现目标。

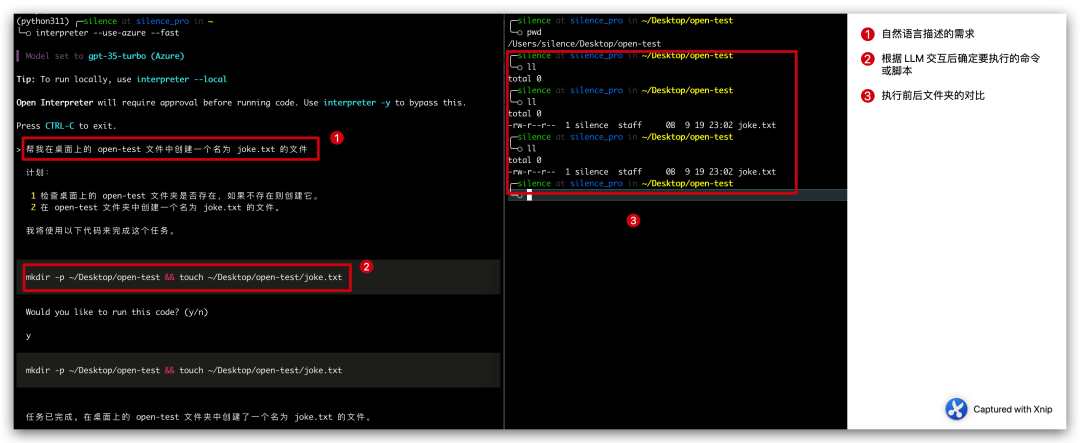

简单来说比如你想在桌面上创建一个名为 joke.txt 文件,你不在需要手动创建,而是通过自然语言告诉 Open Interpreter,让它帮我们生成创建文件的脚本,然后在本地执行,从而生成一个 joke.txt 文件。

我们要做的就是告诉它我们的需求是什么,以及允许它在本地执行代码即可。

如下所示

图片

图片

上面的 case 整个过程分三步:

- 我们通过自然语言描述一个需求:帮我在桌面上的 open-test 文件中创建一个名为 joke.txt 的文件

- Open Interpreter 会将我们的需求进行拆解,并且列出它的执行计划和要执行的命令。

计划:

1 检查桌面上的 open-test 文件夹是否存在,如果不存在则创建它。

2 在 open-test 文件夹中创建一个名为 joke.txt 的文件。

我将使用以下代码来完成这个任务。

mkdir -p ~/Desktop/open-test && touch ~/Desktop/open-test/joke.txt- 在经过我们的人工确认后进行执行,最终成功的创建出的文件。

这个项目刚刚起步,这个 case 也很简单,但是我们要知道这仿佛打开了另一扇大门,以后只要是通过代码能实现的功能,我们都可以通过自然语言来实现了,想想都很激动(可怕)。

官方的介绍这个工具都可以用来编辑视频以及发送邮件,只能说很有前景。

安装和配置

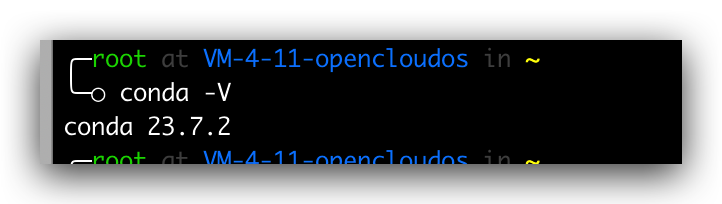

安装 conda

这个项目的安装也非常简单,正常我们只要在命令行中执行 pip install open-interpreter 即可,但是为了保证环境的稳定,我们这边准备用 conda 进行环境隔离,所以我们首先安装 conda,依次执行下面的命令

# 获取脚本

wget https://repo.anaconda.com/archive/Anaconda3-2023.07-2-Linux-x86_64.sh

# 增加可执行权限

chmod +x Anaconda3-2023.07-2-Linux-x86_64.sh

# 运行安装脚本

./Anaconda3-2023.07-2-Linux-x86_64.sh

# 查询版本

conda -V如何能正常输出版本号,则表明安装成功,如果提示命令不存在,那我们就需要配置一下环境变量,在

vim .bash_profile

# 加入下面一行

PATH=$PATH:$HOME/bin:$NODE_PATH/bin:/root/anaconda3/bin

# 再次执行

conda -V 图片

图片

创建隔离环境

安装完成 conda 过后,我们就创建指定 Python 版本的隔离环境了,通过如下命令

conda create -n python311 pythnotallow=3.11这行代码的含义是通过 conda create 创建一个名字叫 python311 的隔离环境,隔离环境的 python 版本指定为 3.11,创建完成过后我们可以通过下面的命令查询隔离环境的列表。

conda env list 图片

图片

安装 open-interpreter

然后我们进入到隔离环境中,在隔离环境中安装 open interpreter,命令如下

conda activate python311

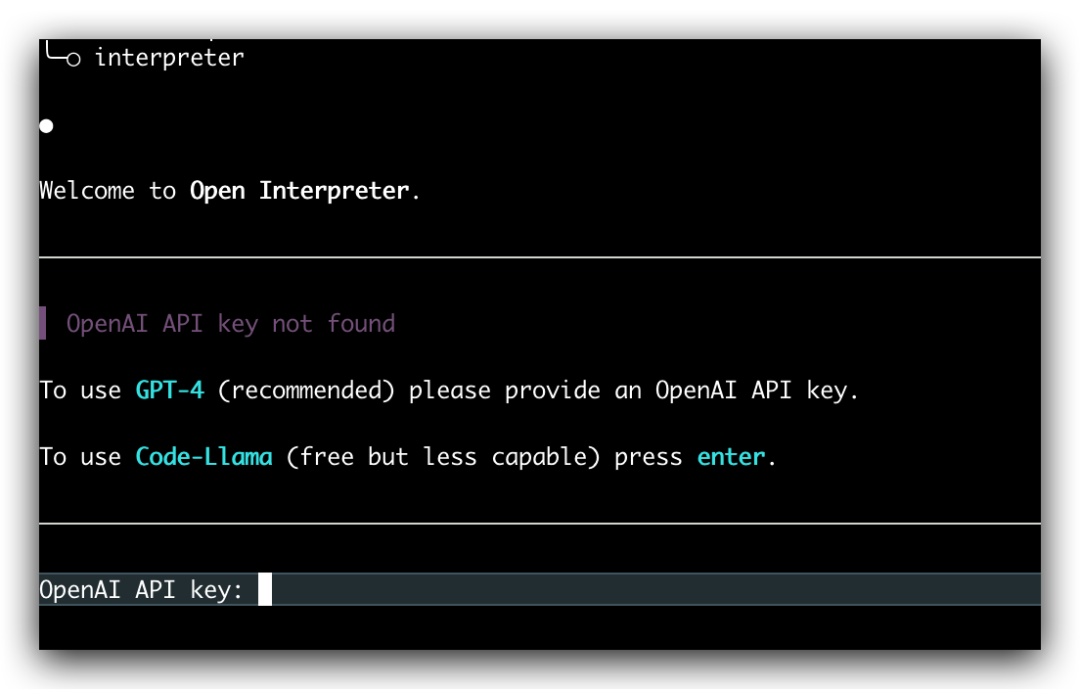

pip install open-interpreter等待一会即可安装成功,安装成功过后输入下面命令,即可开启本地大语言模型交互。

interpreter 图片

图片

直接输入 interpreter 命令会要求我们输入自己的 OpenAI API key,此时默认使用的 GPT-4 模型,我们可以通过增加 --fast 参数来使用 GPT-3.5,

interpreter --fast这里我们每次执行都需要手动填入 OpenAI API key 比较麻烦,可以配置一下环境变量

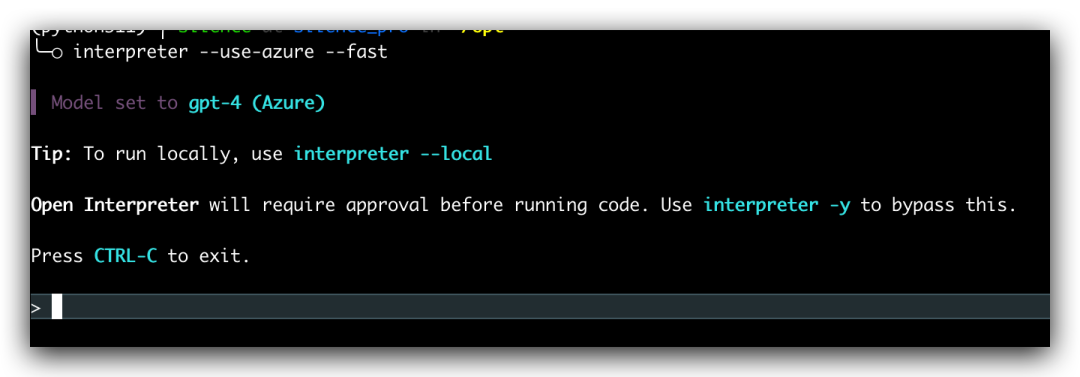

export OPENAI_API_KEY=skxxxx这样我们后续执行就不用在手动填 OpenAI 的API key 了,如果想用微软的 Azure OpenAI 的话,也是支持的,只要配置下面的环境变量,然后在启动的时候增加 --use-azure 参数就可以了

export AZURE_API_KEY=

export AZURE_API_BASE=

export AZURE_API_VERSION=

export AZURE_DEPLOYMENT_NAME=interpreter --use-azure 图片

图片

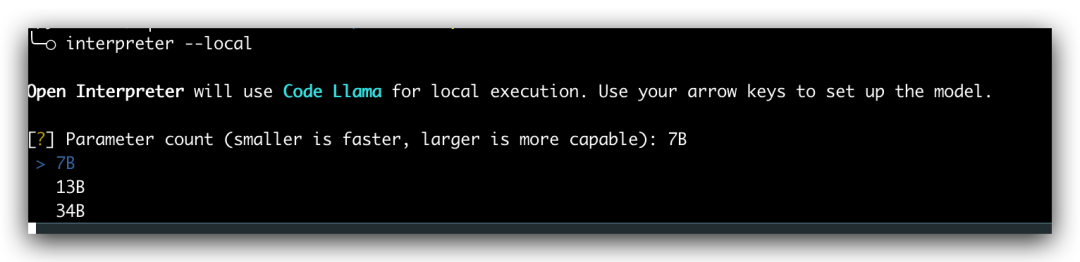

本地启动

上面的操作都需要我们有对应 OpenAI 的 API Key 或者 Azure 的 OpenAI 的 endpoint,其实 open interpreter 还支持本地运行,只要在启动的时候增加 --local 参数,然后就让我们选择对应的模型。不过对于本地运行需要我们的电脑配置支持才行,感兴趣的小伙伴可以参考官方文档实践一下,我这边的配置不允许~~

图片

图片

总结

今天给大家介绍了一下 Open interpreter 的安装方法和简单玩法,这个项目还在高速的迭代中,相信不久的将来将会带来一场变革,不得不说 AI 的时代是真正的到来了,未来几年将会是 AI 产品的井喷时代,作为程序员我们要紧跟时代的步伐不掉队。