本文经自动驾驶之心公众号授权转载,转载请联系出处。

原标题:SupFusion: Supervised LiDAR-Camera Fusion for 3D Object Detection

论文链接:https://arxiv.org/pdf/2309.07084.pdf

作者单位:香港中文大学 NIO

代码链接:https://github.com/IranQin/SupFusion

会议:ICCV 2023

论文思路

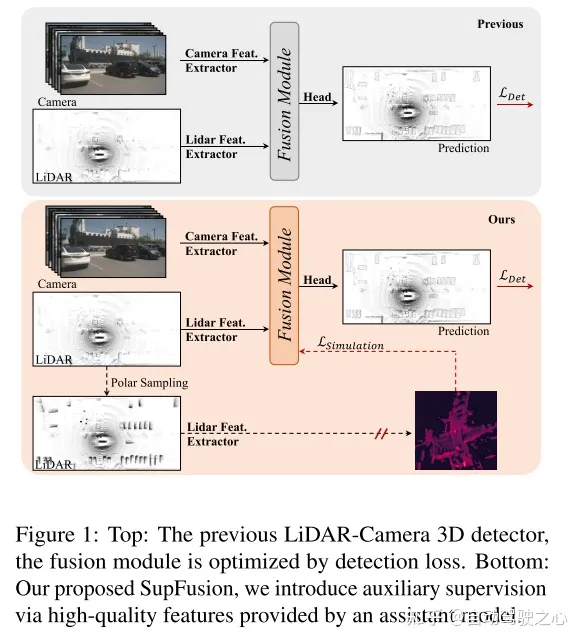

基于LiDAR-Camera融合的三维检测是实现自动驾驶的关键技术之一。近年来,许多LiDAR-Camera的融合方法涌现出来,并取得了与单模态检测器相比有前途的性能,但始终缺乏对融合过程的精心设计和有效的监督。

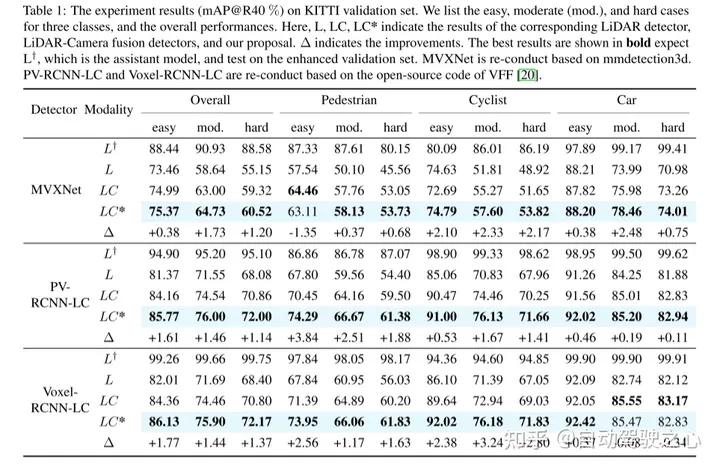

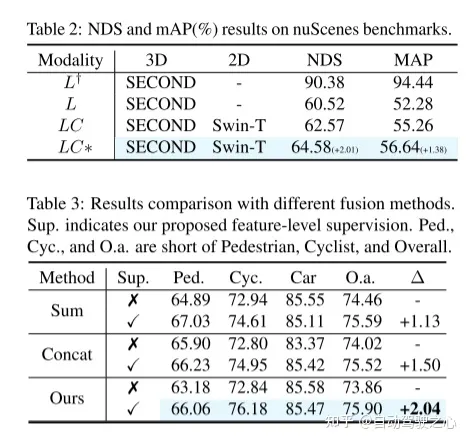

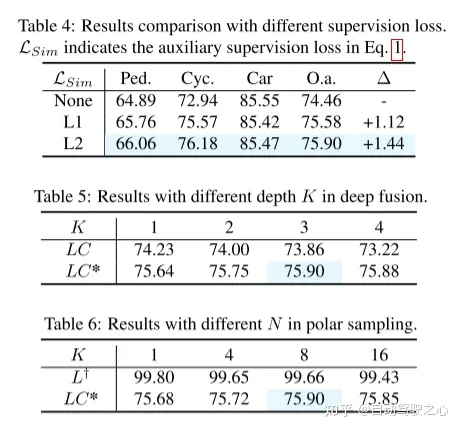

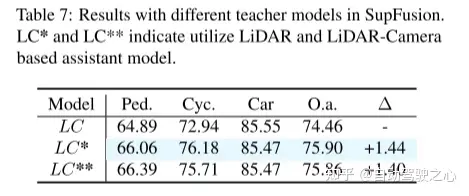

本文提出了一种新的训练策略SupFusion,该策略为有效的LiDAR-Camera融合提供了辅助特征级监督,显著提高了检测性能。本文的策略涉及到一种称为极坐标采样(Polar Sampling)的数据增强方法,它对稀疏的目标进行加密,并训练一个辅助模型生成高质量的特征作为监督。然后利用这些特征训练LiDAR-Camera融合模型,对融合特征进行优化,以模拟生成的高质量特征。此外,本文提出了一种简单而有效的深度融合模块(deep fusion module),与已有的基于SupFusion策略的融合方法相比,该模块具有连续的优越性能。这样看来,本文的提出的方法有以下优点。首先,SupFusion引入了辅助特征级监督,可以在不引入额外推理成本的情况下提高LiDAR-Camera的检测性能。其次,提出的深度融合可以不断提高检测器的能力。本文提出的SupFusion和deep fusion模块是即插即用的,本文进行了大量的实验来证明其有效性。具体来说,基于多个 LiDAR-Camera 3D 检测器,本文在 KITTI 基准上获得了约 2% 的 3D mAP 改进。

主要贡献

本文提出了一种名为 SupFusion 的新型监督融合训练策略,该策略主要由高质量特征生成过程组成,并据本文所知,首先提出辅助特征级监督损失,以实现鲁棒融合特征提取和准确的 3D 检测。

为了在SupFusion中获得高质量的特征,本文提出了一种极坐标采样的数据增强方法来对稀疏目标进行加密。此外,本文提出了一种高效的深度融合模块,以提高连续检测精度。

本文基于不同融合策略的多个检测器进行了大量实验,并在KITTI基准上获得了约2%的mAP改进。

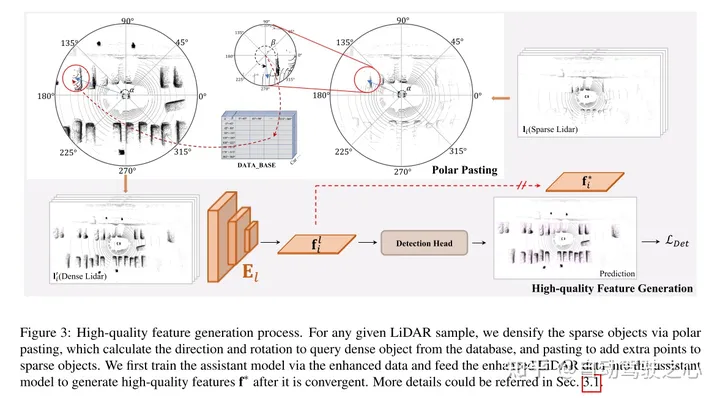

网络设计

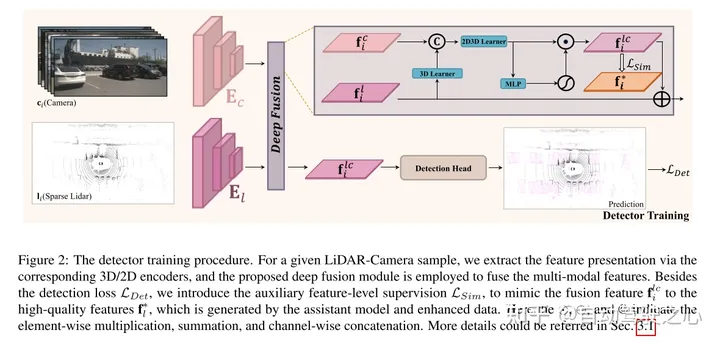

本文提出了一种名为 SupFusion 的有监督 LiDAR-Camera 融合方法,以生成高质量的特征并为融合和特征提取过程提供有效的监督,并进一步提高基于 LiDAR-Camera 融合的 3D 检测性能。具体来说,本文首先训练一个辅助模型来提供高质量的特征。为了实现这一目标,与以前利用更大模型或额外数据的方法不同,本文提出了一种称为极坐标采样(Polar Sampling)的新型数据增强方法。极坐标采样可以从稀疏的激光雷达数据中动态增强物体的密度,从而更容易检测并提高特征质量,例如特征可以得出准确的检测结果。然后,本文通过引入辅助特征级监督来简单地训练基于 LiDAR-Camera 融合的检测器。在此步骤中,本文将原始 LiDAR 和摄像机输入输入到 3D/2D 主干和融合模块中以获得融合特征。一方面,融合特征被输入检测头进行最终预测,即决策级监督。另一方面,辅助监督将融合特征模拟为高质量特征,这些特征是通过预训练的辅助模型和增强的激光雷达数据获得的。通过这种方式,所提出的特征级监督可以使融合模块生成更鲁棒的特征,并进一步提高检测性能。为了更好地融合 LiDAR 和摄像机特征,本文提出了一种简单而有效的深度融合模块,该模块由堆叠的 MLP 块和动态融合块组成。SupFusion可以充分挖掘深度融合模块能力,不断提高检测精度。

图2:检测器训练过程。对于给定的LiDAR-Camera样本,本文通过相应的3D/2D编码器提取特征表示,并使用提出的深度融合模块融合多模态特征。除了检测损失的 外,本文 提出辅助特征级监督 ,将融合的特征 模拟成高质量的特征 ,这是由辅助模型和增强数据生成的。

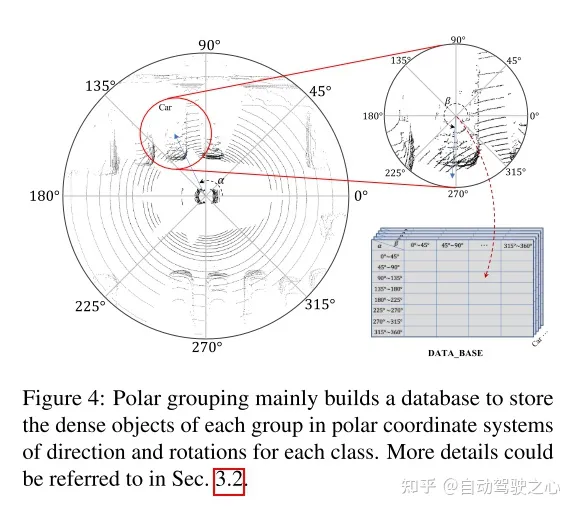

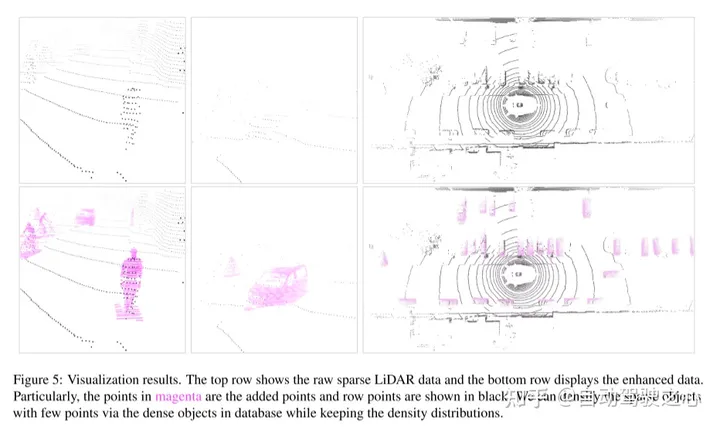

图3:高质量的特征生成过程。对于任意给定的LiDAR样本,本文通过 polar pasting 对稀疏目标进行加密,polar pasting计算从数据库中查询稠密目标的方向和旋转,并通过粘贴向稀疏目标添加额外的点。本文首先通过增强的数据训练辅助模型,并将增强的LiDAR数据输入辅助模型中,以生成高质量的特征 ,直到它被收敛。

图1:上图:之前的LiDAR-Camera 3D检测器,通过检测损失对融合模块进行优化。底部:本文提出的SupFusion,本文提出了通过一个辅助模型提供的高质量特征的辅助监督。

图4:Polar grouping主要是建立一个数据库,将每个组的密集目标存储在每个类的方向和旋转的极坐标系系统中。

实验结果

引用

Qin, Y., Wang, C., Kang, Z., Ma, N., Li, Z., & Zhang, R. (2023). SupFusion: Supervised LiDAR-Camera Fusion for 3D Object Detection. ArXiv. /abs/2309.07084

原文链接:https://mp.weixin.qq.com/s/-pPUtrlfeo_09svMxk2qFA