Bard全家桶,终于来了!

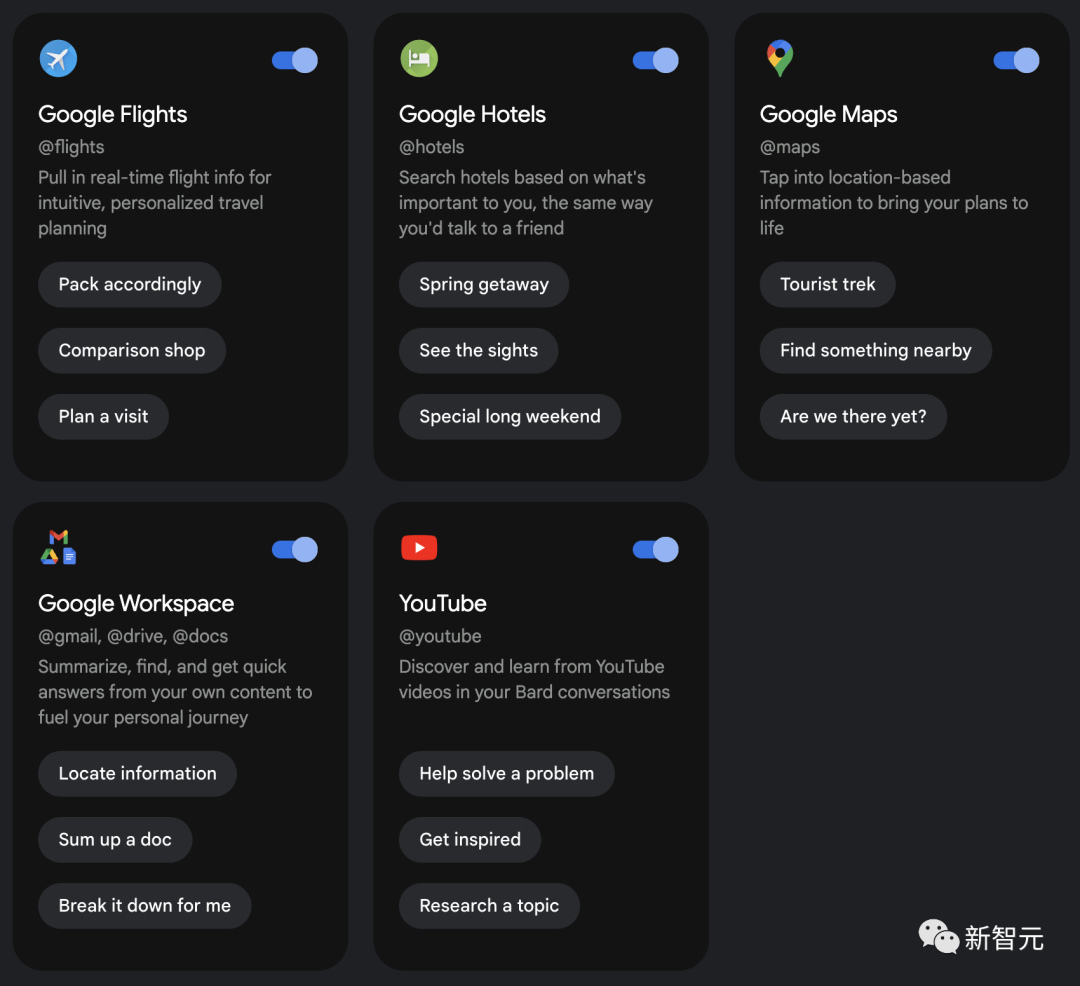

今年3月,Bard发布,六个月后,Bard终于有自己的插件生态了。它可以调用丰富的谷歌应用API,从而执行复杂的操作。

从此,你每天使用的谷歌工具,比如Gmail、Docs、Drive、谷歌地图、Youtube、谷歌航班等应用,Bard都能打开,然后从中为你找到你需要的信息。

即使我们需要的信息分散在多个应用和服务中,有了Bard,也能快速集成。

总的来说就是,你对谷歌的产品使用有多深,Bard发挥的潜力就会有多大!

大模型发展到现在,无论是国内厂商还是谷歌这类巨头,果然都开始卷应用生态的方向了。

全家桶小助手

比如,现在你想去大峡谷,想要成功地制定这个活动计划,需要非常琐碎的信息。

而Bard就可以发挥它神奇的功能——

它会从Gmail中阅读邮件,选择一个适合所有人的日期。

然后查找实时航班和酒店信息,在谷歌地图中查找前往机场的路线。

甚至还能帮你看几个YouTube视频,做出一个大峡谷攻略。

所有这些任务,都是Bard在一个对话里完成的。

或者,假如你正在找新工作,需要写一份简历,你就可以这样命令Bard——

「从我的云端硬盘中,找到我2023年6月的简历,然后把它总结成一小段个人陈述」。

这样,Bard就可以帮你完成新简历了。

「根据最近我跟Alex的邮件沟通,帮我撰写一份商业合作计划书,然后用Gmail发给Alex。」

「根据我刚刚对巴黎和几个周边城市的搜索信息,帮我设计一套旅游攻略,然后保存到Google Docs中。」

「把会议记录中提到的跟我有关的信息,全都记到Google Keep中。」

……

Bard可以帮你干的事,真是太多了。它的思路跟Notion AI有些类似,但后者并不能在各个数据库中调用数据。

要知道,如今数据就是最稀缺的资源。

跟OpenAI比,Bard的天然优势就是更多的数据和应用。

从此,我们的上网搜索记录、浏览过的视频、邮件、文档、地图,Bard都可以自动调用,总结出我们最需要的信息。

有人会担心:那我的隐私怎么办?

对此,谷歌表示,如何使用扩展程序是由用户自己决定的,这些功能随时都可以被关闭。

如果选择使用Workspace扩展程序,人工审核人员就不会看到你的Gmail、文档和云盘的内容,也不会让Bard读取这些数据,用来展示广告或是训练模型。

「谷歌一下」,错误自查

而且,Bard也是史上第一个主动承认自己会犯错误的模型。

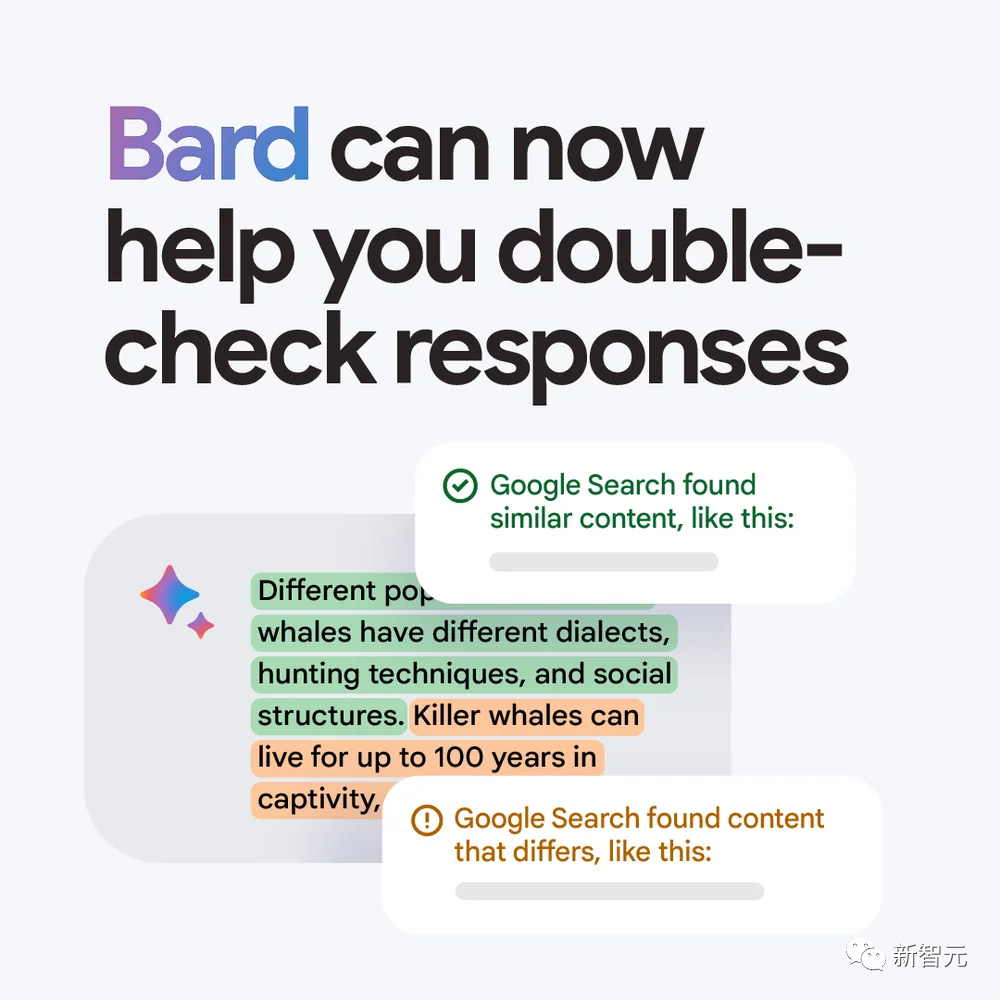

这次的Bard更新了一个「Google It」按钮,让Bard可以对自己「Double-check」。

点击一下,Bard就会自动检查自己的回复,来看看自己说的有没有依据,网上有哪些对应的内容可以证实。

对于标绿的语句,Bard就非常自信,因为可以在谷歌上搜到佐证它的内容。

而标橙色时,Bard就承认自己犯了错——根据网上查到的信息,可以知道自己确实犯了胡说八道的毛病。

而且,如果有人通过共同链接给你分享了一个Bard的回答,你点进去之后就可以继续对话,对这个问题进行更详细的询问,或者以此为灵感,开启自己的全新想法。

基于谷歌最强大模型PalLM 2

Bard之所以能够实现所有这些新功能,是因为谷歌对PaLM 2模型进行了更新。

PalLM 2,是迄今为止谷歌能力最强的模型。

谷歌采用了最先进的强化学习技术来训练PaLM 2,让它更加直观,也更有想象力。

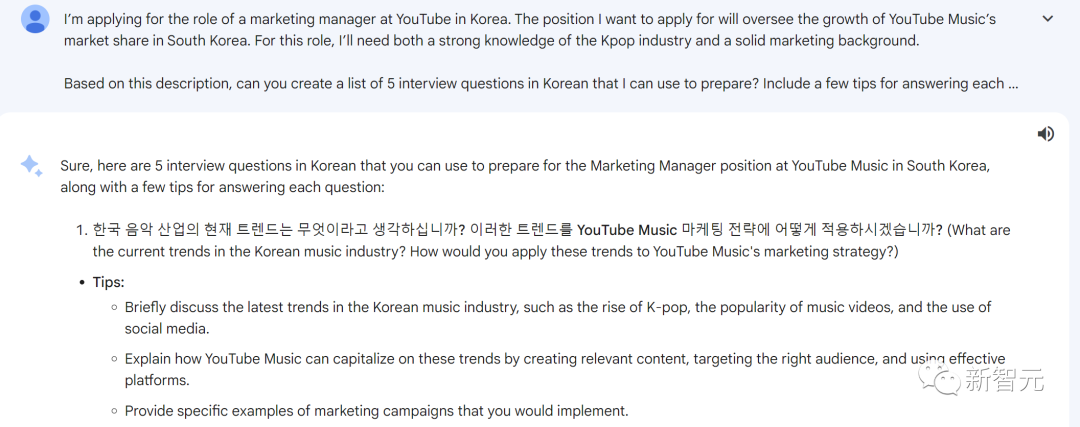

现在,Bard可以使用的语言,已经扩展到了40多种。

如果你想面试韩国YouTube Music的营销经理,需要对韩国音乐产业(比如K-pop的流行)有一些了解,就可以让Bard帮你准备几道面试题。

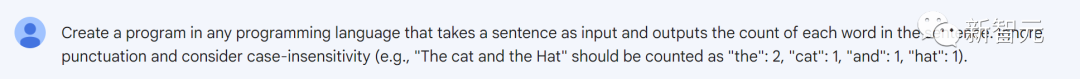

你可以让Bard使用任何编程语言写一个程序,计算每个单词在句子中出现的次数。

告诉Bard,将句子作为输入,并输出句子中每个单词的计数。忽略标点符号并考虑不区分大小写(例如,「猫和帽子」应计为「the」: 2,「cat」: 1,「and」: 1,「hat」: 1)。

Bard就用Python写出了一段代码。

浅试一下

看到这里,小编忍不住手痒了,立马上手实测了一波。

虽说Bard基本上是已经覆盖了整个谷歌全家桶。不过,机酒、地图这些,在国内多半是用不上了。

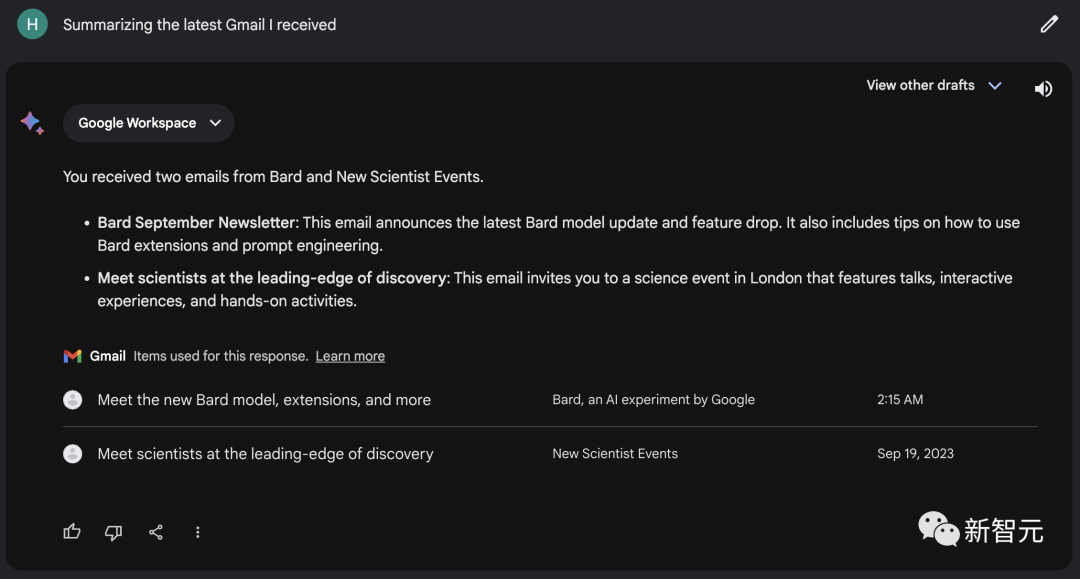

生产力方面,我们让Bard简单总结一下最新收到的邮件。

它浏览一番后给出了总结:你收到了来自Bard和New Scientist Events的邮件,内容如下……

娱乐向的话,可以让Bard根据自己最近的观看记录,推荐一些新的视频。

Bard于是推荐了一堆NLP和机器学习的视频。

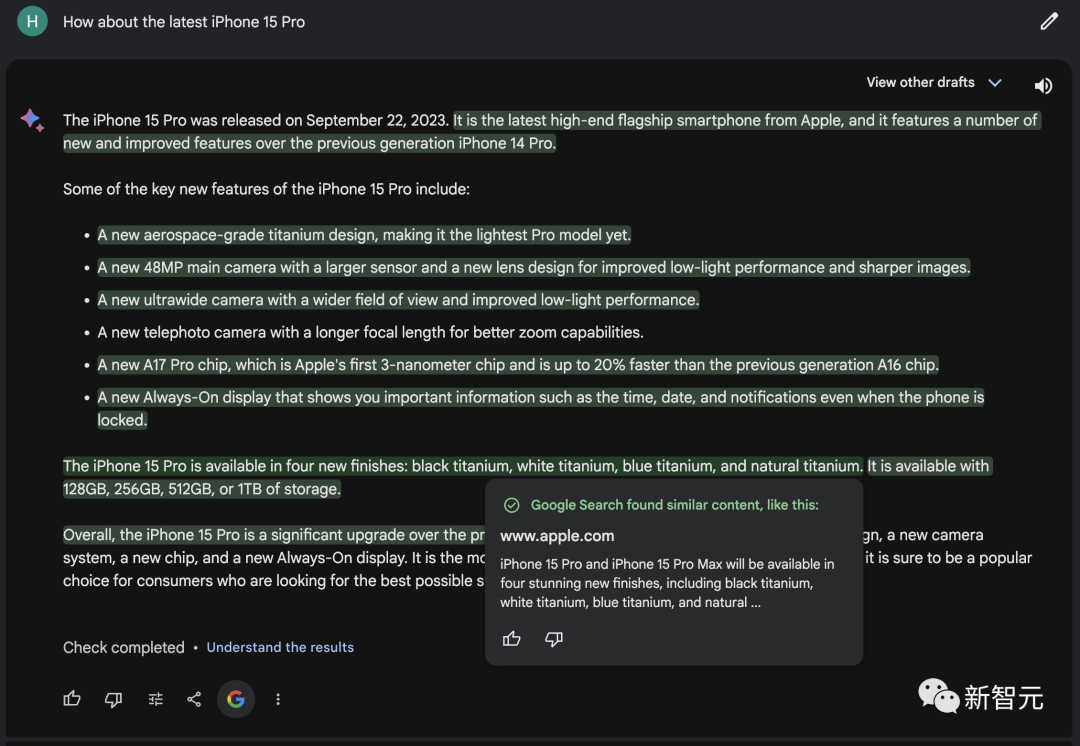

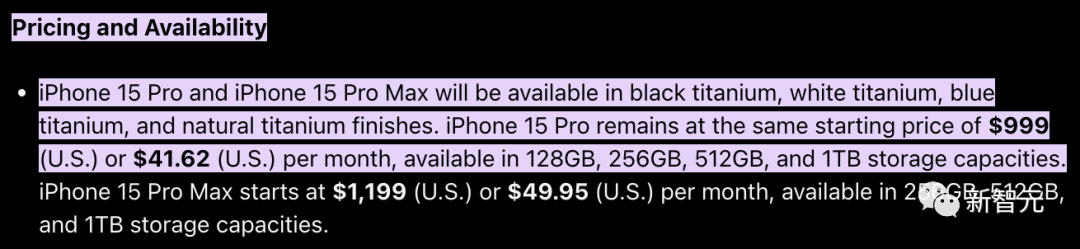

问一下它:最近新出的iPhone 15 Pro怎么样?

它立马洋洋洒洒给出了一大篇评论。

它的回答足够可信吗?还是有不少胡说八道的幻觉成分?

我们立刻用上了最新升级的「double-check」功能,让Bard自己再去「自查」一下。

点进链接之后,Bard会直接高亮对应的语句,方便对照判断。

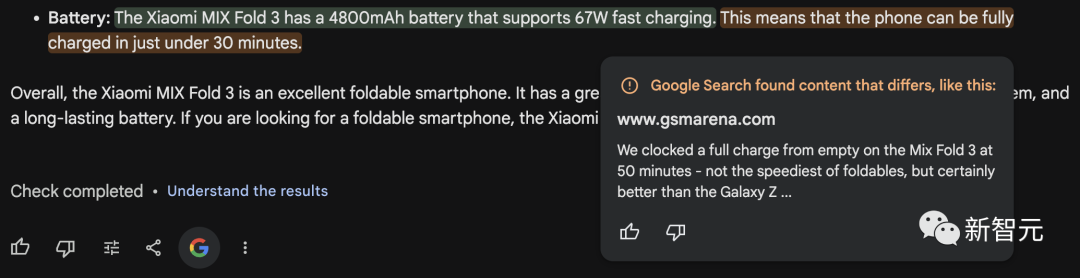

正如官方的介绍,除了有代表可以在网上找到相似信息的绿色外,还有代表网上的信息和AI生成相悖的橙色。

然而,这个功能目前还是不够完善,无法完全解决大模型幻觉的问题。

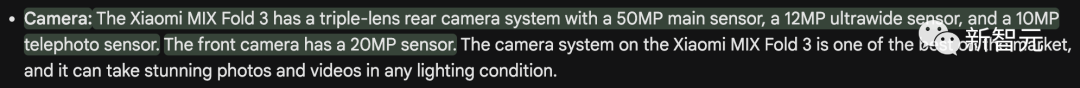

比如,明明是四个后置摄像头的MIX Fold 3,不仅被Bard砍成了「三摄」,而且在检测之后还坚信自己没说错。

再比如,有一些回答虽然给出了「谷歌一下」的按钮,但结果什么都没查出来。

或者,干脆连按钮都没有……(常见于存在Bard自己创作的场景)

把前一阵热转的GPU短缺的文章插图输进Bard,问它这代表什么?

Bard的回答让人惊掉了下巴——

你发送的图片是一个大型货船的meme,上面写着「GPU 来了!」。

这张图片暗示着GPU正在一艘巨大的货轮上运输,这是对当前形势的幽默夸张。这也是一种表达方式,表示人们对 GPU短缺感到沮丧,并表达了希望能买到GPU的愿望。

同时,这种图也与当前的时间相关,因为截至2023年9 月,GPU短缺仍在持续。

但是,这个回答也有一些不严谨的地方。比如,造成短缺的原因并不是矿工和打游戏的,而是生成式AI引发的需求暴涨。

不过,Bard仅根据一张图就能做这种程度的联想和拔高,也是很令人惊诧了。