仅在今年第二季度,英伟达就已经卖出了816吨H100!

假如这个速度不变,它有望在今年卖出3,266吨H100。并且,在接下来的每年里,英伟达都会卖出120万张H100。

现在,云服务供应商的大规模H100集群容量即将耗尽,全球陷入GPU短缺,硅谷大佬们都急了——整体算来,全球公司需要约432000张H100。

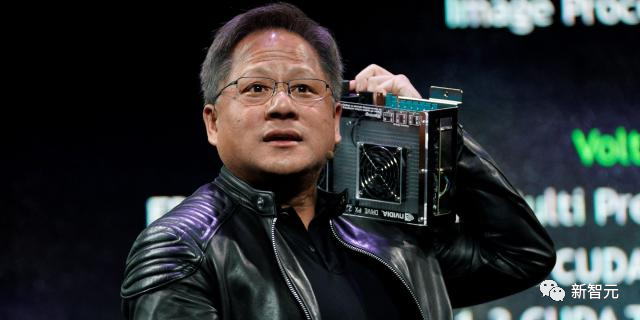

最近同时大火的,还有黄仁勋管理英伟达的方法。

「没有计划、没有汇报、没有层级」,如此随性,如此佛系,甚至可以说,如此疯狂。

就是这种管理办法,让英伟达市值超过1万亿,在半导体公司中一时风头无两。

半导体巨人

英伟达声称,在2024财年第二季度,他们售出了价值103亿美元的数据中心硬件。

价值103亿美元是什么概念?

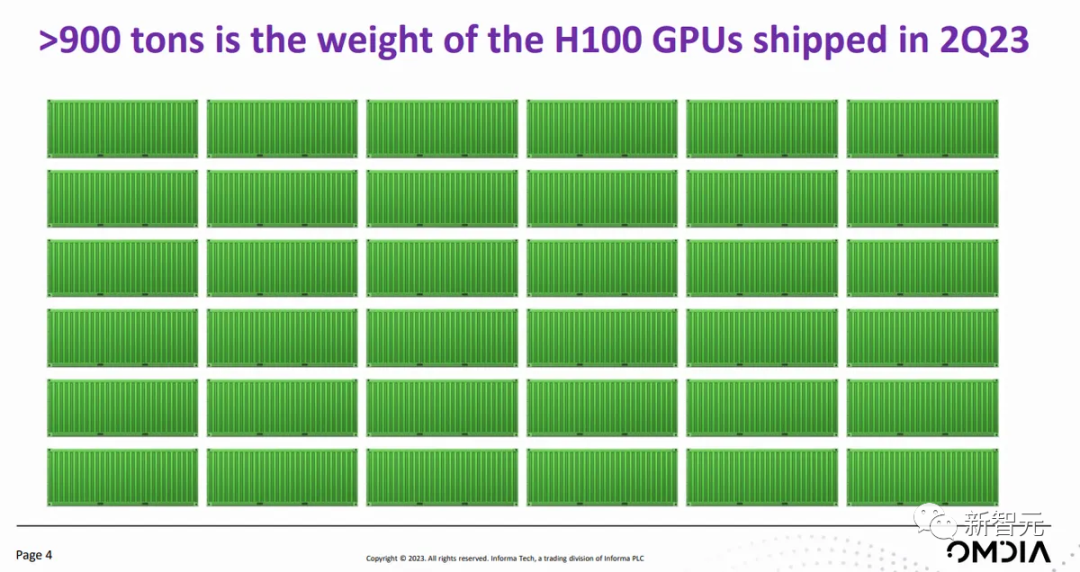

今天,市场研究公司Omdia给出了让我们更容易理解的单位——816吨H100!

根据Omdia估计,第二季度英伟达的H100 GPU出货量超过了816吨。

一个英伟达H100 GPU,再加上散热器,平均重量超过了3公斤,因此,第二季度的H100发货量,保守估计也有30万个。

Omdia的估算准确吗?

要知道,H100有三种不同的外形尺寸,重量也不尽相同。

H100 PCIe显卡重达1.2千克,H100 SXM模组的重量尚不清楚,而带散热片的OAM模组重量可达2千克,它与H100 SXM的尺寸和TDP大致相同。

假设H100出货量80%是模组,20%是显卡,那么单个H100的平均重量应为1.84千克左右。

所以,Omida的估算可以认为大致准确。当然,实际重量可能少于816吨这个数字。

816吨是多重?

为了便于理解这个重量,我们可以拿以下这些东西来类比——

4.5架波音747

11架航天飞机

181,818台PlayStation 5

32,727只金毛

假如英伟达在未来几个季度保持相同的GPU销量,那么它有望在今年售出3,266吨H100。

假如这个速度保持不变,每年英伟达都会卖出120万个H100。

并且,还不止这些。

还有H800,以及上一代的A100、A800、A30。

这样算的话,英伟达每季度实际销售的GPU数量远远高于30万个,重量总计远超过816吨。

即便如此,仍然不能满足全球的GPU荒——根据行业内部消息,英伟达H100 2023年的产量,早已销售一空,现在交钱订购,至少要到2024年中才能拿到货。

现在,H100早已一卡难求。

甚至还有外媒爆料:英伟达要在2024年,将H100的产量从今年的50万张左右直接提高到150-200万张。

显然,随着英伟达芯片在生成式AI的热潮中愈加紧俏,这个预测并不夸张。

黄仁勋「第一性原理」

与此同时,GPU的销量暴涨,也让英伟达成为了世界算力霸主,成功进入万亿美元俱乐部。

这背后离不开领导人黄仁勋的「疯狂式」的管理策略。

老黄表示,当你创立一家公司时,很自然地从第一性原理开始。

「就像我们正在建造一台机器如何运作一样,什么是输入,什么是输出,处在什么条件下,行业标准又是什么.....」

用老黄的话来说,英伟达的使命是,解决世界那些几乎不可能的计算问题。如果一个问题可以由普通的电脑解决,英伟达就会不做。

为了实现这一使命,英伟达吸引很多很多出色的人才,聚集在一起。

同时还需要,老黄管理这些人才的顶级策略,具体包括:

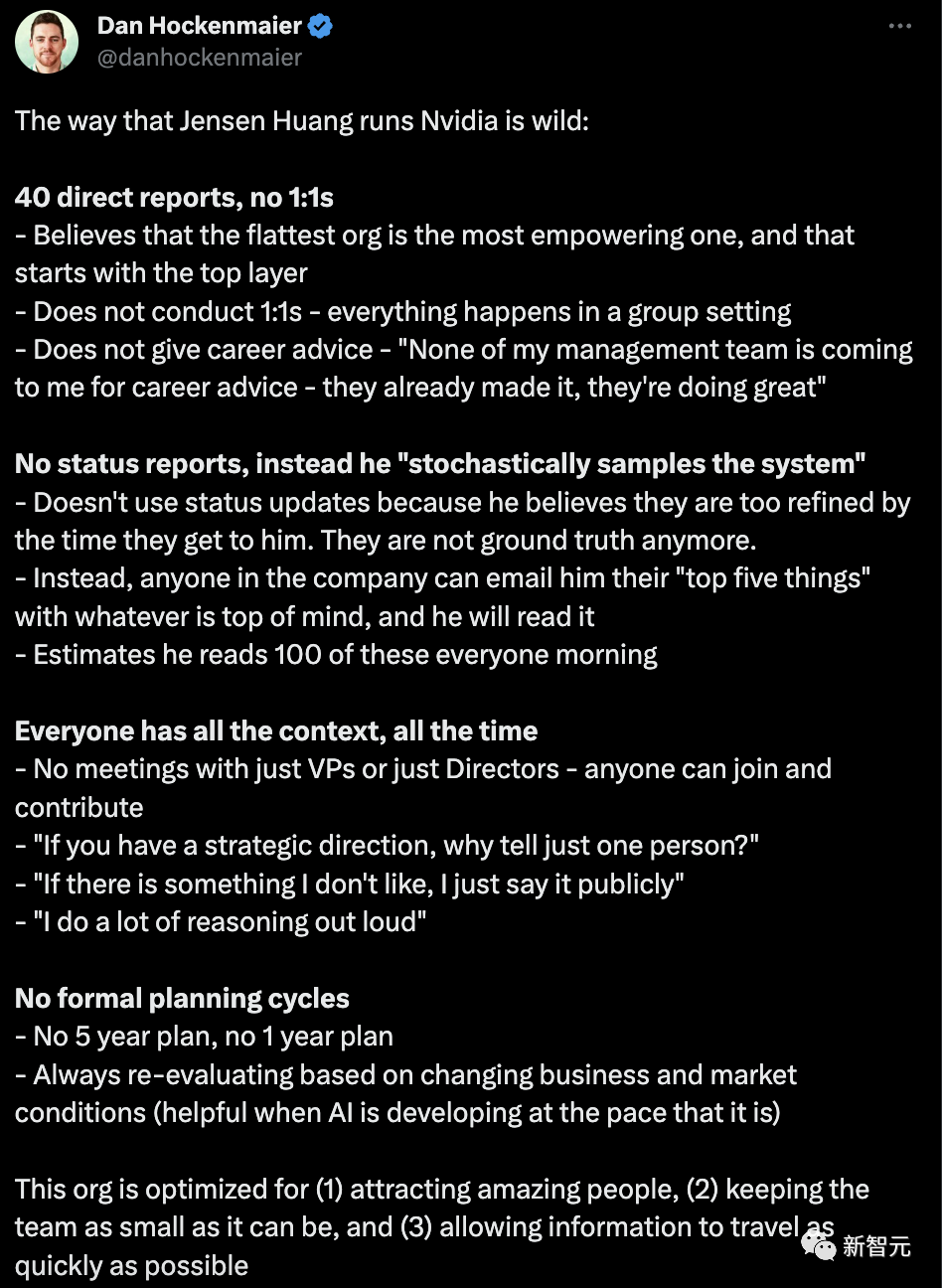

直接管理40名下属,没有1:1会议

英伟达不需要「金字塔」式的管理,而是将权力下放给每一个人。

老黄信奉扁平化的组织最富有能力,以便信息能够快速传播。

其中,组织的第一层——公司高层,就必须要考虑更加周全。他从不向任何人高管提供职业建议,因为管理团队中没有人来向他寻求职业建议。

「他们已经成功了,他们做得很好」。

另外,老黄从不进行1对1会议,所有事情都在小组讨论中进行。

「如果你有一个战略方向,为什么只告诉一个人?应该让每个人都知道」。

每个人都能随时了解所有情况

在公司内部,从来都不会召开副总裁会议、总监会议。

老黄称,自己参加的会议里,有来自不同组织的人,刚刚毕业的大学生,任何人都可以参加并发表意见。

不做状态报告,而是email「前五件事情」

在英伟达,每个人都不需要做状态报告,因为老黄认为这像是「元资讯」,太过精炼,基本上没有有益的讯息。

相反,公司里的任何人都可以通过电子邮件向他发送自己的「前五件事情」。

你所学到的,你所观察到的,你即将要做的,无论是什么事情,他每天早上都会阅读100+邮件,去了解大家的TOP 5 things。

比如,你去了一家非常棒的餐厅、有了一个可爱的baby...,这才是真正重要的信息。

没有正式的定期计划

对于,如何去做规划,让公司最底层的想法展现出来、让最好的工程师执行。

老黄表示,对于我来说,没有5年计划,也没有1年计划,会根据不断变化的业务和市场条件进行重新评估。

总结来说,英伟达优化组织结构的目的是:(1)吸引优秀人才;(2)保持尽可能小的团队规模;(3)使信息传播尽可能迅速

就连英伟达深度学习研究员VP Bryan Catanzaro,直接现身证明,全部为真。

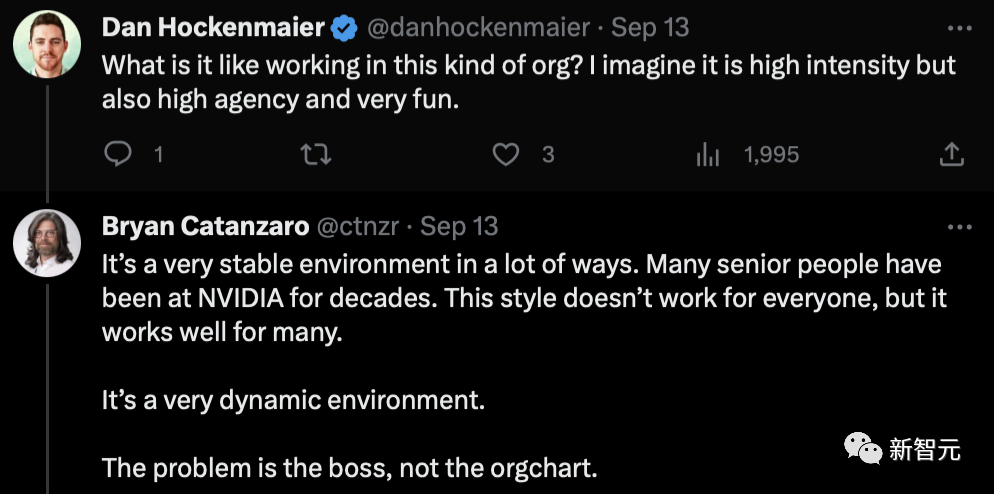

那么,在这样的组织工作是一种什么样的体验?

Bryan表示,在很多方面,这是一个非常稳定的环境。许多资深员工已经在英伟达工作了几十年。这种风格并不适合每一个人,但对很多人来说却很有效。这是一个充满活力的环境。

与马斯克不同的是,老黄很少对外讲述自己管理公司的方法。

今年在台大的演讲中,老黄曾讲述了定义了今天英伟达样貌的3个故事。这当中,离不开他的决策和判断,已经思考。

最初,英伟达与SEGA签约,为其打造游戏机。经过一年的开发过程,却发现使用的技术架构是错误的。

但是,黄仁勋发现即便纠正过来,也无济于事,因为这一产品创造与微软的Widows系统并不兼容。

于是,他联络了SEGA执行长,解释英伟达无法完成这个任务,并还得到了SEGA的帮助,所幸没有破产。

第二件事,就是2007年英伟达宣布的CUDA GPU加速计算技术。

为了向全世界推广CUDA技术,还专门创办了GTC的会议。经过多年努力,英伟达这项技术成为AI革命重要的推动引擎。

第三件事,做出放弃手机市场的艰难决定,将重心放在显卡上。

正如老黄所说,「战略性的撤退、牺牲、决定放弃什麽是成功的核心,非常关键的核心。」

一位X的工程师称,这一管理方式与马斯克X公司的操作非常类似。

还有网友戏称,老黄的这种管理方式,都可以在多模态智能体大模型体系中建模了。

如果老黄,能够像马斯克一样出一本传记,相信每个人都愿意去拜读一下。

看看,英伟达的GPU如何取得成功,成为大厂的掘金铲。

全球GPU缺口超40万张

H100的短缺,早就让硅谷大佬们都慌了!

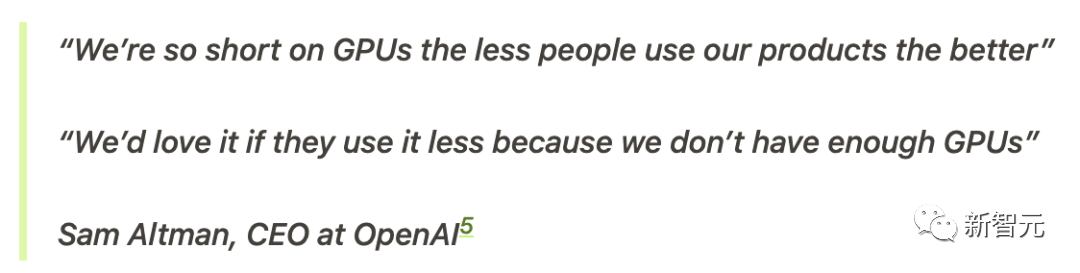

Sam Altman就曾自曝,GPU已经告急,希望用ChatGPT的用户能少一点。😂

「GPU非常短缺,使用我们产品的人越少越好」

Altman表示,受GPU限制,OpenAI已经推迟了多项短期计划(微调、专用容量、32k上下文窗口、多模态)。

OpenAI联合创始人兼职科学家Andrej Karpathy也透露过,现在谁家得到了多少块H100,都是硅谷的顶级八卦。

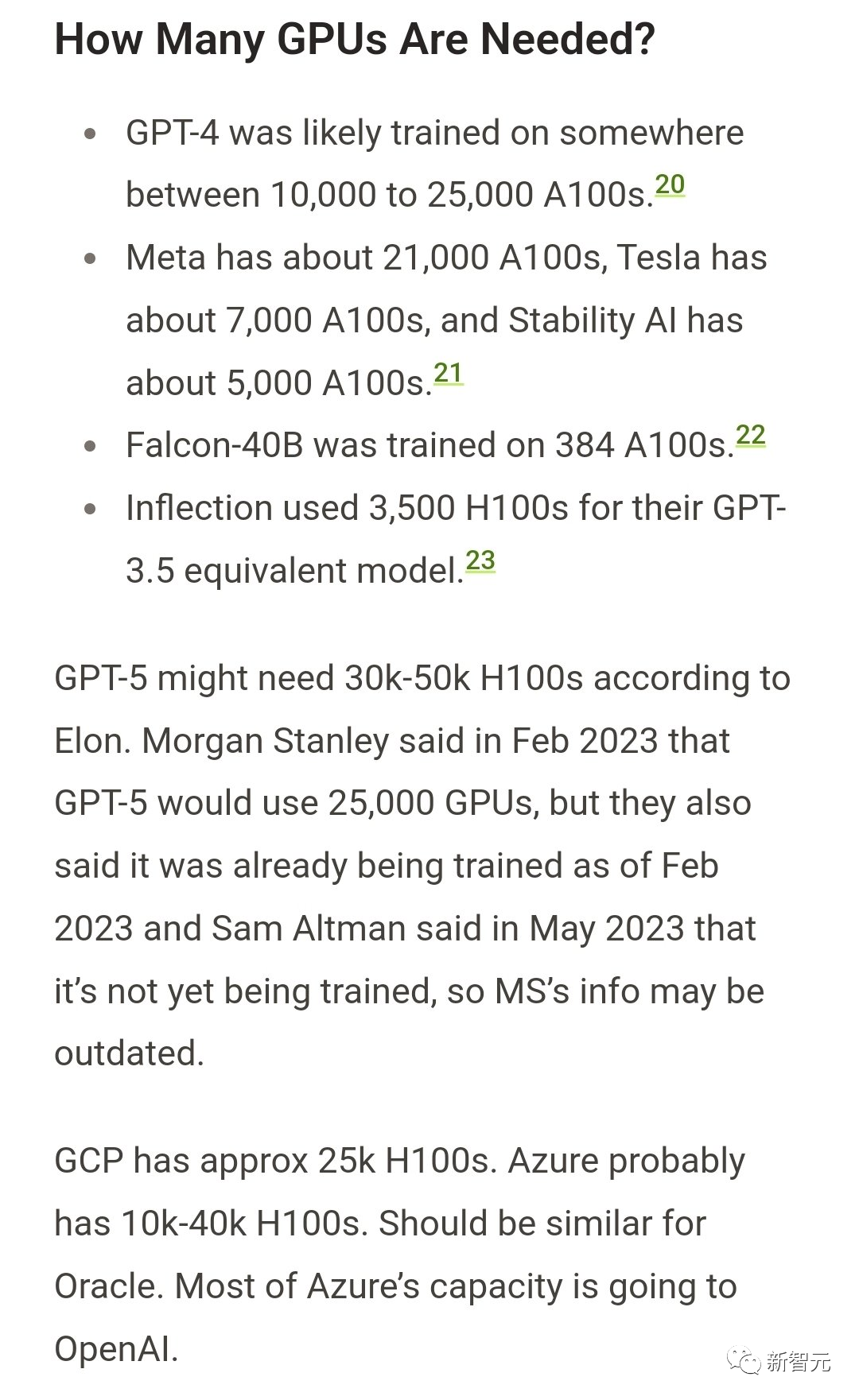

这张在社区广为流传的图曾做出如下估算——

-GPT-4可能在大约10000-25000张A100上进行了训练

-Meta大约21000 A100

-Tesla大约7000 A100

-Stability AI大约5000 A100

-Falcon-40B在384个A100上进行了训练

– Inflection使用了3500和H100,来训练与GPT-3.5能力相当的模型

现在不光是科技公司排着队购买H100,连沙特阿拉伯和阿联酋都出手了,一下就买了几千个H100 GPU。

马斯克直言,现在想买到H100已经难如登天。

根据马斯克的说法,GPT-5可能需要30000-50000个H100。此前,摩根士丹利曾表示GPT-5使用25000个GPU,自2月以来已经开始训练,不过Sam Altman之后澄清了GPT-5尚未进行训。

而一篇名为「Nvidia H100 GPU:供需」文章曾推测,小型和大型云提供商的大规模H100集群容量即将耗尽,H100的需求趋势至少会持续到2024年底。

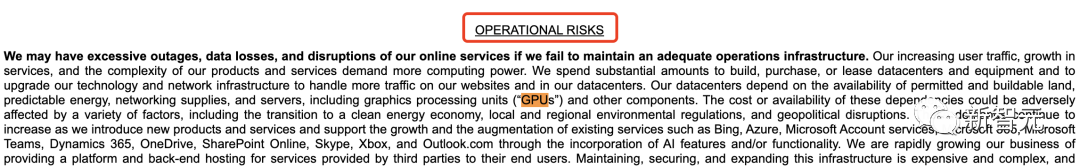

微软的年报中也向投资者强调,GPU是其云业务快速增长的「关键原材料」。如果无法获得所需的基础设施,可能会出现数据中心中断的风险因素。

据推测,OpenAI可能需要50000个H100,而Inflection需要22,000个,Meta可能需要 25k,而大型云服务商可能需要30k(比如Azure、Google Cloud、AWS、Oracle)。

Lambda和CoreWeave以及其他私有云可能总共需要100k。Anthropic、Helsing、Mistral和Character可能各需要10k。

整体算来,全球公司需要约432000张H100。按每个H100约35k美元来计算,GPU总需求耗资150亿美元。

这其中,还不包括国内大量需要H800的互联网公司。

而且,H100不光不愁卖,利润率还高得吓人。

业内专家曾称,英伟达H100的利润率接近1000%。