我们知道过去几年,图像编辑领域发展惊人。但在视频领域,还有所缺陷。近日,一项视频编辑领域的研究成果放出。让我们先来看一下效果。

姜文变成大猩猩......

美女变成卡通人物......

是不是看起来非常不错?这都来自于以下这篇研究。

链接:https://arxiv.org/abs/2308.07926

图像处理领域能取得如此显著的进步,在很大程度上归功于能够在大规模数据集上训练的生成式模型,后者能显著提高图像任务的质量和精度。然而,有关视频内容的处理任务却没有取得同等的进展。视频任务的挑战之一在于对保持时间一致性的要求较高,而这个要求会因神经网络固有的随机性而变得复杂。另一个挑战来自视频数据集本身的性质,和图像集相比通常质量较差,并且需要更多的计算资源。

因此,基于视频的算法的质量明显落后于那些专注于图像的算法。这种落差引发了一个问题:以图像形式表示视频,将已建立的图像算法无缝应用于具有高度时间一致性的视频内容是否可行?

为了实现这一目标,在深度学习时代之前,研究人员曾建议从动态视频中生成视频马赛克,而在隐式神经表征提出之后,研究人员又建议利用神经分层图像图集。但是这些方法存在两个主要缺陷。首先,这些方法的表征能力是有限的,特别是在如实地重建视频中错综复杂的细节时。通常,重建的视频忽略了微妙的运动细节,如眨眼或轻微的微笑。第二个限制与估计图集的典型扭曲性质有关,语义信息会因此受损。总而言之,现有的图像处理算法无法发挥最佳性能,因为预测的结果缺乏足够的自然度。

本文作者提出了一种新的视频表征方法,该方法利用基于 2D 散列的图像场和基于 3D 散列的时间变形场。结合多分辨率散列编码来表示时间变化,大大提高了重建一般视频的能力。这种方法有助于跟踪水和烟雾等复杂实体的变形。然而,变形场能力的增强对估计自然规范图像提出了挑战。不自然的规范图像也可以通过完整的重建来估计相应的变形场。

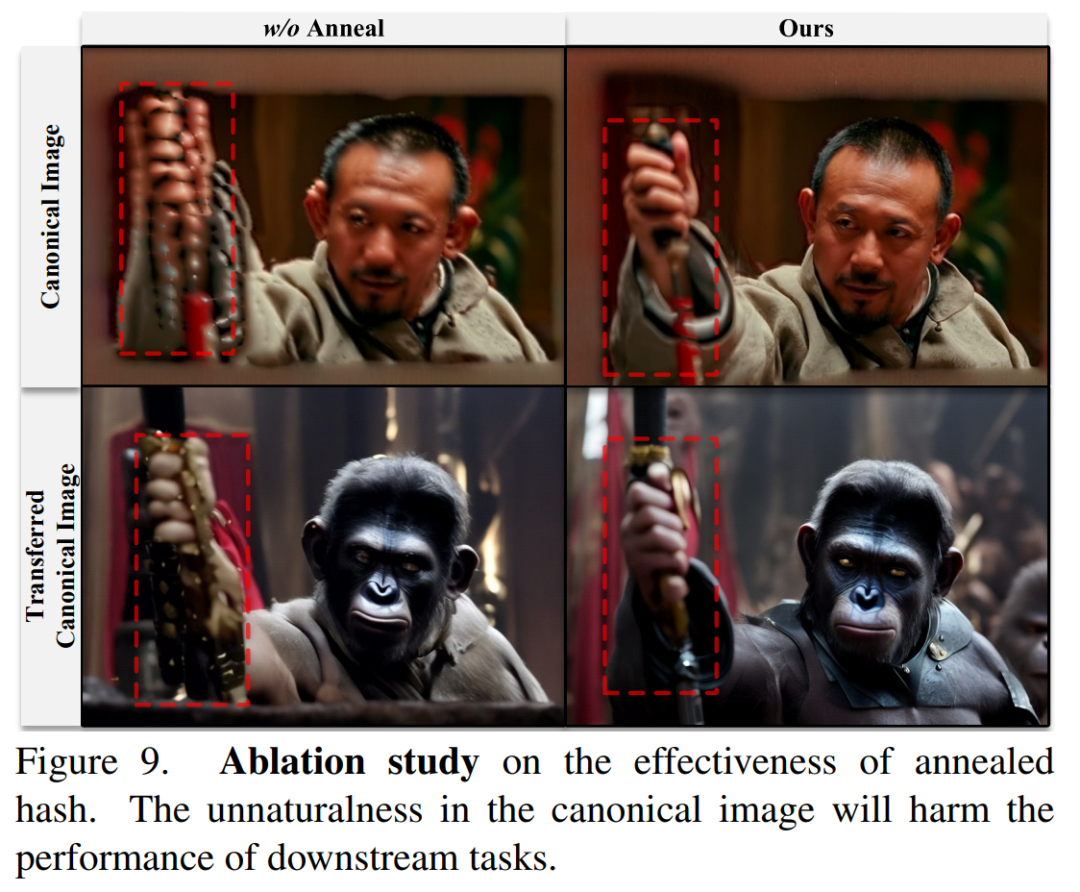

为了应对这一挑战,本文建议在训练期间使用退火哈希算法。先使用平滑变形网格来识别适用于所有刚性运动的粗解决方案,然后逐渐添加高频细节。通过这种由粗到细的训练,表征结果在规范的自然性和重建的还原性之间实现了平衡。与之前的方法相比,本文作者观察到重建后的质量显著提高。改进后 PSNR 大约增加 4.4,规范图像的自然性也肉眼可见的增加。这种方法的优化过程只需要大约 300 秒来估计带有变形场的规范图像,而之前的隐式分层表示需要超过 10 个小时。

本文在变形场算法的基础上,还说明了提升图像处理任务,如提示引导图像翻译、超分辨率和分割 —— 到视频内容的更动态场。在处理标准图像时,本文使用的 prompt-guided 的视频到视频重建的方法,具体来说使用的网络是 ControlNet ,然后通过学习后的变形场传导重建的内容。重建过程在单个标准图像上进行,无需跨所有帧,无需使用耗时的推理模型(例如扩散模型)。与基于生成模型的 sota 零拍视频重建相比,本文的重建输出结果在时间一致性和纹理质量方面有明显改善。与依赖神经分层标签的 Text2Live 相比,本文提出的模型可以说是精通处理更复杂的运动,能给产生更自然的标准图像,从而实现卓越的重建结果。此外,本文将超分辨率、语义分割和关键点检测等图像算法的应用扩展到标准图像,从而在视频上下文中能给得到实际应用。这包括视频超分辨率、视频对象分割、视频关键点跟踪等。本文作者提出的表征算法能从始至终地保持卓越的时间一致性,生成高保真合成帧,展示了其作为视频处理工具突破性的潜力。

方法概览

给定由帧 {I1,I2,…,IN} 组成的视频 V,对于对应的视频任务,可以简单地将图像处理算法 X 单独应用于每一帧,但是可能会出现帧之间存在不一致的内容,这是我们不希望看到的。进一步地,可以使用另一种策略:用时间模块增强算法 X,但这需要对视频数据进行额外的训练。然而,简单地引入时间模块很难保证理论的一致性,并且可能由于训练数据不足而导致性能下降。

受此启发,本文作者建议使用平滑的规范图像 Ic 和变形场 D 来表征视频 V。通过在 Ic 上应用图像算法 X,可以利用学习到的变形场将效果有效地应用到整个视频。这种新颖的视频表示是图像算法和视频任务之间的重要桥梁,能将最先进的图像方法直接提升到视频应用中。

本文提出的表征算法具有以下基本特征:

- 如实地视频重建的拟合能力。表征应该具有精确拟合视频中的大的刚性或非刚性物体变形的能力。

- 规范图像的语义正确性。失真或语义不正确的规范图像可能导致图像处理性能下降,特别是考虑到这些训练过程多数都是在自然图像数据上进行的。

- 变形场的平滑度。保证变形场的平滑性是保证时间一致性和正确传播的一个基本特征。

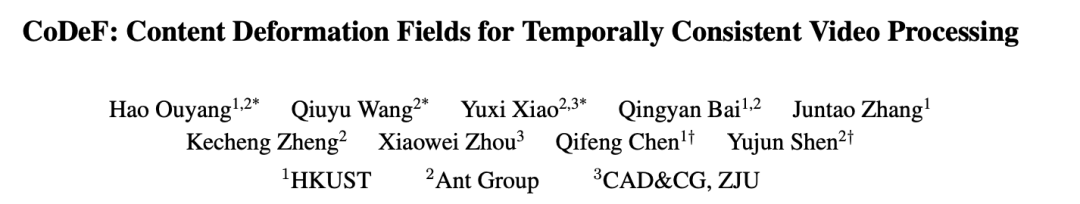

下图 2. 显示了本文提出的的视频表示算法 CoDeF 的说明,其将任意视频分解为 2D 内容规范场和 3D 时间变形场。每个字段使用高效的 MLP,用多分辨率 2D 或 3D 哈希表来实现。这种新型的表示算法天然地支持用于视频处理任务的图像算法,其方式是将所建立的算法直接应用于规范图像(即,从规范内容字段渲染),然后沿着时间轴通过时间变形字段传播结果。

实验

重建质量

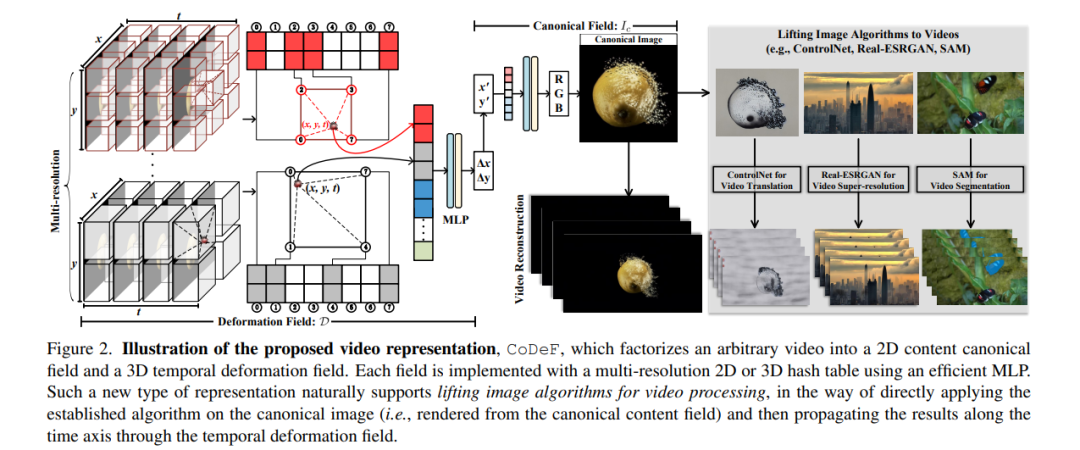

在与神经图像图谱的比较分析中,如图所示,本文提出的模型对非刚性运动表现出卓越的鲁棒性,能够以更高的精度有效地重建细微的运动(例如眨眼、面部纹理)。

流媒体视频处理

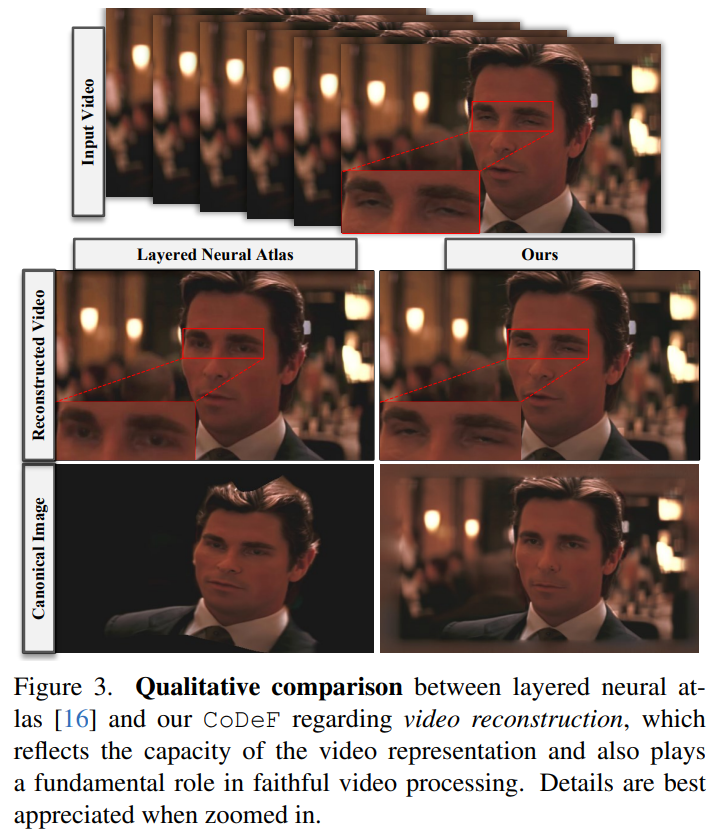

(a) 视频到视频的重建。定性比较包括几种基线方法,分为三个不同的类别:(1) 使用图像翻译模型的逐帧推理,如 ControlNet ;(2) 分层视频编辑,如 Text-to-live ;(3) 基于扩散模型的视频翻译,包括 Tune-A-Video 和 FateZero 。

如图 4 所示,每帧图像转换模型可生成高保真内容,并伴有明显的闪烁。其他基线的生成质量或时间一致性相对较低。 本文提出的流水线式方法能有效地将图像转换提升到视频,保持与图像转换算法相关的高质量,同时确保时间一致性。

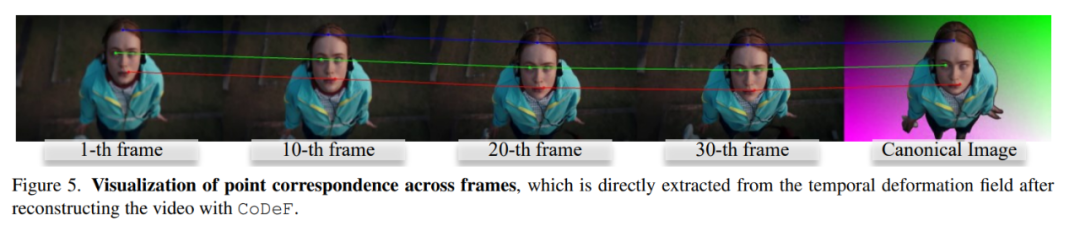

(b) 视频关键点跟踪。通过估计每个单独帧的变形场,可以查询规范空间内一帧中特定关键点的位置,然后识别所有帧中存在的对应点,如图 5 所示。本文在项目页面的视频中展示了在非刚性对象(如流体)中跟踪点的演示。

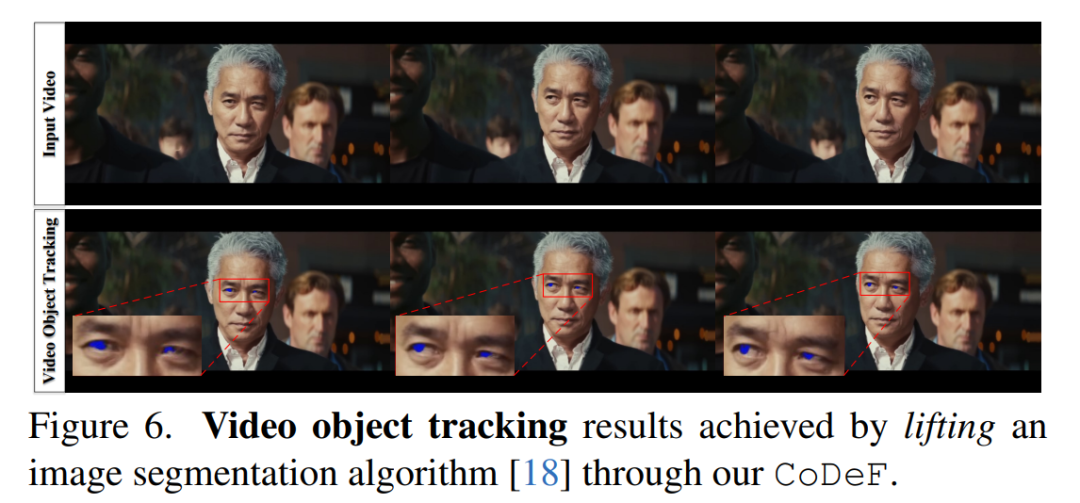

(c)视频对象跟踪。使用规范图像上的分割算法,本文能够利用内容变形场促进掩模在所有视频序列中的传播。如图 6 所示,本文提出的流水线算法熟练地生成在所有帧之间保持一致性的掩码。

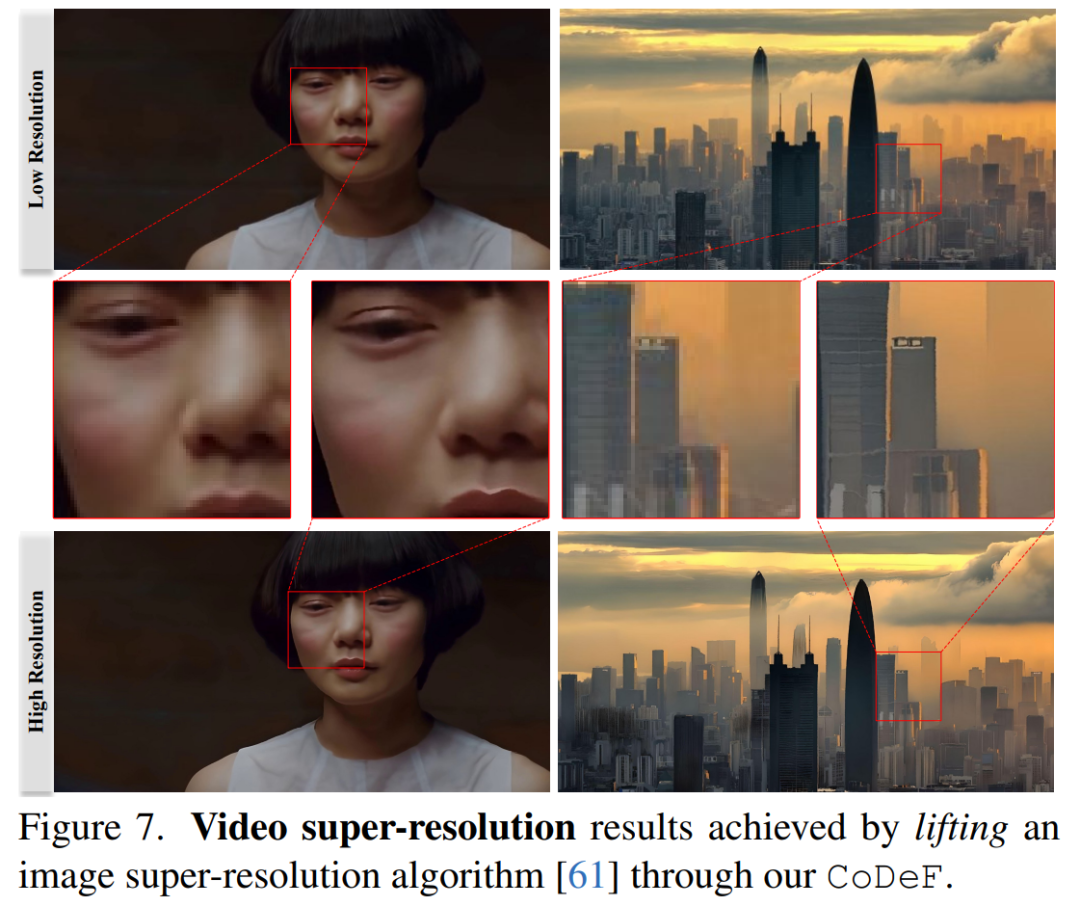

(d) 视频超分辨率算法。通过将图像超分辨率算法直接应用于规范图像,可以将视频进行超分辨率处理以生成高质量视频,如图 7 所示。假设变形由连续场表示,那么超分辨率的应用不会产生闪烁。

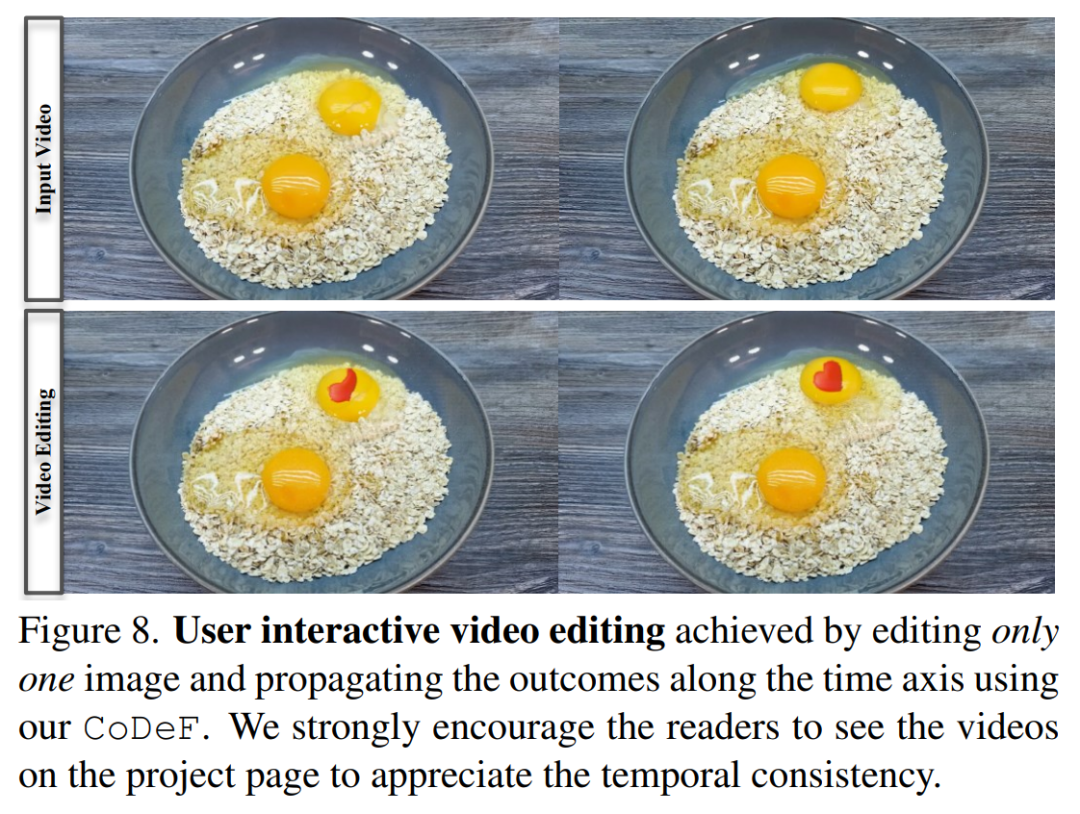

(e) 用户交互式视频编辑。本文提出的表示算法允许用户编辑具有独特风格的对象,而不会影响图像的其他部分。如图 8 所示,用户可以手动调整规范图像上的内容,以在自动编辑算法可能无法实现最佳结果的区域进行精确编辑。

消融实验

为了验证本文所提出模块的效果,作者进行了消融实验研究。在用位置编码代替 3D 散列编码时,视频的重建 PSNR 显著降低了 3.1dB。在没有退火散列的情况下,规范图像失去了其自然外观,如图 9 中的显示。此外,在不考虑流信息损失的情况下,平滑区域明显受到闪烁的影响。要进行更广泛的比较,请参阅项目页面上的视频。