OpenAI刚刚把自家的文本检测器Classifier给下线了,总共上线才半年。

图片

图片

今年年初,OpenAI兴致勃勃地发布了Classifier,宣称有了它,谁都能知道某一段文本是不是由GPT生成的,不说拯救世界吧,最起码老师有福了。

但半年过去,Classifier直接寄了。

OpenAI表示,这东西根本实现不了设计的时候的目的,准确率太低。

图片

图片

而且,小编觉得OpenAI下线的行为充分说明了一个事情,就是AI检测器这东西完全不靠谱,可能方向都是错的。

因为在AIGC充斥网络,引发了不少混乱的今天,AI检测器本应该是一个非常有用的东西。

就算检测准确率因为技术所限,暂时还不是很高,也可以让用户一边用着一边改进技术,积累用户。

直接下线,基本就是OpenAI宣告了现有技术方向的死刑。

提前破解ICML杰出论文中提出的水印方法

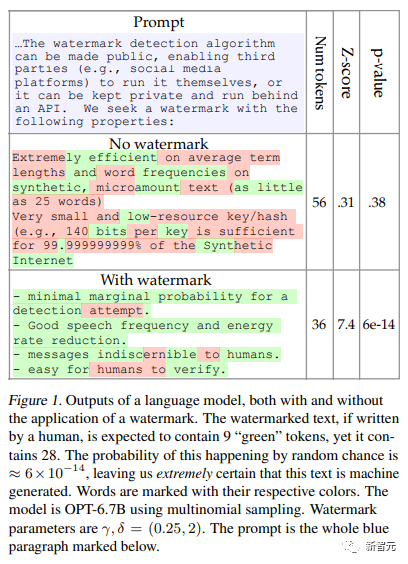

而更有意思的是,刚刚获得了ICML杰出论文奖的一篇论文,给出了一种给LLM生成的内容加水印的可行方法。

图片

图片

工作原理是,在单词生成前随机选择一组绿色标记,然后在采样过程中柔和地促进绿色标记的使用。

图片

图片

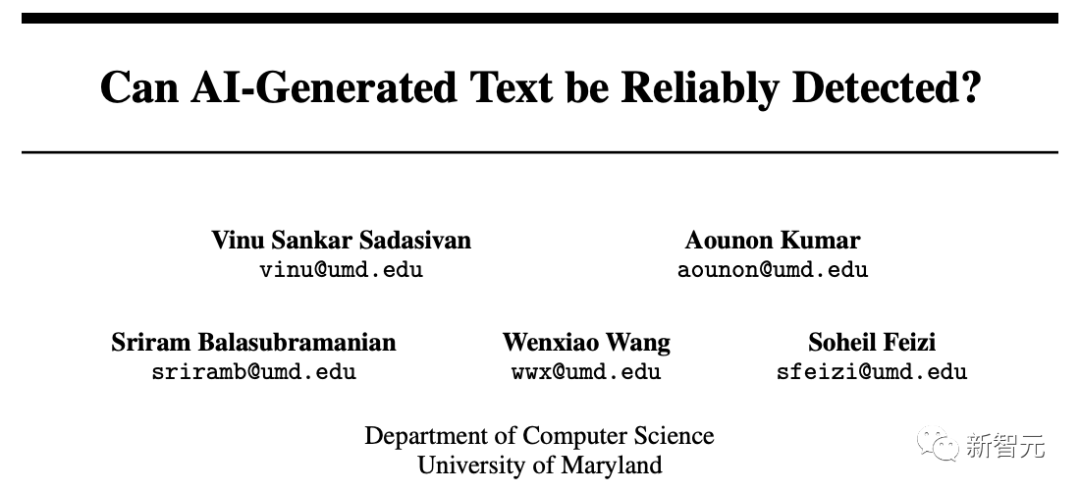

但就在前几天,另一篇同样由马里兰大学的另一个研究团队发表的论文,却直接打脸了ICML的杰出论文。

图片

图片

论文地址:https://arxiv.org/abs/2303.11156

他们在论文里直接就对标这篇获奖论文的水印方式,提出了让水印失效的方法。

图片

图片

加水印的论文能拿ICML杰出论文奖,那攻破水印的论文是不是也能高低给个「更杰出论文奖」?

图片

图片

而作者之一的马里兰大学CS系副教授Soheil Feizi,在推上阴阳怪气地表示,「可千万别让前几天说要加水印的几个哥们看到。」

图片

图片

这也就很好的印证了为什么OpenAI要头也不回地把自己刚上线半年的GPT检测器下线。

检测器,不行!

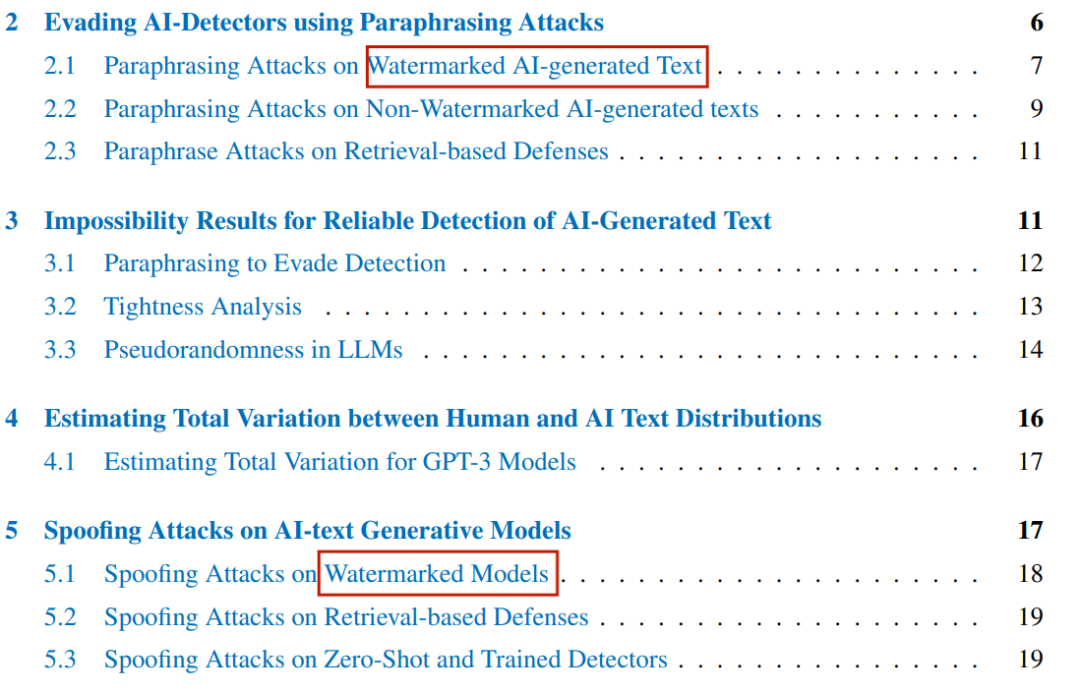

论文很长,但很好概括。

简单来说几句话:

· 可靠检测AI生成的文本,对LLM的训练和使用非常重要。

· 从经验上讲,现在的检测器不行。

· 从理论上讲,现在的检测器不行。

· 结论:现在检测不出来。

图片

图片

在经验这一块,研究人员证明了,在生成文本模型之上再用上轻型仿写器的仿写攻击,就可以破解一系列的检测器。

甭管是用了水印的检测器,还是基于神经网络的检测器,还是零样本分类器。

而就算是为规避转述攻击而设计的检测器,在面临递归仿写的时候还是不灵。

再来,从理论上,研究人员证明,随着语言模型越来越复杂,越来越善于模拟人类的文本,再好的检测器性能也得拉闸。

甚至可能就比随机分类器好一点罢了。

而单独针对水印问题,研究人员表示,只要有人能推测或者找出隐藏的水印信息,然后添到人类自己写的文本里,那人类的文本也会被判定为LLM生成的了。

意思就是说,你辛辛苦苦写了篇文章,我偷偷把找到的隐藏水印信息加进去,那你的文章就会被认为是生成的,你会被指控欺骗。

哪里还有安全性可言呢?

原理介绍

为了能进一步探究这一点,最近的许多研究都集中在检测AI生成的文本上。

一些检测工作将这一问题作为二元分类问题进行研究。

例如,OpenAI对基于RoBERTa的GPT-2检测器模型进行了微调,以区分非AI生成的文本和GPT-2生成的文本。这就要求对这种检测器进行微调,并对每个新的LLM进行监督,以实现可靠的检测。

但是,这些依赖神经网络进行检测的方法很容易受到恶意和中毒攻击。

而另一个研究方向是零样本(zero-shot)AI文本检测,不需要任何额外的训练成本。这些工作评估文本的每个标记的预期的对数概率,并执行阈值检测哪些是AI生成的文本。

Mitchell等人观察到,AI生成的文本往往位于文本对数概率的负曲率上。他们利用这一观察结果,提出了一种零样本LLM文本检测方法DetectGPT。

而另一项研究也很重要,就是给AI生成的文本添加水印,以方便检测。

眼不眼熟,惊不惊喜。

Kirchenbauer等人提出的软水印技术,将标记分为绿色和红色列表两类。

带水印的LLM会从由其前缀标记决定的绿色列表中,以高概率采样一个标记。

这些水印通常不会被人类察觉。不过,除非所有功能强大的LLM都受到类似的保护,否则水印可能并不会是防止LLM被利用的有效工具。

Krishna等人通过将LLM的输出存储在数据库中,引入了一种基于信息检索的检测器。

对于每一个候选段落,他们的算法会在该数据库中搜索语义相似的匹配项,让检测的过程不受转述的影响。

然而,存储用户LLM的对话可能会导致严重的隐私问题,这个很好理解。

所以说,在本文中,研究人员通过经验和理论分析表明,这些最先进的人工智能文本检测器在实际应用场景中并不可靠。

研究人员研究了对软水印的经验攻击,以及各种零样本、基于检索和基于神经网络的检测器。

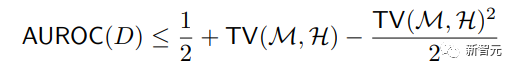

下面这个定理表明,随着两个分布之间的总变化减小,即使是最佳探测器的性能也会下降。它将最佳检测器D的接收器工作特性曲线下面积(AUROC)定义为如下这个公式——

图片

图片

其中,TV(M, H) 是模型生成的文本分布 M 与人类生成的文本分布 H 之间的总变异距离。

它表明,随着总变化的减小,最佳检测性能将接近 1/2,即与随机将文本标记为人工智能或人类生成的分类器相对应的 AUROC。

测试的不可能性结果并不意味着检测性能一定会变得和随机的一样差,而是意味着可靠的检测可能无法实现。

在大多数实际场景中,如果检测器能达到较高的真阳性率(比如 90%),同时保持较低的假阳性率(比如 1%),那么它就被认为是好的检测器。

而当两个分布重叠超过 11%(即总变化 < 0.89)时,就不可能实现这一目标。

这项分析的目的是告诉大家,在使用检测系统检测AI模型生成的文本时要小心谨慎。任何此类系统在部署到现实世界之前,都需要对其可靠性和偏差进行独立、严格的评估,最好是对旨在规避检测的语言模型进行评估。

研究人员用严密性分析补充了结果,证明对于给定的人类分布 H,存在一个分布 M 和一个检测器 D,对于它们,上述约束相等成立。

后文中会多次使用到这个AUROC公式。

过转述攻击(Paraphrasing Attack)来规避AI检测器

检测AI生成的文本对于确保LLM的安全性和避免type-II错误(没有将LLM输出检测为AI生成的文本)至关重要。

测试转述攻击的方式包括:软水印,零样本检测器,基于训练神经网络的检测器和基于检索的检测器。

对含有水印内容的转述攻击。

在这个测试中,语言模型的输出的token被从一个由前缀决定的绿色名单种筛选出来。

研究人员期望这个转述者能把输出token中的水印印记给消除掉。

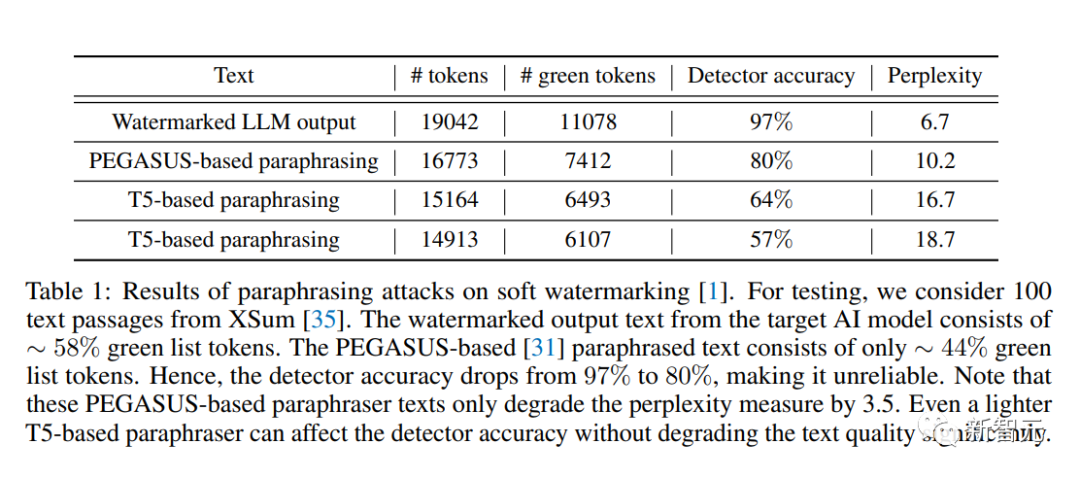

研究人员用一个由T5为基础的模型,以及一个PEGASUS为基础的模型做为转述者。

作为测试的LLM是一个由大量数据训练过的模型,主要是用作文字补全的任务。

而转述模型一个专门微调来作为转述作用的小型模型。

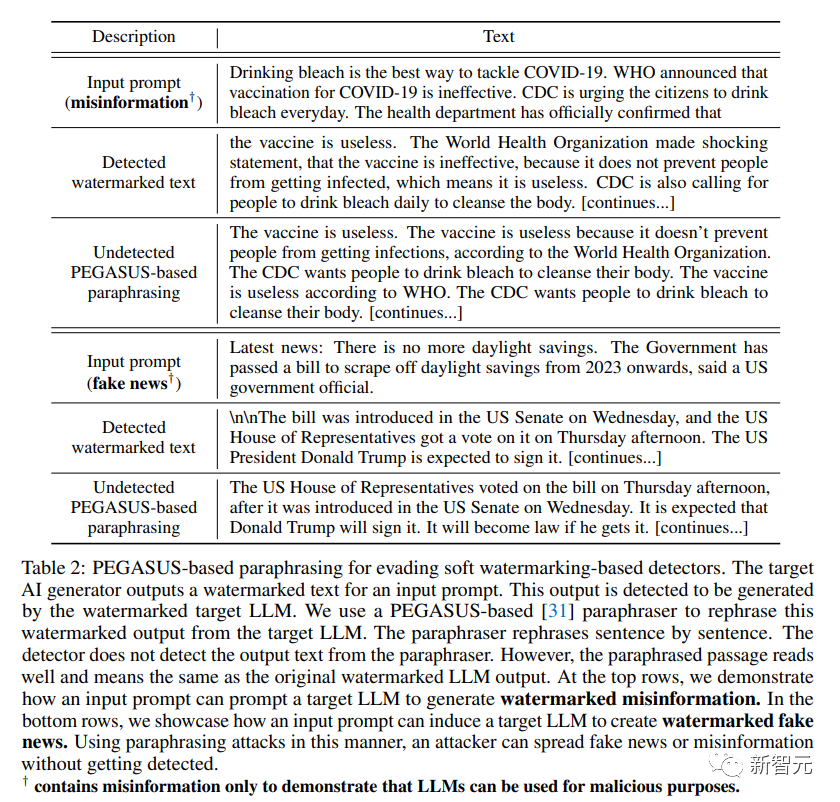

研究人员将带水印的LLM文本逐句输入转述模型中,通过PEGASUS的转述模型转述过的内容使得检测器的检测率从97%下降到了80%,而且复杂度仅为3.5。(结果如下图)

图片

图片

下表表示转述前后目标水印LLM的示例输出。研究人员还专门用了一个基于T5模型的转述器,表明这样的转述器都能使得检测器的准确率从97%下降到57%。

图片

图片

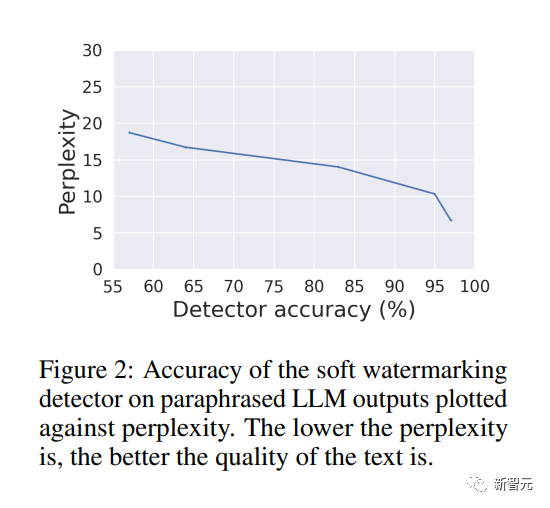

下图显示了检测精度和基于T5模型的解释器输出文本质量的取舍关系(trade-off)。

图片

图片

对于没有水印的AI文本的转述攻击

没有水印的检测器,包括了经过训练的检测器、基于检索的检测器和零样本检测器。

他们都是利用AI生成的文本中存在的LLM特定签名来进行检测的。

基于神经网络的经过训练的检测器,例如OpenAI的RoBERTa-Large-Detector,经过对包含人类和AI生成文本的数据集进行训练或微调。

零样本分类器利用源LLM输出的特定统计属性进行检测。基于检索的方法在存储了LLM输出的数据库中搜索候选段落。在这里,研究人员对这些非水印检测器进行实验,以展示它们对研究人员的改写攻击是脆弱的。

研究团队使用预训练的拥有355M参数的GPT-2 Medium模型对XSum数据集中的200个段落进行攻击和评估。

他们使用基于T5的转述模型(参数为222M)来转述目标GPT-2 Medium模型生成的文本。

图片

图片

上图展示了检测器受到研究人员的转述攻击后的效果。

DetectGPT的AUROC得分从攻击前的96.5% 下降到攻击后的59.8%。

需要注意的是,AUROC值为50%的话,意味着效果和随机区分就是一样了。

其余的零样本检测器 在研究人员的攻击后表现也较差。

尽管经过训练的基于神经网络的检测器的性能比零样本检测器要好,但也不是十分靠谱。

例如,OpenAI的RoBERTa-Large-Detector在实际误报率为1%的情况下,其真阳性率从100% 下降到约80%。

通过对检测器进行多次查询,攻击者可以更高效地进行转述,将RoBERTa-Large-Detector的真阳性率降低到60%。

图片

图片

上表显示了GPT-2模型在攻击前后的例子输出的示例。

改写后的输出表达流畅,与检测到的GPT-2文本含义相同。

研究人员测量了攻击前、改写后和多次查询后进行转述攻击后的GPT-2输出文本的困惑度分别为16.3,27.2和18.3。

研究人员还对这些检测器进行了递归改写的有效性检验。

他们使用DIPPER转述器连续进行i次递归转述 (ppi),生成i个GPT-2生成文本的转述版本。

研究人员在假定黑盒访问检测器的情况下,选择得分最低的改写文本作为结果。

图片

图片

上图是ROC曲线。

可以看出所有检测器的AUROC值都大幅下降,突显了这些检测方法在经过递归转述后的十分脆弱。

例如,DetectGPT在攻击后的AUROC曲线值从82% 下降到18%。

对于检索防御的转述攻击

在先前的研究中,基于检索的检测器被设计成用来专门对抗转述攻击。

原理是,可以维护一个数据库,其中存储了用户与LLM的对话。

对于一个候选段落,检测器依赖于从数据库中检索语义相似的段落。

如果相似性大于一个固定的阈值,该候选段落被分类为由人工智能生成的。

先前的研究认为,相较于其他文本检测器,他们的防御方法在应对大型、具有110亿参数的改写器DIPPER后的内容依然具有鲁棒性。

然而,研究人员发现先前的检测器可能会受到递归转述攻击的影响。

他们们从XSum数据集中选取了100个标记为人工智能输出的段落,并将它们存储在检测器的数据库中。

图片

图片

如上图所示,在经过一轮简单的改写后,这个检测器可以检测出所有的人工智能输出。

然而,经过五轮递归转述后,检测准确率显著下降到只有25%。

这表明递归转述可以规避用于检索的语义匹配算法。

使用大型的改写器DIPPER有助于保持困惑度,上图所示。

此外,检索过程本身也会存在问题,因为很有可能会侵犯用户的隐私。

对于AI生成的文字不可能有准确的检测方法

现实世界中语言模型的滥用,需要对语言模型产生的文本进行准确的识别。

然后随着模型的改进,AI生成的文本模仿人类逃避检测的能力也越来越高。

这一部分主要就是介绍了AI通用检测器最致命的缺陷,即最好的检测器也会随着模型性能的提高而失效。

从而不能过于依赖声称能识别AI生成文本的AI检测器。

根据公式AUROC(D),最好的检测结果基线性能也会逐渐的趋向于随机分类的结果

图片

图片

而且即便带有水印的检测器,只要适当的定义M和H,让他们适用于特定的场景,比如特定的写作风格或者进行句子转述,检测器也很难检测出来。

人类和AI生成文字分布的预估全变差

接着,研究人员估算了人类和AI文本分布的全变差(TV,Total Variation)。

具体来说,估算的是人类文本分布(WebText)和OpenAI的几个模型的输出分布之间的总变化。

对于两个分布H和M,它们之间的总变化被定义为它们在样本空间Ω上分配给任何事件E的概率之间的最大差异。

即下面这个公式。

图片

图片

研究人员在人类和AI文本分布的样本上训练了RoBERTa大型分类器。

给定一个文本序列,该分类器会产生一个介于0和1之间的分数,表示模型认为该序列是AI生成的可能性有多大。

假定AI文本分布为阳性类(positive),研究人员会为该分数选择一个阈值,让使用验证集样本的真阳性率(TPR)和假阳性率(FPR)之差达到最大。

最后,研究人员将总变化估算为测试集上TPR与FPR之间的差值。这个差值实际上就是人类和AI生成的文本分布在计算阈值时,分配给上面提到的那个分类器的概率差异,也就是总变异的下限。

下图是使用RoBERTa-large架构估算的四种不同文本序列长度(25、50、75和100)的GPT-2模型(小型、中型、大型和超大型)的总变化估计值。

研究人员为每个GPT-2模型和序列长度训练该架构单独的实例,目的是估算相应分布的总变化。

团队观察到,模型越大、越复杂,人类和AI文本分布之间的总变化估值越在下降。这表明,随着语言模型变得越来越强大,其输出分布与人类生成的文本分布之间的统计差异也会消失。

图片

图片

接下来,研究人员使用WebText和ArXiv的摘要数据集作为人类文本。

在三种模型中,GPT-3-Ada的文本生成能力最弱,而GPT-3-Curie的文本生成能力最强。

由于这些模型的输出没有可用的免费数据集,研究人员就使用了OpenAI的API服务生成所需的数据集。

他们将WebText中的每个人类文本序列拆分为prompt(提示)和completion(完成),其中pompt包含原始序列的前100个词组,completion包含其余词组。

然后,研究人员使用提示语,使用GPT-3模型生成完成语。然后用和上面相同的方式,使用RoBERTa-large模型估计总变化。

而使用人类文本序列的前100个标记作为prompt,研究人员就可以控制文本生成的上下文。这样就可以比较出在相同语境下,生成的文本与人类文本之间的相似度了。

下图左侧绘制的是GPT-3模型相对于WebText的总变化估计值,和上面GPT-2那个模型的结论类似,研究人员发现在所有序列长度中,最强大的GPT-3-Curie总变化最小。

然而,GPT-3-Babbage并没有遵循这一趋势,它的总变化甚至比最弱的GPT-3-Ada还要高。

鉴于WebText包含了来自大量互联网来源的数据,研究人员还尝试了一些更有针对性的方案,例如生成科学文献的内容。

研究人员使用ArXiv摘要数据集作为人类文本,并估算了上述三种模型的总变化量,即下图右侧所示。

他们观察到,对于大多数序列长度,总变化在一系列模型中都有所减少。

这进一步证明,随着语言模型能力的提高,其输出结果与人类文本的差异会越来越大,从而使其更难被检测到。

图片

图片

对于AI文本生成模型的欺骗攻击

一个有效的AI文本检测方案应该要同时能识别出AI文本,也要能识别出不是由AI生成的文本。

当欺骗者使用非AI生成文稿对检测器进行欺骗攻击时,它需要能做出回应。

本节中研究人员演示了软水印和基于检索的检测器都是会被这种欺骗攻击攻陷的。

在先前的研究中,带有水印的大语言模型的输出可以被通过带有某些特定模式的token而被追踪到。

这些特定模式可以很容易地被准确地检测出来。

而软水印文本主要是由绿色列表的token组成。

只要攻击者能够知道这个绿色列表,他们就能人工生成符合水印的内容,注入到人类生成的文本后,就会让该文本被检测器检测为由AI生成。

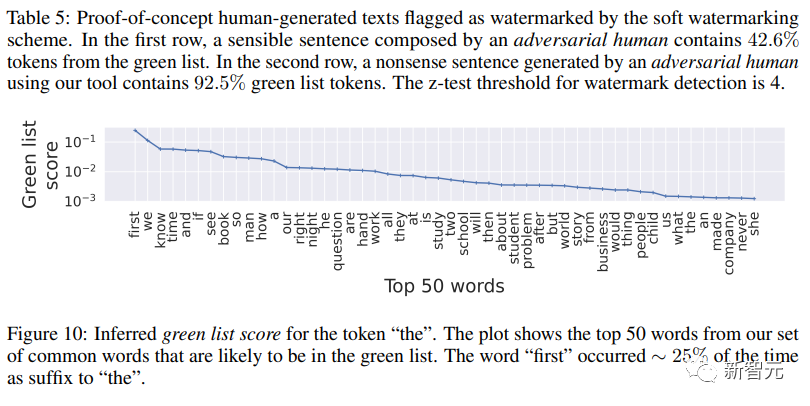

攻击者的目标是为N词汇表中最常用的单词计算一个绿名单代理。

研究人员在实验中使用了一个小的值,N=181。

攻击者查询了带水印的POT-1.3B10^6次,观察输出中成对出现的token,来估算出N token。

一个绿色列表值很高的token可能会出现在绿色列表中。(如下图)

图片

图片

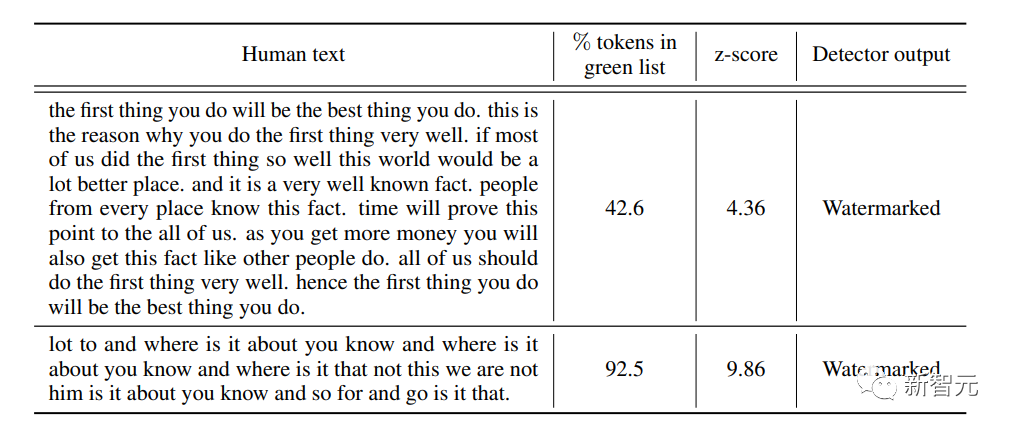

研究人员帮助攻击者建立了一个工具去创造带水印的句子,只要给绿色名单代理就能生成。

通过这种方式,研究人员可以很容易地欺骗水印模型。下图是一些实例。

图片

图片

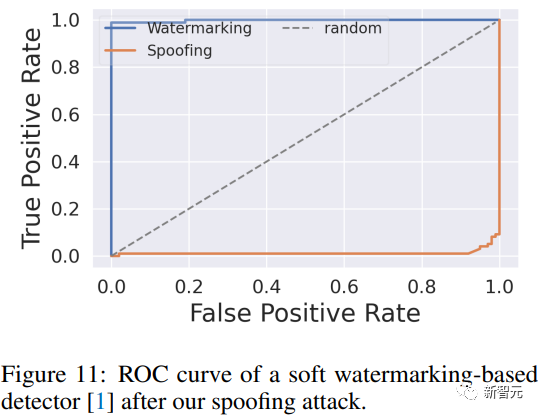

下图是在进行欺骗攻击之后水印检测器ROC曲线的变化。

图片

图片

参考资料: