ICML 2023开奖了!

今年一共有6篇文章摘得杰出论文奖的桂冠,从32篇候选论文中脱颖而出。

官方表示,评选过程包括平均分数筛选,以及程序委员会成员推荐。

然后,选出16个主题的论文,再递交给杰出论文奖的评委会。

最终,评委会成员根据论文的清晰度、洞察力、创造力,以及未来可能的影响力,选择出最后6篇。

下面,就让我们一起来看看这6篇论文吧!

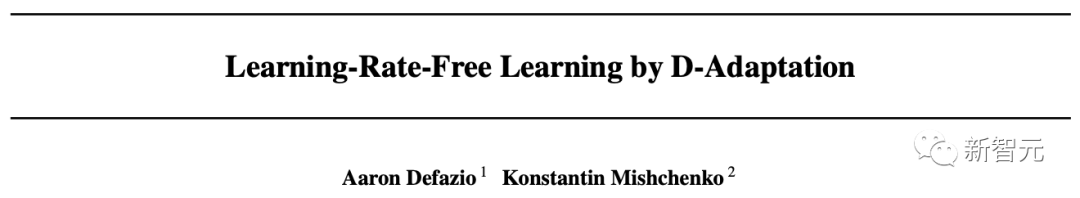

Learning-Rate-Free Learning by D-Adaptation

机构:FAIR,三星AI中心

作者:Aaron Defazio, Konstantin Mishchenko

论文地址:https://openreview.net/forum?id=GXZ6cT5cvY

D-Adaptation是一种自动设置学习率的方法,它可以渐近地达到最小化凸Lipschitz函数的最佳收敛率,无需回溯或直线搜索,每一步也无需额外的函数值或梯度评估。

该方法克服了传统学习率选择在优化此类问题时施加的限制。

研究人员的方法是该类别中第一种超参数自由方法,收敛速度中没有额外的乘法对数因子。

团队还介绍了SGD和Adam变体的大量实验,在这些实验中,研究人员表示的方法自动匹配了十几种不同机器学习问题的人工调整学习率,包括大规模视觉和语言问题。

该项目已开源。

ICML官方认为,作者提出了一种新方法,克服了传统学习率选择在优化此类问题时施加的限制。

这项研究为优化领域做出了宝贵而实用的贡献,因此拿下杰出论文奖。

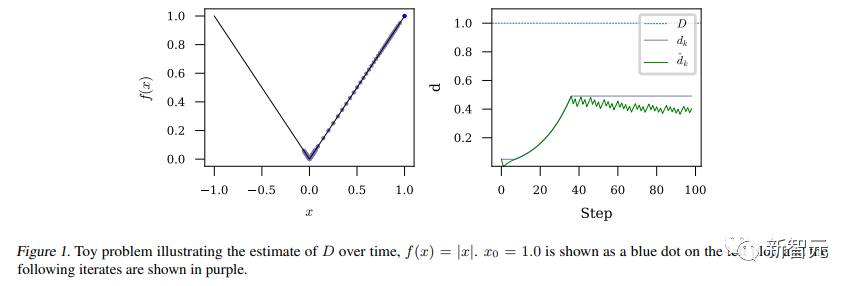

A Watermark for Large Language Models

机构:马里兰大学

作者:John Kirchenbauer, Jonas Geiping, Yuxin Wen, Jonathan Katz, Ian Miers, Tom Goldstein

论文地址:https://openreview.net/forum?id=aX8ig9X2a7

水印的事儿这两天已经聊过很多次了。

从美国7大科技巨头联名加水印,再到有论文证明加了水印也检测不出来,水印到底能不能解决训练数据污染的问题依旧悬而未决。

这篇论文给出了一种给LLM生成的内容加水印的可行方法。

论文摘要:LLM的潜在危害可以通过对模型输出的内容进行水印处理来减轻,即在生成的文本中嵌入信号,这些信号对人类来说不可见,但通过算法可以从短跨度的标记中检测出来。

研究人员为专有的语言模型创建了一个水印框架。嵌入水印对文本质量的影响可以忽略不计,而且可以使用高效的开源算法进行检测,无需访问语言模型的应用程序接口或参数。

工作原理是,在单词生成前随机选择一组绿色标记,然后在采样过程中柔和地促进绿色标记的使用。

研究团队提出了一种可解释p值的水印检测统计测试方法,并推导出一种信息论框架来分析水印的灵敏度。

使用了开放式预训练变换器 (OPT) 系列的参数模型对水印进行了测试,同时还讨论了鲁棒性和安全性问题。

鉴于检测和审核由 LLM 生成的合成文本所面临的严峻挑战,本文有可能对业界产生重大影响,因此获奖。

华人作者Yuxin Wen

他本科毕业于马里兰大学帕克分校,现为马里兰大学帕克分校计算机系博士在读。

Generalization on the Unseen, Logic Reasoning and Degree Curriculum

机构:EPFL,苹果

作者:Emmanuel Abbe, Samy Bengio, Aryo Lotfi, Kevin Rizk

论文地址:https://openreview.net/forum?id=3dqwXb1te4

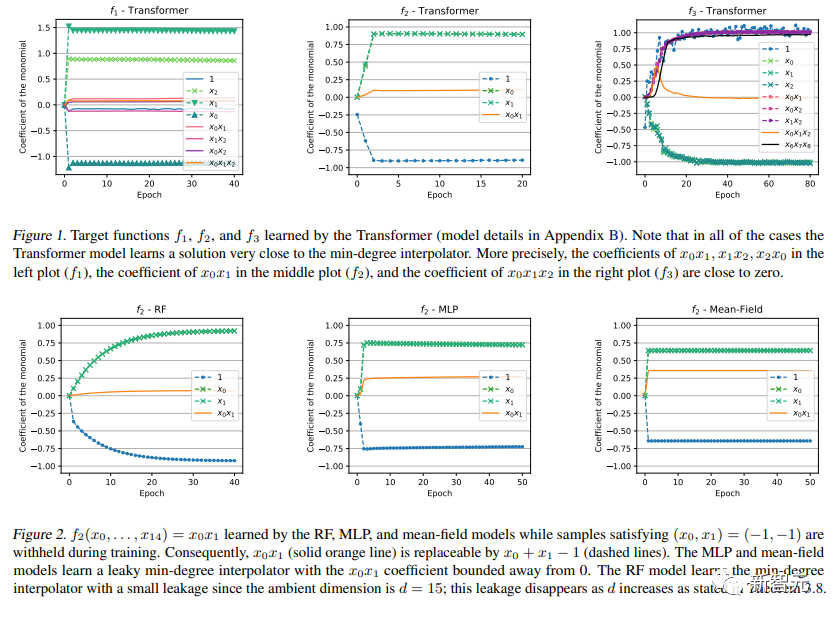

这篇论文探讨了逻辑函数的学习,重点聚焦GOTU设置,这是分布外泛化的一种强有力的实例。

这是因为在某些推理任务(如算术/逻辑)中,数据丰富组合的性质使得代表性数据采样更具挑战性,而在GOTU条件下的成功学习则为「外推」或「推理」学习者提供了第一手资料。

随后,团队研究了由(S)GD训练的不同网络架构在GOTU下的表现,并提供了理论和实验证据,证明对于一类网络模型,包括transformer实例、随机特征模型和对角线性网络,可以在未见数据上学习到最小度插值器(min-degree-interpolator)。

同时,研究人员还证明了其他学习率更高的实例或均值场网络也能达到泄漏的最小度解决方案。

这些发现有两个意义:

(1)为长度泛化问题提供了解释;

(2)引入一种名为Degree-Curriculum的课程学习算法,它能通过递增支持更有效地学习单项式。

ICML官方认为,这篇文章勾勒出深度神经网络领域的一个关键研究方向,从而脱颖而出。

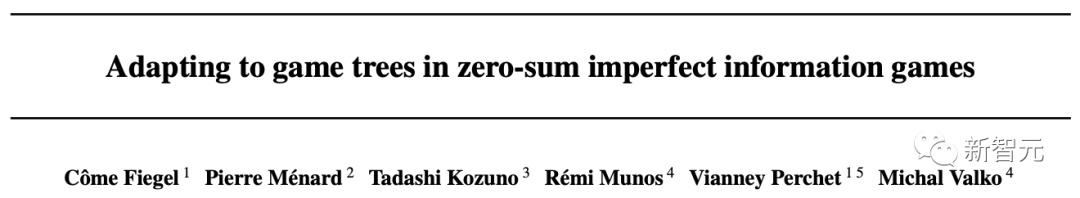

Adapting to game trees in zero-sum imperfect information games

机构: 巴黎理工学院,里昂大学,Omron Sinic X,Deepmind,法国国家经济研究中心,CRITEO AI实验室

作者:Côme Fiegel, Pierre MENARD, Tadashi Kozuno, Remi Munos, Vianney Perchet, Michal Valko

论文地址:https://openreview.net/forum?id=O1j4uFuSVW

ICML官方认为,这个研究严格地建立了一个新颖的下界,并提出了两种算法,Balanced FTRL和Adaptive FTRL。

这些研究成果在不完全信息博弈的优化领域中有着显著的推进作用。

实验充分地证实了这些研究人员所提出的论断。

不完全信息博弈(IIG)是指每个参与者只能观察到部分当前的博弈状态。

研究人员研究如何通过自我对弈和轨迹反馈(Trajectory Feedback)学习零和不完全信息博弈中 的最优策略。

的最优策略。

他们对于学习这些高概率策略所需的实现次数提出了问题不相关(problem-independent)的下界 。

此外,研究人员提出了两种用于这种情境的Follow the Regularized Leader(FTRL)算法:

1.Balance FTRL与该下界相匹配,但需要预先了解信息集结构以定义正则化;

2.Adaptive FTRL则无需这种要求。

Self-Repellent Random Walks on General Graphs - Achieving Minimal Sampling Variance via Nonlinear Markov Chains

机构:艾昆纬,北卡罗来纳州立大学

作者:Vishwaraj Doshi, Jie Hu, Do Young Eun

论文地址:https://openreview.net/forum?id=450iImFM4U

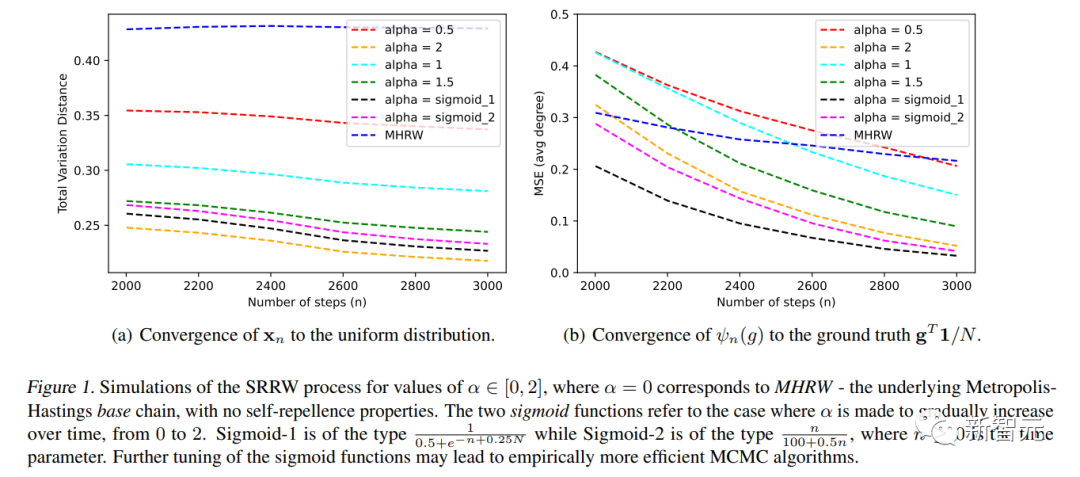

ICML官方评论认为,这篇论文探讨了一个具有挑战性的开放性问题,即使用自我排斥随机游走的MCMC(马尔可夫链蒙特卡洛)方法。

论文超越了传统的非回溯(non-backtracking)方法,并为MCMC抽样研究开辟了新的方向。

作者在马尔可夫链蒙特卡洛文献中做出了原创而且非凡的贡献,而且能把这一过程进行严格的分析和证明是一项令人瞩目的成就。

论文写作流畅,对主要概念给出了清晰而直观的解释,结果令人信服而且全面。

具体来说,团队研究了在离散状态空间上的随机游走问题,例如一般的无向图(general undirect graphs),其中随机游走者通过采样和邻域探索来逼近网络拓扑上的目标量,这种方法采用了马尔可夫链蒙特卡洛(MCMC)过程。

给定任何对应于目标概率分布的马尔可夫链,研究人员设计了一种自我排斥随机游走(SRRW),它在转移时不太可能转向过去高访问的节点,并且更有可能转向很少访问的节点。

对于一类由正实数参数化的SRRW,研究人员证明了过程的经验分布几乎必定收敛于潜在马尔可夫链核的目标(平稳)分布。

然后,他们提供了中心极限定理,并推导了产生的渐近协方差矩阵的精确形式,这使得他们可以证明具有更强斥力(更大参数)的SRRW总是实现更小的渐近协方差,按照协方差矩阵的Loewner排序意义。

特别是对于SRRW驱动的MCMC算法,研究人员证明了渐近抽样方差的减小是按照的阶数,最终趋近于零。

最后,研究人员提供了与理论结果相补充的数值模拟,还经验证明一种随时间增加的版本的SRRW结合了由较大参数引起的较小渐近方差的优势,同时具有观察到的较小参数下SRRW的更快混合性质。

其中的华人作者Jie Hu:

他本科毕业于武汉理工大学,硕士毕业于美国西北大学,博士毕业于北卡罗来纳州立大学,现为北卡罗来纳州立大学计算机工程系助理研究员。

Bayesian Design Principles for Frequentist Sequential Learning

机构:哥伦比亚大学

作者:Yunbei Xu, Assaf Zeevi

论文地址:https://openreview.net/forum?id=tRhQsHnoFw

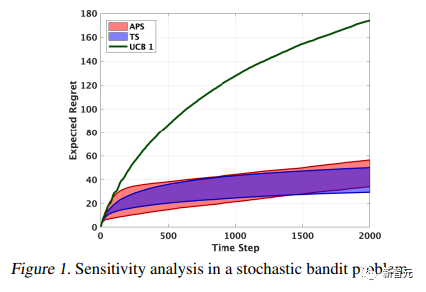

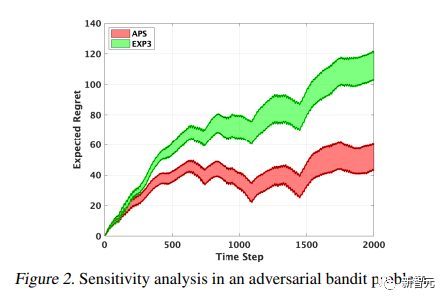

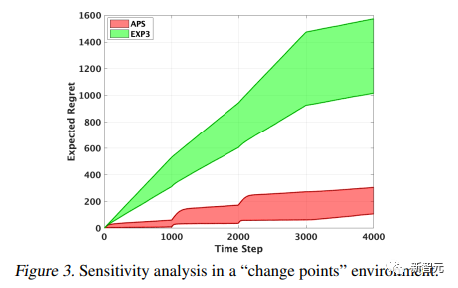

ICML官方认为,该论文解决了设计老虎机和其他顺序决策策略非常普遍的问题。

提出了一种利用新颖的算法信息比率(algorithmic information ratio)来界定任何策略遗憾(regret)的方法,并推导出优化此界限的方法。

与早期类似的信息论量相比,这个界限更紧,而且这些方法在随机和对抗性赌臂环境中表现良好,实现了最佳所有世界。

特别有趣的是,该论文可能为探索与众不同的赌博探索-开发策略打开了一扇新的大门,超越了众所周知的老虎机Thompson Sampling和UCB算法。

而且这个原理扩展到强化学习领域也会非常有前景。

因此,该论文在专家评审中得到了一致的大力支持。

具体来说,研究团队开发了一种通用理论,以优化顺序学习问题中的频率后悔(frequentist regret),从而可以从统一的贝叶斯原理中导出高效的老虎机(bandit)算法和强化学习算法。

他们还提出了一种新颖的优化方法,在每一轮创建"算法信念"(algorithmic beliefs),并利用贝叶斯后验来做决策。

这是首个使贝叶斯类型算法在先验无关(prior-free)的情况下,以一种通用且最优的方式适用于对抗性环境的方法,而且算法简单且易于实现。

作为一个重要应用,研究人员还提出了一种新型多臂老虎机算法,能在随机、对抗性和非平稳环境中实现"最佳的全局表现"。

研究人员还展示了这些原理在线性老虎机、凸老虎机(Convex Bandits)和强化学习中的应用。

论文中的华人一作,Yunbei Xu

他本科毕业于北京大学,博士毕业于哥伦毕业大学,现在在哥伦毕业大学进行博士后研究。