3D 人像合成一直是备受关注的 AIGC 领域。随着 NeRF 和 3D-aware GAN 的日益进步,合成高质量的 3D 人像已经不能够满足大家的期待,能够通过简单的方式自定义 3D 人像的风格属性成为了更高的目标,例如直接使用文本描述指导合成想要的 3D 人像风格。

但是 3D 人像的风格化存在一个普遍的问题,当一个高质量的 3D 人像合成模型训练好后(例如训练一个 EG3D 模型),后续往往很难对其进行较大的风格化改变。基于模型隐空间编辑的方法会受限于预训练 3D 人像合成模型的数据分布;直接对 3D 人像不同视角进行风格化会破坏 3D 一致性;自己收集创建一个风格化的多视角人像数据集成本很高。以上这些问题使得大家难以简单的创建风格化 3D 人像。

本文作者们提出一种简单高效的风格化 3D 人像合成方法,能够快速实现基于文本描述的自定义 3D 人像风格化。

图片

图片

- 论文地址:https://arxiv.org/pdf/2306.15419.pdf

- 项目网站:https://tianxiangma.github.io/FF3D/

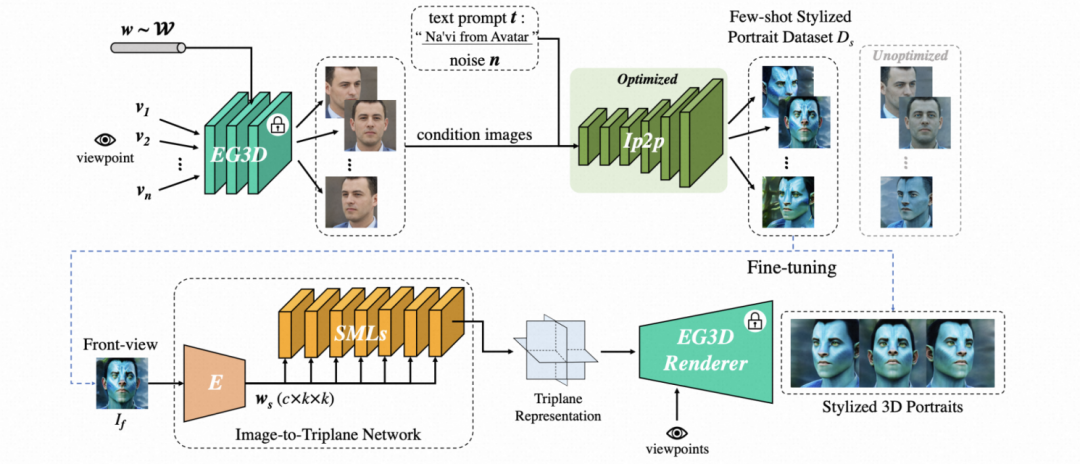

方法框架

该方法的核心步骤有两个:1. 小样本风格化人像数据集构建,2. Image-to-Triplane 模型微调。方法框架如下。

图片

图片

使用两种先验模型构建小样本风格化人像数据集

人工收集多视角风格化人像数据是困难的,但是研究团队可以利用已有的预训练模型来间接构建这种数据。本文采用两个预训练先验模型 EG3D 和 Instruct-pix2pix (IP2P) 来实现这一目标。

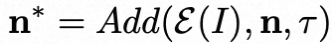

EG3D 是一个高质量的 3D-aware GAN 方法用来提供多视角 3D 一致的人像合成结果,计作: 。theta 是模型的参数,w 是从 W 隐空间随机采样的向量编码,v 是人像的渲染方向。该研究随机采样一个 w,并从 - 30 度到 30 度的俯仰角和偏航角范围内均匀采样 i*i 个不同视角的人像。

。theta 是模型的参数,w 是从 W 隐空间随机采样的向量编码,v 是人像的渲染方向。该研究随机采样一个 w,并从 - 30 度到 30 度的俯仰角和偏航角范围内均匀采样 i*i 个不同视角的人像。

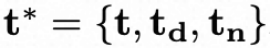

IP2P 是一个文本引导的图像编辑大模型,该研究用其来对不同视角的人像进行风格化编辑,计作: 。phi 是模型参数,I 代表输入的人像图像,n 是随机噪声,c 是文本的条件输入(后面使用 t 来表示)。借助 T ,研究团队可以将上述 i*i 个不同视角的人像进行文本引导的风格化编辑。同时,在实验中研究团队发现 IP2P 在一些文本提示下对于同一个人像的不同视角的风格化编辑结果存在较大的差异。因此该研究对其推理过程进行一些改进,将原始的噪声 n 替换为

。phi 是模型参数,I 代表输入的人像图像,n 是随机噪声,c 是文本的条件输入(后面使用 t 来表示)。借助 T ,研究团队可以将上述 i*i 个不同视角的人像进行文本引导的风格化编辑。同时,在实验中研究团队发现 IP2P 在一些文本提示下对于同一个人像的不同视角的风格化编辑结果存在较大的差异。因此该研究对其推理过程进行一些改进,将原始的噪声 n 替换为 。该式表示将噪声 n 与输入人像 I 的信息进行加权融合,使得不同视角的人像 I 的风格化编辑结果趋紧相同。此外该研究又引入辅助文本提示 td 和消极文本提示 tn 来增强 IP2P 的生成质量,即新的文本提示为

。该式表示将噪声 n 与输入人像 I 的信息进行加权融合,使得不同视角的人像 I 的风格化编辑结果趋紧相同。此外该研究又引入辅助文本提示 td 和消极文本提示 tn 来增强 IP2P 的生成质量,即新的文本提示为 。

。

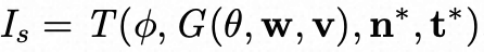

基于上述过程,该研究提出风格化人像合成 pipeline 为:

图片

图片

。该过程为纯模型推理不需要额外的训练。对于 i*i 个不同视角的合成人像,研究团队可以快速构建出一个小样本风格化人像数据集 Ds。

Image-to-Triplane 模型微调

构建出 Ds 后,需要学习一个符合该数据集人像风格的的 3D 模型。针对这个问题,研究团队提出一个 Image-to-Triplane (I2T) 网络,它可以建立人像图像到 Triplane 表征到映射。研究将预训练的 EG3D 模型的 Triplane 合成网络替换为本文提出的的 I2T 网络,并复用剩余的渲染网络。

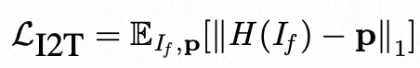

因为 Ds 数据集的不同视角风格化肖像是 3D 不一致的,所以首先需要对 I2T 网络进行预训练,来预先建立人像到 Triplane 表征的准确映射关系。研究团队利用 EG3D 的合成数据来预训练 I2T 网络,训练损失函数如下:

图片

图片

H 代表 I2T 网络,If 为正视角人像图像输入(由 EG3D 采样提供),p 是 Triplane 表征的真值(也由 EG3D 采样提供)。

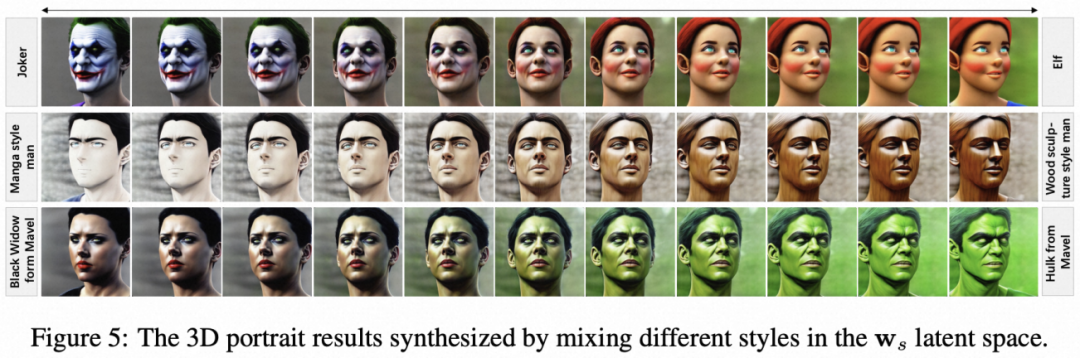

利用预训练的 I2T 网络,研究团队就可以在构建好的 Ds 数据集上进行快速微调,让 I2T 的隐空间拟合到 Ds 数据集风格分布。模型微调的损失函数包含重建损失和密度正则损失: 该模型微调是十分高效的,可以在 3 分钟左右完成。至此,就能够得到一个自定义风格(使用文本提示 t 指定)的 3D 人像模型。

该模型微调是十分高效的,可以在 3 分钟左右完成。至此,就能够得到一个自定义风格(使用文本提示 t 指定)的 3D 人像模型。

实验

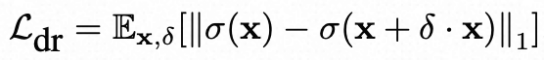

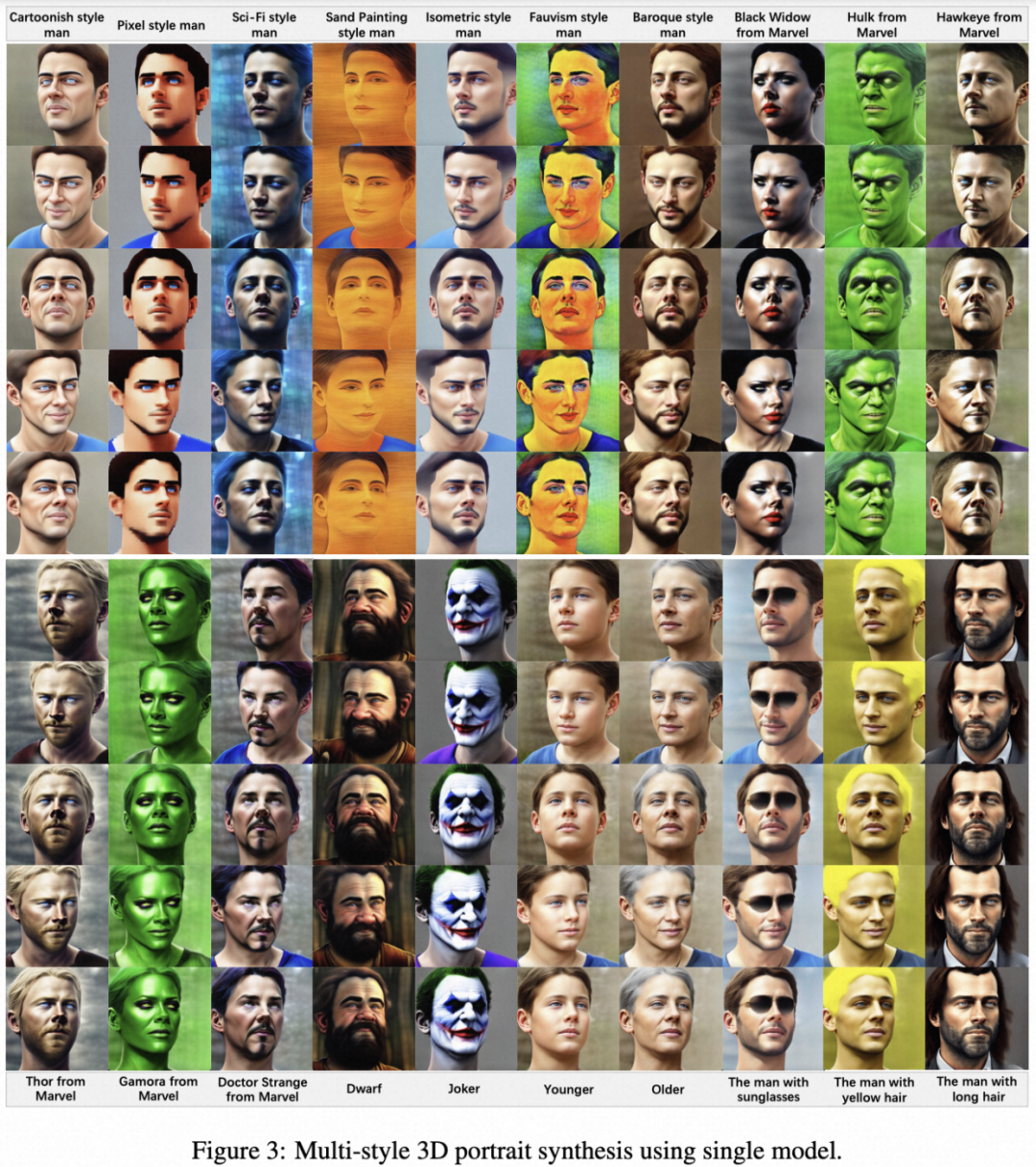

在本文的首页所展示的就是一系列高质量的风格化 3D 人像合成结果。为了验证本文方法的可扩展性,研究团队构建了一个多风格多身份人像数据集。他们利用 ChatGPT 生成 100 种不同风格类型的问题提示,包含艺术风格、电影角色风格、游戏角色风格、以及基础属性编辑风格。对于每种风格使用本文的人像风格化 pipeline 合成 10*10 张不同视角的风格化人像,进而构建出包含 10,000 张图像的多风格单身份人像数据集(MSSI)。此外,在 MSSI 的基础上扩展每种风格的身份属性,即随机采样不同的 w 向量,得到多风格多身份人像数据集(MSMI)。该方法在这两个数据集上的微调模型的 3D 人像合成结果如下:

图片

图片

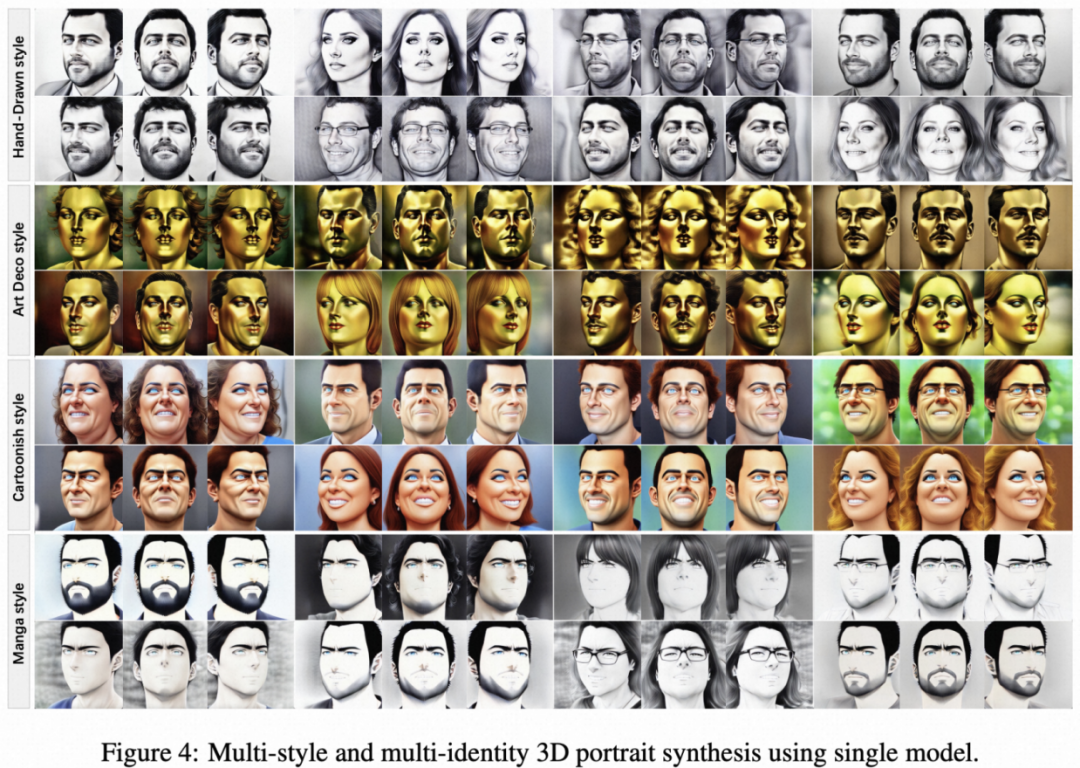

在 I2T 的 ws 隐空间进行插值即可实现 3D 人像的风格变化:

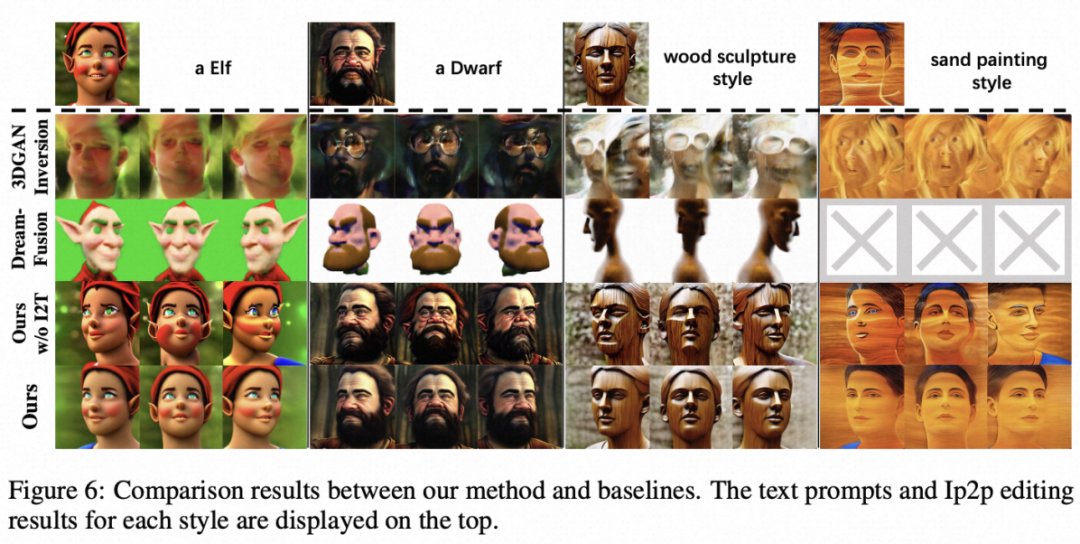

该方法与 baseline 方法的对比结果如下:

更多的方法细节和实验结果请参考论文原文以及项目网站。