哈喽,大家好。

最近在研究AIGC方面的内容,好久没有更新公众号内容。

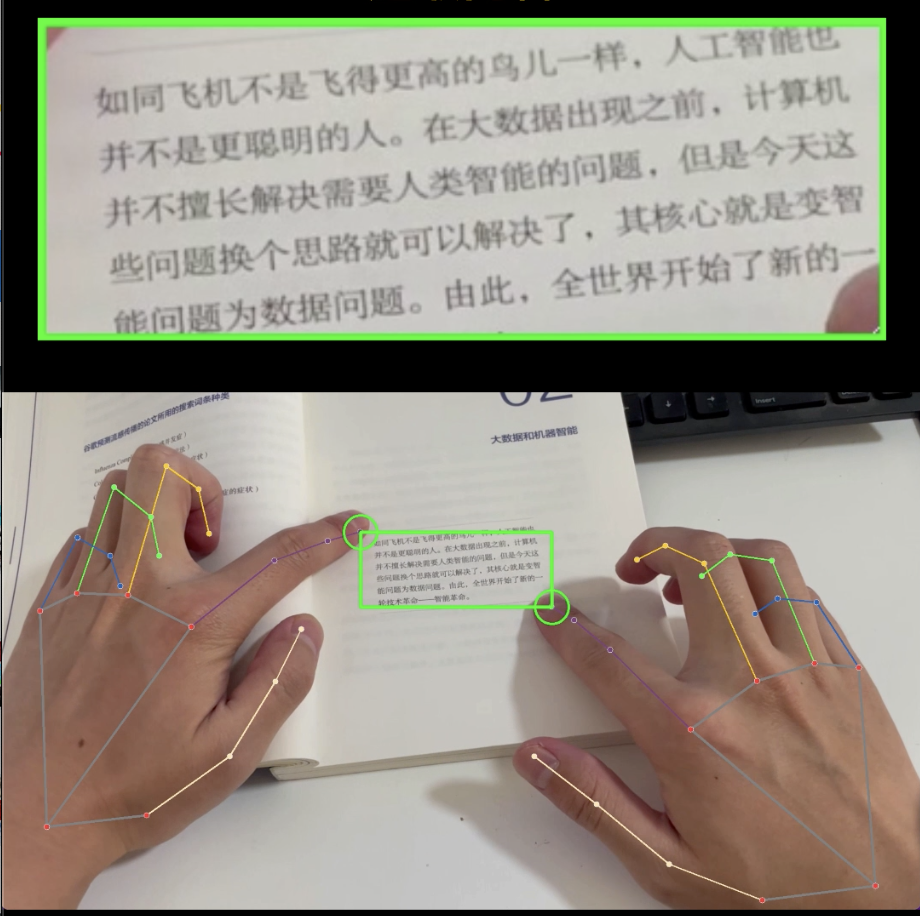

今天给大家分享的是用计算机视觉技术做一个虚拟点读机。

图片

图片

技术上很简单,只不过工程实现先有些细节需要注意。

1. 思路

- OpenCV读取视频流,识别食指坐标

- 用两个食指坐标作为顶点,画一个矩形框

- 截取矩形框,送入OCR模型识别文本

- 用语音合成引擎TTS将文本合成语音

- 调用音频播放模块,播放声音

2. 细节处理

OpenCV读取视频流、mediapipe识别食指坐标,之前的分享的文章都有代码,这里就不贴了,重点说下需要处理的细节。

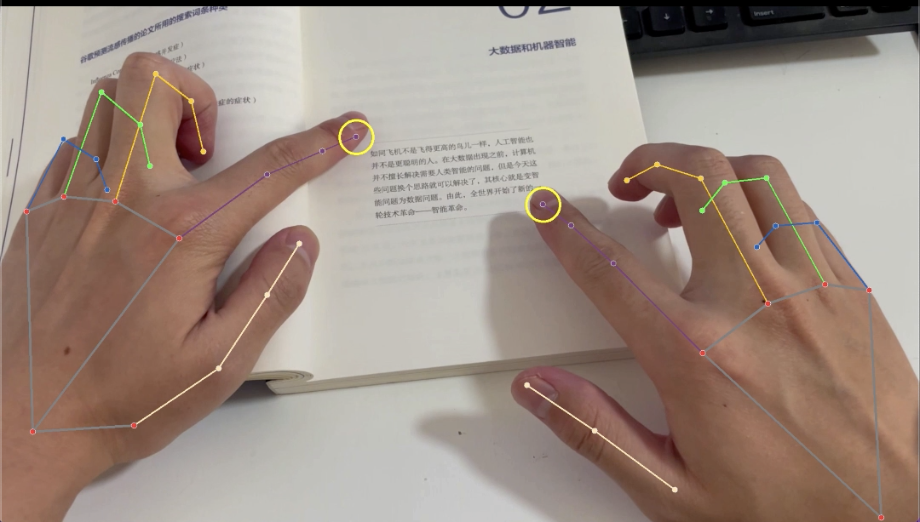

细节1. 检测到两个食指时,需要设置一个时间间隔,这样可以给你预留一些时间来调整矩形框

if self.point_start_time is None:

# 首次同时检测到左右食指

self.point_start_time = time.time()

else:

time_del = time.time() - self.point_start_time

if time_del > 3: 图片

图片

细节2. 设置标记,防止重复识别

矩形框一旦确定,如果没有标记,每一帧都会送入OCR模型识别、然后播放声音,这样程序就会卡死。

需要设置标记,保证任何时刻只处理一个矩形框。

if not self.is_processing:

# 开始识别

self.is_processing = True

# ocr识别选定的图片

t, b = min(p0_y, p1_y), max(p0_y, p1_y)

l, r = min(p0_x, p1_x), max(p0_x, p1_x)

selected_frame = frame[t:b, l:r]

# ocr识别文字

text = self.ocr_rec(selected_frame)

# 文本转语音

voice = self.tts.get_speech(text)

# 播放语音

self.player.play(voice, False, notallow=lambda: self.stop_play())

self.pc_time = time.time()细节3. 多线程处理

播放音频的时候需要用多线程播放,不然主程序会卡死,知道音频播放完成才能继续运行。

如果识别的内容很多,播放时间长,程序就会一直卡着很长时间没有反应。

3. 其他技术

关于OCR和TTS技术之前的文章都有介绍过。

OCR直接用Paddle框架和预训练好的模型就行。

TTS如果是Mac可以使用系统自带的,不需要安装其他程序。如果是Windows可以使用微软的edge-tts。edge-tts效果比大部分tts强太多。

也可以用d-id、wav2lip或者sadtalker实现唇形合成,让静态图片朗读文本内容。